MINIMA: Modality Invariant Image Matching

作者: Jiangwei Ren, Xingyu Jiang, Zizhuo Li, Dingkang Liang, Xin Zhou, Xiang Bai

分类: cs.CV

发布日期: 2024-12-27 (更新: 2025-03-29)

备注: Accepted to CVPR 2025. The dataset and code are available at https://github.com/LSXI7/MINIMA

🔗 代码/项目: GITHUB

💡 一句话要点

MINIMA:提出模态不变图像匹配框架,解决跨模态图像匹配泛化性问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 跨模态图像匹配 数据生成 模态不变性 深度学习 图像检索

📋 核心要点

- 现有跨模态图像匹配方法泛化性差,难以适应多种模态和场景,主要原因是训练数据有限。

- MINIMA通过数据引擎,利用生成模型从RGB数据扩展模态,构建大规模跨模态数据集MD-syn。

- 实验表明,在MD-syn上训练的MINIMA显著优于现有方法,并在多种跨模态匹配任务上表现出色。

📝 摘要(中文)

本文提出MINIMA,一个统一的图像匹配框架,用于解决多种跨模态情况下的图像匹配问题。针对不同成像系统/风格造成的模态差异给匹配任务带来的巨大挑战,现有方法试图提取特定模态的不变特征,并在有限的数据集上进行训练,泛化性较差。MINIMA不追求复杂的模块,而是从数据规模化的角度来提升通用性能。为此,我们提出了一个简单而有效的数据引擎,可以自由地生成包含多种模态、丰富场景和准确匹配标签的大型数据集。具体来说,我们通过生成模型,从廉价但丰富的仅RGB匹配数据中扩展模态。在这种设置下,RGB数据集的匹配标签和丰富的多样性被很好地继承到生成的跨模态数据中。受益于此,我们构建了MD-syn,一个新的综合数据集,填补了通用跨模态图像匹配的数据空白。借助MD-syn,我们可以直接在随机选择的模态对上训练任何先进的匹配流程,以获得跨模态能力。在包括19个跨模态案例的领域内和零样本匹配任务上的大量实验表明,我们的MINIMA可以显著优于基线方法,甚至超过特定模态的方法。

🔬 方法详解

问题定义:跨模态图像匹配旨在找到不同成像方式下同一场景的对应关系。现有方法通常针对特定模态设计不变特征,并在小规模数据集上训练,导致模型泛化能力不足,难以适应实际应用中复杂的模态组合。因此,如何提升跨模态图像匹配的通用性和鲁棒性是一个关键问题。

核心思路:MINIMA的核心思路是通过大规模数据来提升模型的泛化能力。具体而言,利用生成模型将廉价且丰富的RGB图像匹配数据扩展到多种模态,从而构建一个包含多种模态、丰富场景和准确匹配标签的大型数据集。这样,模型可以在大规模数据上学习到更通用的跨模态匹配能力。

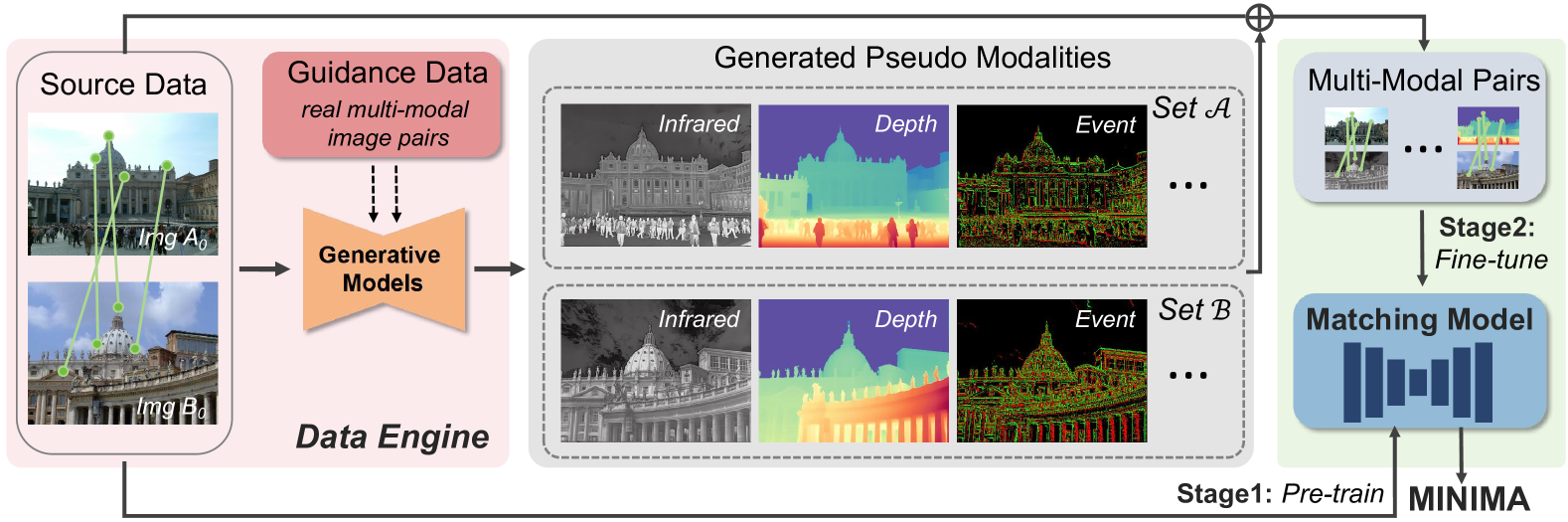

技术框架:MINIMA的整体框架主要包含两个部分:数据引擎和匹配网络。数据引擎负责生成大规模的跨模态数据集MD-syn,它利用生成模型将RGB图像转换为其他模态的图像,并继承RGB图像的匹配标签。匹配网络则是在MD-syn上训练的任意先进的图像匹配pipeline,用于学习跨模态匹配能力。训练时,随机选择模态对进行训练,以增强模型的泛化性。

关键创新:MINIMA的关键创新在于其数据驱动的方法,即通过数据引擎生成大规模的跨模态数据集MD-syn。与现有方法依赖于特定模态的不变特征设计不同,MINIMA通过数据规模化来提升模型的通用性和鲁棒性。这种方法避免了针对特定模态的复杂设计,更加灵活和可扩展。

关键设计:数据引擎的关键在于生成模型的选择和训练。论文中使用了多种生成模型,例如GAN、VAE等,用于将RGB图像转换为其他模态的图像。为了保证生成图像的质量和匹配标签的准确性,需要对生成模型进行仔细的训练和调优。此外,MD-syn数据集的构建也需要考虑模态的多样性和场景的丰富性,以保证模型的泛化能力。

🖼️ 关键图片

📊 实验亮点

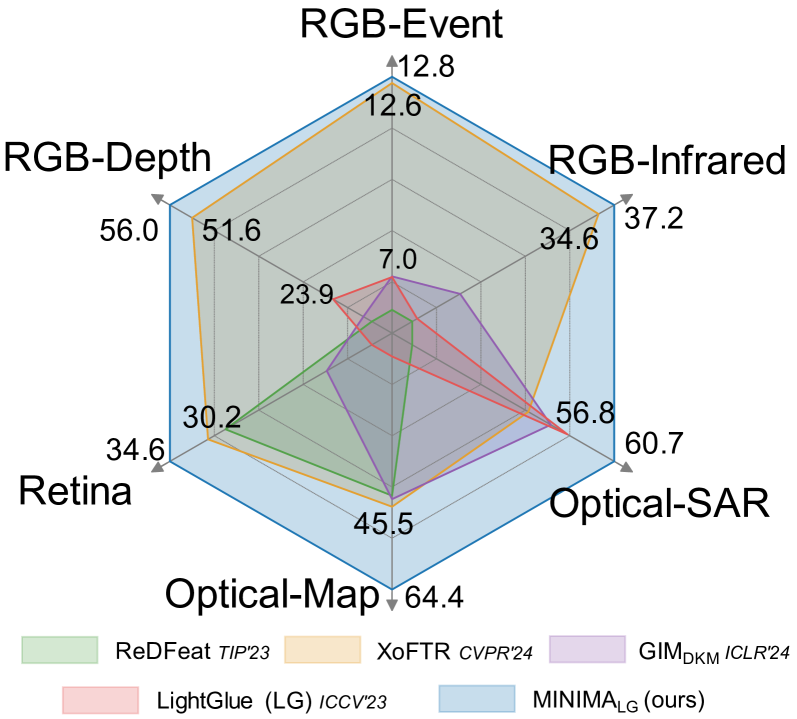

MINIMA在包括19个跨模态案例的领域内和零样本匹配任务上进行了大量实验。实验结果表明,MINIMA显著优于基线方法,甚至超过特定模态的方法。例如,在某些跨模态匹配任务上,MINIMA的性能提升超过10%。这些结果验证了MINIMA的有效性和泛化能力。

🎯 应用场景

MINIMA在多模态感知领域具有广泛的应用前景,例如自动驾驶、机器人导航、遥感图像分析、医学图像诊断等。通过跨模态图像匹配,可以融合不同传感器获取的信息,提高环境感知和决策的准确性和可靠性。此外,该方法还可以应用于跨模态图像检索、三维重建等任务,具有重要的实际价值和未来影响。

📄 摘要(原文)

Image matching for both cross-view and cross-modality plays a critical role in multimodal perception. In practice, the modality gap caused by different imaging systems/styles poses great challenges to the matching task. Existing works try to extract invariant features for specific modalities and train on limited datasets, showing poor generalization. In this paper, we present MINIMA, a unified image matching framework for multiple cross-modal cases. Without pursuing fancy modules, our MINIMA aims to enhance universal performance from the perspective of data scaling up. For such purpose, we propose a simple yet effective data engine that can freely produce a large dataset containing multiple modalities, rich scenarios, and accurate matching labels. Specifically, we scale up the modalities from cheap but rich RGB-only matching data, by means of generative models. Under this setting, the matching labels and rich diversity of the RGB dataset are well inherited by the generated multimodal data. Benefiting from this, we construct MD-syn, a new comprehensive dataset that fills the data gap for general multimodal image matching. With MD-syn, we can directly train any advanced matching pipeline on randomly selected modality pairs to obtain cross-modal ability. Extensive experiments on in-domain and zero-shot matching tasks, including $19$ cross-modal cases, demonstrate that our MINIMA can significantly outperform the baselines and even surpass modality-specific methods. The dataset and code are available at https://github.com/LSXI7/MINIMA.