Learning Monocular Depth from Events via Egomotion Compensation

作者: Haitao Meng, Chonghao Zhong, Sheng Tang, Lian JunJia, Wenwei Lin, Zhenshan Bing, Yi Chang, Gang Chen, Alois Knoll

分类: cs.CV, cs.LG, cs.RO

发布日期: 2024-12-26

备注: 9 pages, 3 figures

💡 一句话要点

提出基于运动补偿的单目事件相机深度估计框架,提升深度预测精度。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 事件相机 深度估计 运动补偿 焦点代价 代价聚合

📋 核心要点

- 现有事件相机深度估计方法缺乏物理先验,模型复杂且未能充分利用事件流的时序信息。

- 本文提出基于运动补偿的深度估计框架,通过显式地将运动信息融入深度估计过程来提高精度。

- 实验结果表明,该框架在真实和合成数据集上均优于现有方法,绝对相对误差降低高达10%。

📝 摘要(中文)

本文提出了一种基于运动补偿的单目事件相机深度估计框架。现有方法通常将事件流视为黑盒学习系统,忽略了物理先验知识,导致模型参数过多且未能充分利用事件相机数据中的丰富时序信息。为解决此问题,本文融入了物理运动原理,构建了一个可解释的单目深度估计框架,其中深度假设的可能性由运动补偿的效果显式确定。为此,提出了焦点代价判别(FCD)模块,该模块测量边缘的清晰度作为焦点水平的关键指标,并整合空间环境以促进代价估计。此外,分析了框架中的噪声模式,并通过新引入的假设间代价聚合(IHCA)模块对其进行改进,该模块通过代价趋势预测和多尺度代价一致性约束来细化代价体。在真实和合成数据集上的大量实验表明,所提出的框架在绝对相对误差指标方面优于最先进的方法高达10%,显示出卓越的预测精度。

🔬 方法详解

问题定义:论文旨在解决单目事件相机深度估计问题。现有方法主要将事件流作为黑盒进行学习,忽略了事件相机数据中蕴含的物理运动信息,导致模型参数过多,泛化能力差,并且未能充分利用事件相机高时间分辨率的优势。这些方法在高速或低光照等挑战性场景下的表现仍然有待提高。

核心思路:论文的核心思路是将物理运动原理融入到深度估计过程中。通过运动补偿,将事件流与相机自身的运动信息相结合,显式地确定不同深度假设的可能性。这种方法利用了事件相机对运动敏感的特性,并结合了相机运动的先验知识,从而提高了深度估计的准确性和鲁棒性。

技术框架:整体框架包含以下几个主要模块:1) 事件数据输入:接收事件相机产生的事件流数据。2) 运动估计:估计相机的自身运动(Egomotion)。3) 焦点代价判别(FCD)模块:该模块用于评估不同深度假设下的图像清晰度,作为深度估计的依据。FCD模块通过测量边缘的清晰度来判断焦点水平,并整合空间信息以提高代价估计的准确性。4) 假设间代价聚合(IHCA)模块:该模块用于优化代价体,通过代价趋势预测和多尺度代价一致性约束来减少噪声的影响,提高深度估计的精度。5) 深度图生成:根据优化后的代价体,生成最终的深度图。

关键创新:论文的关键创新在于:1) 将物理运动原理显式地融入到事件相机的深度估计中,避免了黑盒学习方法对大量数据的依赖。2) 提出了焦点代价判别(FCD)模块,该模块能够有效地评估不同深度假设下的图像清晰度,为深度估计提供可靠的依据。3) 提出了假设间代价聚合(IHCA)模块,该模块能够有效地减少噪声的影响,提高深度估计的精度。与现有方法相比,该方法更具可解释性,并且能够更好地利用事件相机数据的时序信息。

关键设计:FCD模块的关键设计在于边缘清晰度的度量方式,以及空间信息的整合策略。IHCA模块的关键设计在于代价趋势预测的算法,以及多尺度代价一致性约束的实现方式。具体的损失函数设计未知。网络结构细节未知。

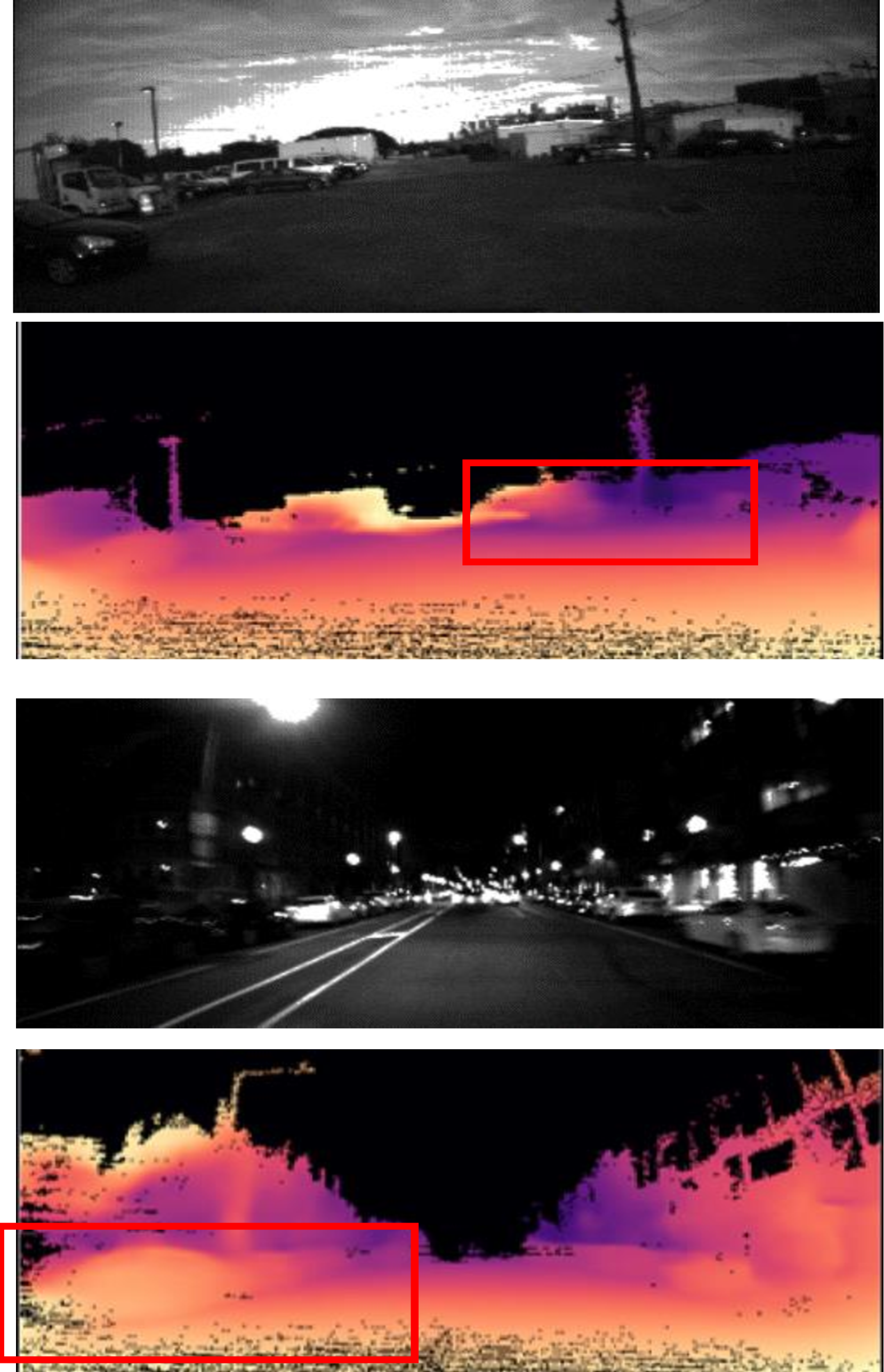

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在真实和合成数据集上均优于现有最先进的方法,在绝对相对误差指标上取得了高达10%的提升。这表明该方法能够更准确地估计场景的深度信息,尤其是在具有挑战性的场景下,例如高速运动和低光照条件。

🎯 应用场景

该研究成果可应用于自动驾驶、机器人导航、增强现实等领域。在自动驾驶中,可以利用事件相机在高速运动和低光照条件下的优势,提高车辆对周围环境的感知能力。在机器人导航中,可以帮助机器人更好地理解周围环境的深度信息,从而实现更精确的定位和导航。在增强现实中,可以为用户提供更逼真的虚拟现实体验。

📄 摘要(原文)

Event cameras are neuromorphically inspired sensors that sparsely and asynchronously report brightness changes. Their unique characteristics of high temporal resolution, high dynamic range, and low power consumption make them well-suited for addressing challenges in monocular depth estimation (e.g., high-speed or low-lighting conditions). However, current existing methods primarily treat event streams as black-box learning systems without incorporating prior physical principles, thus becoming over-parameterized and failing to fully exploit the rich temporal information inherent in event camera data. To address this limitation, we incorporate physical motion principles to propose an interpretable monocular depth estimation framework, where the likelihood of various depth hypotheses is explicitly determined by the effect of motion compensation. To achieve this, we propose a Focus Cost Discrimination (FCD) module that measures the clarity of edges as an essential indicator of focus level and integrates spatial surroundings to facilitate cost estimation. Furthermore, we analyze the noise patterns within our framework and improve it with the newly introduced Inter-Hypotheses Cost Aggregation (IHCA) module, where the cost volume is refined through cost trend prediction and multi-scale cost consistency constraints. Extensive experiments on real-world and synthetic datasets demonstrate that our proposed framework outperforms cutting-edge methods by up to 10\% in terms of the absolute relative error metric, revealing superior performance in predicting accuracy.