Relation-aware Hierarchical Prompt for Open-vocabulary Scene Graph Generation

作者: Tao Liu, Rongjie Li, Chongyu Wang, Xuming He

分类: cs.CV, cs.AI

发布日期: 2024-12-26 (更新: 2025-07-13)

备注: Accepted by AAAI-25

🔗 代码/项目: GITHUB

💡 一句话要点

提出关系感知层级提示框架,解决开放词汇场景图生成中文本表示的局限性。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 开放词汇场景图生成 关系感知 层级提示 视觉-语言模型 实体聚类 区域感知 动态选择

📋 核心要点

- 现有开放词汇场景图生成方法受限于固定的文本表示,导致图像-文本对齐的多样性和准确性不足。

- 提出关系感知层级提示框架(RAHP),通过整合主客体和区域信息增强文本表示,提升视觉关系识别能力。

- 在Visual Genome和Open Images v6数据集上,RAHP取得了state-of-the-art的性能,验证了其有效性。

📝 摘要(中文)

开放词汇场景图生成(OV-SGG)通过将视觉关系表示与开放词汇文本表示对齐,克服了封闭集假设的局限性。这使得能够识别新的视觉关系,使其适用于具有多样化关系的真实场景。然而,现有的OV-SGG方法受到固定文本表示的约束,限制了图像-文本对齐的多样性和准确性。为了应对这些挑战,我们提出了关系感知层级提示(RAHP)框架,该框架通过整合主客体和区域特定的关系信息来增强文本表示。我们的方法利用实体聚类来解决关系三元组类别的复杂性,从而有效地整合主客体信息。此外,我们利用大型语言模型(LLM)生成详细的区域感知提示,捕捉细粒度的视觉交互,并提高视觉和文本模态之间的对齐。RAHP还在视觉-语言模型(VLM)中引入了一种动态选择机制,该机制根据视觉内容自适应地选择相关的文本提示,从而减少来自不相关提示的噪声。在Visual Genome和Open Images v6数据集上的大量实验表明,我们的框架始终如一地实现了最先进的性能,证明了其在解决开放词汇场景图生成挑战方面的有效性。

🔬 方法详解

问题定义:开放词汇场景图生成旨在识别图像中实体之间的关系,并用开放词汇表来描述这些关系。现有方法的痛点在于,它们通常使用固定的文本表示来描述关系,这限制了模型捕捉细粒度关系的能力,也难以泛化到未见过的关系类型。

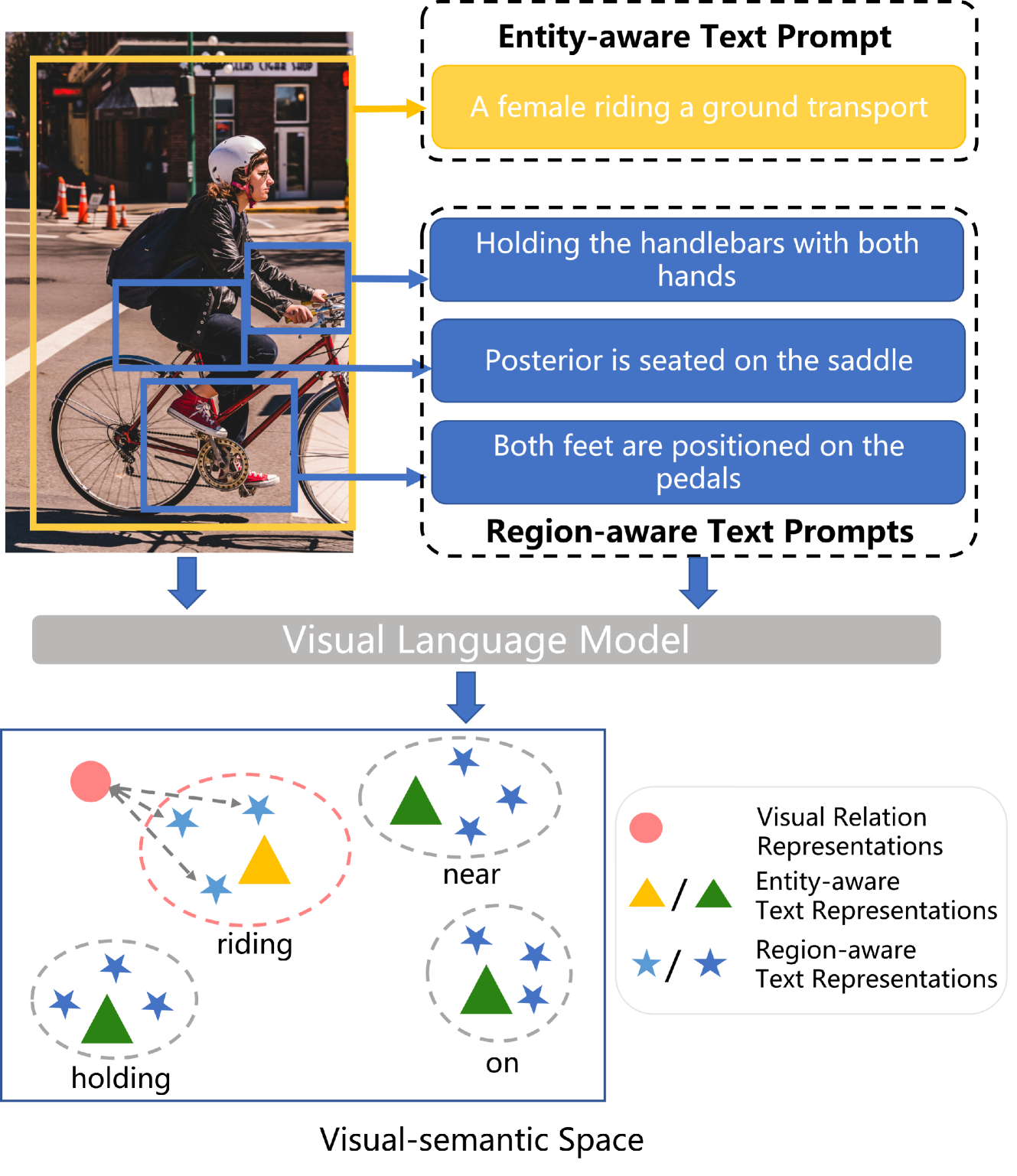

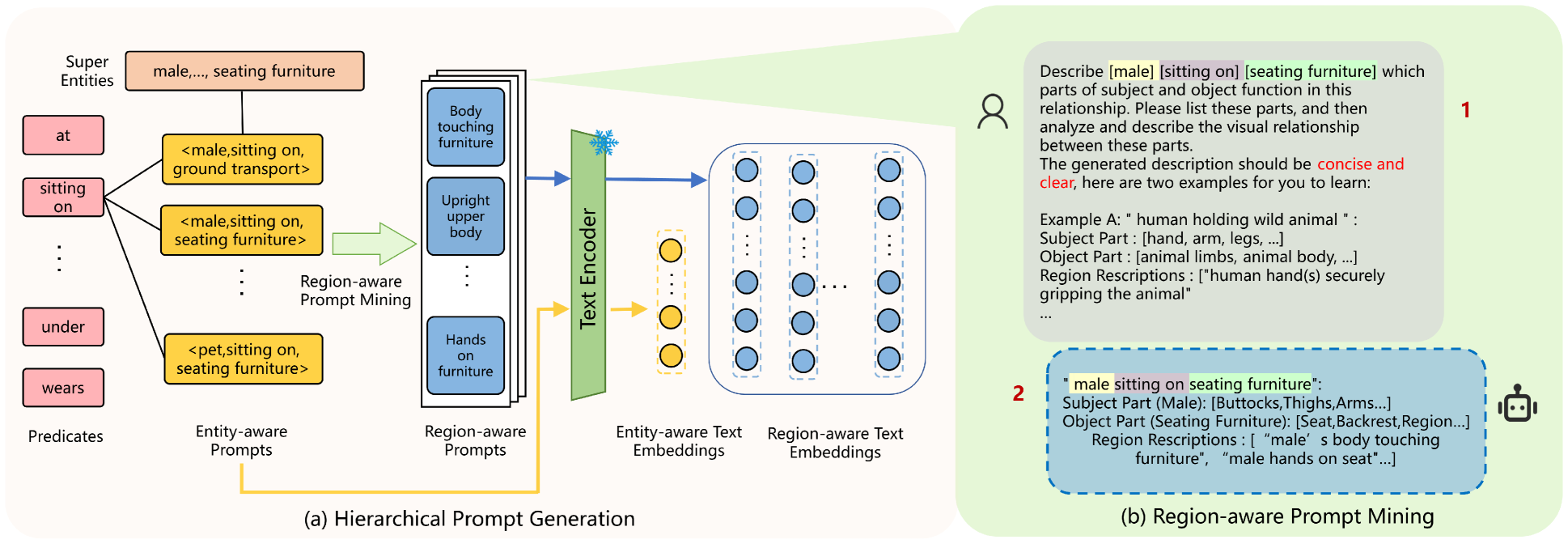

核心思路:RAHP的核心思路是利用层级化的提示来增强文本表示,从而更准确地描述视觉关系。具体来说,它首先通过实体聚类来整合主客体信息,然后利用大型语言模型生成区域感知的提示,最后通过动态选择机制来选择最相关的提示。这样设计的目的是为了更全面、更准确地捕捉视觉关系,并提高图像-文本对齐的质量。

技术框架:RAHP框架主要包含三个模块:1) 实体聚类模块,用于将图像中的实体进行聚类,并提取主客体信息;2) 区域感知提示生成模块,利用大型语言模型生成针对不同区域的详细文本提示;3) 动态选择模块,根据视觉内容自适应地选择最相关的文本提示。整体流程是:输入图像,经过目标检测得到实体及其位置信息,然后通过实体聚类模块提取主客体信息,再利用区域感知提示生成模块生成文本提示,最后通过动态选择模块选择最相关的提示,用于视觉-语言模型的训练和推理。

关键创新:RAHP最重要的技术创新点在于关系感知的层级提示机制。它与现有方法的本质区别在于,它不是使用固定的文本表示,而是根据图像内容动态生成和选择文本提示,从而更灵活、更准确地描述视觉关系。这种层级结构能够有效地整合主客体信息和区域信息,从而提高模型的性能。

关键设计:实体聚类模块使用K-means算法对实体进行聚类,K值的选择需要根据数据集的特点进行调整。区域感知提示生成模块使用预训练的大型语言模型,例如GPT-3,通过prompt engineering来生成高质量的文本提示。动态选择模块使用注意力机制来计算每个提示的权重,并选择权重最高的提示。损失函数采用对比学习损失,鼓励视觉表示和文本表示之间的对齐。

🖼️ 关键图片

📊 实验亮点

RAHP在Visual Genome数据集和Open Images v6数据集上都取得了state-of-the-art的性能。例如,在Visual Genome数据集上,RAHP的Recall@50指标相比于之前的最佳方法提升了超过3个百分点,证明了其在开放词汇场景图生成方面的有效性。实验结果表明,RAHP能够更准确地识别图像中的关系,并生成更丰富的场景图。

🎯 应用场景

该研究成果可应用于智能监控、图像检索、机器人导航等领域。例如,在智能监控中,可以利用场景图生成技术来理解监控视频中的场景,从而实现更智能的异常行为检测。在图像检索中,可以利用场景图作为图像的语义表示,从而实现更准确的图像检索。在机器人导航中,可以利用场景图来理解周围环境,从而实现更安全的导航。

📄 摘要(原文)

Open-vocabulary Scene Graph Generation (OV-SGG) overcomes the limitations of the closed-set assumption by aligning visual relationship representations with open-vocabulary textual representations. This enables the identification of novel visual relationships, making it applicable to real-world scenarios with diverse relationships. However, existing OV-SGG methods are constrained by fixed text representations, limiting diversity and accuracy in image-text alignment. To address these challenges, we propose the Relation-Aware Hierarchical Prompting (RAHP) framework, which enhances text representation by integrating subject-object and region-specific relation information. Our approach utilizes entity clustering to address the complexity of relation triplet categories, enabling the effective integration of subject-object information. Additionally, we utilize a large language model (LLM) to generate detailed region-aware prompts, capturing fine-grained visual interactions and improving alignment between visual and textual modalities. RAHP also introduces a dynamic selection mechanism within Vision-Language Models (VLMs), which adaptively selects relevant text prompts based on the visual content, reducing noise from irrelevant prompts. Extensive experiments on the Visual Genome and Open Images v6 datasets demonstrate that our framework consistently achieves state-of-the-art performance, demonstrating its effectiveness in addressing the challenges of open-vocabulary scene graph generation. The code is available at: https://github.com/Leon022/RAHP