Embodied Image Quality Assessment for Robotic Intelligence

作者: Jianbo Zhang, Chunyi Li, Jie Hao, Jun Jia, Huiyu Duan, Guoquan Zheng, Liang Yuan, Guangtao Zhai

分类: cs.CV

发布日期: 2024-12-25 (更新: 2025-08-18)

🔗 代码/项目: GITHUB

💡 一句话要点

提出MA-EIQA模型和EPD数据集,用于评估机器人生成内容(RGC)的图像质量。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图像质量评估 机器人视觉 具身智能 多尺度注意力 数据集构建

📋 核心要点

- 现有图像质量评估(IQA)主要针对UGC,忽略了RGC的特殊性,可能与机器人任务需求不符。

- 提出MA-EIQA模型,利用多尺度注意力机制,更有效地评估RGC图像质量,贴合机器人感知特性。

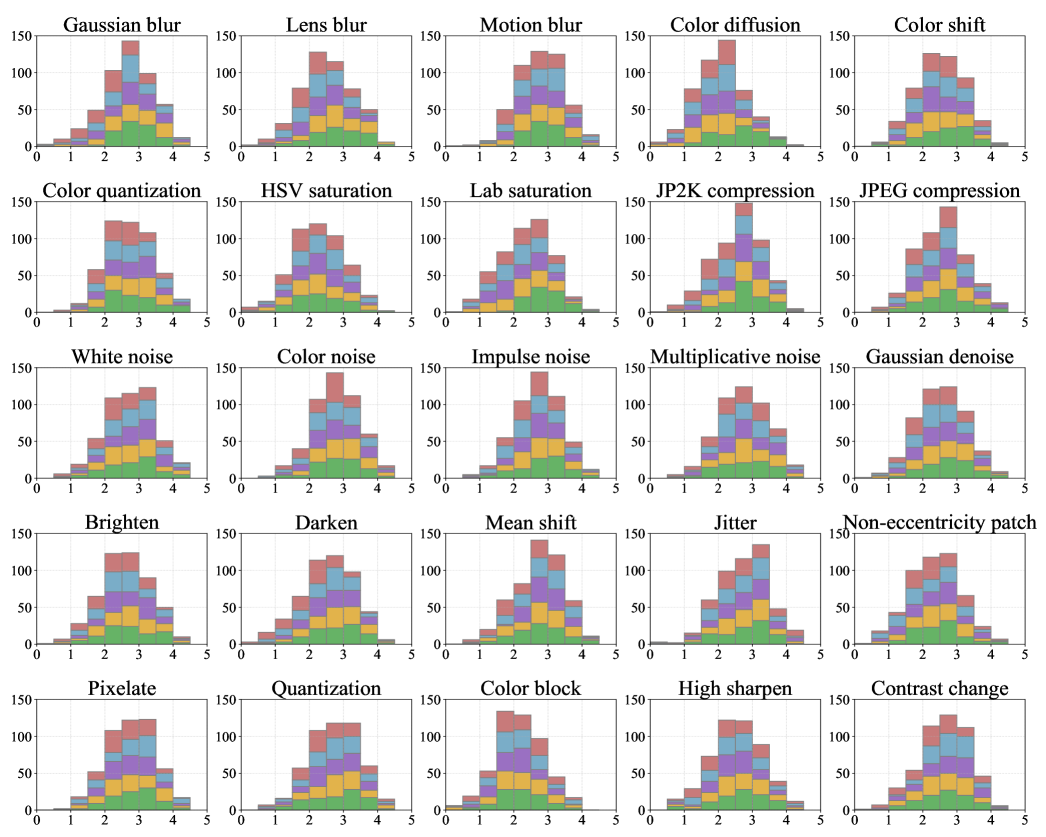

- 构建EPD数据集,包含大量RGC失真图像及其标注,为具身机器人IQA研究提供基准。

📝 摘要(中文)

用户生成内容(UGC)的图像质量评估(IQA)是衡量用户体验(QoE)的关键技术。然而,机器人生成内容(RGC)的图像质量是否表现出与莫拉维克悖论一致的特征,从而可能与人类感知规范相冲突?人类主观评分更多地基于图像的吸引力。具身智能体需要在环境中交互和感知,并最终执行特定任务。视觉图像作为输入直接影响下游任务。本文探讨了具身机器人对图像质量的感知机制。我们提出了第一个具身偏好数据库(EPD),其中包含12,500个失真图像的注释。我们建立了基于机器人下游任务的评估指标。此外,UGC和RGC之间存在差距。为了解决这个问题,我们提出了一种新的多尺度注意力具身图像质量评估方法,称为MA-EIQA。对于所提出的EPD数据集,这是第一个为具身机器人设计的无参考IQA模型。最后,验证了主流IQA算法在EPD数据集上的性能。实验表明,具身图像的质量评估与人类的质量评估不同。我们真诚地希望EPD能够通过关注图像质量评估来促进具身人工智能的发展。基准测试可在https://github.com/Jianbo-maker/EPD_benchmark获得。

🔬 方法详解

问题定义:论文旨在解决机器人生成内容(RGC)的图像质量评估问题。现有图像质量评估方法主要针对用户生成内容(UGC),忽略了RGC的特殊性,例如机器人视觉任务对图像细节和特定区域的关注程度可能与人类感知不同。因此,直接应用UGC的IQA方法可能无法准确反映RGC的质量,进而影响机器人的感知和决策。

核心思路:论文的核心思路是构建一个专门针对RGC的图像质量评估框架,该框架能够学习机器人对图像质量的偏好,并将其与下游任务相关联。通过构建EPD数据集,并设计MA-EIQA模型,使模型能够更好地理解RGC图像质量,从而提升机器人在实际环境中的表现。

技术框架:整体框架包含以下几个主要部分:1) 构建具身偏好数据库(EPD),包含大量RGC失真图像及其标注;2) 提出多尺度注意力具身图像质量评估模型(MA-EIQA),用于评估RGC图像质量;3) 基于EPD数据集,对MA-EIQA模型进行训练和评估,并与现有IQA算法进行比较。

关键创新:论文的关键创新在于:1) 首次关注RGC的图像质量评估问题,并指出其与UGC的区别;2) 构建了EPD数据集,为RGC的IQA研究提供了基准;3) 提出了MA-EIQA模型,该模型利用多尺度注意力机制,能够更有效地评估RGC图像质量。

关键设计:MA-EIQA模型采用多尺度特征提取模块,以捕获不同尺度的图像信息。同时,引入注意力机制,使模型能够关注图像中与机器人任务相关的区域。损失函数的设计也考虑了机器人任务的特殊性,例如可以根据下游任务的性能来调整图像质量的评估标准。具体网络结构和参数设置在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

论文构建了包含12,500张失真图像的EPD数据集,并提出了MA-EIQA模型。实验结果表明,MA-EIQA模型在EPD数据集上取得了优于现有IQA算法的性能。这表明,针对RGC设计的IQA模型能够更准确地评估图像质量,从而提升机器人的感知能力。

🎯 应用场景

该研究成果可应用于机器人视觉、自动驾驶、智能监控等领域。通过准确评估RGC的图像质量,可以提升机器人的感知能力和决策水平,从而提高机器人在复杂环境中的适应性和可靠性。未来,该研究可以进一步扩展到其他类型的机器人生成数据,例如深度图、点云等。

📄 摘要(原文)

Image Quality Assessment (IQA) of User-Generated Content (UGC) is a critical technique for human Quality of Experience (QoE). However, does the the image quality of Robot-Generated Content (RGC) demonstrate traits consistent with the Moravec paradox, potentially conflicting with human perceptual norms? Human subjective scoring is more based on the attractiveness of the image. Embodied agent are required to interact and perceive in the environment, and finally perform specific tasks. Visual images as inputs directly influence downstream tasks. In this paper, we explore the perception mechanism of embodied robots for image quality. We propose the first Embodied Preference Database (EPD), which contains 12,500 distorted image annotations. We establish assessment metrics based on the downstream tasks of robot. In addition, there is a gap between UGC and RGC. To address this, we propose a novel Multi-scale Attention Embodied Image Quality Assessment called MA-EIQA. For the proposed EPD dataset, this is the first no-reference IQA model designed for embodied robot. Finally, the performance of mainstream IQA algorithms on EPD dataset is verified. The experiments demonstrate that quality assessment of embodied images is different from that of humans. We sincerely hope that the EPD can contribute to the development of embodied AI by focusing on image quality assessment. The benchmark is available at https://github.com/Jianbo-maker/EPD_benchmark.