Video Is Worth a Thousand Images: Exploring the Latest Trends in Long Video Generation

作者: Faraz Waseem, Muhammad Shahzad

分类: cs.CV, cs.AI

发布日期: 2024-12-24 (更新: 2025-08-05)

备注: 35 pages, 18 figures, Manuscript submitted to ACM

💡 一句话要点

综述长视频生成最新趋势,探讨生成模型、策略、数据集与评估指标。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长视频生成 视频生成模型 生成对抗网络 扩散模型 视频数据集 视频质量评估 时空一致性

📋 核心要点

- 现有长视频生成方法难以兼顾生成质量、时空一致性和可控性,尤其在视频长度增加时问题更加突出。

- 该综述旨在梳理长视频生成领域的技术现状,为研究人员提供全面的背景知识和未来研究方向的指导。

- 文章涵盖了生成模型、视频生成策略、数据集和评估指标等多个方面,并探讨了分而治之策略的潜力。

📝 摘要(中文)

图像胜过千言万语,而由成百上千帧图像组成的视频则讲述了一个更为复杂的故事。尽管多模态大型语言模型(MLLM)取得了显著进展,但生成长视频仍然是一个艰巨的挑战。目前最先进的系统,如OpenAI的Sora,仍然只能生成最长一分钟的视频。这种限制源于长视频生成的复杂性,它不仅需要生成式AI技术来逼近密度函数,还需要规划、故事发展以及保持空间和时间一致性等关键方面。将生成式AI与分而治之的方法相结合可以提高更长视频的可扩展性,同时提供更大的控制。本综述考察了长视频生成的当前格局,涵盖了GAN和扩散模型等基础技术、视频生成策略、大规模训练数据集、评估长视频质量的指标以及解决现有视频生成能力局限性的未来研究领域。我们相信它将作为一个全面的基础,提供广泛的信息,以指导长视频生成领域的未来发展和研究。

🔬 方法详解

问题定义:长视频生成旨在根据给定的输入(例如文本描述、图像或短视频)生成一段较长时间的连贯视频。现有方法面临的痛点包括:难以维持长时间的时空一致性,生成内容缺乏故事性和规划性,以及计算资源消耗巨大,导致难以扩展到更长的视频。

核心思路:该综述的核心思路是全面梳理长视频生成领域的相关技术,包括底层生成模型(GANs、扩散模型等)、视频生成策略(例如分层生成、循环生成等)、大规模训练数据集和评估指标。通过对这些技术的分析和总结,为研究人员提供一个清晰的全局视角,并指出未来的研究方向。

技术框架:该综述没有提出新的技术框架,而是对现有技术进行了分类和总结。主要涵盖以下几个方面: 1. 生成模型:回顾了GANs和扩散模型在视频生成中的应用。 2. 视频生成策略:讨论了不同的视频生成策略,例如自回归模型、分层模型和循环模型。 3. 大规模数据集:介绍了用于训练长视频生成模型的大规模数据集。 4. 评估指标:总结了用于评估长视频生成质量的指标,包括FID、IS等。

关键创新:该综述的创新之处在于其全面性和系统性。它不是专注于提出一种新的算法,而是对整个长视频生成领域的技术进行了梳理和总结,为研究人员提供了一个有价值的参考。

关键设计:该综述的关键设计在于其组织结构。它按照生成模型、视频生成策略、数据集和评估指标等几个方面对技术进行了分类和总结,使得读者可以快速找到自己感兴趣的内容。此外,该综述还讨论了未来研究方向,例如如何提高长视频的时空一致性、如何生成更具故事性的视频等。

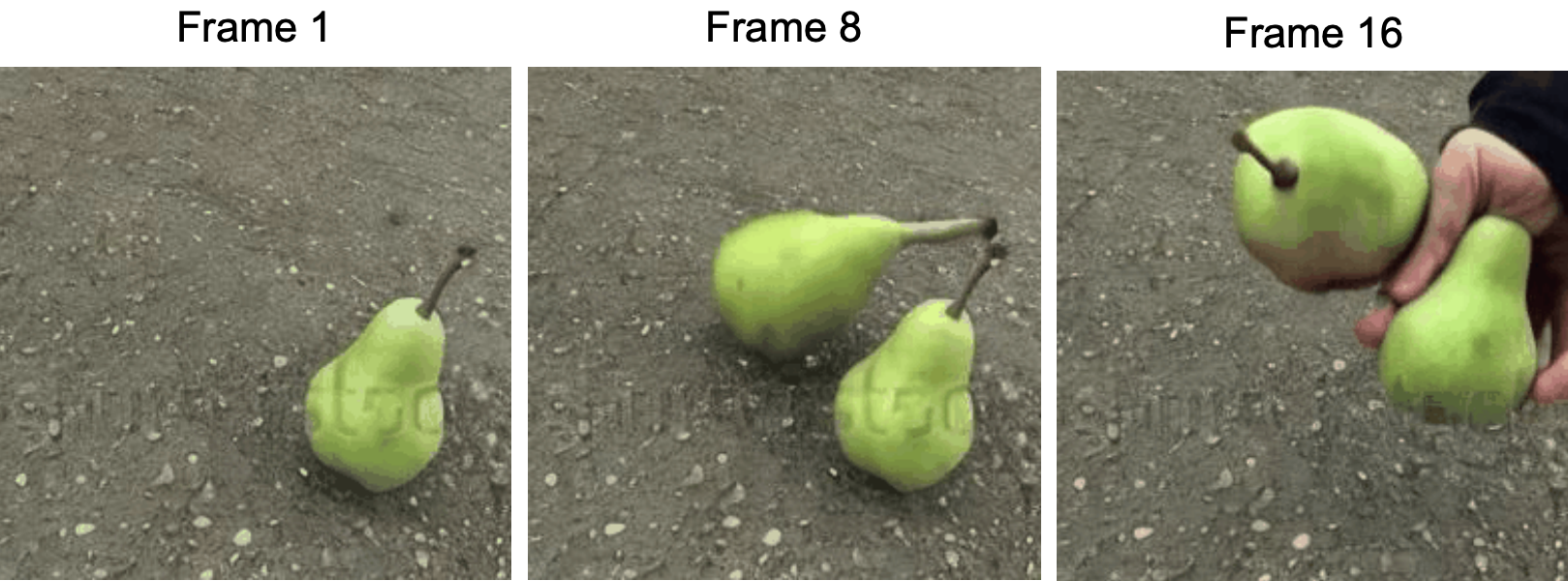

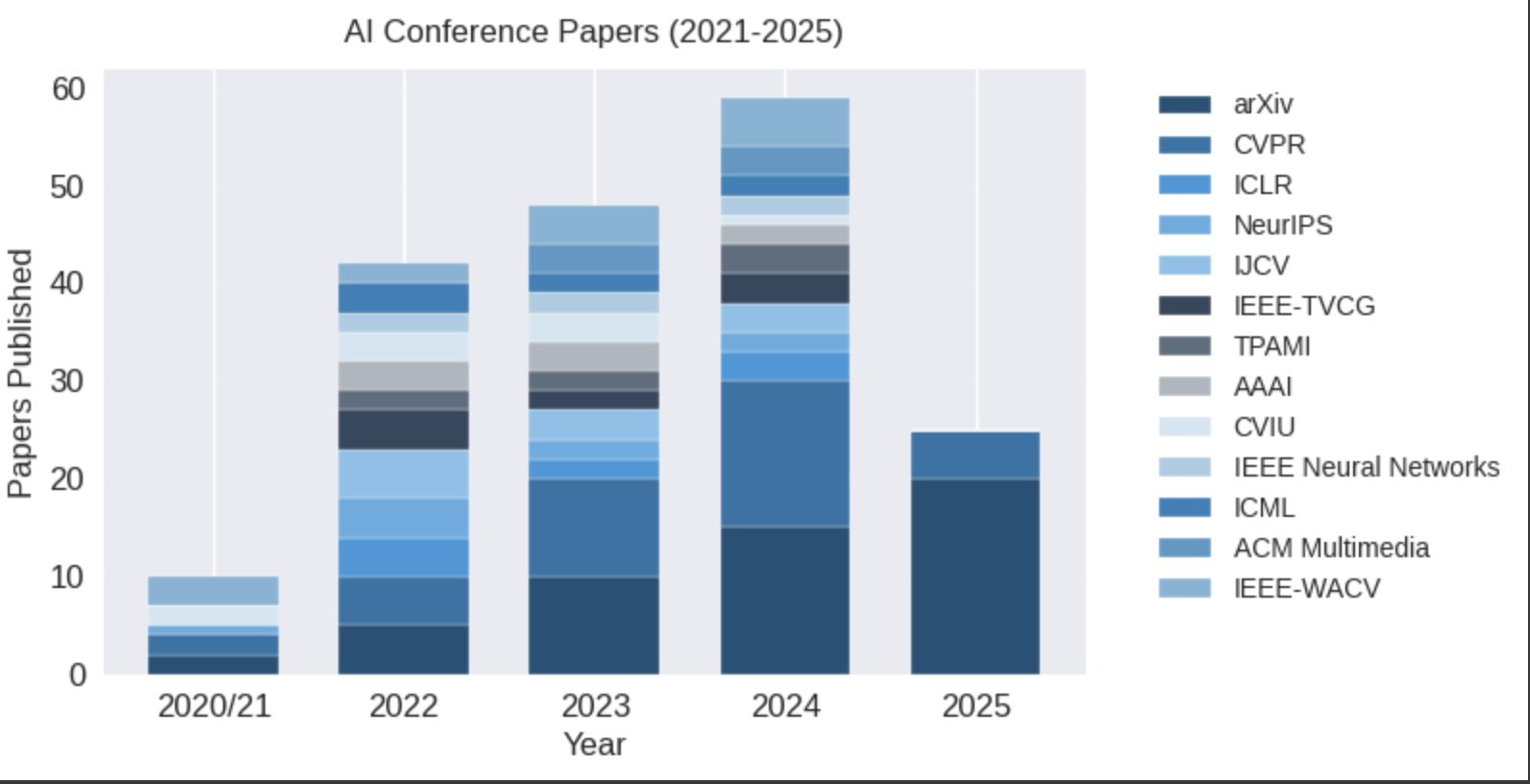

🖼️ 关键图片

📊 实验亮点

该综述全面梳理了长视频生成领域的现有技术,并指出了未来研究方向。它强调了长视频生成面临的挑战,例如时空一致性、故事性以及计算资源消耗等问题。此外,该综述还讨论了分而治之策略在长视频生成中的潜力,并认为将其与生成式AI相结合可以提高可扩展性和可控性。

🎯 应用场景

长视频生成技术具有广泛的应用前景,包括电影制作、游戏开发、广告创意、教育娱乐等领域。例如,可以根据剧本自动生成电影片段,为游戏创建逼真的过场动画,或者生成个性化的教育视频。随着技术的不断发展,长视频生成有望成为内容创作的重要工具。

📄 摘要(原文)

An image may convey a thousand words, but a video composed of hundreds or thousands of image frames tells a more intricate story. Despite significant progress in multimodal large language models (MLLMs), generating extended videos remains a formidable challenge. As of this writing, OpenAI's Sora, the current state-of-the-art system, is still limited to producing videos that are up to one minute in length. This limitation stems from the complexity of long video generation, which requires more than generative AI techniques for approximating density functions essential aspects such as planning, story development, and maintaining spatial and temporal consistency present additional hurdles. Integrating generative AI with a divide-and-conquer approach could improve scalability for longer videos while offering greater control. In this survey, we examine the current landscape of long video generation, covering foundational techniques like GANs and diffusion models, video generation strategies, large-scale training datasets, quality metrics for evaluating long videos, and future research areas to address the limitations of the existing video generation capabilities. We believe it would serve as a comprehensive foundation, offering extensive information to guide future advancements and research in the field of long video generation.