Switch-a-View: View Selection Learned from Unlabeled In-the-wild Videos

作者: Sagnik Majumder, Tushar Nagarajan, Ziad Al-Halah, Kristen Grauman

分类: cs.CV

发布日期: 2024-12-24 (更新: 2025-04-22)

💡 一句话要点

提出Switch-a-View,从无标注视频中学习视角选择,用于生成教学视频。

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 视角选择 无监督学习 教学视频 多视角视频 自监督学习

📋 核心要点

- 现有教学视频制作中,视角选择依赖人工,效率低且主观性强,缺乏自动化的视角切换方法。

- Switch-a-View通过分析无标注的教学视频,学习视觉和语音内容与视角切换之间的关系,实现自动视角选择。

- 在HowTo100M和Ego-Exo4D数据集上的实验表明,该方法能够有效地选择合适的视角,提升视频观看体验。

📝 摘要(中文)

我们提出了SWITCH-A-VIEW,一个能够自动选择视角以用于创建教学视频的模型。该方法的核心在于如何从无标注但经过人工编辑的视频样本中训练模型。我们设计了一个预训练任务,该任务为训练视频中的片段伪标记其主要视角(例如,自我中心或他人中心),然后发现教学视频中的视觉和语音内容与其视角切换时刻之间的模式。有了这个预测器,我们的模型可以应用于新的多视角视频设置,用于编排何时应该显示哪个视角,即使这些设置带有有限的标签。我们在来自HowTo100M和Ego-Exo4D的各种真实视频上展示了我们的想法,并严格验证了它的优势。

🔬 方法详解

问题定义:现有的教学视频制作通常依赖于人工选择视角,这既耗时又容易受到主观偏见的影响。缺乏一种能够自动根据视频内容和上下文选择最佳视角的有效方法。因此,需要解决的问题是如何从大量无标注的教学视频中学习视角选择的策略,从而实现自动化的视角切换。

核心思路:该论文的核心思路是利用大量已有的、人工编辑过的教学视频作为训练数据,从中学习视角切换的模式。通过设计一个自监督的预训练任务,模型能够学习到视频内容(视觉和语音)与视角选择之间的关联性。这种方法避免了对大量标注数据的依赖,使得模型能够更容易地应用于新的多视角视频场景。

技术框架:Switch-a-View的整体框架包含以下几个主要阶段:1) 伪标签生成:利用预训练模型对无标注视频片段进行视角分类,生成伪标签(egocentric或exocentric)。2) 特征提取:提取视频片段的视觉特征(例如,使用预训练的图像或视频模型)和语音特征(例如,使用语音识别模型)。3) 视角切换预测:使用一个模型(例如,Transformer或LSTM)来预测每个时间点的最佳视角,该模型以视觉特征、语音特征和伪标签作为输入。4) 模型训练:使用交叉熵损失函数或其他合适的损失函数来训练视角切换预测模型。

关键创新:该论文的关键创新在于提出了一种从无标注视频中学习视角选择策略的方法。通过设计一个自监督的预训练任务,模型能够学习到视频内容与视角选择之间的关联性,从而避免了对大量标注数据的依赖。此外,该方法还能够应用于新的多视角视频场景,即使这些场景带有有限的标签。

关键设计:在伪标签生成阶段,可以使用预训练的图像分类模型或视频分类模型来区分egocentric和exocentric视角。在特征提取阶段,可以使用预训练的ResNet、CLIP或VideoBERT等模型来提取视觉和语音特征。在视角切换预测阶段,可以使用Transformer或LSTM等序列模型来建模视频内容与视角选择之间的时序关系。损失函数可以选择交叉熵损失函数,也可以根据具体任务进行调整。

🖼️ 关键图片

📊 实验亮点

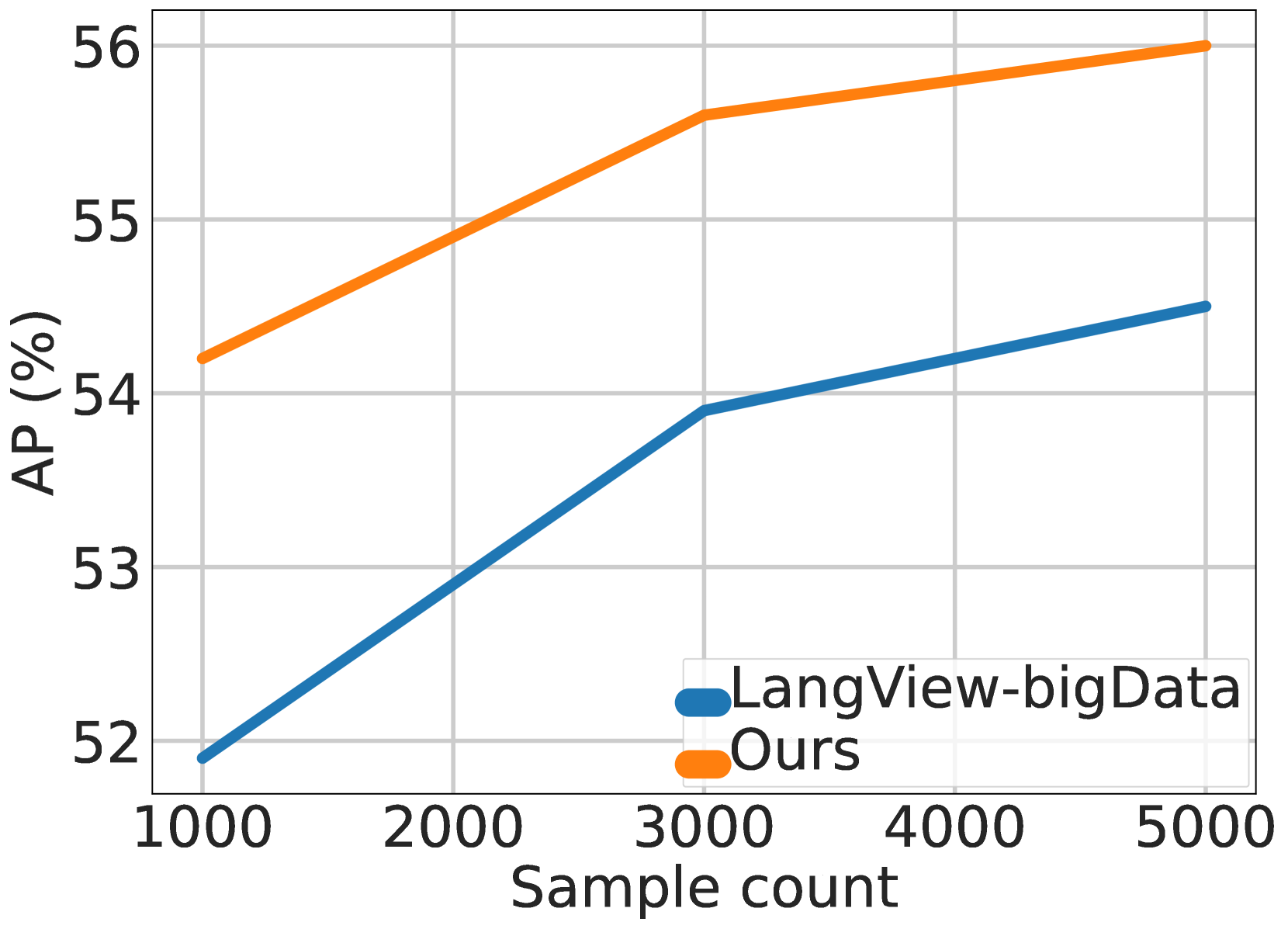

该论文在HowTo100M和Ego-Exo4D数据集上进行了实验,结果表明Switch-a-View能够有效地选择合适的视角。与人工选择的视角相比,Switch-a-View能够达到相近甚至更好的效果。此外,该方法还能够泛化到新的多视角视频场景,即使这些场景带有有限的标签。

🎯 应用场景

该研究成果可广泛应用于教学视频制作、体育赛事直播、监控视频分析等领域。通过自动选择最佳视角,可以提升视频观看体验,提高视频制作效率,并为视频内容理解和分析提供更丰富的信息。未来,该技术有望应用于虚拟现实、增强现实等新兴领域,为用户提供更加沉浸式的体验。

📄 摘要(原文)

We introduce SWITCH-A-VIEW, a model that learns to automatically select the viewpoint to display at each timepoint when creating a how-to video. The key insight of our approach is how to train such a model from unlabeled -- but human-edited -- video samples. We pose a pretext task that pseudo-labels segments in the training videos for their primary viewpoint (egocentric or exocentric), and then discovers the patterns between the visual and spoken content in a how-to video on the one hand and its view-switch moments on the other hand. Armed with this predictor, our model can be applied to new multi-view video settings for orchestrating which viewpoint should be displayed when, even when such settings come with limited labels. We demonstrate our idea on a variety of real-world videos from HowTo100M and Ego-Exo4D, and rigorously validate its advantages. Project: https://vision.cs.utexas.edu/projects/switch_a_view/.