Mulberry: Empowering MLLM with o1-like Reasoning and Reflection via Collective Monte Carlo Tree Search

作者: Huanjin Yao, Jiaxing Huang, Wenhao Wu, Jingyi Zhang, Yibo Wang, Shunyu Liu, Yingjie Wang, Yuxin Song, Haocheng Feng, Li Shen, Dacheng Tao

分类: cs.CV, cs.AI

发布日期: 2024-12-24 (更新: 2024-12-31)

备注: Technical report

🔗 代码/项目: GITHUB

💡 一句话要点

提出CoMCTS,赋能MLLM类o1推理与反思能力,解决复杂问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 蒙特卡洛树搜索 集体学习 推理与反思 视觉问答

📋 核心要点

- 现有MLLM在复杂推理问题上表现不足,缺乏对中间推理步骤的显式建模和学习。

- 提出CoMCTS,通过多模型协作的蒙特卡洛树搜索,学习有效的推理路径,提升推理能力。

- 构建Mulberry-260k数据集,并使用其训练Mulberry模型,实验证明在多个基准测试中性能优越。

📝 摘要(中文)

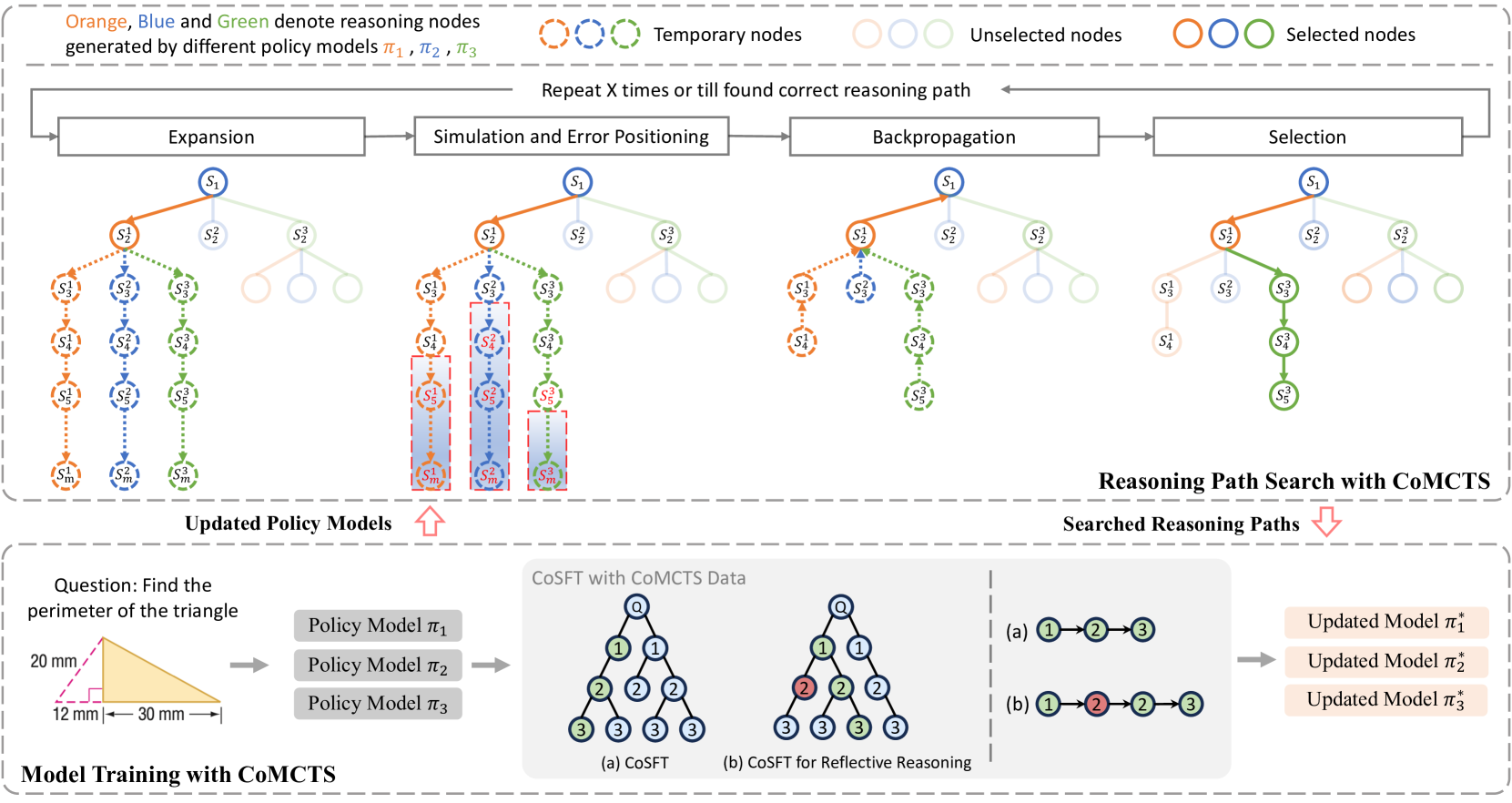

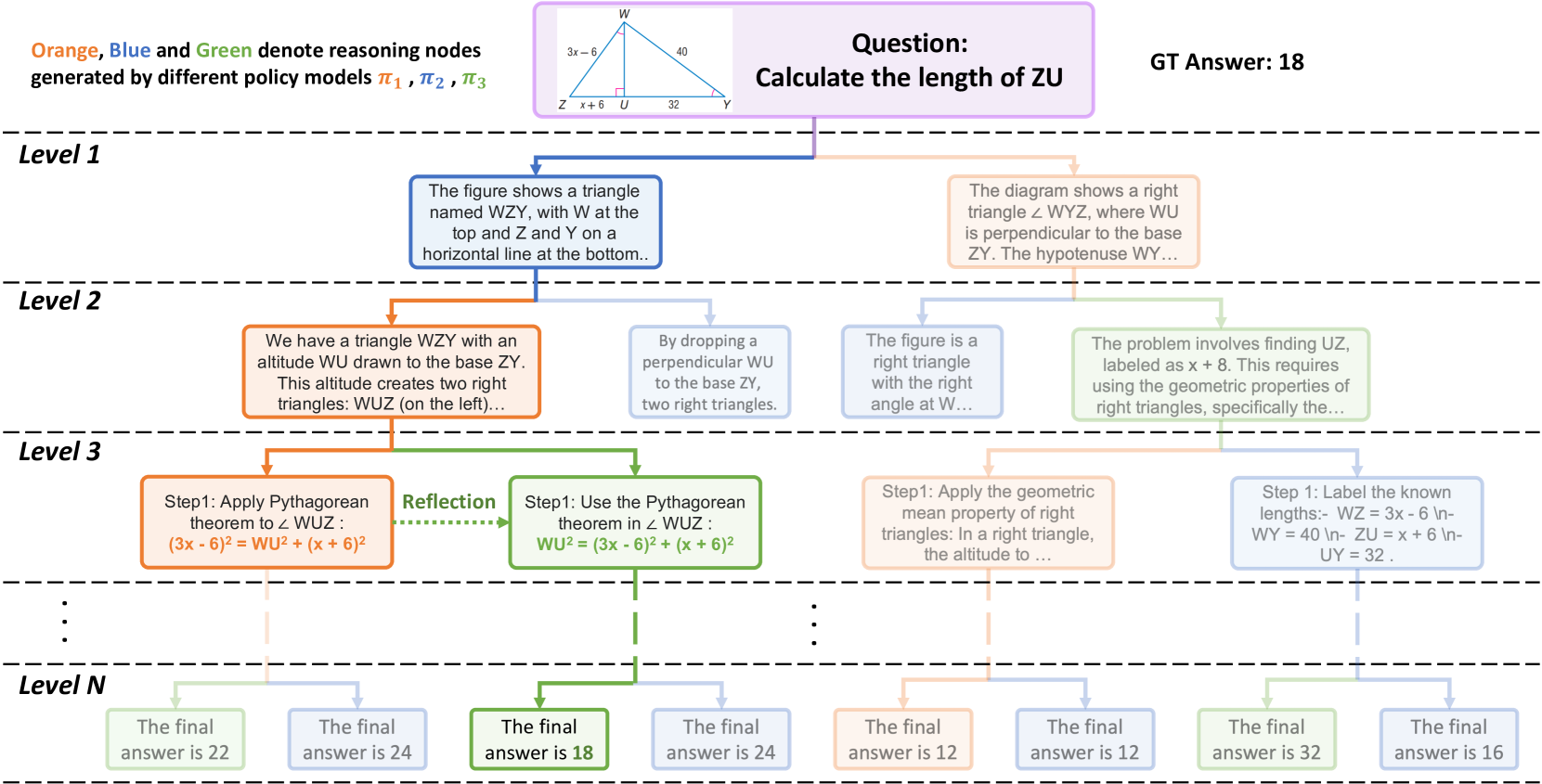

本文旨在开发一种MLLM,使其能够通过学习创建推理的每个中间步骤直到最终答案来理解和解决问题。为此,我们提出了一种新的MLLM学习推理方法——集体蒙特卡洛树搜索(CoMCTS)。CoMCTS将集体学习的概念引入“树搜索”,以有效且高效地搜索和学习推理路径。CoMCTS的核心思想是利用来自多个模型的集体知识,通过包括扩展、模拟和错误定位、反向传播和选择四个迭代操作,协作地推测、搜索和识别通向正确答案的有效推理路径。使用CoMCTS,我们构建了Mulberry-260k,这是一个多模态数据集,其中每个问题都包含一个具有丰富、明确和良好定义的推理节点的树。借助Mulberry-260k,我们执行集体SFT来训练我们的模型Mulberry,这是一系列具有类o1逐步推理和反思能力的MLLM。大量实验证明了我们提出的方法在各种基准测试中的优越性。

🔬 方法详解

问题定义:现有的大型多模态语言模型(MLLM)在处理需要复杂推理的问题时,往往难以给出清晰的推理过程,缺乏对中间步骤的理解和建模。这导致模型难以定位错误,也难以进行有效的反思和改进。因此,如何让MLLM像人类一样,逐步推理并反思每一步的正确性,是本文要解决的核心问题。

核心思路:本文的核心思路是引入集体学习的概念到蒙特卡洛树搜索(MCTS)中,提出集体蒙特卡洛树搜索(CoMCTS)。CoMCTS利用多个模型的集体知识,通过协作的方式探索、搜索和学习有效的推理路径。这种集体学习的方式可以更有效地利用不同模型的优势,从而找到更优的推理策略。

技术框架:CoMCTS的整体框架包含四个主要步骤:扩展(Expansion)、模拟和错误定位(Simulation and Error Positioning)、反向传播(Backpropagation)和选择(Selection)。在扩展阶段,模型基于当前状态生成可能的下一步推理步骤。在模拟和错误定位阶段,模型对生成的推理路径进行评估,并尝试定位错误。在反向传播阶段,模型根据评估结果更新树中节点的价值。在选择阶段,模型根据节点的价值选择下一步要探索的节点。通过不断迭代这四个步骤,CoMCTS可以逐步构建一棵包含丰富推理路径的树,并从中学习到有效的推理策略。

关键创新:CoMCTS的关键创新在于将集体学习引入到MCTS中。传统的MCTS通常只依赖于单个模型进行搜索和学习,而CoMCTS则利用多个模型的集体知识,从而可以更有效地探索搜索空间,并找到更优的推理路径。此外,CoMCTS还引入了错误定位机制,可以帮助模型更好地理解推理过程中的错误,并进行针对性的改进。

关键设计:CoMCTS的关键设计包括:1) 使用多个预训练的MLLM作为基础模型,每个模型负责生成不同的推理路径;2) 设计了一种新的奖励函数,用于评估推理路径的质量,该奖励函数考虑了推理的正确性、效率和可解释性;3) 采用了一种基于置信上限树(UCT)的搜索策略,用于平衡探索和利用;4) 构建了一个包含260k个多模态推理问题的Mulberry-260k数据集,用于训练和评估模型。

🖼️ 关键图片

📊 实验亮点

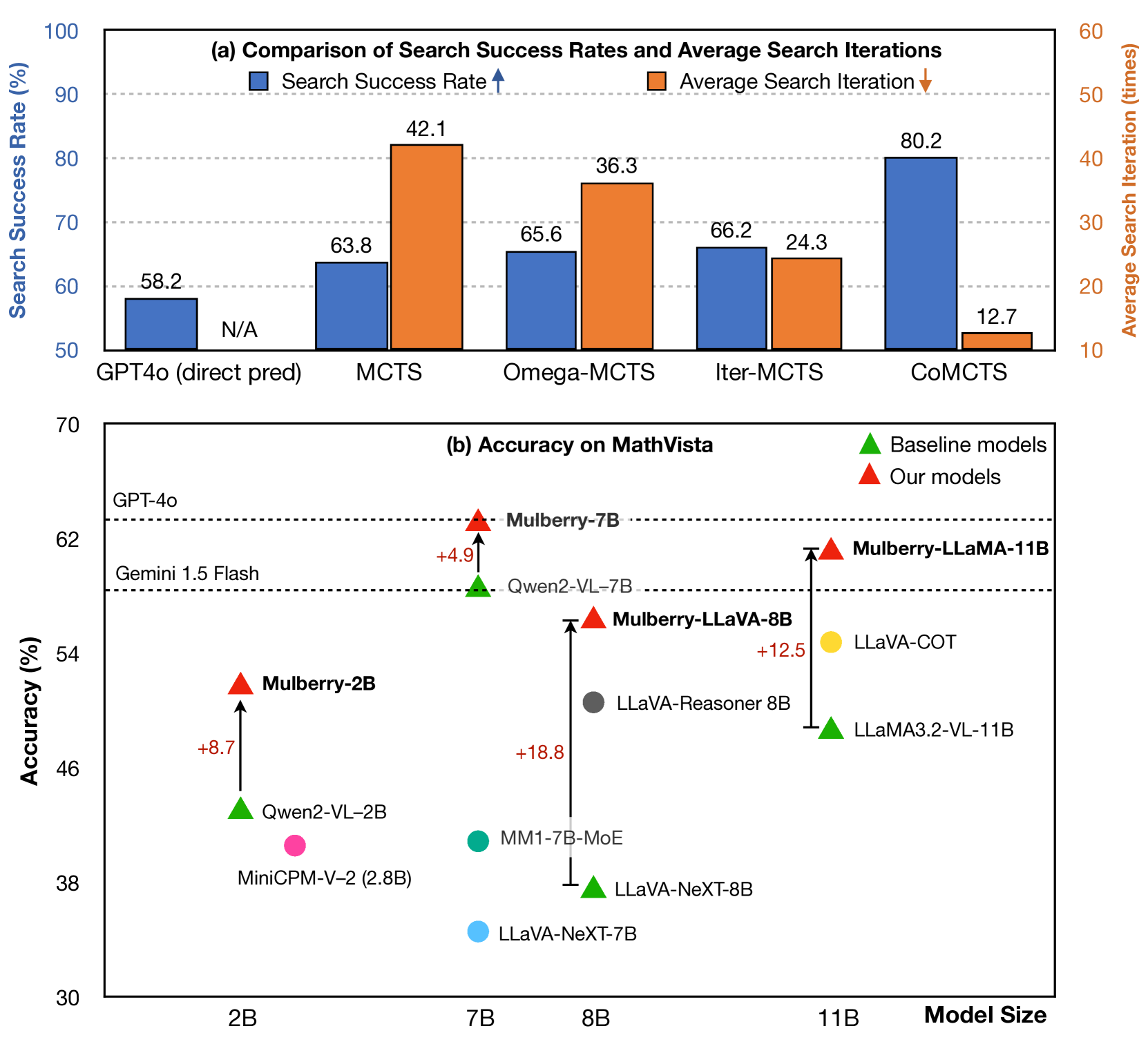

实验结果表明,使用CoMCTS训练的Mulberry模型在多个基准测试中取得了显著的性能提升。例如,在视觉问答(VQA)任务中,Mulberry模型相比于基线模型取得了超过10%的准确率提升。此外,Mulberry模型在需要多步推理的任务中也表现出色,证明了CoMCTS的有效性。

🎯 应用场景

该研究成果可应用于需要复杂推理和决策的各种领域,例如智能问答、机器人导航、游戏AI和医疗诊断。通过赋予MLLM更强的推理和反思能力,可以提高其在这些领域的应用效果,并为解决复杂问题提供新的思路。

📄 摘要(原文)

In this work, we aim to develop an MLLM that understands and solves questions by learning to create each intermediate step of the reasoning involved till the final answer. To this end, we propose Collective Monte Carlo Tree Search (CoMCTS), a new learning-to-reason method for MLLMs, which introduces the concept of collective learning into ``tree search'' for effective and efficient reasoning-path searching and learning. The core idea of CoMCTS is to leverage collective knowledge from multiple models to collaboratively conjecture, search and identify effective reasoning paths toward correct answers via four iterative operations including Expansion, Simulation and Error Positioning, Backpropagation, and Selection. Using CoMCTS, we construct Mulberry-260k, a multimodal dataset with a tree of rich, explicit and well-defined reasoning nodes for each question. With Mulberry-260k, we perform collective SFT to train our model, Mulberry, a series of MLLMs with o1-like step-by-step Reasoning and Reflection capabilities. Extensive experiments demonstrate the superiority of our proposed methods on various benchmarks. Code will be available at https://github.com/HJYao00/Mulberry