Parallel Neural Computing for Scene Understanding from LiDAR Perception in Autonomous Racing

作者: Suwesh Prasad Sah

分类: cs.CV

发布日期: 2024-12-24

备注: IEEE/ISED 2024

期刊: 12th International Conference on Intelligent Systems and Embedded Design (ISED-2024)

DOI: 10.1109/ISED63599.2024.10956572

🔗 代码/项目: GITHUB | HUGGINGFACE

💡 一句话要点

提出并行感知网络PPN,加速激光雷达场景理解,提升自动驾驶赛车性能

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 自动驾驶赛车 激光雷达 场景理解 并行计算 神经网络 实时感知 鸟瞰图 硬件加速

📋 核心要点

- 高速赛车场景下,自动驾驶面临环境快速变化带来的场景理解挑战,传统串行网络难以满足实时决策需求。

- 论文提出并行感知网络(PPN),利用硬件加速实现分割和重建网络的并行计算,提升处理速度。

- 实验结果表明,PPN在模型推理速度上实现了2倍的加速,验证了并行计算的有效性。

📝 摘要(中文)

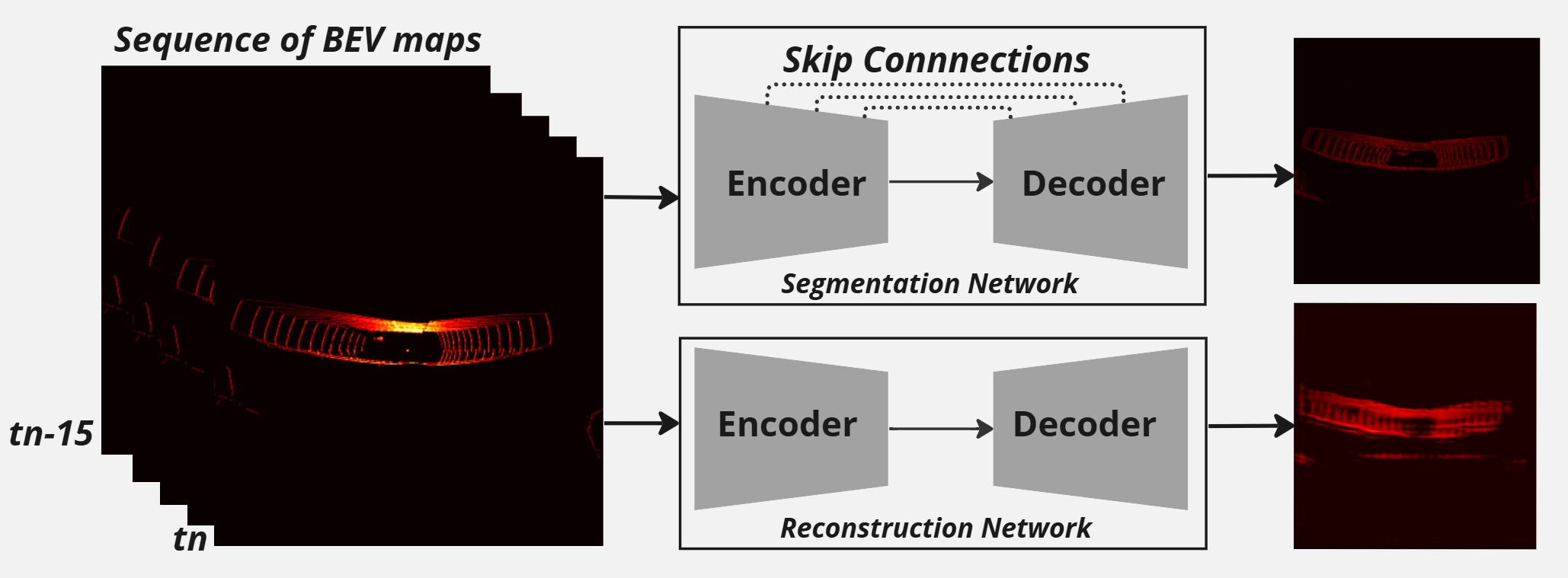

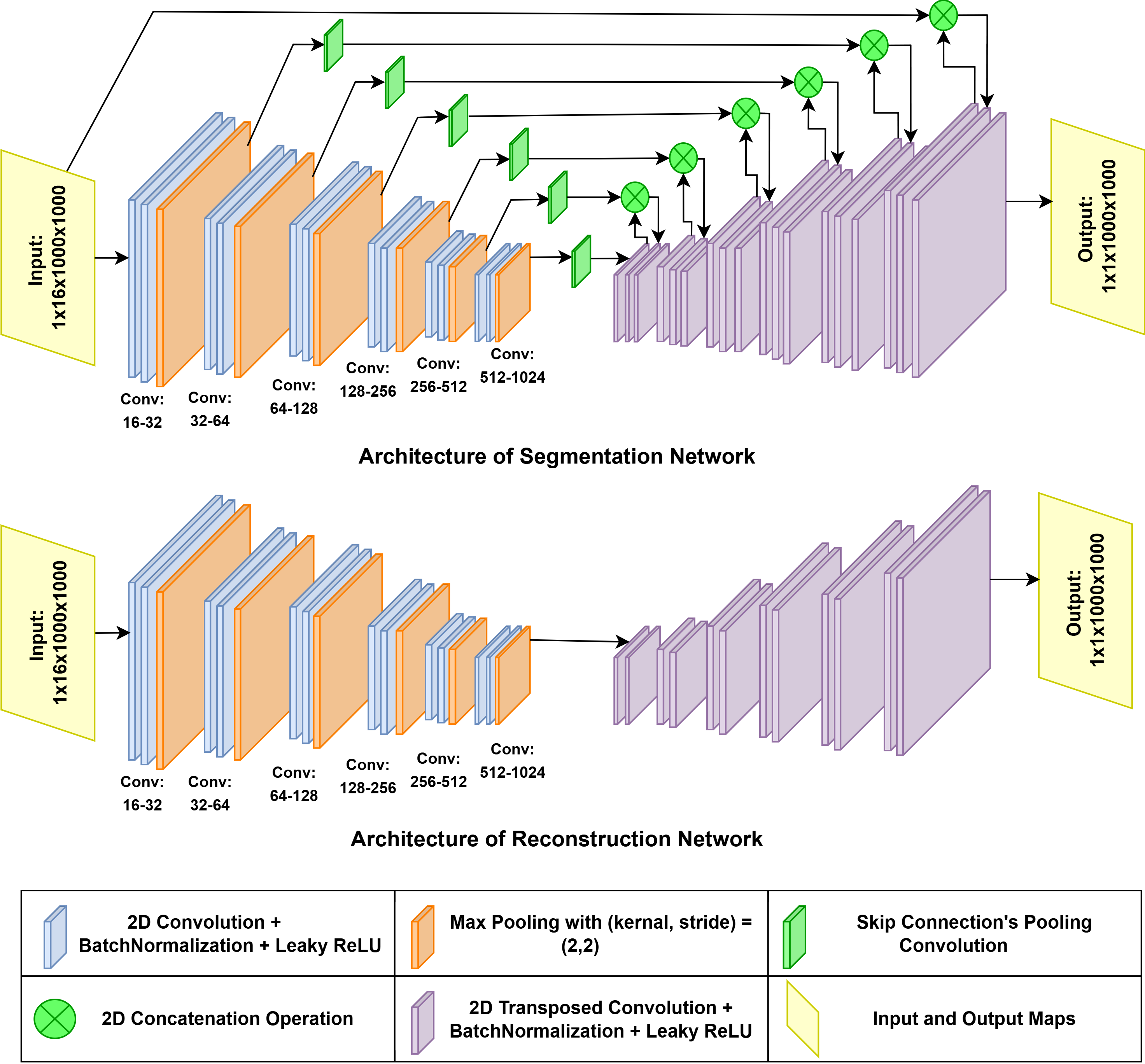

本文针对高速赛车场景下自动驾驶面临的快速环境变化带来的场景理解挑战,提出了一种新颖的基线架构,旨在开发能够实现硬件加速并行化的复杂模型,从而达到与智能体高速运动相匹配的神经处理速度。该模型(并行感知网络PPN)由两个独立的神经网络——分割网络和重建网络组成,它们在独立的加速硬件上并行运行。模型以激光雷达传感器采集的原始3D点云数据作为输入,并将其转换为2D鸟瞰图。每个网络独立地提取其输入在空间和时间维度上的特征,并并行地产生输出。该方法使用包含边缘保持的组合损失函数,在配备两个NVIDIA T4 GPU的系统上进行训练,实验表明,与顺序配置相比,模型推理时间加速了2倍。代码实现和训练好的网络参数已公开。

🔬 方法详解

问题定义:论文旨在解决高速自动驾驶赛车中,由于环境变化迅速,传统串行神经网络难以满足实时场景理解和决策的需求。现有方法的痛点在于计算速度慢,无法跟上车辆的高速运动,导致决策滞后,影响安全性与性能。

核心思路:论文的核心思路是利用硬件加速的并行计算能力,将场景理解任务分解为两个独立的子任务(分割和重建),分别由两个神经网络并行处理。通过并行化,显著提升整体的处理速度,从而满足高速场景下的实时性要求。

技术框架:PPN的整体架构包含以下几个主要模块:1) 激光雷达数据输入:接收原始3D点云数据;2) 鸟瞰图转换:将3D点云转换为2D鸟瞰图;3) 分割网络:提取鸟瞰图中的分割特征;4) 重建网络:提取鸟瞰图中的重建特征;5) 并行计算:分割网络和重建网络在独立的GPU上并行运行;6) 结果融合(未明确提及,但推测存在)。

关键创新:最重要的技术创新点在于将场景理解任务分解为可并行处理的子任务,并利用独立的硬件资源进行加速。与传统的串行网络相比,PPN能够充分利用硬件的并行计算能力,显著提升处理速度。此外,针对赛车场景的特点,可能在网络结构和损失函数设计上进行了优化。

关键设计:论文使用了两个独立的神经网络:分割网络和重建网络。具体网络结构未详细描述,但提到使用了包含边缘保持的组合损失函数进行训练。训练在配备两个NVIDIA T4 GPU的系统上进行,每个网络运行在一个GPU上。论文中公开了代码和训练好的模型参数,方便复现和进一步研究。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的并行感知网络(PPN)在模型推理时间上实现了2倍的加速,与传统的串行配置相比,显著提升了处理速度。这一结果验证了并行计算在加速场景理解任务中的有效性,为高速自动驾驶赛车的实时感知提供了新的解决方案。代码和训练好的模型参数已公开,方便研究人员复现和进一步研究。

🎯 应用场景

该研究成果可应用于高速自动驾驶赛车领域,提升车辆的感知速度和决策能力,从而提高比赛成绩和安全性。此外,该并行计算思路也可推广到其他需要实时场景理解的领域,如机器人导航、无人机飞行等。未来,可以进一步研究更高效的并行架构和更轻量级的网络结构,以适应资源受限的嵌入式平台。

📄 摘要(原文)

Autonomous driving in high-speed racing, as opposed to urban environments, presents significant challenges in scene understanding due to rapid changes in the track environment. Traditional sequential network approaches may struggle to meet the real-time knowledge and decision-making demands of an autonomous agent covering large displacements in a short time. This paper proposes a novel baseline architecture for developing sophisticated models capable of true hardware-enabled parallelism, achieving neural processing speeds that mirror the agent's high velocity. The proposed model (Parallel Perception Network (PPN)) consists of two independent neural networks, segmentation and reconstruction networks, running parallelly on separate accelerated hardware. The model takes raw 3D point cloud data from the LiDAR sensor as input and converts it into a 2D Bird's Eye View Map on both devices. Each network independently extracts its input features along space and time dimensions and produces outputs parallelly. The proposed method's model is trained on a system with two NVIDIA T4 GPUs, using a combination of loss functions, including edge preservation, and demonstrates a 2x speedup in model inference time compared to a sequential configuration. Implementation is available at: https://github.com/suwesh/Parallel-Perception-Network. Learned parameters of the trained networks are provided at: https://huggingface.co/suwesh/ParallelPerceptionNetwork.