Reconstructing People, Places, and Cameras

作者: Lea Müller, Hongsuk Choi, Anthony Zhang, Brent Yi, Jitendra Malik, Angjoo Kanazawa

分类: cs.CV

发布日期: 2024-12-23 (更新: 2025-05-20)

备注: Project website: muelea.github.io/hsfm

🔗 代码/项目: GITHUB

💡 一句话要点

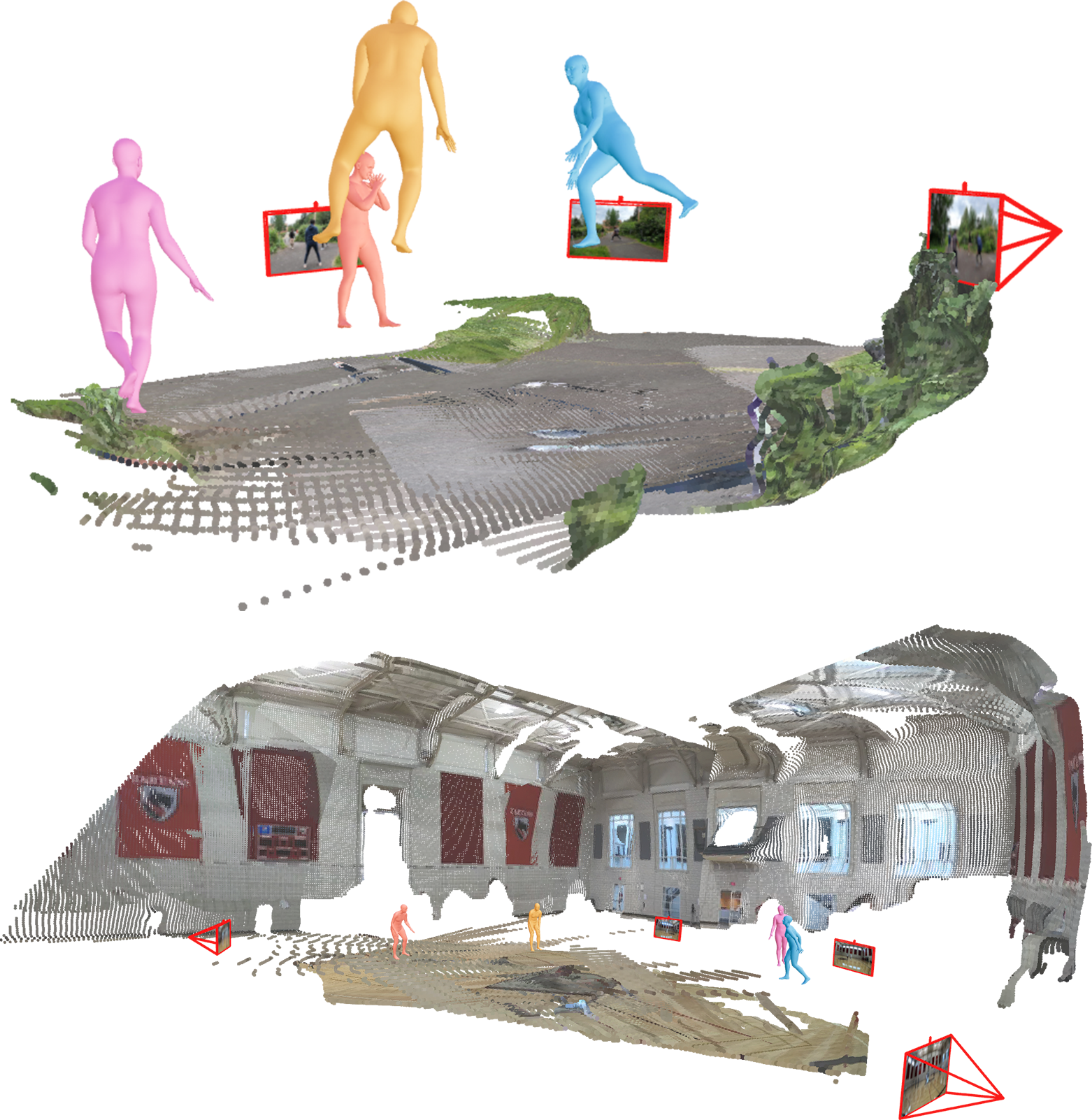

提出HSfM,联合重建多视角图像中的人体网格、场景点云和相机参数。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting)

关键词: 运动结构恢复 人体姿态估计 场景重建 多视角几何 联合优化

📋 核心要点

- 现有SfM方法缺乏度量尺度信息,难以准确重建场景和估计相机参数,尤其是在包含人物的场景中。

- HSfM结合数据驱动的场景重建和传统SfM,利用人体统计模型估计度量尺度,并联合优化人体、场景和相机。

- 实验表明,HSfM在EgoHumans和EgoExo4D数据集上显著提高了人体定位精度和相机姿态估计准确性。

📝 摘要(中文)

本文提出了一种名为“基于运动的人体与结构”(HSfM)的方法,用于从稀疏的、未校准的多视角人体图像中,在统一的度量世界坐标系下,联合重建多个人体网格、场景点云和相机参数。该方法结合了数据驱动的场景重建与传统的运动结构恢复(SfM)框架,以实现更精确的场景重建和相机估计,同时恢复人体网格。与缺乏度量尺度信息的现有场景重建和SfM方法不同,我们的方法利用人体统计模型来估计近似的度量尺度。此外,它在同一世界坐标系中重建多个人体网格以及场景点云,有效地捕捉个体之间的空间关系及其在环境中的位置。我们使用鲁棒的基础模型初始化人体、场景和相机的重建,并联合优化这些元素。这种联合优化协同地提高了每个组件的准确性。我们在两个具有挑战性的基准EgoHumans和EgoExo4D上将我们的方法与现有方法进行了比较,证明了在世界坐标系中人体定位精度的显著提高(在EgoHumans中误差从3.51米降低到1.04米,在EgoExo4D中误差从2.9米降低到0.56米)。值得注意的是,我们的结果表明,将人体数据纳入SfM流程可以提高相机姿态估计的准确性(例如,在EgoHumans上,RRA@15提高了20.3%)。此外,定性结果表明,我们的方法提高了整体场景重建质量。我们的代码可在https://github.com/hongsukchoi/HSfM_RELEASE 获取。

🔬 方法详解

问题定义:论文旨在解决从多视角图像中联合重建场景结构、相机参数和人体网格的问题。现有SfM方法在处理包含人物的场景时,通常缺乏度量尺度信息,导致重建结果不准确,并且难以捕捉人物与场景之间的空间关系。此外,单独重建人体和场景容易产生误差累积,影响整体重建质量。

核心思路:论文的核心思路是将数据驱动的场景重建与传统的SfM框架相结合,并引入人体统计模型作为度量尺度的先验信息。通过联合优化人体网格、场景点云和相机参数,实现各个组件之间的相互促进,从而提高整体重建的准确性和一致性。利用人体先验知识,可以有效约束场景重建的尺度,反过来,场景信息也可以帮助提高人体姿态估计的准确性。

技术框架:HSfM的整体框架包含以下几个主要阶段:1) 使用预训练模型初始化人体姿态、场景结构和相机参数;2) 利用人体统计模型估计场景的度量尺度;3) 联合优化人体网格、场景点云和相机参数,以最小化重建误差和人体姿态误差。优化过程迭代进行,直到收敛。

关键创新:论文的关键创新在于:1) 提出了一种联合重建人体、场景和相机的新框架,实现了各个组件之间的协同优化;2) 利用人体统计模型作为度量尺度的先验信息,克服了传统SfM方法缺乏尺度信息的局限性;3) 将数据驱动的场景重建与传统的SfM框架相结合,提高了重建的鲁棒性和准确性。与现有方法相比,HSfM能够更准确地重建包含人物的复杂场景,并捕捉人物与场景之间的空间关系。

关键设计:在初始化阶段,论文使用了预训练的人体姿态估计模型和场景重建模型,以提供良好的初始值。在联合优化阶段,论文设计了包含重建误差、人体姿态误差和正则化项的损失函数。重建误差衡量重建的场景点云与图像观测之间的差异,人体姿态误差衡量估计的人体姿态与人体统计模型之间的差异。正则化项用于约束人体姿态的合理性。优化的目标是最小化整体损失函数,从而得到一致的人体、场景和相机参数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,HSfM在EgoHumans和EgoExo4D数据集上显著提高了人体定位精度。在EgoHumans数据集上,人体定位误差从3.51米降低到1.04米,在EgoExo4D数据集上,人体定位误差从2.9米降低到0.56米。此外,HSfM还提高了相机姿态估计的准确性,例如在EgoHumans数据集上,RRA@15指标提高了20.3%。定性结果也表明,HSfM能够重建出更准确、更完整的场景结构。

🎯 应用场景

该研究成果可应用于虚拟现实、增强现实、机器人导航、人机交互等领域。例如,在VR/AR应用中,可以利用该方法重建真实场景和人物,从而提供更逼真的沉浸式体验。在机器人导航中,可以利用该方法感知周围环境和行人,从而实现更安全、更智能的导航。在人机交互中,可以利用该方法捕捉人体姿态和动作,从而实现更自然、更流畅的交互。

📄 摘要(原文)

We present "Humans and Structure from Motion" (HSfM), a method for jointly reconstructing multiple human meshes, scene point clouds, and camera parameters in a metric world coordinate system from a sparse set of uncalibrated multi-view images featuring people. Our approach combines data-driven scene reconstruction with the traditional Structure-from-Motion (SfM) framework to achieve more accurate scene reconstruction and camera estimation, while simultaneously recovering human meshes. In contrast to existing scene reconstruction and SfM methods that lack metric scale information, our method estimates approximate metric scale by leveraging a human statistical model. Furthermore, it reconstructs multiple human meshes within the same world coordinate system alongside the scene point cloud, effectively capturing spatial relationships among individuals and their positions in the environment. We initialize the reconstruction of humans, scenes, and cameras using robust foundational models and jointly optimize these elements. This joint optimization synergistically improves the accuracy of each component. We compare our method to existing approaches on two challenging benchmarks, EgoHumans and EgoExo4D, demonstrating significant improvements in human localization accuracy within the world coordinate frame (reducing error from 3.51m to 1.04m in EgoHumans and from 2.9m to 0.56m in EgoExo4D). Notably, our results show that incorporating human data into the SfM pipeline improves camera pose estimation (e.g., increasing RRA@15 by 20.3% on EgoHumans). Additionally, qualitative results show that our approach improves overall scene reconstruction quality. Our code is available at: https://github.com/hongsukchoi/HSfM_RELEASE