GaussianPainter: Painting Point Cloud into 3D Gaussians with Normal Guidance

作者: Jingqiu Zhou, Lue Fan, Xuesong Chen, Linjiang Huang, Si Liu, Hongsheng Li

分类: cs.CV

发布日期: 2024-12-23

备注: To appear in AAAI 2025

💡 一句话要点

GaussianPainter:提出一种基于法线引导的单次前向方法,将点云绘制为3D高斯模型。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 点云绘制 表面法线 前馈网络 外观注入 三维重建 神经渲染

📋 核心要点

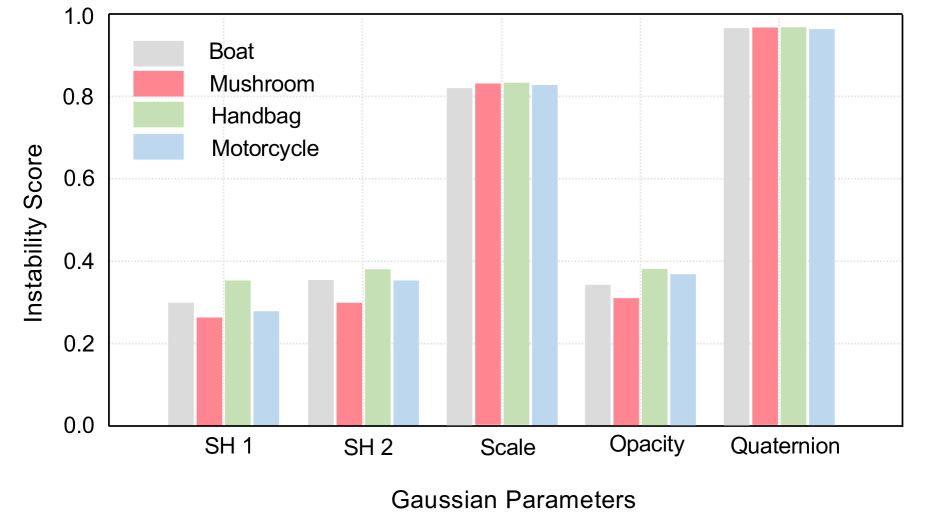

- 3D高斯溅射参数空间大,存在非唯一性问题,导致前馈网络难以直接预测高质量高斯场。

- GaussianPainter通过估计点云的表面法线来确定高斯旋转,从而约束参数空间,稳定网络训练。

- 该方法结合外观注入模块,利用多尺度三平面表示将参考图像外观融入高斯场,提升生成质量。

📝 摘要(中文)

本文提出GaussianPainter,这是第一个在给定参考图像的情况下将点云绘制成3D高斯模型的方法。GaussianPainter引入了一种创新的前馈方法,克服了3D高斯溅射中耗时的测试时优化的局限性。我们的方法解决了该领域的一个关键挑战:3D高斯溅射的大参数空间中固有的非唯一性问题。这个空间包括旋转、各向异性尺度和球谐系数,带来了从截然不同的高斯场渲染相似图像的挑战。因此,前馈网络在尝试直接预测高质量高斯场时面临不稳定性,难以收敛到给定输出的一致参数。为了解决这个问题,我们建议为每个点估计一个表面法线来确定其高斯旋转。这种策略使网络能够有效地预测约束空间中剩余的高斯参数。我们进一步通过多尺度三平面表示,利用外观注入模块将参考图像外观融入高斯场。我们的方法成功地平衡了3D高斯生成的效率和保真度,从而在一次前向传递中从点云实现高质量、多样化和鲁棒的3D内容创建。

🔬 方法详解

问题定义:现有3D高斯溅射方法通常依赖于耗时的测试时优化,难以实现高效的3D内容生成。直接使用前馈网络预测3D高斯参数面临非唯一性问题,即不同的高斯场可能渲染出相似的图像,导致网络训练不稳定,难以收敛到一致的参数。

核心思路:GaussianPainter的核心思路是利用点云的表面法线信息来引导高斯参数的预测,从而约束参数空间,降低非唯一性。通过预测每个点的法线方向,可以确定高斯分布的旋转,从而简化了网络需要学习的参数空间,提高了训练的稳定性。

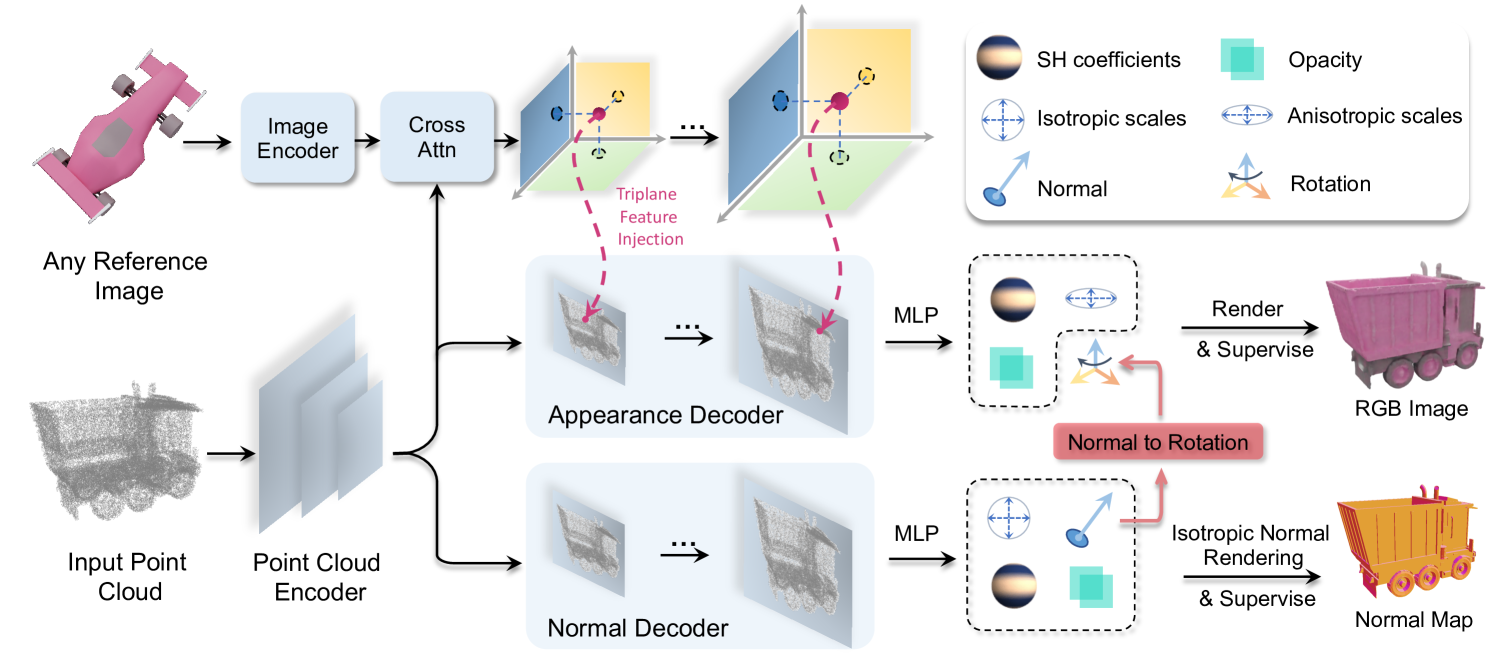

技术框架:GaussianPainter的整体框架包括以下几个主要模块:1) 点云特征提取模块:用于提取点云的几何特征。2) 法线预测模块:用于预测每个点的表面法线。3) 高斯参数预测模块:在法线引导下,预测高斯分布的剩余参数,如尺度和球谐系数。4) 外观注入模块:利用多尺度三平面表示,将参考图像的外观信息融入高斯场。5) 渲染模块:将生成的高斯场渲染成图像。

关键创新:GaussianPainter的关键创新在于利用表面法线来引导高斯参数的预测。与直接预测所有高斯参数相比,这种方法能够有效地约束参数空间,降低非唯一性,提高网络训练的稳定性。此外,外观注入模块也提升了生成图像的质量。

关键设计:法线预测模块使用一个小型神经网络,输入点云特征,输出每个点的法线向量。高斯参数预测模块也使用一个神经网络,输入点云特征和法线向量,输出高斯分布的尺度和球谐系数。外观注入模块使用多尺度三平面表示,将参考图像的特征融入高斯场。损失函数包括渲染损失、法线预测损失和正则化损失。

🖼️ 关键图片

📊 实验亮点

GaussianPainter在多个数据集上进行了实验,结果表明该方法能够生成高质量的3D高斯模型。与现有的3D高斯溅射方法相比,GaussianPainter在生成速度和渲染质量方面都取得了显著的提升。实验结果还表明,法线引导策略能够有效地约束参数空间,提高网络训练的稳定性。此外,外观注入模块也显著提升了生成图像的视觉质量。

🎯 应用场景

GaussianPainter具有广泛的应用前景,包括3D内容创作、虚拟现实、增强现实、游戏开发等领域。它可以用于快速生成高质量的3D模型,例如从单张图像或少量图像重建3D场景。该方法还可以用于生成具有特定外观的3D模型,例如将点云绘制成具有特定纹理和光照效果的3D高斯模型。未来,该技术有望应用于自动驾驶、机器人导航等领域,为环境感知和场景理解提供更准确的3D表示。

📄 摘要(原文)

In this paper, we present GaussianPainter, the first method to paint a point cloud into 3D Gaussians given a reference image. GaussianPainter introduces an innovative feed-forward approach to overcome the limitations of time-consuming test-time optimization in 3D Gaussian splatting. Our method addresses a critical challenge in the field: the non-uniqueness problem inherent in the large parameter space of 3D Gaussian splatting. This space, encompassing rotation, anisotropic scales, and spherical harmonic coefficients, introduces the challenge of rendering similar images from substantially different Gaussian fields. As a result, feed-forward networks face instability when attempting to directly predict high-quality Gaussian fields, struggling to converge on consistent parameters for a given output. To address this issue, we propose to estimate a surface normal for each point to determine its Gaussian rotation. This strategy enables the network to effectively predict the remaining Gaussian parameters in the constrained space. We further enhance our approach with an appearance injection module, incorporating reference image appearance into Gaussian fields via a multiscale triplane representation. Our method successfully balances efficiency and fidelity in 3D Gaussian generation, achieving high-quality, diverse, and robust 3D content creation from point clouds in a single forward pass.