SCBench: A Sports Commentary Benchmark for Video LLMs

作者: Kuangzhi Ge, Lingjun Chen, Kevin Zhang, Yulin Luo, Tianyu Shi, Liaoyuan Fan, Xiang Li, Guanqun Wang, Shanghang Zhang

分类: cs.CV, cs.AI

发布日期: 2024-12-23

💡 一句话要点

提出SCBench:一个用于评估视频大语言模型在体育赛事解说生成任务上的基准。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频大语言模型 体育赛事解说 视频理解 基准测试 时序视觉能力

📋 核心要点

- 现有视频大语言模型评估基准缺乏对细粒度时序视觉能力的有效评估,且任务形式单一。

- 提出SCBench基准,专注于体育视频解说生成任务,利用体育视频的复杂性和挑战性评估模型。

- 构建包含5775个带注释视频片段的CommentarySet数据集,并设计了SCORES六维评估指标。

📝 摘要(中文)

近年来,视频大语言模型(Video LLMs)在学术界和工业界都取得了显著进展。然而,评估不同Video LLMs性能的方法,特别是其细粒度的、时序视觉能力,仍然非常有限。一方面,当前的基准使用相对简单的视频(例如,带有字幕的电影片段),模型只需处理少量帧即可理解整个视频。另一方面,他们的数据集缺乏任务格式的多样性,仅包含QA或多项选择QA,忽略了模型生成深入和精确文本的能力。体育视频具有复杂的视觉信息、连续的事件和充满情感的解说,对Video LLMs提出了严峻的挑战,使得体育解说成为理想的基准测试任务。受这些挑战的启发,我们提出了一项新任务:体育视频解说生成,并开发了用于Video LLMs的$ extbf{SCBench}$。为了构建这样的基准,我们引入了(1)$ extbf{SCORES}$,一个专门为我们的任务设计的六维指标,并在此基础上提出了基于GPT的评估方法,以及(2)$ extbf{CommentarySet}$,一个包含5,775个带注释的视频片段和针对我们的指标量身定制的真实标签的数据集。基于SCBench,我们对多个Video LLMs(例如VILA,Video-LLaVA等)和思维链基线方法进行了全面评估。我们的结果发现,InternVL-Chat-2取得了最佳性能,为5.44,超过第二名1.04。我们的工作为未来的研究提供了新的视角,旨在提高模型在复杂视觉理解任务中的整体能力。我们的数据集即将发布。

🔬 方法详解

问题定义:现有视频大语言模型评估基准存在两个主要痛点。一是视频内容过于简单,模型容易通过少量帧理解视频,无法有效评估其时序理解能力。二是任务形式单一,主要集中在问答或多项选择,忽略了模型生成深入、精确文本的能力。因此,需要一个更具挑战性的基准来评估视频大语言模型在复杂视觉场景下的理解和生成能力。

核心思路:论文的核心思路是利用体育视频的复杂性来评估视频大语言模型。体育视频包含丰富的视觉信息、连续的事件和情感化的解说,对模型的时序理解、视觉推理和文本生成能力提出了更高的要求。通过构建一个体育视频解说生成任务,可以更全面地评估模型的性能。

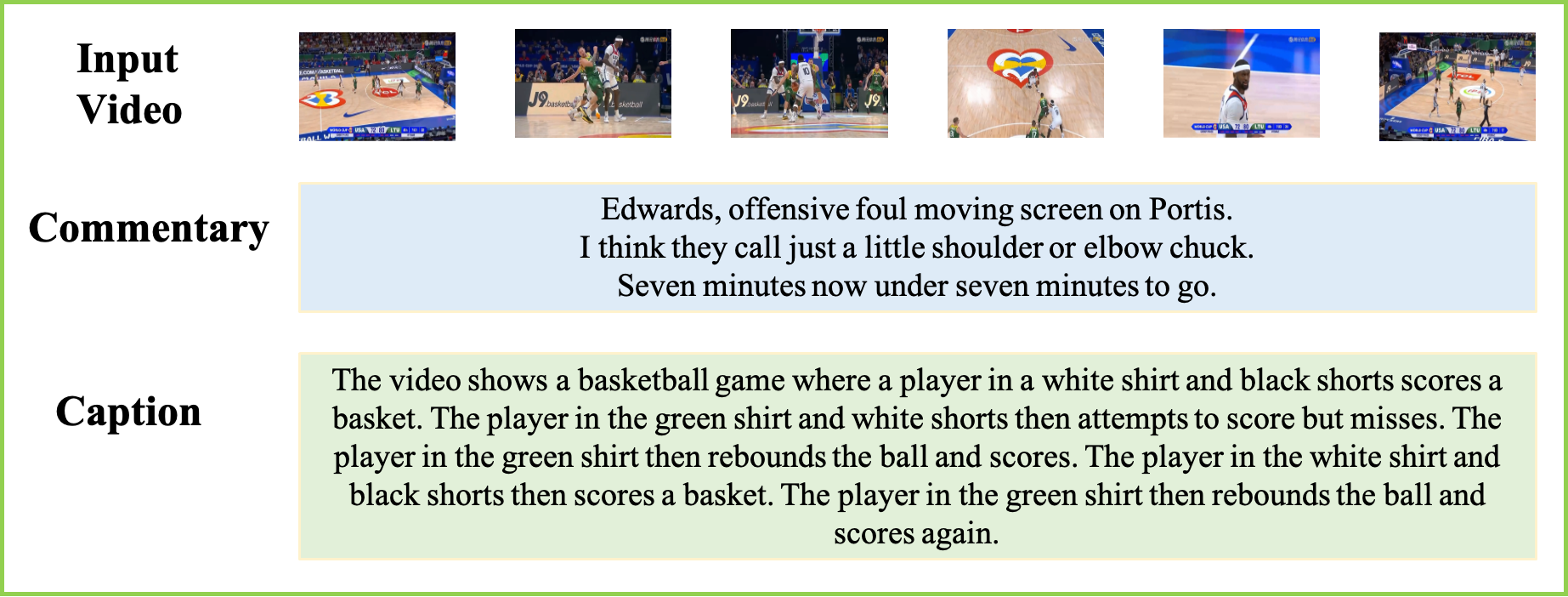

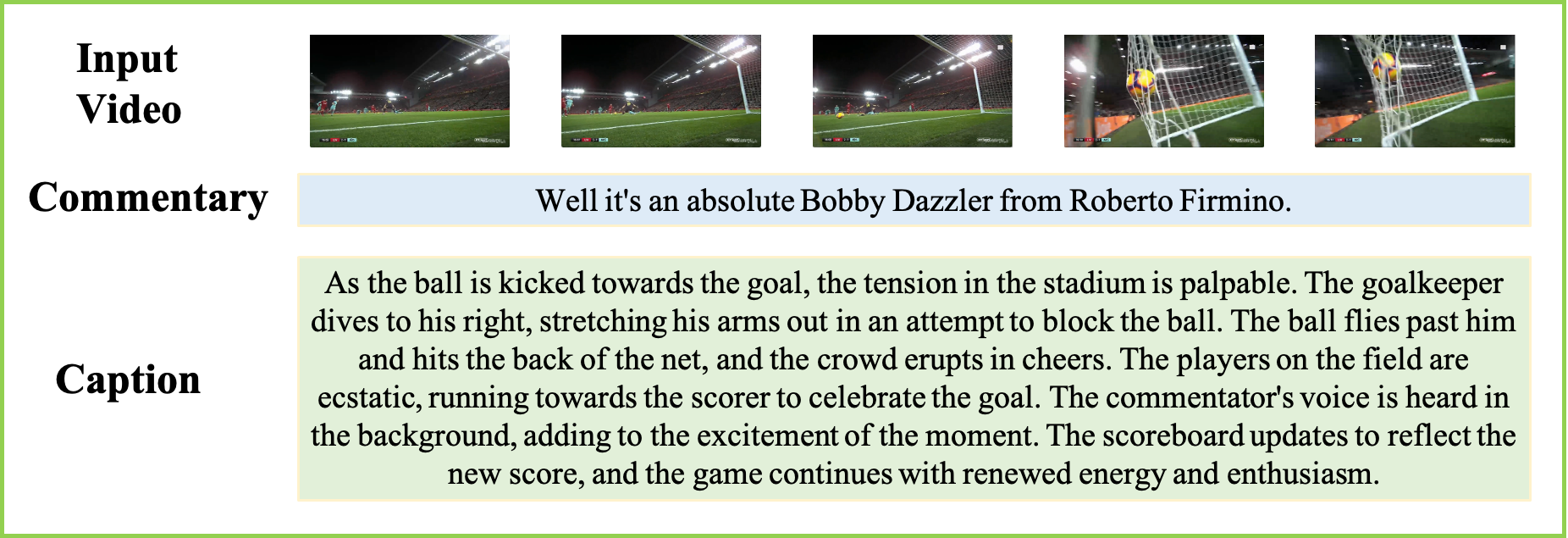

技术框架:SCBench基准主要包含两个组成部分:SCORES评估指标和CommentarySet数据集。SCORES是一个六维指标,用于评估生成解说的质量,包括准确性、流畅性、相关性、信息量、情感表达和时序一致性。CommentarySet是一个包含5,775个带注释的视频片段和真实标签的数据集,用于训练和评估模型。评估过程使用基于GPT的评估方法,该方法利用GPT模型来自动评估生成解说的质量。

关键创新:SCBench的关键创新在于提出了一个更具挑战性的体育视频解说生成任务,并设计了专门的六维评估指标SCORES。与现有的基准相比,SCBench更注重评估模型的细粒度时序视觉能力和文本生成能力。此外,基于GPT的评估方法可以更高效地评估生成解说的质量。

关键设计:SCORES指标包含六个维度:准确性(Accuracy)、流畅性(Fluency)、相关性(Relevance)、信息量(Informativeness)、情感表达(Sentiment)和时序一致性(Temporal Consistency)。每个维度都定义了具体的评估标准,并使用GPT模型进行自动评估。CommentarySet数据集包含多种体育项目,并对每个视频片段进行了详细的标注,包括事件发生的时间、参与者和相关描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,InternVL-Chat-2在SCBench基准上取得了最佳性能,得分为5.44,超过第二名1.04。这表明InternVL-Chat-2在体育视频解说生成任务上具有较强的能力。此外,实验还评估了其他多个Video LLMs和思维链基线方法,为未来的研究提供了参考。

🎯 应用场景

SCBench基准可用于评估和提升视频大语言模型在复杂视觉场景下的理解和生成能力。该研究成果可应用于智能体育解说、视频内容分析、智能监控等领域,帮助模型更好地理解视频内容并生成高质量的文本描述,具有重要的实际应用价值和广阔的未来发展前景。

📄 摘要(原文)

Recently, significant advances have been made in Video Large Language Models (Video LLMs) in both academia and industry. However, methods to evaluate and benchmark the performance of different Video LLMs, especially their fine-grained, temporal visual capabilities, remain very limited. On one hand, current benchmarks use relatively simple videos (e.g., subtitled movie clips) where the model can understand the entire video by processing just a few frames. On the other hand, their datasets lack diversity in task format, comprising only QA or multi-choice QA, which overlooks the models' capacity for generating in-depth and precise texts. Sports videos, which feature intricate visual information, sequential events, and emotionally charged commentary, present a critical challenge for Video LLMs, making sports commentary an ideal benchmarking task. Inspired by these challenges, we propose a novel task: sports video commentary generation, developed $\textbf{SCBench}$ for Video LLMs. To construct such a benchmark, we introduce (1) $\textbf{SCORES}$, a six-dimensional metric specifically designed for our task, upon which we propose a GPT-based evaluation method, and (2) $\textbf{CommentarySet}$, a dataset consisting of 5,775 annotated video clips and ground-truth labels tailored to our metric. Based on SCBench, we conduct comprehensive evaluations on multiple Video LLMs (e.g. VILA, Video-LLaVA, etc.) and chain-of-thought baseline methods. Our results found that InternVL-Chat-2 achieves the best performance with 5.44, surpassing the second-best by 1.04. Our work provides a fresh perspective for future research, aiming to enhance models' overall capabilities in complex visual understanding tasks. Our dataset will be released soon.