LiHi-GS: LiDAR-Supervised Gaussian Splatting for Highway Driving Scene Reconstruction

作者: Pou-Chun Kung, Xianling Zhang, Katherine A. Skinner, Nikita Jaipuria

分类: cs.CV, cs.RO

发布日期: 2024-12-19 (更新: 2025-11-25)

备注: RA-L 2025

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出LiHi-GS,利用激光雷达监督的高斯溅射重建高速公路驾驶场景

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 高斯溅射 激光雷达 场景重建 自动驾驶 高速公路场景

📋 核心要点

- 现有高斯溅射方法主要关注城市环境,忽略了高速公路场景在自动驾驶中的重要性,且对激光雷达数据的利用不足。

- LiHi-GS利用激光雷达监督高斯溅射,专注于高速公路场景重建,旨在提升动态场景合成和编辑的质量。

- 该方法通过激光雷达监督改进场景重建,并支持激光雷达数据的渲染,从而更有效地利用激光雷达的深度信息。

📝 摘要(中文)

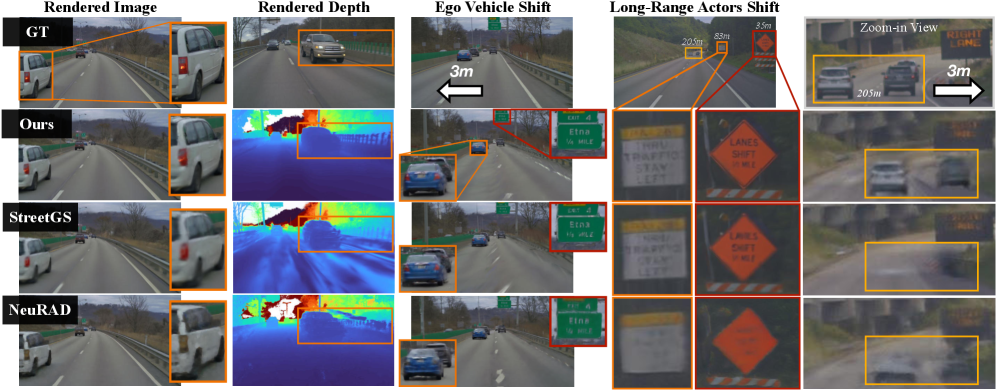

逼真的3D场景重建在自动驾驶中扮演着重要的角色,它能够利用现有数据集生成新的数据,从而模拟安全关键场景,并在无需额外采集成本的情况下扩展训练数据。高斯溅射(GS)通过场景的显式3D高斯表示,实现了实时的、逼真的渲染,与隐式的神经辐射场(NeRFs)相比,提供了更快的处理速度和更直观的场景编辑。虽然广泛的GS研究在自动驾驶应用中取得了可喜的进展,但它们忽略了两个关键方面:首先,现有方法主要集中在低速和特征丰富的城市场景,而忽略了高速公路场景在自动驾驶中的重要作用。其次,虽然激光雷达在自动驾驶平台中很常见,但现有方法主要从图像中学习,仅使用激光雷达进行初始估计或没有精确的传感器建模,因此错失了利用激光雷达提供的丰富深度信息的机会,并限制了合成激光雷达数据的能力。在本文中,我们提出了一种新的GS方法,用于动态场景合成和编辑,通过激光雷达监督改进了场景重建,并支持激光雷达渲染。与主要在城市数据集上测试的先前工作不同,据我们所知,我们是第一个关注更具挑战性和高度相关的高速公路场景,这些场景具有稀疏的传感器视图和单调的背景。

🔬 方法详解

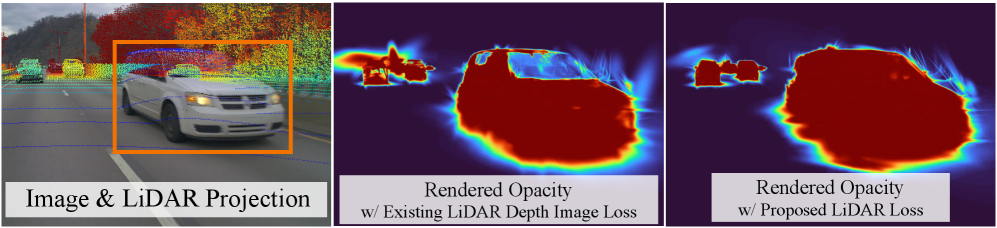

问题定义:现有基于高斯溅射的场景重建方法主要集中在城市环境中,忽略了高速公路场景的特殊性,例如传感器视角稀疏、背景单调等。此外,现有方法对激光雷达数据的利用不足,通常仅用于初始化或缺乏精确的传感器建模,无法充分利用激光雷达提供的深度信息。这限制了重建场景的质量和合成激光雷达数据的能力。

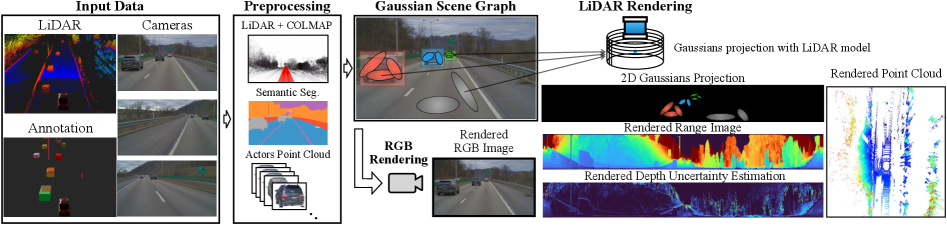

核心思路:LiHi-GS的核心思路是利用激光雷达数据对高斯溅射进行监督,从而提高高速公路场景重建的质量。通过精确的传感器建模和有效的损失函数设计,充分利用激光雷达提供的深度信息,克服高速公路场景的挑战。同时,该方法还支持激光雷达数据的渲染,从而实现更全面的场景理解和数据合成。

技术框架:LiHi-GS的整体框架包含以下几个主要模块:1) 高斯溅射初始化:使用图像和激光雷达数据初始化高斯溅射参数。2) 激光雷达监督:利用激光雷达数据对高斯溅射参数进行优化,包括位置、大小、颜色等。3) 场景渲染:使用优化后的高斯溅射参数进行场景渲染,包括图像渲染和激光雷达数据渲染。4) 动态场景处理:针对动态场景,引入时间一致性约束,保证场景重建的稳定性。

关键创新:LiHi-GS的关键创新在于:1) 首次关注高速公路场景的重建,并针对该场景的特点进行了优化。2) 提出了基于激光雷达监督的高斯溅射方法,充分利用激光雷达的深度信息。3) 支持激光雷达数据的渲染,从而实现更全面的场景理解和数据合成。

关键设计:LiHi-GS的关键设计包括:1) 精确的传感器建模:对激光雷达的内外参数进行精确建模,保证激光雷达数据与图像数据的对齐。2) 损失函数设计:设计了包括深度损失、颜色损失和正则化损失在内的损失函数,用于优化高斯溅射参数。深度损失用于约束高斯溅射的深度与激光雷达数据一致,颜色损失用于约束高斯溅射的颜色与图像数据一致,正则化损失用于防止高斯溅射参数过拟合。3) 时间一致性约束:针对动态场景,引入时间一致性约束,保证相邻帧之间高斯溅射参数的平滑性。

🖼️ 关键图片

📊 实验亮点

论文首次将高斯溅射应用于高速公路场景重建,并提出激光雷达监督方法,显著提升了重建质量。具体性能数据未知,但论文强调其在高速公路场景重建方面的开创性工作,以及对激光雷达数据有效利用的贡献。

🎯 应用场景

LiHi-GS可应用于自动驾驶的仿真测试、数据增强和场景理解等领域。通过重建逼真的高速公路场景,可以生成大量的训练数据,提高自动驾驶系统的鲁棒性和安全性。此外,该方法还可以用于场景编辑和虚拟现实等应用,为用户提供更丰富的交互体验。

📄 摘要(原文)

Photorealistic 3D scene reconstruction plays an important role in autonomous driving, enabling the generation of novel data from existing datasets to simulate safety-critical scenarios and expand training data without additional acquisition costs. Gaussian Splatting (GS) facilitates real-time, photorealistic rendering with an explicit 3D Gaussian representation of the scene, providing faster processing and more intuitive scene editing than the implicit Neural Radiance Fields (NeRFs). While extensive GS research has yielded promising advancements in autonomous driving applications, they overlook two critical aspects: First, existing methods mainly focus on low-speed and feature-rich urban scenes and ignore the fact that highway scenarios play a significant role in autonomous driving. Second, while LiDARs are commonplace in autonomous driving platforms, existing methods learn primarily from images and use LiDAR only for initial estimates or without precise sensor modeling, thus missing out on leveraging the rich depth information LiDAR offers and limiting the ability to synthesize LiDAR data. In this paper, we propose a novel GS method for dynamic scene synthesis and editing with improved scene reconstruction through LiDAR supervision and support for LiDAR rendering. Unlike prior works that are tested mostly on urban datasets, to the best of our knowledge, we are the first to focus on the more challenging and highly relevant highway scenes for autonomous driving, with sparse sensor views and monotone backgrounds. Visit our project page at: https://umautobots.github.io/lihi_gs