Flowing from Words to Pixels: A Noise-Free Framework for Cross-Modality Evolution

作者: Qihao Liu, Xi Yin, Alan Yuille, Andrew Brown, Mannat Singh

分类: cs.CV

发布日期: 2024-12-19 (更新: 2025-03-24)

备注: CVPR 2025 camera-ready version. Project page: https://cross-flow.github.io/

💡 一句话要点

提出CrossFlow,一种无需噪声的跨模态Flow Matching框架,实现模态间的直接映射。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱四:生成式动作 (Generative Motion)

关键词: 跨模态生成 Flow Matching 文本到图像 变分编码器 无噪声学习 Transformer 图像超分辨率

📋 核心要点

- 现有跨模态生成模型依赖于从噪声到目标模态的映射,计算成本高且效果有待提升。

- CrossFlow直接学习模态间的映射,无需噪声输入和条件机制,简化了训练流程。

- 实验表明,CrossFlow在文本到图像生成等任务上表现优异,并具有良好的扩展性和泛化性。

📝 摘要(中文)

扩散模型及其泛化形式Flow Matching在媒体生成领域产生了显著影响。传统方法学习从高斯噪声到目标媒体分布的复杂映射。对于文本到图像等跨模态任务,同样学习从噪声到图像的映射,并在模型中加入条件机制。与扩散模型不同,Flow Matching的一个关键且未被充分探索的特性是其源分布不限于噪声。因此,本文提出一种范式转变,探讨是否可以直接训练Flow Matching模型来学习从一个模态的分布到另一个模态的分布的直接映射,从而消除对噪声分布和条件机制的需求。我们提出了一个通用且简单的跨模态Flow Matching框架CrossFlow。我们展示了将变分编码器应用于输入数据的重要性,并引入了一种实现无分类器指导的方法。令人惊讶的是,对于文本到图像生成,使用vanilla Transformer(不含交叉注意力)的CrossFlow略优于标准Flow Matching,并且它在训练步数和模型大小方面具有更好的扩展性,同时允许有趣的潜在算术,从而在输出空间中产生语义上有意义的编辑。为了证明我们方法的通用性,我们还表明CrossFlow在各种跨模态/模内映射任务(如图像描述、深度估计和图像超分辨率)上与最先进水平相当或优于最先进水平。我们希望本文有助于加速跨模态媒体生成的进展。

🔬 方法详解

问题定义:现有的跨模态生成模型,如基于扩散模型或Flow Matching的模型,通常需要学习从一个简单的噪声分布(例如高斯噪声)到目标模态分布的复杂映射。对于文本到图像的生成,这意味着模型需要学习如何将噪声转化为图像,并且需要一个条件机制来指导生成过程,使其与输入的文本描述相符。这种方法的痛点在于,从噪声到图像的映射可能过于复杂,导致训练困难,计算成本高昂,并且生成结果的质量受到噪声分布的限制。

核心思路:CrossFlow的核心思路是直接学习从一个模态的分布到另一个模态的分布的映射,而无需中间的噪声分布。具体来说,对于文本到图像的生成,CrossFlow直接学习从文本的分布到图像的分布的映射。这种方法避免了从噪声到图像的复杂映射,简化了训练过程,并且有可能提高生成结果的质量。这样设计的理由是,直接学习模态间的映射可以更好地捕捉模态间的内在联系,从而生成更符合语义的图像。

技术框架:CrossFlow的整体架构包括以下几个主要模块:1) 变分编码器(VAE):用于将输入数据(例如文本或图像)编码到潜在空间中。2) Flow Matching模型:用于学习从一个模态的潜在空间到另一个模态的潜在空间的映射。3) 解码器:用于将生成的潜在表示解码回目标模态的数据(例如图像)。整个流程如下:首先,使用VAE将输入文本编码到潜在空间中。然后,使用Flow Matching模型将文本的潜在表示映射到图像的潜在表示。最后,使用解码器将图像的潜在表示解码为生成的图像。

关键创新:CrossFlow最重要的技术创新点在于它直接学习模态间的映射,而无需中间的噪声分布。这与现有的基于扩散模型或Flow Matching的模型形成了本质区别。现有的模型通常需要学习从噪声到目标模态的复杂映射,而CrossFlow则避免了这一过程,从而简化了训练过程,并且有可能提高生成结果的质量。此外,CrossFlow还引入了一种实现无分类器指导的方法,进一步提高了生成结果的质量。

关键设计:CrossFlow的关键设计包括以下几个方面:1) 使用变分编码器(VAE)来编码输入数据,这有助于学习数据的潜在表示,并且可以用于生成新的数据。2) 使用Flow Matching模型来学习模态间的映射,Flow Matching模型是一种基于连续归一化流的模型,可以学习复杂的概率分布之间的映射。3) 引入了一种实现无分类器指导的方法,这可以通过在训练过程中随机丢弃一些条件信息来实现。4) 使用vanilla Transformer作为Flow Matching模型的主干网络,并发现即使不使用交叉注意力,CrossFlow也能取得良好的效果。

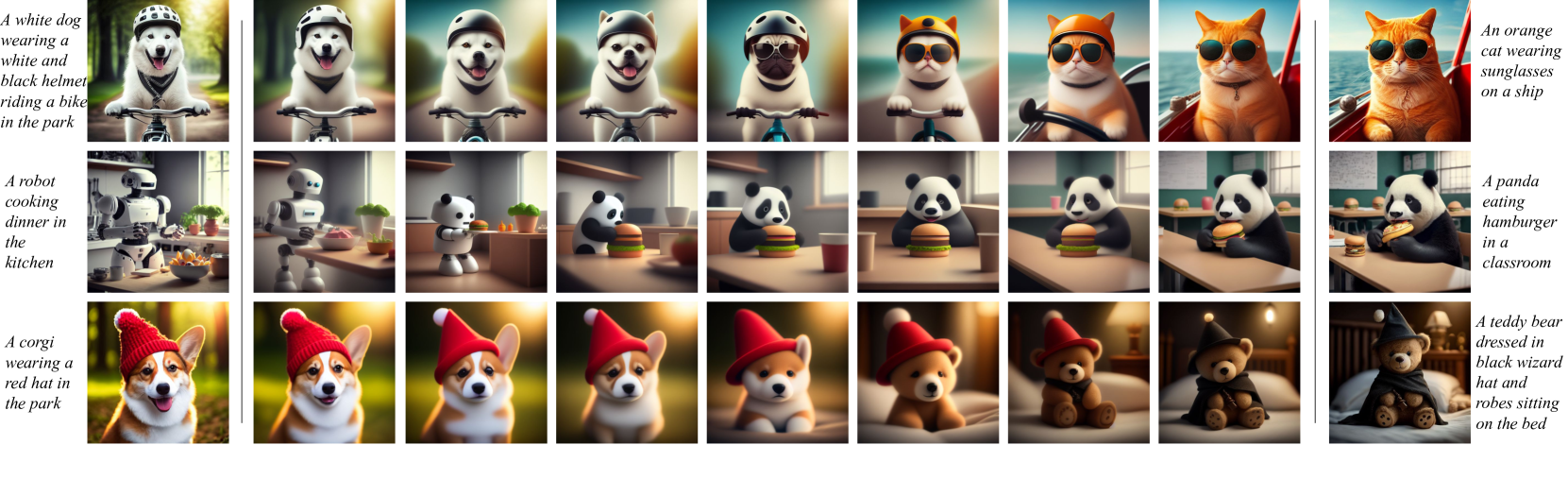

🖼️ 关键图片

📊 实验亮点

CrossFlow在文本到图像生成任务上,使用vanilla Transformer(不含交叉注意力)的情况下,略优于标准Flow Matching。实验还表明,CrossFlow在训练步数和模型大小方面具有更好的扩展性。此外,CrossFlow在图像描述、深度估计和图像超分辨率等任务上与当前最优方法性能相当或更优。

🎯 应用场景

CrossFlow具有广泛的应用前景,包括文本到图像生成、图像描述、深度估计、图像超分辨率等跨模态和模内映射任务。该研究的实际价值在于提供了一种更高效、更简洁的跨模态生成框架,有望加速相关领域的发展。未来,CrossFlow可以应用于更多领域,例如视频生成、3D建模等。

📄 摘要(原文)

Diffusion models, and their generalization, flow matching, have had a remarkable impact on the field of media generation. Here, the conventional approach is to learn the complex mapping from a simple source distribution of Gaussian noise to the target media distribution. For cross-modal tasks such as text-to-image generation, this same mapping from noise to image is learnt whilst including a conditioning mechanism in the model. One key and thus far relatively unexplored feature of flow matching is that, unlike Diffusion models, they are not constrained for the source distribution to be noise. Hence, in this paper, we propose a paradigm shift, and ask the question of whether we can instead train flow matching models to learn a direct mapping from the distribution of one modality to the distribution of another, thus obviating the need for both the noise distribution and conditioning mechanism. We present a general and simple framework, CrossFlow, for cross-modal flow matching. We show the importance of applying Variational Encoders to the input data, and introduce a method to enable Classifier-free guidance. Surprisingly, for text-to-image, CrossFlow with a vanilla transformer without cross attention slightly outperforms standard flow matching, and we show that it scales better with training steps and model size, while also allowing for interesting latent arithmetic which results in semantically meaningful edits in the output space. To demonstrate the generalizability of our approach, we also show that CrossFlow is on par with or outperforms the state-of-the-art for various cross-modal / intra-modal mapping tasks, viz. image captioning, depth estimation, and image super-resolution. We hope this paper contributes to accelerating progress in cross-modal media generation.