Multi-QuAD: Multi-Level Quality-Adaptive Dynamic Network for Reliable Multimodal Classification

作者: Shu Shen, C. L. Philip Chen, Tong Zhang

分类: cs.CV

发布日期: 2024-12-19 (更新: 2025-05-10)

备注: 12 pages, 11 figures

💡 一句话要点

提出Multi-QuAD,解决多模态分类中样本质量差异导致的可靠性问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 可靠分类 质量自适应 动态网络 深度学习 样本质量估计 全局置信度归一化 逐层贪婪参数

📋 核心要点

- 现有方法在多模态分类中难以鲁棒估计数据质量,且缺乏样本特定深度和参数的动态网络。

- Multi-QuAD通过无噪声原型估计样本质量,并利用GCND和LGP实现样本自适应的网络深度和参数。

- 实验表明,Multi-QuAD在分类性能和可靠性上显著优于现有方法,对不同质量数据有更强的适应性。

📝 摘要(中文)

本文提出了一种名为多层质量自适应动态多模态网络(Multi-QuAD)的框架,用于解决多模态可靠分类问题。现有方法无法提供对数据质量的鲁棒估计,并且缺乏样本特定的深度和参数的动态网络来实现可靠的推理。Multi-QuAD首先采用一种基于无噪声原型和无分类器设计的新方法,以可靠地估计每个样本在模态和特征层面的质量。然后,通过全局置信度归一化深度(GCND)机制实现样本特定的网络深度。通过跨模态和样本归一化深度,GCND有效地减轻了具有挑战性的模态输入对动态深度可靠性的影响。此外,Multi-QuAD通过特征级质量驱动的逐层贪婪参数(LGP)机制提供样本自适应网络参数。LGP中的跨模态逐层贪婪策略首次为具有可变架构的多模态网络设计了一种可靠的参数预测范式。在四个数据集上进行的实验表明,Multi-QuAD在分类性能和可靠性方面显著优于最先进的方法,表现出对具有不同质量数据的强大适应性。

🔬 方法详解

问题定义:多模态机器学习在许多场景中取得了显著进展,但其可靠性受到样本质量差异的影响。现有方法无法提供对数据质量的鲁棒估计,并且缺乏动态网络来适应样本特定的深度和参数,从而影响了可靠推理。

核心思路:论文的核心思路是构建一个质量自适应的动态多模态网络,该网络能够根据样本的质量动态调整自身的深度和参数。通过可靠的质量估计和自适应的网络结构,提高多模态分类的可靠性。

技术框架:Multi-QuAD框架包含以下几个主要模块:1) 基于无噪声原型的质量估计模块,用于估计每个样本在模态和特征层面的质量;2) 全局置信度归一化深度(GCND)机制,用于实现样本特定的网络深度;3) 逐层贪婪参数(LGP)机制,用于提供样本自适应的网络参数。

关键创新:论文的关键创新在于提出了GCND和LGP两种机制。GCND通过跨模态和样本归一化深度,减轻了具有挑战性的模态输入对动态深度可靠性的影响。LGP则首次为具有可变架构的多模态网络设计了一种可靠的参数预测范式。

关键设计:GCND的关键在于如何定义和计算全局置信度,并将其用于归一化网络深度。LGP的关键在于如何设计跨模态的逐层贪婪策略,以实现可靠的参数预测。具体的损失函数和网络结构细节在论文中进行了详细描述,但摘要中未明确给出具体参数。

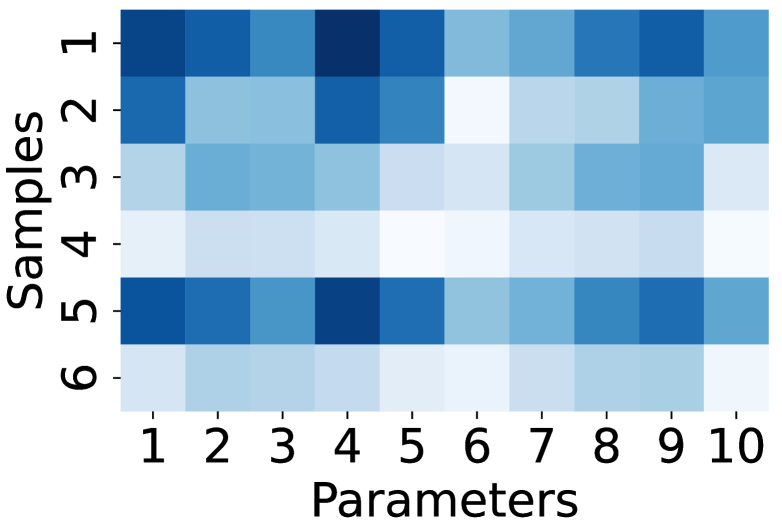

🖼️ 关键图片

📊 实验亮点

实验结果表明,Multi-QuAD在四个数据集上显著优于现有方法。具体性能提升数据未在摘要中给出,但强调了在分类性能和可靠性方面均有提升,并对不同质量的数据表现出更强的适应性。该方法在处理具有挑战性的多模态数据时表现出更强的鲁棒性。

🎯 应用场景

该研究成果可应用于各种需要处理多模态数据并对可靠性有较高要求的场景,例如情感分析、医疗诊断、自动驾驶等。通过提高多模态分类的可靠性,可以减少误判和错误决策,从而提升系统的整体性能和安全性。未来,该方法可以进一步扩展到更多模态和更复杂的任务中。

📄 摘要(原文)

Multimodal machine learning has achieved remarkable progress in many scenarios, but its reliability is undermined by varying sample quality. This paper finds that existing reliable multimodal classification methods not only fail to provide robust estimation of data quality, but also lack dynamic networks for sample-specific depth and parameters to achieve reliable inference. To this end, a novel framework for multimodal reliable classification termed \textit{Multi-level Quality-Adaptive Dynamic multimodal network} (Multi-QuAD) is proposed. Multi-QuAD first adopts a novel approach based on noise-free prototypes and a classifier-free design to reliably estimate the quality of each sample at both modality and feature levels. It then achieves sample-specific network depth via the \textbf{\textit{Global Confidence Normalized Depth (GCND)}} mechanism. By normalizing depth across modalities and samples, \textit{\textbf{GCND}} effectively mitigates the impact of challenging modality inputs on dynamic depth reliability. Furthermore, Multi-QuAD provides sample-adaptive network parameters via the \textbf{\textit{Layer-wise Greedy Parameter (LGP)}} mechanism driven by feature-level quality. The cross-modality layer-wise greedy strategy in \textbf{\textit{LGP}} designs a reliable parameter prediction paradigm for multimodal networks with variable architecture for the first time. Experiments conducted on four datasets demonstrate that Multi-QuAD significantly outperforms state-of-the-art methods in classification performance and reliability, exhibiting strong adaptability to data with diverse quality.