Incorporating Feature Pyramid Tokenization and Open Vocabulary Semantic Segmentation

作者: Jianyu Zhang, Li Zhang, Shijian Li

分类: cs.CV

发布日期: 2024-12-18

备注: 6 pages, 6 figures

💡 一句话要点

提出特征金字塔Tokenization,用于提升开放词汇语义分割性能

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 语义分割 开放词汇 视觉-语言模型 特征金字塔 Tokenization

📋 核心要点

- 现有方法难以将图像级别的语义信息有效传递到像素级别,限制了开放词汇语义分割的性能。

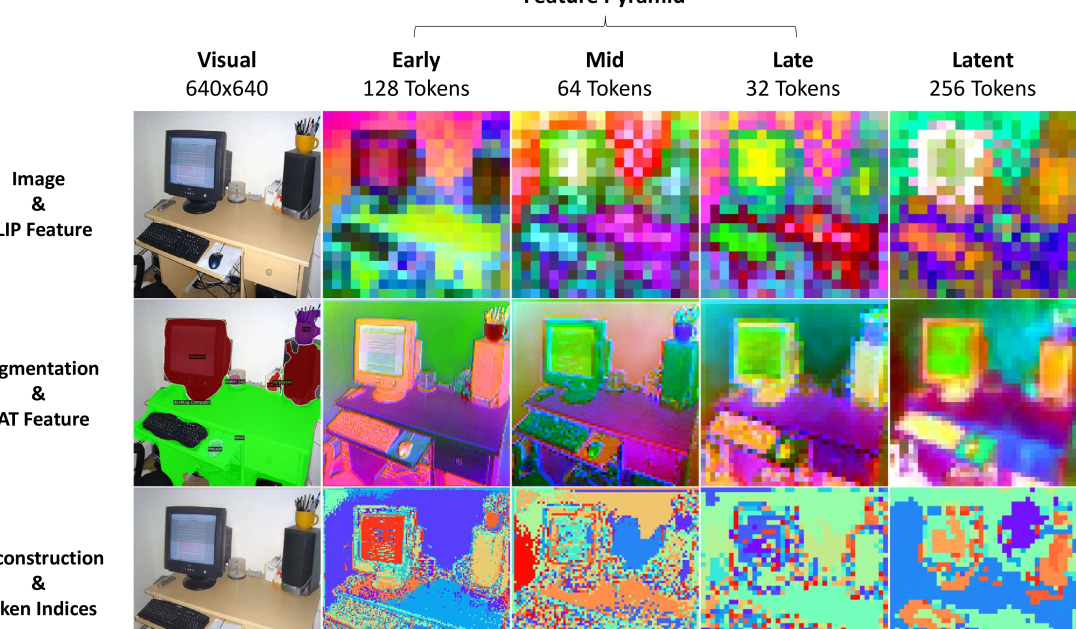

- 论文提出特征金字塔Tokenization (PAT),通过可学习的码本对多分辨率特征进行聚类和表示,实现感知和语义的统一Token压缩。

- 实验结果表明,PAT能够增强VLM特征金字塔的语义直觉,提升基线分割模型的性能,并在开放词汇语义分割任务上取得良好效果。

📝 摘要(中文)

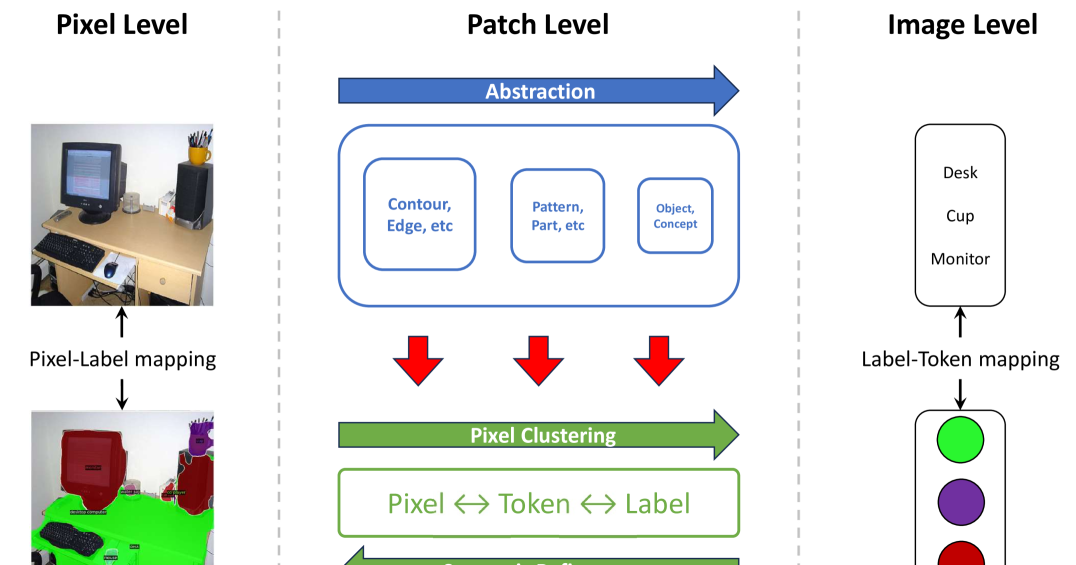

视觉理解通常从图像、图像块和像素三个粒度级别进行。视觉Tokenization通过自监督重构学习,以码本压缩图像块级别的视觉数据,信息损失很小,但视觉Token不具备语义意义。开放词汇语义分割受益于视觉-语言模型(VLM)的强大零样本能力,但将图像级理解迁移到像素级仍然是一个紧迫的挑战。本文将分割视为像素Token化,并研究一种统一的感知和语义Token压缩,以实现所有粒度的理解,从而促进开放词汇语义分割。借鉴预训练VLM的认知过程,其中低级特征逐步组合成高级语义,我们提出特征金字塔Tokenization (PAT),通过可学习的码本聚类和表示多分辨率特征,然后通过联合学习像素重构和语义分割来解码它们。我们设计了松耦合的像素和语义学习分支。像素分支模拟码本Token的自下而上组合和自上而下可视化,而语义分支共同融合分层码本作为辅助分割指导。实验表明,PAT增强了VLM特征金字塔的语义直觉,提高了基线分割模型的性能,并在开放词汇语义分割基准上取得了有竞争力的性能。我们的模型对于VLM集成来说是参数高效的,并且对于独立的Token化是灵活的。我们希望不仅能为改进分割提供灵感,也能为语义视觉Token的利用提供灵感。

🔬 方法详解

问题定义:开放词汇语义分割旨在识别图像中每个像素的语义类别,而无需预先定义所有类别。现有的方法通常依赖于视觉-语言模型(VLM)的图像级理解能力,但如何有效地将图像级别的语义信息传递到像素级别,从而实现精细的分割,仍然是一个挑战。此外,视觉Tokenization虽然能有效压缩视觉数据,但缺乏语义信息。

核心思路:论文的核心思路是将语义分割视为像素级别的Token化过程,并借鉴VLM中低级特征逐步组合成高级语义的认知过程。通过学习一种统一的感知和语义Token压缩方法,将多分辨率特征聚类成具有语义信息的Token,从而实现所有粒度的理解,并促进开放词汇语义分割。

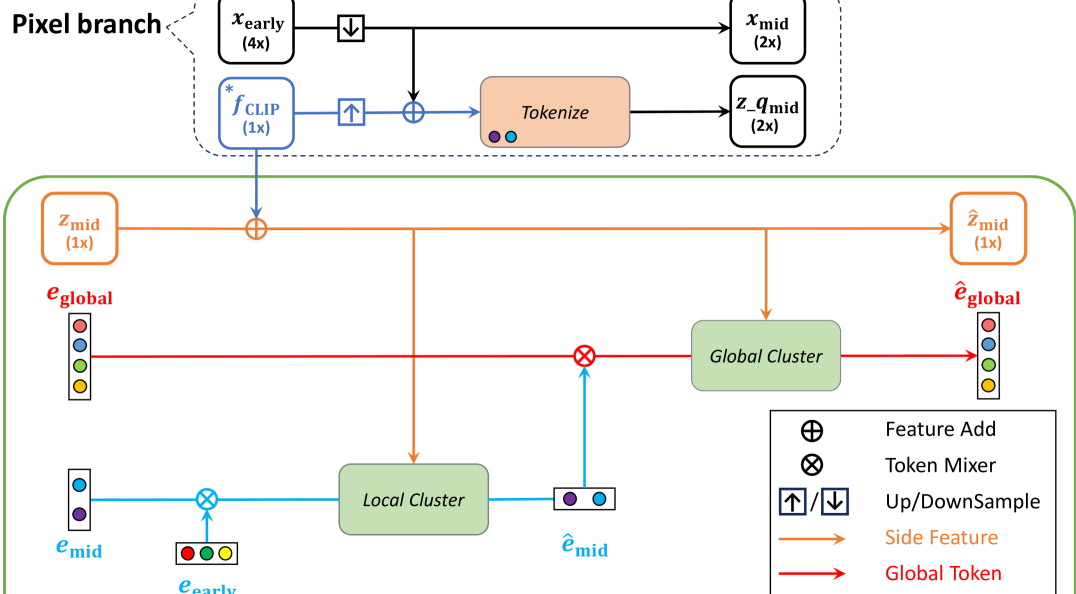

技术框架:论文提出的Feature Pyramid Tokenization (PAT) 包含两个主要分支:像素分支和语义分支。像素分支负责模拟码本Token的自下而上组合和自上而下可视化,实现像素级别的重构。语义分支则负责融合分层码本,作为辅助分割的指导。整体框架通过联合学习像素重构和语义分割,实现感知和语义信息的融合。

关键创新:论文的关键创新在于提出了特征金字塔Tokenization (PAT) 方法,它能够将多分辨率特征聚类成具有语义信息的Token,从而增强VLM特征金字塔的语义直觉。与传统的视觉Tokenization方法相比,PAT 能够学习到具有语义意义的Token,从而更好地支持开放词汇语义分割。

关键设计:PAT 使用可学习的码本对多分辨率特征进行聚类和表示。像素分支通过最小化像素重构损失来学习码本Token的表示。语义分支则通过最小化分割损失来学习如何利用分层码本进行语义分割。两个分支通过联合学习,相互促进,从而实现更好的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的PAT方法能够有效提升开放词汇语义分割的性能。与基线模型相比,PAT在分割精度上取得了显著提升,并在开放词汇语义分割基准上取得了有竞争力的结果。此外,该模型具有参数高效的特点,易于集成到现有的VLM框架中。

🎯 应用场景

该研究成果可应用于自动驾驶、遥感图像分析、医学图像诊断等领域,提升机器对复杂场景的理解能力。通过开放词汇语义分割,可以识别图像中未预先定义的物体,增强系统的泛化能力和适应性,具有重要的实际应用价值和广阔的发展前景。

📄 摘要(原文)

The visual understanding are often approached from 3 granular levels: image, patch and pixel. Visual Tokenization, trained by self-supervised reconstructive learning, compresses visual data by codebook in patch-level with marginal information loss, but the visual tokens does not have semantic meaning. Open Vocabulary semantic segmentation benefits from the evolving Vision-Language models (VLMs) with strong image zero-shot capability, but transferring image-level to pixel-level understanding remains an imminent challenge. In this paper, we treat segmentation as tokenizing pixels and study a united perceptual and semantic token compression for all granular understanding and consequently facilitate open vocabulary semantic segmentation. Referring to the cognitive process of pretrained VLM where the low-level features are progressively composed to high-level semantics, we propose Feature Pyramid Tokenization (PAT) to cluster and represent multi-resolution feature by learnable codebooks and then decode them by joint learning pixel reconstruction and semantic segmentation. We design loosely coupled pixel and semantic learning branches. The pixel branch simulates bottom-up composition and top-down visualization of codebook tokens, while the semantic branch collectively fuse hierarchical codebooks as auxiliary segmentation guidance. Our experiments show that PAT enhances the semantic intuition of VLM feature pyramid, improves performance over the baseline segmentation model and achieves competitive performance on open vocabulary semantic segmentation benchmark. Our model is parameter-efficient for VLM integration and flexible for the independent tokenization. We hope to give inspiration not only on improving segmentation but also on semantic visual token utilization.