A Review of Multimodal Explainable Artificial Intelligence: Past, Present and Future

作者: Shilin Sun, Wenbin An, Feng Tian, Fang Nan, Qidong Liu, Jun Liu, Nazaraf Shah, Ping Chen

分类: cs.CV, cs.AI, cs.CL, cs.LG, cs.MM

发布日期: 2024-12-18

备注: This work has been submitted to the IEEE for possible publication

🔗 代码/项目: GITHUB

💡 一句话要点

综述多模态可解释人工智能(MXAI)方法,应对AI黑盒难题,提升透明度和信任度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 可解释人工智能 综述 深度学习 大型语言模型 AI透明度 AI信任 评估指标

📋 核心要点

- 现有AI模型,特别是处理多模态数据的模型,通常是“黑盒”,缺乏透明性和可解释性,导致用户难以信任其决策。

- 本文对多模态可解释人工智能(MXAI)方法进行全面综述,从历史角度将其划分为四个发展阶段,并分析了每个阶段的特点。

- 该综述总结了MXAI研究中常用的评估指标和数据集,并对未来发展方向和挑战进行了展望,为后续研究提供指导。

📝 摘要(中文)

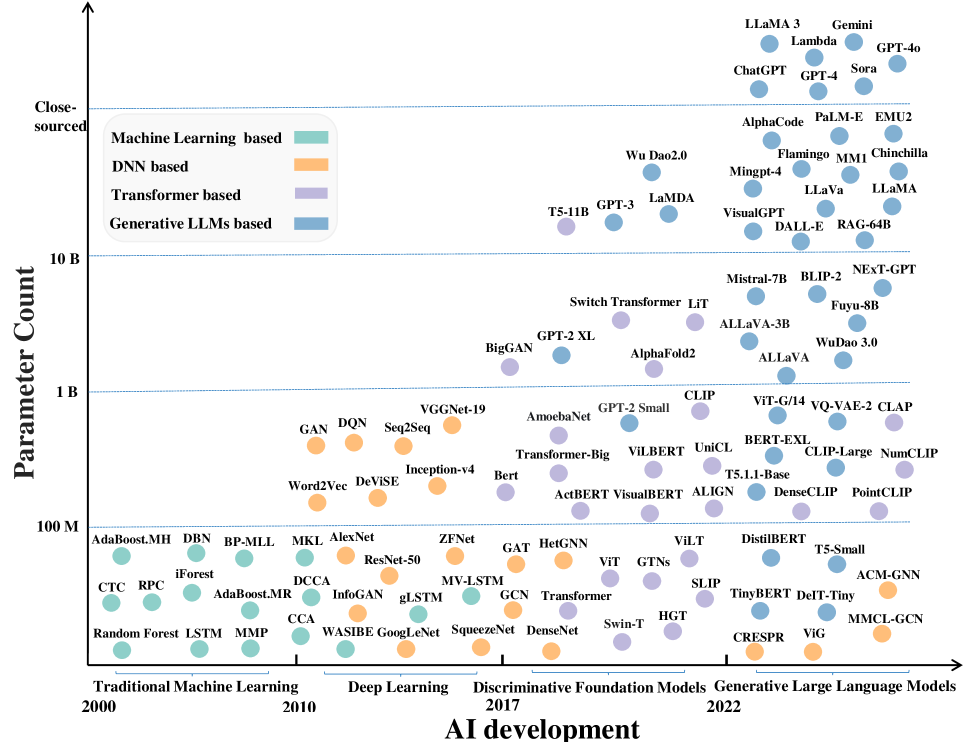

随着计算能力和海量数据集的快速发展,人工智能(AI)取得了显著进步。然而,这也加剧了AI模型“黑盒”性质带来的挑战。为了解决这些问题,可解释人工智能(XAI)应运而生,专注于透明性和可解释性,以增强人类对AI决策过程的理解和信任。在多模态数据融合和复杂推理场景下,多模态可解释人工智能(MXAI)被提出,它整合多种模态进行预测和解释任务。同时,大型语言模型(LLM)的出现带来了自然语言处理的显著突破,但其复杂性进一步加剧了MXAI的问题。为了深入了解MXAI方法的发展,并为构建更透明、公平和值得信赖的AI系统提供关键指导,我们从历史角度回顾了MXAI方法,并将其分为四个时代:传统机器学习、深度学习、判别式基础模型和生成式LLM。我们还回顾了MXAI研究中使用的评估指标和数据集,最后讨论了未来的挑战和方向。与本综述相关的项目已在https://github.com/ShilinSun/mxai_review上创建。

🔬 方法详解

问题定义:论文旨在解决多模态人工智能模型的可解释性问题。现有方法在处理复杂的多模态数据时,往往难以提供清晰、易懂的解释,导致用户难以理解和信任模型的决策过程。尤其是在大型语言模型(LLM)出现后,模型复杂度进一步提升,可解释性问题更加突出。

核心思路:论文的核心思路是从历史发展的角度,对MXAI方法进行系统性的梳理和分类,从而揭示不同阶段MXAI方法的技术特点和演进趋势。通过分析不同方法的优缺点,为未来的MXAI研究提供借鉴和指导。同时,论文也关注了评估指标和数据集,为MXAI研究的有效性评估提供参考。

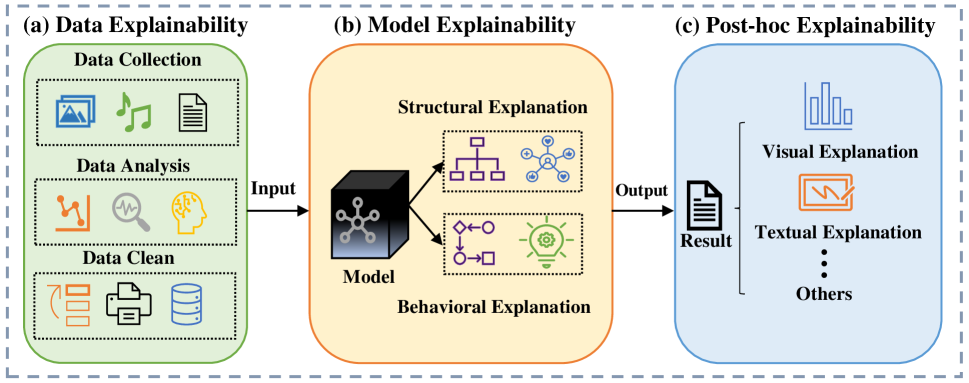

技术框架:论文的技术框架主要包括以下几个部分:1)对MXAI进行定义和问题描述;2)将MXAI的发展历程划分为四个阶段:传统机器学习、深度学习、判别式基础模型和生成式LLM;3)分别对每个阶段的MXAI方法进行详细介绍和分析;4)总结MXAI研究中常用的评估指标和数据集;5)讨论MXAI未来发展方向和挑战。

关键创新:该综述的关键创新在于其系统性和全面性。它不仅回顾了MXAI方法的发展历程,还对其进行了细致的分类和分析,并总结了评估指标和数据集。此外,论文还对未来发展方向和挑战进行了展望,为后续研究提供了有价值的参考。将MXAI的发展划分为四个阶段,有助于研究者更好地理解不同阶段MXAI方法的技术特点和演进趋势。

关键设计:论文的关键设计在于其分类框架和分析方法。论文将MXAI的发展历程划分为四个阶段,并分别对每个阶段的MXAI方法进行详细介绍和分析。在分析过程中,论文关注了方法的原理、优缺点、适用场景等方面,并结合具体的案例进行说明。此外,论文还对评估指标和数据集进行了总结,为MXAI研究的有效性评估提供了参考。

🖼️ 关键图片

📊 实验亮点

该综述系统性地回顾了MXAI方法的发展历程,并将其划分为四个阶段,为研究者提供了清晰的MXAI发展脉络。同时,论文总结了MXAI研究中常用的评估指标和数据集,为后续研究提供了重要的参考。该综述在github上开源,方便研究者获取相关资源。

🎯 应用场景

该研究成果可应用于各种需要可解释AI的领域,例如医疗诊断、金融风控、自动驾驶等。通过提供清晰、易懂的解释,MXAI可以帮助用户更好地理解和信任AI的决策,从而提高AI的应用价值和接受度。未来,MXAI有望成为构建更透明、公平和值得信赖的AI系统的关键技术。

📄 摘要(原文)

Artificial intelligence (AI) has rapidly developed through advancements in computational power and the growth of massive datasets. However, this progress has also heightened challenges in interpreting the "black-box" nature of AI models. To address these concerns, eXplainable AI (XAI) has emerged with a focus on transparency and interpretability to enhance human understanding and trust in AI decision-making processes. In the context of multimodal data fusion and complex reasoning scenarios, the proposal of Multimodal eXplainable AI (MXAI) integrates multiple modalities for prediction and explanation tasks. Meanwhile, the advent of Large Language Models (LLMs) has led to remarkable breakthroughs in natural language processing, yet their complexity has further exacerbated the issue of MXAI. To gain key insights into the development of MXAI methods and provide crucial guidance for building more transparent, fair, and trustworthy AI systems, we review the MXAI methods from a historical perspective and categorize them across four eras: traditional machine learning, deep learning, discriminative foundation models, and generative LLMs. We also review evaluation metrics and datasets used in MXAI research, concluding with a discussion of future challenges and directions. A project related to this review has been created at https://github.com/ShilinSun/mxai_review.