Zero-Shot Prompting and Few-Shot Fine-Tuning: Revisiting Document Image Classification Using Large Language Models

作者: Anna Scius-Bertrand, Michael Jungo, Lars Vögtlin, Jean-Marc Spat, Andreas Fischer

分类: cs.CV

发布日期: 2024-12-18

备注: ICPR 2024

期刊: International Conference on Pattern Recognition - ICPR 2024, pp 152-166. Cham: Springer Nature Switzerland

DOI: 10.1007/978-3-031-78495-8_10

💡 一句话要点

利用大语言模型,探索零样本提示与少样本微调在文档图像分类中的应用

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 文档图像分类 大型语言模型 零样本学习 少样本学习 提示工程 模型微调 文档理解

📋 核心要点

- 文档图像分类依赖大量标注数据,现有方法在RVL-CDIP等数据集上虽表现良好,但对数据依赖性高。

- 论文探索利用LLM的少样本学习能力,通过零样本提示和少样本微调,降低对人工标注数据的需求。

- 研究旨在探索在文档图像分类任务中,如何有效利用LLM,减少对大量训练数据的依赖,提升模型泛化能力。

📝 摘要(中文)

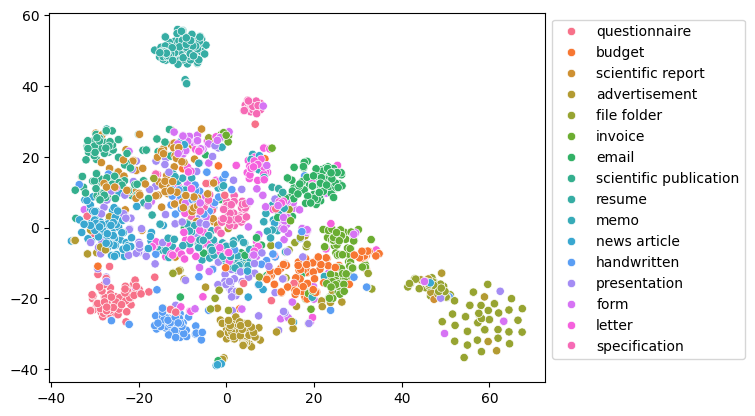

本文研究了如何利用大型语言模型(LLM)解决文档图像分类问题,旨在尽可能减少对人工标注训练样本的需求。文档图像分类是一个具有挑战性的问题,它涉及图像、布局和文本分析,以实现文档理解。尽管如此,对于某些基准数据集,特别是RVL-CDIP,当考虑数十万个训练样本时,现有技术水平正接近完美的性能。随着大型语言模型(LLM)的出现,它们是优秀的少样本学习器,问题在于,仅使用少量甚至没有训练样本,文档分类问题可以在多大程度上得到解决。本文在零样本提示和少样本模型微调的背景下探讨了这个问题。

🔬 方法详解

问题定义:论文旨在解决文档图像分类问题,现有方法虽然在特定数据集上取得了不错的成果,但严重依赖大量的标注数据,这在实际应用中成本很高,限制了模型的泛化能力。因此,如何减少对大量标注数据的依赖,是本文要解决的核心问题。

核心思路:论文的核心思路是利用大型语言模型(LLM)强大的少样本学习能力,通过零样本提示和少样本微调,使模型能够在少量甚至没有标注数据的情况下,完成文档图像分类任务。这种方法旨在降低对人工标注数据的需求,提高模型的实用性和泛化能力。

技术框架:论文主要探索了两种方法:零样本提示和少样本微调。在零样本提示中,直接将文档图像的描述作为提示输入LLM,让LLM直接给出分类结果。在少样本微调中,使用少量标注数据对LLM进行微调,使其更好地适应文档图像分类任务。整体流程包括数据预处理、提示构建(零样本)或数据增强(少样本)、LLM推理或微调、以及结果评估。

关键创新:论文的关键创新在于将大型语言模型应用于文档图像分类任务,并探索了零样本提示和少样本微调两种策略。与传统方法相比,这种方法能够显著减少对标注数据的依赖,并且具有更好的泛化能力。此外,论文还研究了不同提示策略和微调方法对模型性能的影响。

关键设计:论文的关键设计包括:1) 针对文档图像特点的提示工程,例如使用文档类型、布局等信息构建提示;2) 选择合适的LLM作为基础模型,例如具有强大文本理解和生成能力的模型;3) 设计有效的少样本微调策略,例如使用数据增强技术扩充训练数据,或者使用特定的损失函数优化模型。

🖼️ 关键图片

📊 实验亮点

论文重点探索了零样本提示和少样本微调在文档图像分类上的效果,旨在减少对大量标注数据的依赖。虽然摘要中没有给出具体的性能数据和对比基线,但强调了利用LLM在少样本学习方面的潜力,为未来的研究方向提供了思路。

🎯 应用场景

该研究成果可应用于自动化文档处理、智能办公、金融风控等领域。通过减少对大量标注数据的依赖,可以降低文档图像分类的成本,提高效率。未来,该方法有望应用于更复杂的文档理解任务,例如信息抽取、问答等。

📄 摘要(原文)

Classifying scanned documents is a challenging problem that involves image, layout, and text analysis for document understanding. Nevertheless, for certain benchmark datasets, notably RVL-CDIP, the state of the art is closing in to near-perfect performance when considering hundreds of thousands of training samples. With the advent of large language models (LLMs), which are excellent few-shot learners, the question arises to what extent the document classification problem can be addressed with only a few training samples, or even none at all. In this paper, we investigate this question in the context of zero-shot prompting and few-shot model fine-tuning, with the aim of reducing the need for human-annotated training samples as much as possible.