MobiFuse: A High-Precision On-device Depth Perception System with Multi-Data Fusion

作者: Jinrui Zhang, Deyu Zhang, Tingting Long, Wenxin Chen, Ju Ren, Yunxin Liu, Yudong Zhao, Yaoxue Zhang, Youngki Lee

分类: cs.CV

发布日期: 2024-12-18

💡 一句话要点

MobiFuse:一种基于多数据融合的高精度移动端深度感知系统

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 深度感知 多传感器融合 移动设备 深度误差估计 三维重建

📋 核心要点

- 现有移动端深度感知方案精度不足,尤其是在复杂光照和纹理环境下,ToF和双目匹配易受干扰。

- MobiFuse利用物理原理构建深度误差指示(DEI)模态,融合ToF和双目深度图,实现更精确的深度估计。

- 实验表明,MobiFuse显著降低深度测量误差达77.7%,并在3D重建和分割等任务中表现出优越性能。

📝 摘要(中文)

本文提出MobiFuse,一种结合双目RGB相机和飞行时间(ToF)相机的高精度移动设备深度感知系统。为了实现这一目标,我们利用来自各种环境因素的物理原理,提出了深度误差指示(DEI)模态,用于表征ToF和立体匹配的深度误差。此外,我们采用渐进式融合策略,将来自ToF和立体深度图的几何特征与来自DEI模态的深度误差特征融合,以创建精确的深度图。此外,我们创建了一个新的ToF-Stereo深度数据集RealToF,用于训练和验证我们的模型。实验表明,MobiFuse优于基线方法,深度测量误差最多可降低77.7%。它还在不同的数据集上展示了强大的泛化能力,并证明了在两个下游任务(3D重建和3D分割)中的有效性。MobiFuse在现实场景中的演示视频可在YouTube链接(https://youtu.be/jy-Sp7T1LVs)上找到。

🔬 方法详解

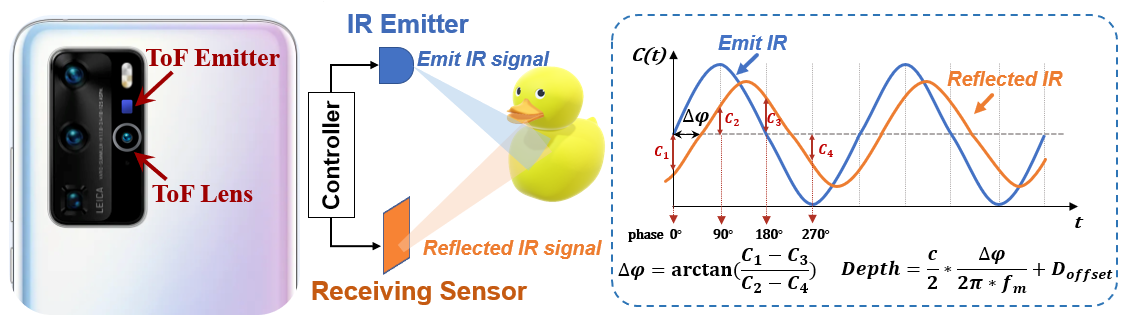

问题定义:移动设备上的深度感知在许多应用中至关重要,但现有方法,如ToF和双目视觉,在精度和鲁棒性方面存在局限性。ToF相机易受环境光照和多径效应的影响,而双目视觉在低纹理区域表现不佳。因此,如何融合多种传感器数据,提高移动端深度感知的精度和鲁棒性是一个关键问题。

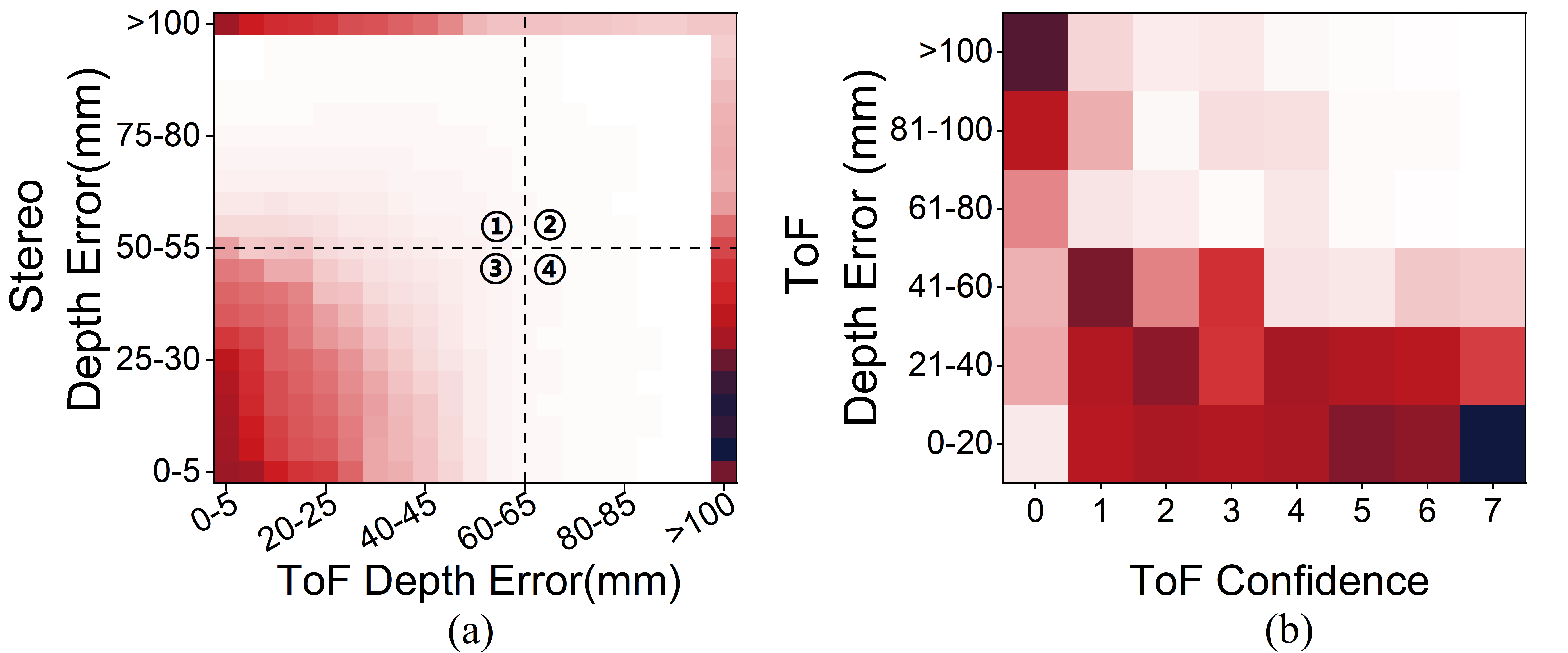

核心思路:MobiFuse的核心思路是利用多种传感器(双目RGB和ToF)的互补优势,并引入深度误差指示(DEI)模态来指导深度融合。通过分析环境因素对不同传感器深度估计的影响,MobiFuse能够更准确地估计深度误差,并据此进行加权融合,从而提高整体深度感知精度。

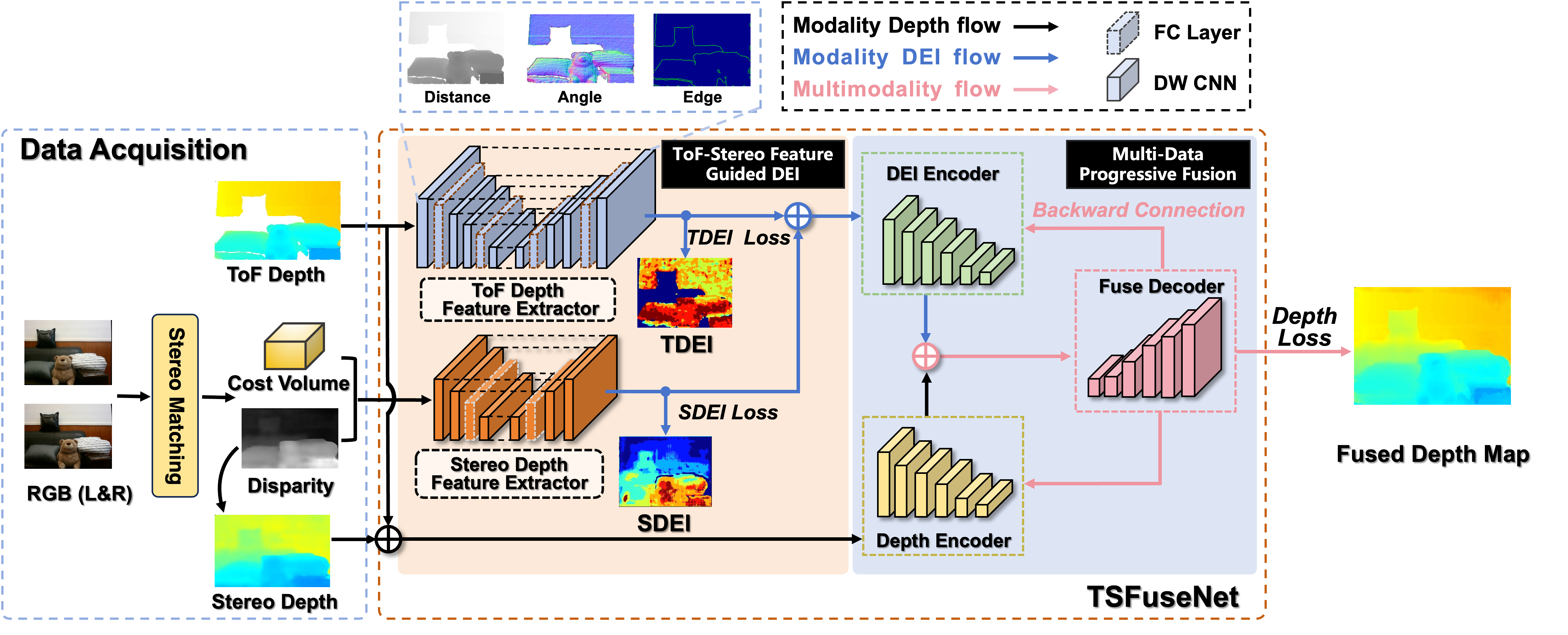

技术框架:MobiFuse系统主要包含三个阶段:1) 深度估计:分别使用ToF相机和双目视觉算法生成初始深度图。2) 深度误差指示(DEI)模态生成:基于物理原理,分析环境光照、纹理等因素对ToF和双目深度估计的影响,生成DEI特征。3) 渐进式深度融合:将ToF深度图、双目深度图和DEI特征输入到融合网络中,逐步融合不同模态的信息,最终生成高精度的深度图。

关键创新:MobiFuse的关键创新在于DEI模态的引入。DEI模态能够显式地表征ToF和双目深度估计的误差,从而为深度融合提供更准确的指导信息。与传统的直接融合方法相比,MobiFuse能够更有效地利用不同传感器的数据,提高深度感知精度。

关键设计:DEI模态的生成依赖于对环境因素的建模,例如,通过分析图像的梯度信息来估计双目视觉的深度不确定性。融合网络采用渐进式融合策略,逐步融合不同模态的信息。损失函数包括深度回归损失和深度一致性损失,以保证深度估计的准确性和一致性。

🖼️ 关键图片

📊 实验亮点

MobiFuse在RealToF数据集上取得了显著的性能提升,深度测量误差降低了77.7%,优于其他基线方法。此外,MobiFuse在不同的数据集上表现出良好的泛化能力,并在3D重建和3D分割等下游任务中取得了优异的结果。这些实验结果表明,MobiFuse是一种有效且鲁棒的移动端深度感知系统。

🎯 应用场景

MobiFuse在移动增强现实(AR)、虚拟现实(VR)、机器人导航、三维重建、室内场景理解等领域具有广泛的应用前景。高精度的深度感知能够提升AR/VR应用的沉浸感和交互性,帮助机器人更好地理解周围环境,并为三维重建提供更准确的几何信息。该研究有助于推动移动设备在三维感知领域的应用。

📄 摘要(原文)

We present MobiFuse, a high-precision depth perception system on mobile devices that combines dual RGB and Time-of-Flight (ToF) cameras. To achieve this, we leverage physical principles from various environmental factors to propose the Depth Error Indication (DEI) modality, characterizing the depth error of ToF and stereo-matching. Furthermore, we employ a progressive fusion strategy, merging geometric features from ToF and stereo depth maps with depth error features from the DEI modality to create precise depth maps. Additionally, we create a new ToF-Stereo depth dataset, RealToF, to train and validate our model. Our experiments demonstrate that MobiFuse excels over baselines by significantly reducing depth measurement errors by up to 77.7%. It also showcases strong generalization across diverse datasets and proves effectiveness in two downstream tasks: 3D reconstruction and 3D segmentation. The demo video of MobiFuse in real-life scenarios is available at the de-identified YouTube link(https://youtu.be/jy-Sp7T1LVs).