Multi-Exposure Image Fusion via Distilled 3D LUT Grid with Editable Mode

作者: Xin Su, Zhuoran Zheng

分类: cs.CV

发布日期: 2024-12-18

💡 一句话要点

提出基于蒸馏3D LUT网格的多曝光图像融合方法,支持编辑模式

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 多曝光图像融合 3D LUT 师生网络 隐式表示 图像增强

📋 核心要点

- 现有方法难以实时处理超高分辨率多曝光图像融合,且缺乏灵活性。

- 利用师生网络建模3D LUT网格的不确定性,并引入隐式表示函数实现可编辑性。

- 实验表明,该方法在效率和准确性方面都表现出很强的竞争力。

📝 摘要(中文)

随着手持设备成像分辨率的提高,现有的多曝光图像融合算法难以实时生成超高分辨率的高动态范围图像。此外,根据不同应用场景的需求设计可管理和可编辑的算法已成为一种趋势。为了解决这些问题,我们引入了3D LUT技术,该技术可以在资源受限的设备上实时增强超高清(UHD)分辨率的图像。然而,由于来自不同曝光率的多个图像的信息融合具有不确定性,这种不确定性极大地考验了3D LUT网格的泛化能力。为了解决这个问题并确保模型具有强大的学习空间,我们提出使用师生网络来建模3D LUT网格上的不确定性。此外,我们通过使用隐式表示函数为多曝光图像融合算法提供了一种可编辑模式,以满足不同场景中的需求。大量实验表明,我们提出的方法在效率和准确性方面都具有很强的竞争力。

🔬 方法详解

问题定义:现有方法在处理超高分辨率的多曝光图像融合时,计算复杂度高,难以在资源受限的设备上实现实时处理。此外,针对不同应用场景,用户往往需要对融合结果进行调整,而现有方法缺乏可编辑性,难以满足个性化需求。

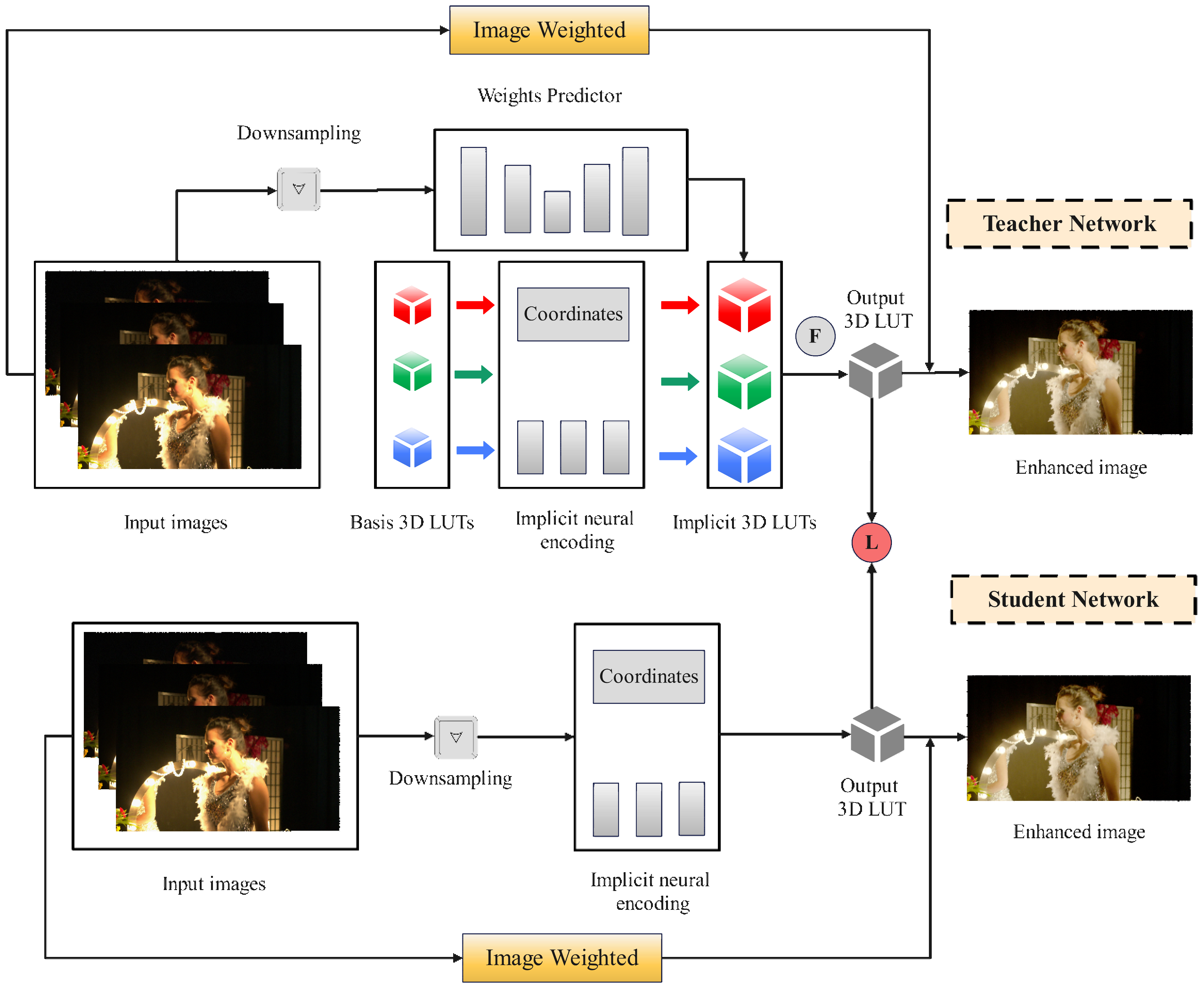

核心思路:论文的核心思路是利用3D LUT(Look-Up Table)技术加速图像增强过程,并通过师生网络建模多曝光图像融合过程中的不确定性,提高3D LUT的泛化能力。同时,引入隐式表示函数,将融合结果映射到可编辑的参数空间,从而实现对融合结果的灵活调整。

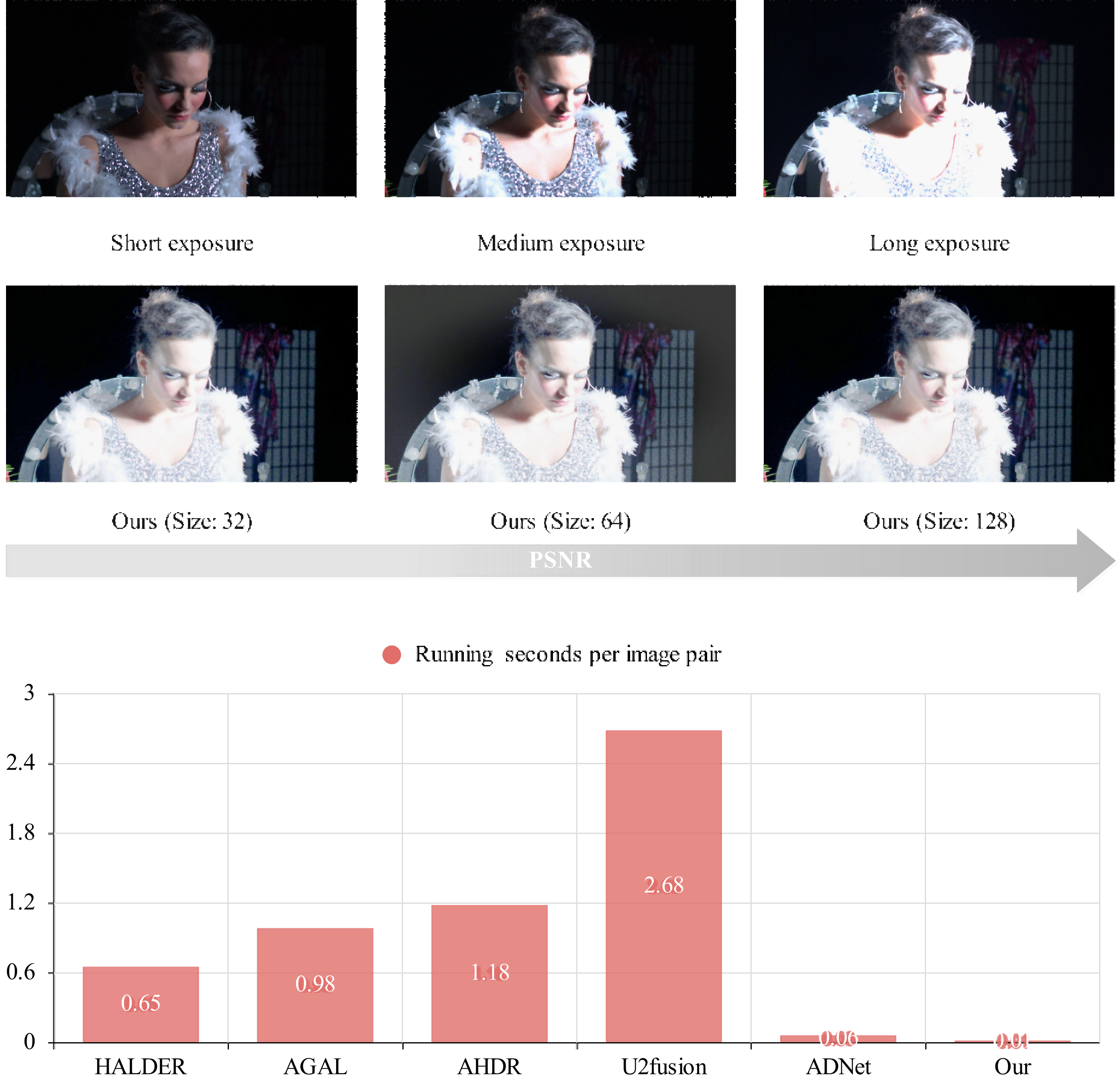

技术框架:该方法采用师生网络框架。教师网络负责生成高质量的融合结果,学生网络则学习教师网络的输出,并生成3D LUT网格。用户可以通过调整隐式表示函数的参数,对3D LUT进行编辑,从而实现对融合结果的调整。整体流程包括:多曝光图像输入、教师网络融合、学生网络学习并生成3D LUT、用户编辑3D LUT、最终图像输出。

关键创新:该方法的主要创新点在于:1) 利用师生网络建模多曝光图像融合的不确定性,提高了3D LUT的泛化能力;2) 引入隐式表示函数,实现了对融合结果的可编辑性,满足了不同应用场景的需求;3) 将3D LUT技术应用于多曝光图像融合,实现了在资源受限设备上的实时处理。

关键设计:教师网络和学生网络的具体结构未知,但关键在于教师网络需要能够生成高质量的融合结果,学生网络需要能够有效地学习教师网络的输出,并生成具有良好泛化能力的3D LUT网格。隐式表示函数的选择和参数化方式是实现可编辑性的关键。损失函数的设计需要考虑融合结果的质量、3D LUT的平滑性以及编辑操作的有效性。具体的参数设置和网络结构在论文中可能有所描述,但此处信息不足,无法详细说明。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了所提出方法在效率和准确性方面的优势。具体性能数据未知,但摘要中提到该方法在效率和准确性方面都具有很强的竞争力。与现有方法相比,该方法能够在资源受限的设备上实现实时处理,并提供可编辑模式,满足不同应用场景的需求。具体的提升幅度和对比基线未知。

🎯 应用场景

该研究成果可应用于手机、相机等手持设备的图像处理,实现高质量、实时的多曝光图像融合。通过可编辑模式,用户可以根据个人喜好或特定场景需求,调整图像的亮度、对比度、色彩等参数,获得更符合需求的图像。该技术还可应用于安防监控、自动驾驶等领域,提高图像的清晰度和动态范围,从而提升系统的性能。

📄 摘要(原文)

With the rising imaging resolution of handheld devices, existing multi-exposure image fusion algorithms struggle to generate a high dynamic range image with ultra-high resolution in real-time. Apart from that, there is a trend to design a manageable and editable algorithm as the different needs of real application scenarios. To tackle these issues, we introduce 3D LUT technology, which can enhance images with ultra-high-definition (UHD) resolution in real time on resource-constrained devices. However, since the fusion of information from multiple images with different exposure rates is uncertain, and this uncertainty significantly trials the generalization power of the 3D LUT grid. To address this issue and ensure a robust learning space for the model, we propose using a teacher-student network to model the uncertainty on the 3D LUT grid.Furthermore, we provide an editable mode for the multi-exposure image fusion algorithm by using the implicit representation function to match the requirements in different scenarios. Extensive experiments demonstrate that our proposed method is highly competitive in efficiency and accuracy.