GIRAFFE: Design Choices for Extending the Context Length of Visual Language Models

作者: Mukai Li, Lei Li, Shansan Gong, Qi Liu

分类: cs.CV, cs.AI, cs.CL

发布日期: 2024-12-17

备注: Working in progress

💡 一句话要点

GIRAFFE:通过系统设计选择扩展视觉语言模型的上下文长度至128K。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言模型 长上下文建模 位置编码 指令微调 数据配方 混合分辨率训练 多模态学习

📋 核心要点

- 现有视觉语言模型在长程建模方面存在不足,难以处理视觉代理等复杂任务。

- 论文提出GIRAFFE模型,通过数据、位置编码和训练策略的优化,有效扩展上下文长度。

- GIRAFFE在长上下文VLM基准测试中达到SOTA,与GPT-4V等商业模型具有竞争力。

📝 摘要(中文)

视觉语言模型(VLM)在处理多模态输入方面表现出令人印象深刻的能力,但视觉代理等应用需要处理多个图像和高分辨率视频,这需要增强长程建模能力。现有的开源VLM缺乏对扩展上下文长度的系统性探索,而商业模型通常提供的细节有限。为了解决这个问题,我们的目标是建立一个有效的解决方案,增强VLM的长上下文性能,同时保持其在短上下文场景中的能力。为此,我们通过从数据整理到上下文窗口扩展和利用的广泛实验设置,做出了最佳设计选择:(1)我们分析了数据来源和长度分布,构建了ETVLM,这是一种平衡跨场景性能的数据配方;(2)我们检查了现有的位置扩展方法,识别了它们的局限性,并提出了M-RoPE++作为一种增强方法;我们还选择仅使用混合源数据对骨干网络进行指令微调;(3)我们讨论了如何更好地利用扩展的上下文窗口,并提出了混合分辨率训练。基于Qwen-VL系列模型,我们提出了Giraffe,它有效地扩展到128K长度。在VideoMME和Visual Haystacks等广泛的长上下文VLM基准上进行评估,我们的Giraffe在类似大小的开源长VLM中实现了最先进的性能,并且与商业模型GPT-4V相比具有竞争力。我们将开源代码、数据和模型。

🔬 方法详解

问题定义:现有视觉语言模型(VLMs)在处理长序列视觉信息时面临挑战,尤其是在需要处理多个图像或高分辨率视频的场景下。开源VLMs缺乏对上下文长度扩展的系统研究,而商业模型细节不透明。现有方法在长上下文建模能力、训练效率和短上下文性能保持方面存在痛点。

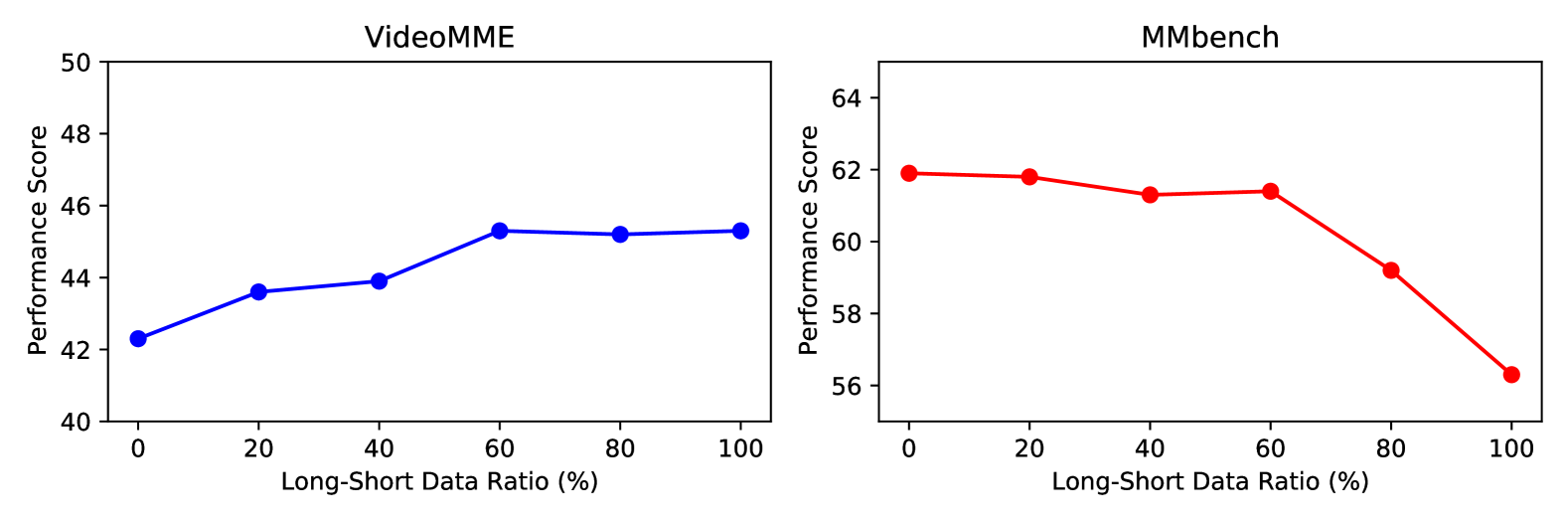

核心思路:GIRAFFE的核心思路是通过系统性的设计选择,包括数据配方、位置编码方法和训练策略,来有效扩展VLMs的上下文长度,同时保持其在短上下文场景下的性能。这种设计思路强调平衡长短上下文性能,并充分利用扩展的上下文窗口。

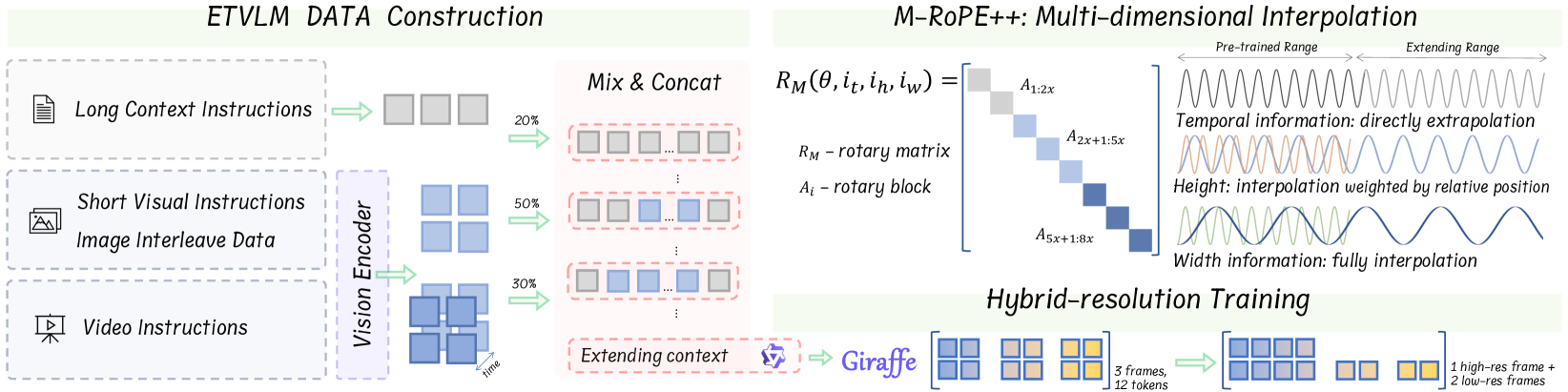

技术框架:GIRAFFE建立在Qwen-VL系列模型之上,主要包含以下几个关键模块:1) ETVLM数据配方:用于平衡不同场景下的性能。2) M-RoPE++位置编码:一种增强的位置扩展方法,克服了现有方法的局限性。3) 混合分辨率训练:用于更好地利用扩展的上下文窗口。整个框架采用指令微调的方式,使用混合源数据对骨干网络进行训练。

关键创新:GIRAFFE的关键创新在于其系统性的设计选择和M-RoPE++位置编码方法。M-RoPE++通过改进旋转位置编码,更好地适应长上下文建模,同时避免了性能下降。此外,混合分辨率训练策略也提高了训练效率和性能。

关键设计:ETVLM数据配方通过分析数据来源和长度分布,构建了一个平衡的数据集,以确保模型在不同长度的上下文上都能表现良好。M-RoPE++的具体实现细节未知,但其目标是克服现有位置编码方法的局限性。混合分辨率训练的具体策略也未知,但其目的是在训练过程中使用不同分辨率的图像,以提高训练效率和性能。

🖼️ 关键图片

📊 实验亮点

GIRAFFE在VideoMME和Visual Haystacks等长上下文VLM基准测试中取得了最先进的性能,尤其是在同等规模的开源模型中表现突出。虽然具体性能数据未知,但论文强调GIRAFFE与商业模型GPT-4V相比具有竞争力,证明了其在长上下文建模方面的有效性。

🎯 应用场景

GIRAFFE模型可应用于视觉代理、视频理解、图像检索等领域。例如,在视觉代理中,GIRAFFE可以处理多个图像输入,从而更好地理解环境并做出决策。在视频理解中,GIRAFFE可以处理长视频序列,从而更好地理解视频内容。该研究有助于推动视觉语言模型在实际应用中的发展。

📄 摘要(原文)

Visual Language Models (VLMs) demonstrate impressive capabilities in processing multimodal inputs, yet applications such as visual agents, which require handling multiple images and high-resolution videos, demand enhanced long-range modeling. Moreover, existing open-source VLMs lack systematic exploration into extending their context length, and commercial models often provide limited details. To tackle this, we aim to establish an effective solution that enhances long context performance of VLMs while preserving their capacities in short context scenarios. Towards this goal, we make the best design choice through extensive experiment settings from data curation to context window extending and utilizing: (1) we analyze data sources and length distributions to construct ETVLM - a data recipe to balance the performance across scenarios; (2) we examine existing position extending methods, identify their limitations and propose M-RoPE++ as an enhanced approach; we also choose to solely instruction-tune the backbone with mixed-source data; (3) we discuss how to better utilize extended context windows and propose hybrid-resolution training. Built on the Qwen-VL series model, we propose Giraffe, which is effectively extended to 128K lengths. Evaluated on extensive long context VLM benchmarks such as VideoMME and Viusal Haystacks, our Giraffe achieves state-of-the-art performance among similarly sized open-source long VLMs and is competitive with commercial model GPT-4V. We will open-source the code, data, and models.