GS-ProCams: Gaussian Splatting-based Projector-Camera Systems

作者: Qingyue Deng, Jijiang Li, Haibin Ling, Bingyao Huang

分类: cs.CV, cs.GR, cs.MM

发布日期: 2024-12-16 (更新: 2025-10-26)

DOI: 10.1109/TVCG.2025.3616841

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出基于高斯溅射的投影相机系统GS-ProCams,实现高效、视角无关的投影映射。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 投影相机系统 高斯溅射 投影映射 视角无关 可微渲染

📋 核心要点

- 传统基于CNN的投影相机系统视角受限,而基于NeRF的方法计算和内存开销巨大,难以满足高效投影映射的需求。

- GS-ProCams利用2D高斯表示场景,显式建模投影仪响应、表面几何材料和全局光照,实现视角无关且高效的投影映射。

- 实验表明,GS-ProCams无需额外设备,模拟质量优于NeRF方法,训练内存占用仅为1/10,推理速度提升900倍。

📝 摘要(中文)

本文提出GS-ProCams,这是首个基于高斯溅射的投影相机系统(ProCams)框架。GS-ProCams不仅视角无关,而且显著提高了投影映射(PM)的效率,投影映射需要在投影仪和相机之间建立几何和辐射映射。以往基于CNN的ProCams受限于特定视角,限制了其在新视角下的应用。相比之下,基于NeRF的ProCams支持视角无关的投影映射,但需要额外的共址光源,并消耗大量的计算和内存资源。为了解决这个问题,我们提出了GS-ProCams,它采用2D高斯作为场景表示,并实现了高效的视角无关ProCams应用。特别地,我们使用投影仪响应、由高斯表示的投影表面几何和材料以及全局光照分量,显式地建模了ProCams的复杂几何和光度映射。然后,我们采用可微的基于物理的渲染,从捕获的多视角投影中联合估计它们。与最先进的基于NeRF的方法相比,我们的GS-ProCams消除了对额外设备的需求,实现了卓越的ProCams模拟质量。它还仅使用1/10的GPU内存进行训练,并在推理速度上快900倍。

🔬 方法详解

问题定义:论文旨在解决投影相机系统(ProCams)中视角依赖和计算资源消耗大的问题。现有的基于CNN的ProCams方法只能在特定视角下工作,而基于NeRF的方法虽然支持视角无关,但需要额外的硬件设备(共址光源)并且计算和内存需求很高,限制了其在实际应用中的部署。

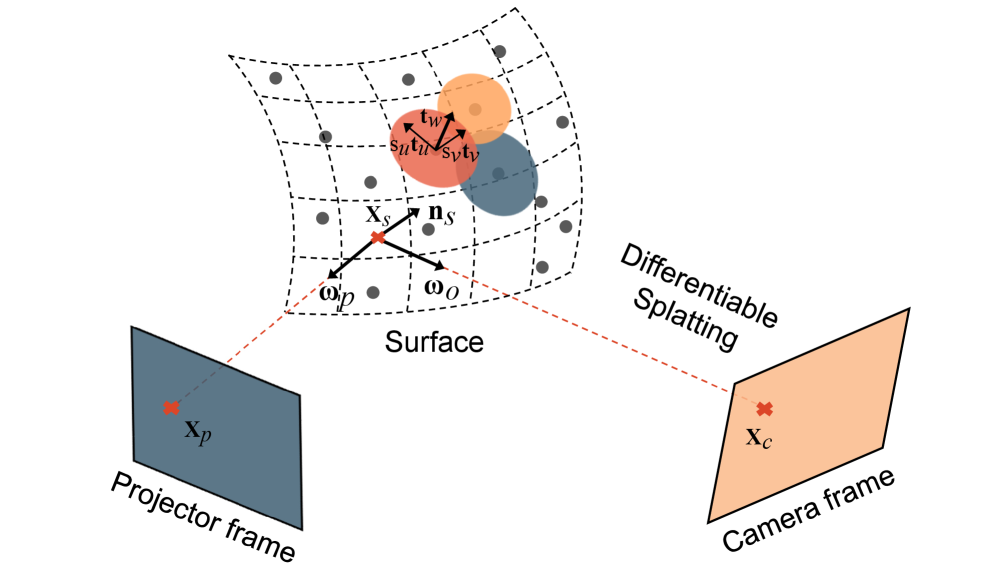

核心思路:论文的核心思路是利用3D高斯溅射(Gaussian Splatting)来表示场景,并显式地建模投影仪的响应、投影表面的几何和材质以及全局光照。通过这种方式,可以实现视角无关的投影映射,同时降低计算和内存的需求。高斯溅射本身具有可微渲染的特性,方便进行优化。

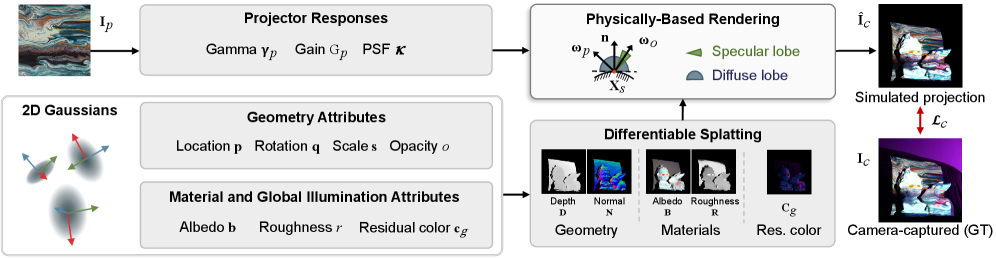

技术框架:GS-ProCams的整体框架包括以下几个主要模块:1) 场景表示:使用3D高斯溅射表示场景的几何和材质属性。2) 投影仪建模:显式建模投影仪的响应函数。3) 光照建模:考虑全局光照的影响。4) 可微渲染:使用可微的基于物理的渲染器,将高斯溅射表示的场景渲染到相机图像中。5) 优化:通过最小化渲染图像与真实图像之间的差异,联合优化高斯溅射的参数、投影仪响应和光照参数。

关键创新:论文的关键创新在于将3D高斯溅射引入到投影相机系统中,并提出了一种显式建模投影仪响应和光照的方法。与基于NeRF的方法相比,GS-ProCams不需要额外的硬件设备,并且计算和内存需求更低。与基于CNN的方法相比,GS-ProCams支持视角无关的投影映射。

关键设计:论文的关键设计包括:1) 使用2D高斯来表示场景,每个高斯包含位置、协方差、颜色和不透明度等参数。2) 使用一个神经网络来建模投影仪的响应函数。3) 使用球谐函数来表示全局光照。4) 使用基于物理的渲染方程来计算渲染图像的颜色。5) 使用L1损失函数和感知损失函数来优化高斯溅射的参数、投影仪响应和光照参数。

🖼️ 关键图片

📊 实验亮点

GS-ProCams在ProCams模拟质量上优于最先进的基于NeRF的方法,同时显著降低了计算和内存需求。具体来说,GS-ProCams仅使用1/10的GPU内存进行训练,并在推理速度上快900倍。这些结果表明,GS-ProCams是一种高效且实用的投影相机系统。

🎯 应用场景

GS-ProCams具有广泛的应用前景,例如:增强现实(AR)、虚拟现实(VR)、工业设计、文物修复、电影特效等。它可以用于在任意表面上进行精确的投影映射,实现沉浸式的用户体验。此外,GS-ProCams还可以用于三维重建和材质估计,为计算机视觉和图形学领域的研究提供新的思路。

📄 摘要(原文)

We present GS-ProCams, the first Gaussian Splatting-based framework for projector-camera systems (ProCams). GS-ProCams is not only view-agnostic but also significantly enhances the efficiency of projection mapping (PM) that requires establishing geometric and radiometric mappings between the projector and the camera. Previous CNN-based ProCams are constrained to a specific viewpoint, limiting their applicability to novel perspectives. In contrast, NeRF-based ProCams support view-agnostic projection mapping, however, they require an additional co-located light source and demand significant computational and memory resources. To address this issue, we propose GS-ProCams that employs 2D Gaussian for scene representations, and enables efficient view-agnostic ProCams applications. In particular, we explicitly model the complex geometric and photometric mappings of ProCams using projector responses, the projection surface's geometry and materials represented by Gaussians, and the global illumination component. Then, we employ differentiable physically-based rendering to jointly estimate them from captured multi-view projections. Compared to state-of-the-art NeRF-based methods, our GS-ProCams eliminates the need for additional devices, achieving superior ProCams simulation quality. It also uses only 1/10 of the GPU memory for training and is 900 times faster in inference speed. Please refer to our project page for the code and dataset: https://realqingyue.github.io/GS-ProCams/.