OmniHD-Scenes: A Next-Generation Multimodal Dataset for Autonomous Driving

作者: Lianqing Zheng, Long Yang, Qunshu Lin, Wenjin Ai, Minghao Liu, Shouyi Lu, Jianan Liu, Hongze Ren, Jingyue Mo, Xiaokai Bai, Jie Bai, Zhixiong Ma, Xichan Zhu

分类: cs.CV

发布日期: 2024-12-14 (更新: 2025-01-23)

💡 一句话要点

OmniHD-Scenes:新一代自动驾驶多模态数据集,助力低成本传感器方案

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动驾驶 多模态数据集 3D目标检测 语义分割 占用预测 4D成像雷达 传感器融合

📋 核心要点

- 现有自动驾驶算法对高质量、多模态数据的需求日益增长,而现有数据集在数据覆盖范围、详细标注和场景多样性方面存在不足。

- OmniHD-Scenes数据集通过集成128线激光雷达、摄像头和4D成像雷达数据,提供全向高清环境感知,并提出新的4D标注流程和自动化密集占用真值生成流程。

- 实验表明,该数据集支持低成本传感器配置,并在恶劣条件下表现出鲁棒性,为自动驾驶应用提供了有价值的资源。

📝 摘要(中文)

深度学习的快速发展对自动驾驶算法提出了对综合数据的需求。高质量的数据集对于开发有效的数据驱动的自动驾驶解决方案至关重要。下一代自动驾驶数据集必须是多模态的,包含来自先进传感器的数据,这些传感器具有广泛的数据覆盖、详细的注释和多样化的场景表示。为了满足这一需求,我们提出了OmniHD-Scenes,这是一个大规模多模态数据集,提供全面的全向高清数据。OmniHD-Scenes数据集结合了来自128线激光雷达、六个摄像头和六个4D成像雷达系统的数据,以实现完整的环境感知。该数据集包含1501个片段,每个片段约30秒长,总计超过450K个同步帧和超过585万个同步传感器数据点。我们还提出了一种新颖的4D注释流程。到目前为止,我们已经用超过514K个精确的3D边界框注释了200个片段。这些片段还包括静态场景元素的语义分割注释。此外,我们还引入了一种新颖的自动化流程,用于生成密集的占用真值,该流程有效地利用了来自非关键帧的信息。除了提出的数据集之外,我们还为3D检测和语义占用预测建立了全面的评估指标、基线模型和基准。这些基准利用环视摄像头和4D成像雷达来探索用于自动驾驶应用的经济高效的传感器解决方案。大量的实验证明了我们的低成本传感器配置的有效性及其在不利条件下的鲁棒性。数据将在https://www.2077ai.com/OmniHD-Scenes发布。

🔬 方法详解

问题定义:论文旨在解决自动驾驶领域缺乏高质量、多模态数据集的问题。现有数据集通常在传感器覆盖范围、标注精细度和场景多样性方面存在局限性,难以满足先进自动驾驶算法的训练和评估需求。特别是,如何有效利用低成本传感器配置,并在恶劣条件下保持感知系统的鲁棒性,是一个重要的挑战。

核心思路:论文的核心思路是构建一个大规模、多模态的自动驾驶数据集,该数据集包含来自多种传感器的同步数据,并提供详细的3D边界框和语义分割标注。此外,论文还提出了一种自动化流程,用于生成密集的占用真值,从而更全面地描述环境。通过提供高质量的数据和基准,论文旨在促进自动驾驶算法的开发和评估,并探索低成本传感器配置的潜力。

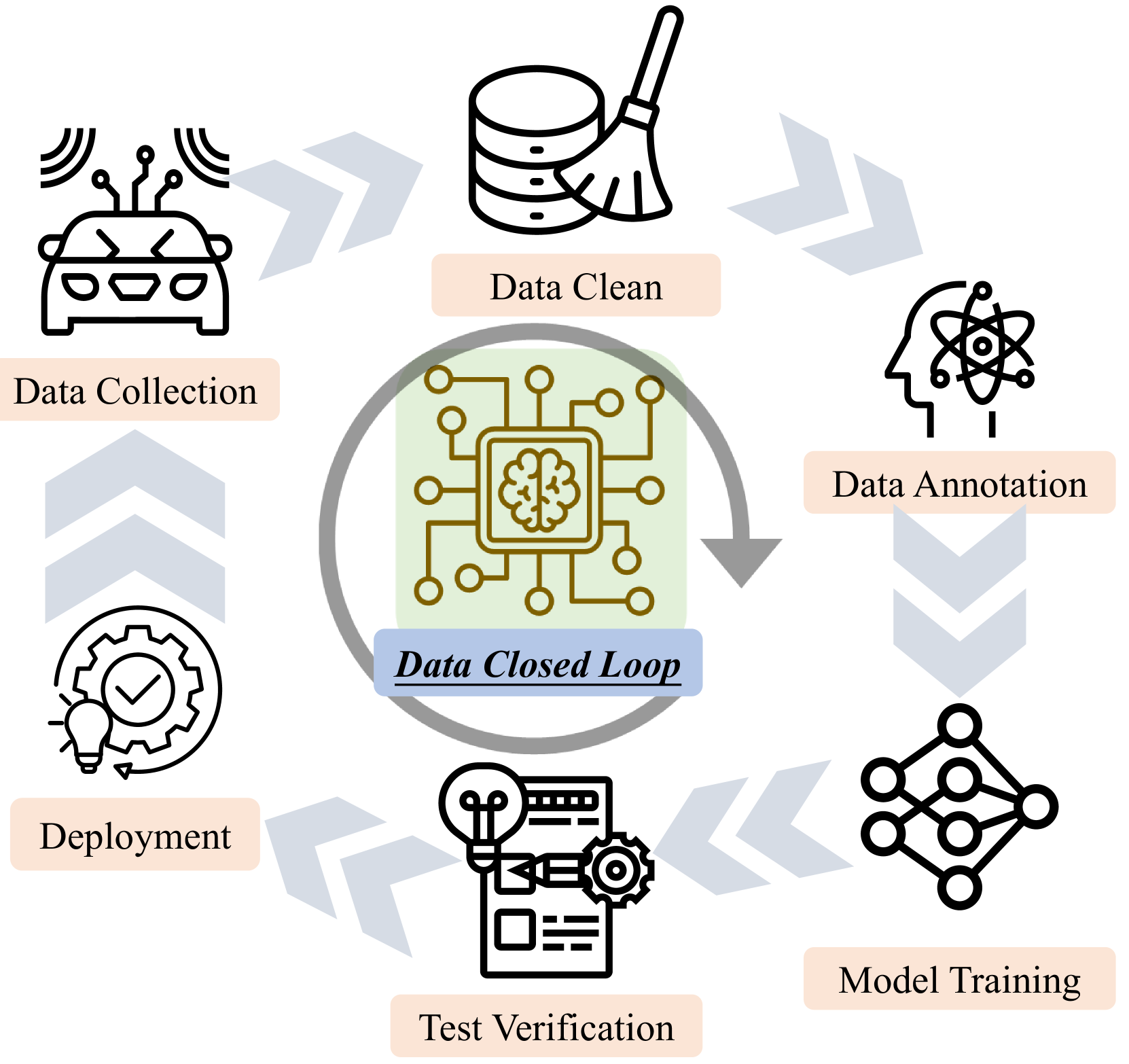

技术框架:OmniHD-Scenes数据集的构建流程主要包括以下几个阶段:1) 数据采集:使用配备128线激光雷达、六个摄像头和六个4D成像雷达的车辆,在各种场景下采集数据。2) 数据同步:对来自不同传感器的数据进行同步,以确保数据的一致性。3) 数据标注:人工标注3D边界框和语义分割信息,并使用自动化流程生成密集的占用真值。4) 基准建立:建立3D检测和语义占用预测的评估指标和基线模型。

关键创新:论文的关键创新点包括:1) 构建了一个大规模、多模态的自动驾驶数据集,该数据集包含来自多种传感器的同步数据。2) 提出了一种新颖的4D标注流程,用于生成精确的3D边界框和语义分割标注。3) 引入了一种自动化流程,用于生成密集的占用真值,该流程有效地利用了来自非关键帧的信息。4) 探索了低成本传感器配置在自动驾驶应用中的潜力。

关键设计:在数据标注方面,论文采用了人工标注和自动化流程相结合的方法,以提高标注的效率和准确性。在自动化流程中,论文设计了一种基于多传感器融合的算法,用于生成密集的占用真值。此外,论文还针对不同的传感器数据,设计了特定的预处理和特征提取方法,以提高算法的性能。具体的参数设置、损失函数和网络结构等技术细节在论文中没有详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

论文通过实验证明了OmniHD-Scenes数据集的有效性。实验结果表明,基于该数据集训练的自动驾驶算法在3D目标检测和语义占用预测等任务上取得了良好的性能。此外,实验还表明,低成本传感器配置在恶劣条件下表现出良好的鲁棒性,为自动驾驶应用的经济高效解决方案提供了可能性。具体的性能数据和提升幅度在论文中没有详细描述,属于未知信息。

🎯 应用场景

OmniHD-Scenes数据集可广泛应用于自动驾驶算法的开发、测试和评估。该数据集支持3D目标检测、语义分割、占用预测等多种任务,并可用于研究低成本传感器配置和恶劣条件下的鲁棒性。此外,该数据集还可用于训练和评估基于深度学习的自动驾驶模型,并促进自动驾驶技术的进步。

📄 摘要(原文)

The rapid advancement of deep learning has intensified the need for comprehensive data for use by autonomous driving algorithms. High-quality datasets are crucial for the development of effective data-driven autonomous driving solutions. Next-generation autonomous driving datasets must be multimodal, incorporating data from advanced sensors that feature extensive data coverage, detailed annotations, and diverse scene representation. To address this need, we present OmniHD-Scenes, a large-scale multimodal dataset that provides comprehensive omnidirectional high-definition data. The OmniHD-Scenes dataset combines data from 128-beam LiDAR, six cameras, and six 4D imaging radar systems to achieve full environmental perception. The dataset comprises 1501 clips, each approximately 30-s long, totaling more than 450K synchronized frames and more than 5.85 million synchronized sensor data points. We also propose a novel 4D annotation pipeline. To date, we have annotated 200 clips with more than 514K precise 3D bounding boxes. These clips also include semantic segmentation annotations for static scene elements. Additionally, we introduce a novel automated pipeline for generation of the dense occupancy ground truth, which effectively leverages information from non-key frames. Alongside the proposed dataset, we establish comprehensive evaluation metrics, baseline models, and benchmarks for 3D detection and semantic occupancy prediction. These benchmarks utilize surround-view cameras and 4D imaging radar to explore cost-effective sensor solutions for autonomous driving applications. Extensive experiments demonstrate the effectiveness of our low-cost sensor configuration and its robustness under adverse conditions. Data will be released at https://www.2077ai.com/OmniHD-Scenes.