BrushEdit: All-In-One Image Inpainting and Editing

作者: Yaowei Li, Yuxuan Bian, Xuan Ju, Zhaoyang Zhang, Junhao Zhuang, Ying Shan, Yuexian Zou, Qiang Xu

分类: cs.CV, cs.AI

发布日期: 2024-12-13 (更新: 2025-05-05)

备注: WebPage available at https://liyaowei-stu.github.io/project/BrushEdit/

💡 一句话要点

提出BrushEdit,一种基于图像修复的交互式指令图像编辑框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图像编辑 图像修复 多模态大语言模型 指令引导 交互式编辑

📋 核心要点

- 现有基于反演的图像编辑方法难以进行大幅修改,而基于指令的方法缺乏用户交互性。

- BrushEdit利用多模态大语言模型和图像修复模型,实现自由形式指令引导的图像编辑。

- 实验表明,BrushEdit在多个指标上表现出色,有效结合了大语言模型和图像修复模型。

📝 摘要(中文)

图像编辑随着扩散模型的发展取得了显著进展,包括基于反演和基于指令的方法。然而,由于反演噪声的结构化特性,现有的基于反演的方法难以处理大的修改(例如,添加或删除对象),这阻碍了实质性的改变。同时,基于指令的方法通常将用户限制在黑盒操作中,限制了用户直接交互以指定编辑区域和强度。为了解决这些限制,我们提出BrushEdit,一种新颖的基于图像修复的指令引导图像编辑范例,它利用多模态大型语言模型(MLLM)和图像修复模型来实现自主、用户友好和交互式的自由形式指令编辑。具体来说,我们设计了一个系统,通过在代理协作框架中集成MLLM和双分支图像修复模型来实现自由形式的指令编辑,以执行编辑类别分类、主要对象识别、掩码获取和编辑区域修复。大量的实验表明,我们的框架有效地结合了MLLM和修复模型,在包括掩码区域保留和编辑效果一致性在内的七个指标上实现了卓越的性能。

🔬 方法详解

问题定义:现有图像编辑方法存在两个主要痛点。一是基于反演的方法难以处理大幅度的图像修改,例如添加或删除物体,因为反演噪声具有结构性,限制了图像的改变程度。二是基于指令的方法通常是黑盒操作,用户无法直接指定编辑区域和编辑强度,交互性较差。

核心思路:BrushEdit的核心思路是将图像编辑问题转化为图像修复问题,并利用多模态大语言模型(MLLM)来理解用户的自由形式指令,从而引导图像修复模型进行编辑。通过这种方式,既可以实现大幅度的图像修改,又可以提供用户友好的交互方式。

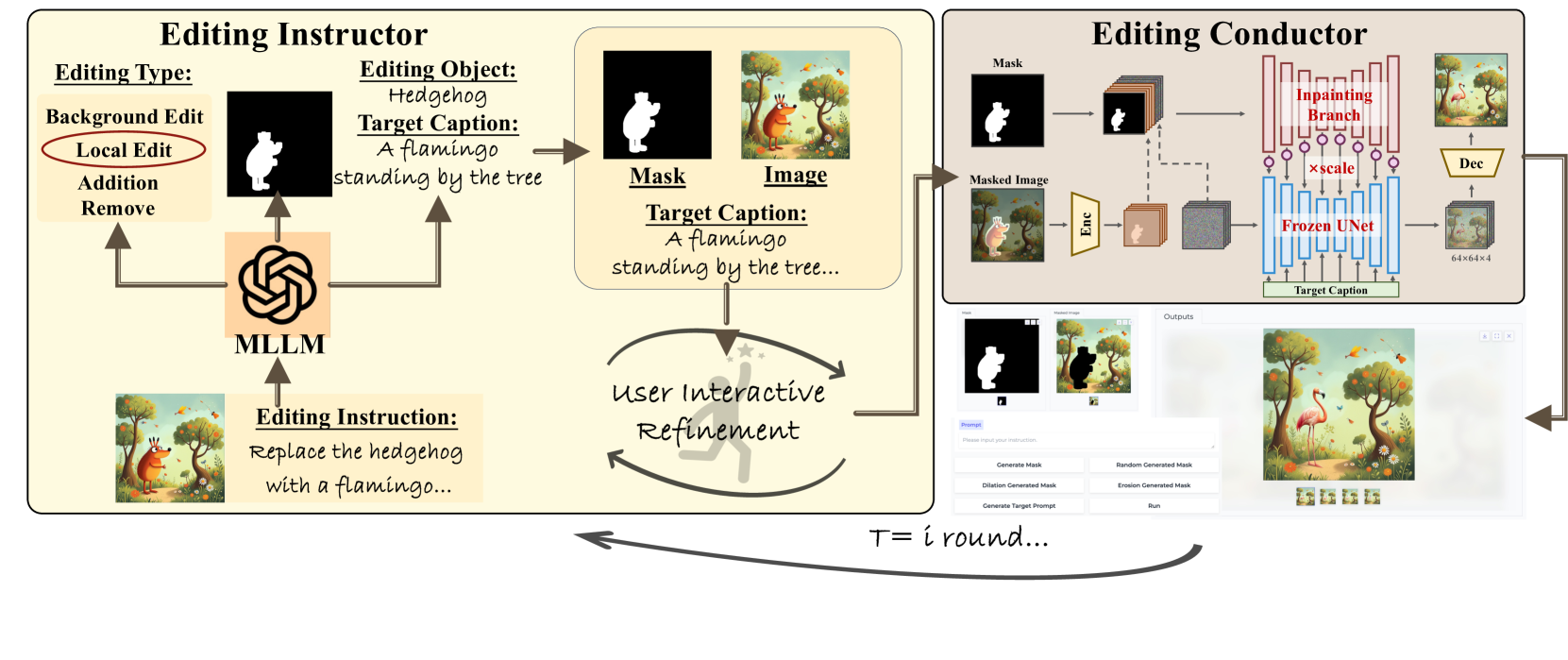

技术框架:BrushEdit的整体框架是一个代理协作系统,包含以下几个主要模块:1) MLLM:负责理解用户指令,并进行编辑类别分类和主要对象识别。2) Mask Acquisition:根据MLLM的输出,自动获取需要编辑的区域的掩码。3) Dual-Branch Image Inpainting Model:一个双分支的图像修复模型,负责根据用户指令和掩码,对编辑区域进行修复。整个流程是:用户输入指令 -> MLLM分析指令 -> 生成编辑区域掩码 -> 图像修复模型根据掩码和指令进行图像修复。

关键创新:BrushEdit的关键创新在于将图像编辑问题转化为图像修复问题,并利用MLLM来理解和引导图像修复过程。这种方法有效地结合了MLLM的理解能力和图像修复模型的生成能力,实现了更灵活和用户友好的图像编辑。与现有方法相比,BrushEdit允许用户进行自由形式的指令编辑,并能够处理大幅度的图像修改。

关键设计:BrushEdit的关键设计包括:1) 使用MLLM进行编辑类别分类和主要对象识别,从而更好地理解用户意图。2) 设计了自动掩码获取模块,减少了用户手动指定编辑区域的负担。3) 使用双分支图像修复模型,可以更好地处理复杂的图像编辑任务。论文中没有明确说明具体的参数设置、损失函数和网络结构等细节,这些可能是基于现有模型的改进或微调,具体细节未知。

🖼️ 关键图片

📊 实验亮点

BrushEdit在七个指标上取得了优异的性能,包括掩码区域保留和编辑效果一致性。这些结果表明,BrushEdit能够有效地结合MLLM和图像修复模型,实现高质量的图像编辑。具体的性能数据和对比基线在摘要中没有给出,详细的实验结果未知。

🎯 应用场景

BrushEdit具有广泛的应用前景,包括照片编辑、艺术创作、虚拟现实、游戏开发等领域。它可以帮助用户轻松地修改图像内容,实现个性化的视觉效果。例如,用户可以使用BrushEdit快速地移除照片中的不需要的物体,或者将照片中的物体替换成其他物体。该研究的未来影响在于推动图像编辑技术的发展,使其更加智能化和用户友好。

📄 摘要(原文)

Image editing has advanced significantly with the development of diffusion models using both inversion-based and instruction-based methods. However, current inversion-based approaches struggle with big modifications (e.g., adding or removing objects) due to the structured nature of inversion noise, which hinders substantial changes. Meanwhile, instruction-based methods often constrain users to black-box operations, limiting direct interaction for specifying editing regions and intensity. To address these limitations, we propose BrushEdit, a novel inpainting-based instruction-guided image editing paradigm, which leverages multimodal large language models (MLLMs) and image inpainting models to enable autonomous, user-friendly, and interactive free-form instruction editing. Specifically, we devise a system enabling free-form instruction editing by integrating MLLMs and a dual-branch image inpainting model in an agent-cooperative framework to perform editing category classification, main object identification, mask acquisition, and editing area inpainting. Extensive experiments show that our framework effectively combines MLLMs and inpainting models, achieving superior performance across seven metrics including mask region preservation and editing effect coherence.