SplineGS: Robust Motion-Adaptive Spline for Real-Time Dynamic 3D Gaussians from Monocular Video

作者: Jongmin Park, Minh-Quan Viet Bui, Juan Luis Gonzalez Bello, Jaeho Moon, Jihyong Oh, Munchurl Kim

分类: cs.CV

发布日期: 2024-12-13 (更新: 2024-12-18)

备注: The first two authors contributed equally to this work (equal contribution). The last two authors advised equally to this work. Please visit our project page at this https://kaist-viclab.github.io/splinegs-site/

💡 一句话要点

提出SplineGS,通过运动自适应样条曲线实现单目视频实时动态3D高斯重建。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting)

关键词: 动态场景重建 3D高斯溅射 单目视频 运动自适应样条 新视角合成

📋 核心要点

- 现有方法难以从单目视频中重建动态场景,缺乏多视角信息且易受场景动态变化的影响。

- SplineGS提出运动自适应样条曲线,用少量控制点表示动态3D高斯轨迹,并进行控制点剪枝以适应不同运动。

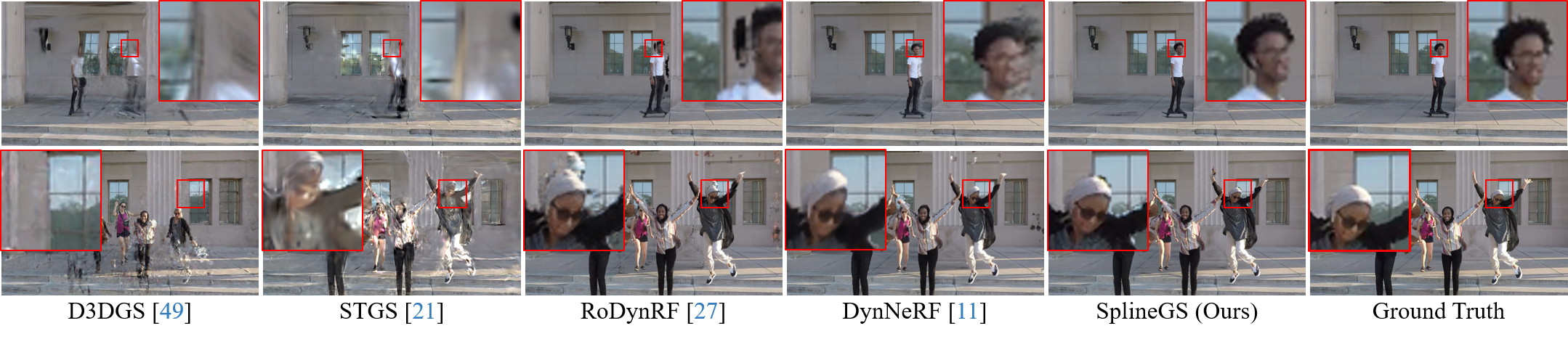

- 实验表明,SplineGS在动态场景新视角合成方面显著优于现有技术,渲染速度提升数千倍。

📝 摘要(中文)

本文提出SplineGS,一个无需COLMAP的动态3D高斯溅射(3DGS)框架,用于从单目视频中进行高质量重建和快速渲染。核心是一种新颖的运动自适应样条(MAS)方法,它使用具有少量控制点的三次Hermite样条来表示连续的动态3D高斯轨迹。对于MAS,我们引入了一种运动自适应控制点剪枝(MACP)方法,用于对每个动态3D高斯在不同运动下的变形进行建模,逐步剪枝控制点,同时保持动态建模的完整性。此外,我们提出了一种相机参数估计和3D高斯属性的联合优化策略,利用光度和几何一致性。这消除了对运动结构重建预处理的需求,并增强了SplineGS在真实世界条件下的鲁棒性。实验表明,SplineGS在单目视频动态场景的新视角合成质量方面显著优于最先进的方法,实现了数千倍的渲染速度提升。

🔬 方法详解

问题定义:现有方法在单目视频的动态场景重建中面临挑战,主要痛点在于缺乏多视角信息,难以准确建模场景的动态变化,且通常依赖于耗时的Structure-from-Motion (SfM)预处理,限制了实时性。

核心思路:SplineGS的核心在于使用运动自适应样条曲线(Motion-Adaptive Spline, MAS)来表示动态3D高斯轨迹。通过少量控制点定义的三次Hermite样条,可以有效地捕捉高斯分布随时间的连续变化。此外,引入运动自适应控制点剪枝(Motion-Adaptive Control points Pruning, MACP)方法,根据运动幅度自适应地减少控制点数量,从而提高效率并保持建模精度。

技术框架:SplineGS框架主要包含以下几个阶段:1) 初始化:无需COLMAP等SfM预处理,直接从单目视频帧初始化3D高斯分布。2) 运动自适应样条建模:利用MAS方法,为每个3D高斯构建基于三次Hermite样条的动态轨迹。3) 运动自适应控制点剪枝:使用MACP方法,根据运动幅度动态调整控制点数量。4) 联合优化:同时优化相机参数和3D高斯属性,利用光度和几何一致性约束,提高重建质量。

关键创新:SplineGS的关键创新在于运动自适应样条曲线(MAS)和运动自适应控制点剪枝(MACP)。MAS能够以紧凑的方式表示动态3D高斯轨迹,而MACP则进一步提高了效率,并能更好地适应不同运动模式。与现有方法相比,SplineGS无需SfM预处理,更加鲁棒,且渲染速度更快。

关键设计:MAS使用三次Hermite样条,控制点数量根据运动幅度自适应调整。MACP通过评估控制点对整体轨迹的影响来决定是否剪枝。损失函数包含光度损失和几何一致性损失,用于联合优化相机参数和3D高斯属性。具体参数设置(如控制点数量、剪枝阈值、损失权重)未知,需要在实验中进行调整。

🖼️ 关键图片

📊 实验亮点

SplineGS在动态场景新视角合成方面取得了显著的性能提升。实验结果表明,SplineGS在渲染速度上比现有方法快数千倍,同时保持了高质量的重建效果。具体性能数据未知,但摘要强调了其优于现有技术的表现。

🎯 应用场景

SplineGS在虚拟现实、增强现实、机器人导航、自动驾驶等领域具有广泛的应用前景。它可以用于创建逼真的动态3D场景,提升用户体验,并为机器人提供更准确的环境感知能力。此外,该技术还可以应用于视频编辑、特效制作等领域,提高内容创作的效率和质量。

📄 摘要(原文)

Synthesizing novel views from in-the-wild monocular videos is challenging due to scene dynamics and the lack of multi-view cues. To address this, we propose SplineGS, a COLMAP-free dynamic 3D Gaussian Splatting (3DGS) framework for high-quality reconstruction and fast rendering from monocular videos. At its core is a novel Motion-Adaptive Spline (MAS) method, which represents continuous dynamic 3D Gaussian trajectories using cubic Hermite splines with a small number of control points. For MAS, we introduce a Motion-Adaptive Control points Pruning (MACP) method to model the deformation of each dynamic 3D Gaussian across varying motions, progressively pruning control points while maintaining dynamic modeling integrity. Additionally, we present a joint optimization strategy for camera parameter estimation and 3D Gaussian attributes, leveraging photometric and geometric consistency. This eliminates the need for Structure-from-Motion preprocessing and enhances SplineGS's robustness in real-world conditions. Experiments show that SplineGS significantly outperforms state-of-the-art methods in novel view synthesis quality for dynamic scenes from monocular videos, achieving thousands times faster rendering speed.