All-in-One: Transferring Vision Foundation Models into Stereo Matching

作者: Jingyi Zhou, Haoyu Zhang, Jiakang Yuan, Peng Ye, Tao Chen, Hao Jiang, Meiya Chen, Yangyang Zhang

分类: cs.CV

发布日期: 2024-12-13

备注: Accepted by AAAI 2025

💡 一句话要点

AIO-Stereo:将视觉基础模型迁移至立体匹配,实现性能突破

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 立体匹配 视觉基础模型 知识迁移 特征对齐 深度估计

📋 核心要点

- 现有立体匹配方法在特征提取能力上仍有提升空间,无法充分利用视觉基础模型(VFMs)的强大表征能力。

- AIO-Stereo通过双层特征利用机制对齐异构特征,并设计双层选择性知识迁移模块,有效整合多个VFMs的优势。

- 实验结果表明,AIO-Stereo在Middlebury和ETH3D等数据集上取得了领先的性能,显著提升了立体匹配的精度。

📝 摘要(中文)

本文提出了一种名为AIO-Stereo的新型立体匹配方法,该方法能够灵活地选择和迁移来自多个异构视觉基础模型(VFMs)的知识到一个单一的立体匹配模型中。为了更好地协调异构VFMs和立体匹配模型之间的特征,并充分利用VFMs的先验知识,本文提出了一种双层特征利用机制,该机制对齐异构特征并迁移多层知识。基于该机制,设计了一个双层选择性知识迁移模块,用于选择性地迁移知识并整合多个VFMs的优势。实验结果表明,AIO-Stereo在多个数据集上取得了最先进的性能,并在Middlebury数据集上排名第一,并在ETH3D基准测试中优于所有已发表的工作。

🔬 方法详解

问题定义:立体匹配是计算机视觉中的一项基本任务,旨在从一对或多对立体图像中恢复场景的深度信息。现有的基于迭代优化的立体匹配方法虽然取得了显著进展,但其特征提取能力仍有提升空间,无法充分利用视觉基础模型(VFMs)所蕴含的丰富先验知识。

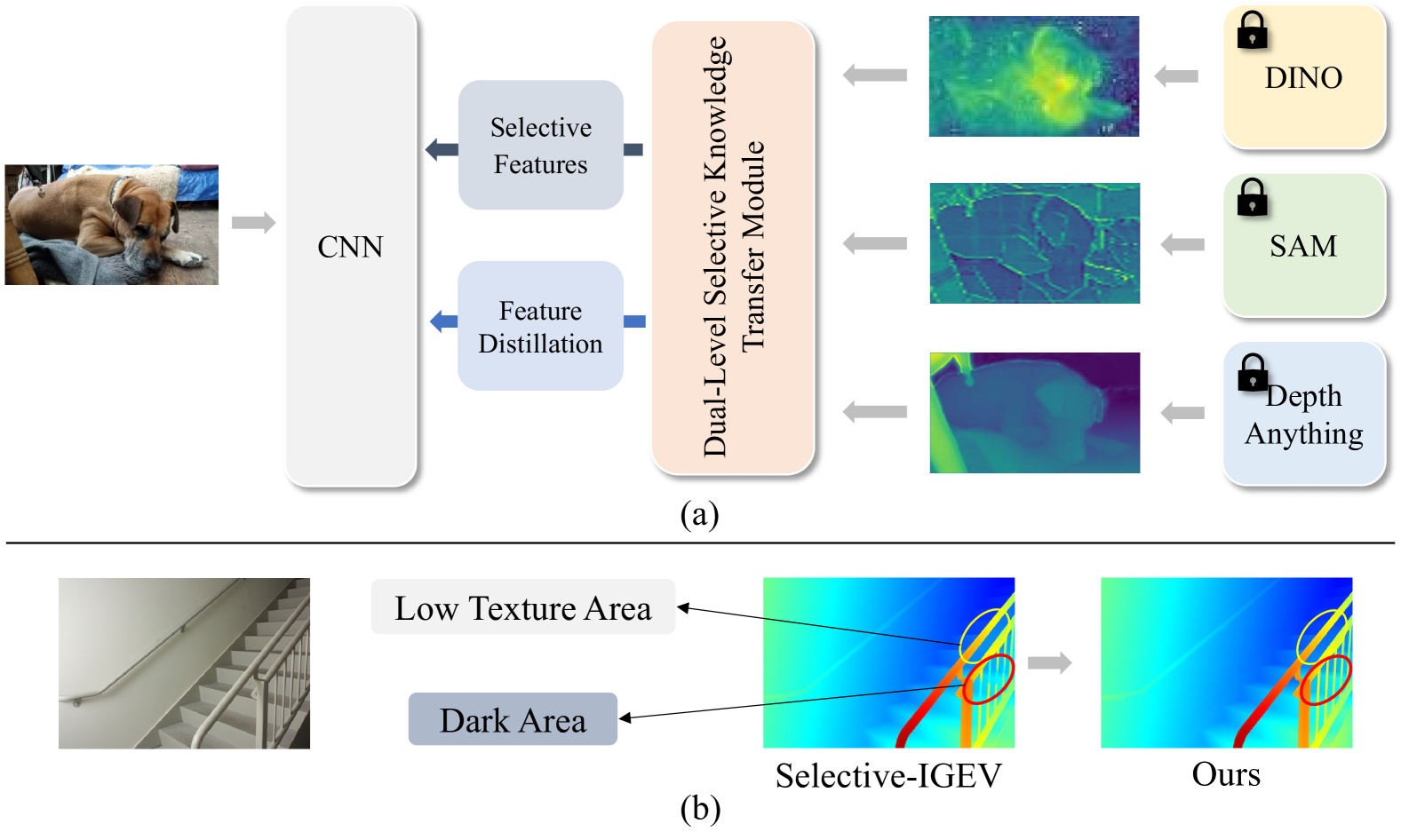

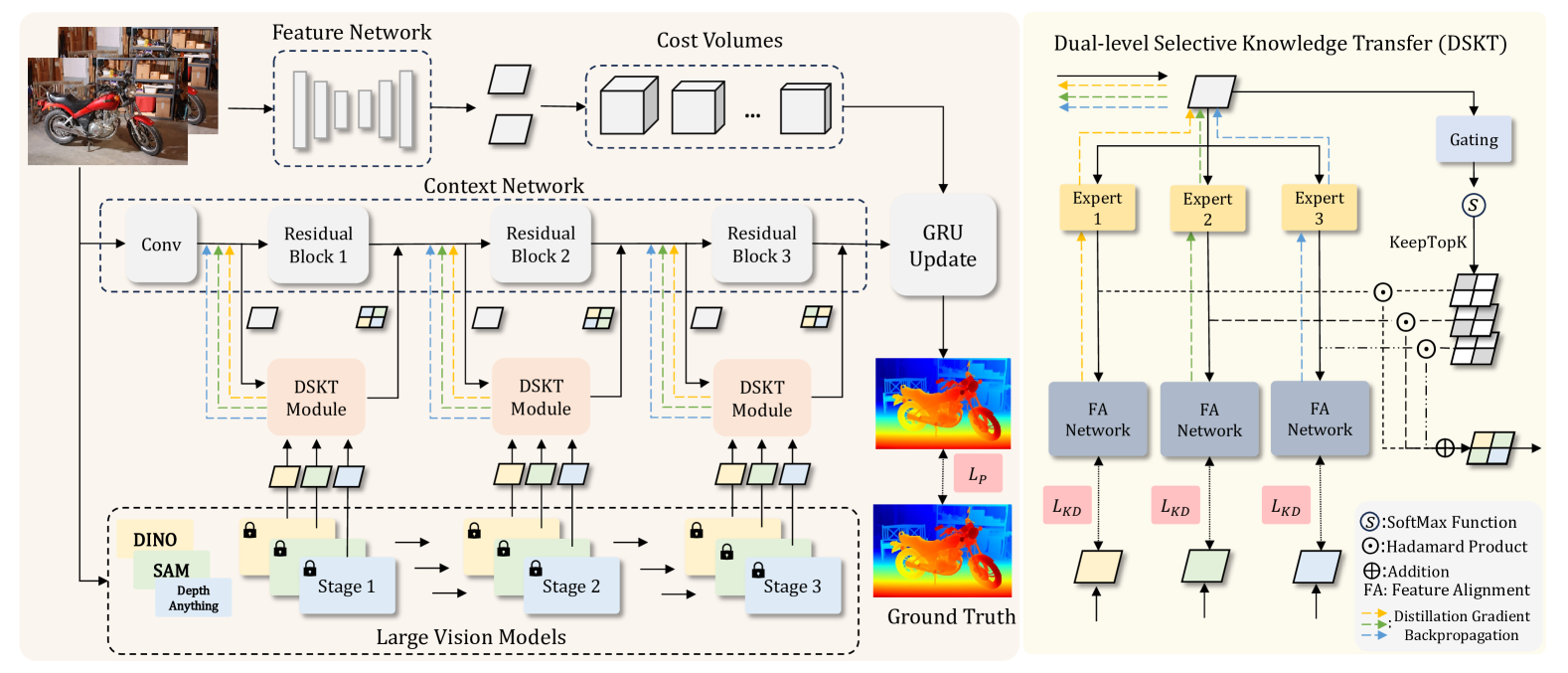

核心思路:AIO-Stereo的核心思路是将预训练的视觉基础模型(VFMs)的知识迁移到立体匹配模型中,从而增强特征提取能力。通过设计双层特征利用机制和双层选择性知识迁移模块,实现异构VFMs特征的对齐和多层知识的有效迁移,最终提升立体匹配的精度和鲁棒性。

技术框架:AIO-Stereo的整体框架包含以下几个主要模块:1) 异构视觉基础模型(VFMs):用于提取多尺度的图像特征。2) 双层特征利用机制:包括特征对齐和多层知识迁移两个部分,用于协调VFMs和立体匹配模型之间的特征差异。3) 双层选择性知识迁移模块:用于选择性地迁移VFMs的知识,并整合多个VFMs的优势。4) 立体匹配网络:基于迁移的特征进行代价体构建、代价聚合和视差估计。

关键创新:AIO-Stereo的关键创新在于双层特征利用机制和双层选择性知识迁移模块。双层特征利用机制能够有效地对齐异构VFMs的特征,并充分利用VFMs的多层知识。双层选择性知识迁移模块能够根据不同VFMs的特点,选择性地迁移知识,从而避免负迁移,并整合多个VFMs的优势。

关键设计:双层特征利用机制包括特征对齐和多层知识迁移两个部分。特征对齐通过可学习的线性变换将不同VFMs的特征映射到统一的特征空间。多层知识迁移则利用VFMs不同层的特征,从而获得更丰富的上下文信息。双层选择性知识迁移模块采用注意力机制,根据不同VFMs的特征重要性,自适应地调整知识迁移的权重。损失函数包括视差回归损失和正则化损失,用于优化立体匹配网络的参数。

🖼️ 关键图片

📊 实验亮点

AIO-Stereo在Middlebury数据集上排名第一,并在ETH3D基准测试中优于所有已发表的工作,充分证明了其优越的性能。相较于之前的SOTA方法,AIO-Stereo在多个数据集上均取得了显著的精度提升,尤其是在具有挑战性的场景中,表现出更强的鲁棒性。这表明AIO-Stereo能够有效地利用视觉基础模型的知识,提升立体匹配的性能。

🎯 应用场景

AIO-Stereo在自动驾驶、机器人导航、三维重建、虚拟现实等领域具有广泛的应用前景。高精度的立体匹配结果可以为这些应用提供可靠的深度信息,从而提升系统的性能和鲁棒性。例如,在自动驾驶中,AIO-Stereo可以用于感知周围环境,识别障碍物,并规划安全行驶路径。在机器人导航中,AIO-Stereo可以用于构建地图,实现自主导航。

📄 摘要(原文)

As a fundamental vision task, stereo matching has made remarkable progress. While recent iterative optimization-based methods have achieved promising performance, their feature extraction capabilities still have room for improvement. Inspired by the ability of vision foundation models (VFMs) to extract general representations, in this work, we propose AIO-Stereo which can flexibly select and transfer knowledge from multiple heterogeneous VFMs to a single stereo matching model. To better reconcile features between heterogeneous VFMs and the stereo matching model and fully exploit prior knowledge from VFMs, we proposed a dual-level feature utilization mechanism that aligns heterogeneous features and transfers multi-level knowledge. Based on the mechanism, a dual-level selective knowledge transfer module is designed to selectively transfer knowledge and integrate the advantages of multiple VFMs. Experimental results show that AIO-Stereo achieves start-of-the-art performance on multiple datasets and ranks $1^{st}$ on the Middlebury dataset and outperforms all the published work on the ETH3D benchmark.