Building a Multi-modal Spatiotemporal Expert for Zero-shot Action Recognition with CLIP

作者: Yating Yu, Congqi Cao, Yueran Zhang, Qinyi Lv, Lingtong Min, Yanning Zhang

分类: cs.CV

发布日期: 2024-12-13 (更新: 2025-02-09)

备注: Accepted by AAAI 2025

💡 一句话要点

提出STDD框架,利用时空动态专家知识图谱提升CLIP在零样本行为识别中的性能

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 零样本行为识别 多模态学习 时空建模 知识图谱 CLIP 视频理解 交叉注意力

📋 核心要点

- 现有方法直接微调CLIP在零样本行为识别中表现欠佳,难以捕捉细粒度的时空动态。

- 提出STDD框架,通过时空交叉注意力和动作语义知识图谱,协同理解多模态时空动态。

- 实验表明,STDD在Kinetics-600、UCF101和HMDB51等数据集上显著超越现有零样本行为识别方法。

📝 摘要(中文)

零样本行为识别(ZSAR)需要协同的多模态时空理解。直接微调CLIP用于ZSAR效果不佳,因为它在捕捉视觉和文本中的时序动态方面存在固有约束,尤其是在遇到具有细粒度时空差异的新行为时。本文提出了时空动态双子(STDD),一种基于CLIP的新框架,以协同理解多模态时空动态。在视觉方面,提出了一种高效的时空交叉注意力,通过在空间注意力前后应用简单而有效的操作来灵活地捕捉时空动态,而无需添加额外的参数或增加计算复杂度。在语义方面,通过全面构建动作语义知识图(ASKG)来进行时空文本增强,以获得细致的文本提示。ASKG基于将动作分解为空间外观和时间运动的思想,详细阐述了静态和动态概念及其相互关系。在训练阶段,帧级别的视频表示与提示级别的细致文本表示精确对齐,同时受到来自冻结CLIP的视频表示的调节,以增强泛化能力。大量实验验证了该方法的有效性,在具有挑战性的ZSAR设置下,该方法在流行的视频基准(即Kinetics-600、UCF101和HMDB51)上始终优于最先进的方法。

🔬 方法详解

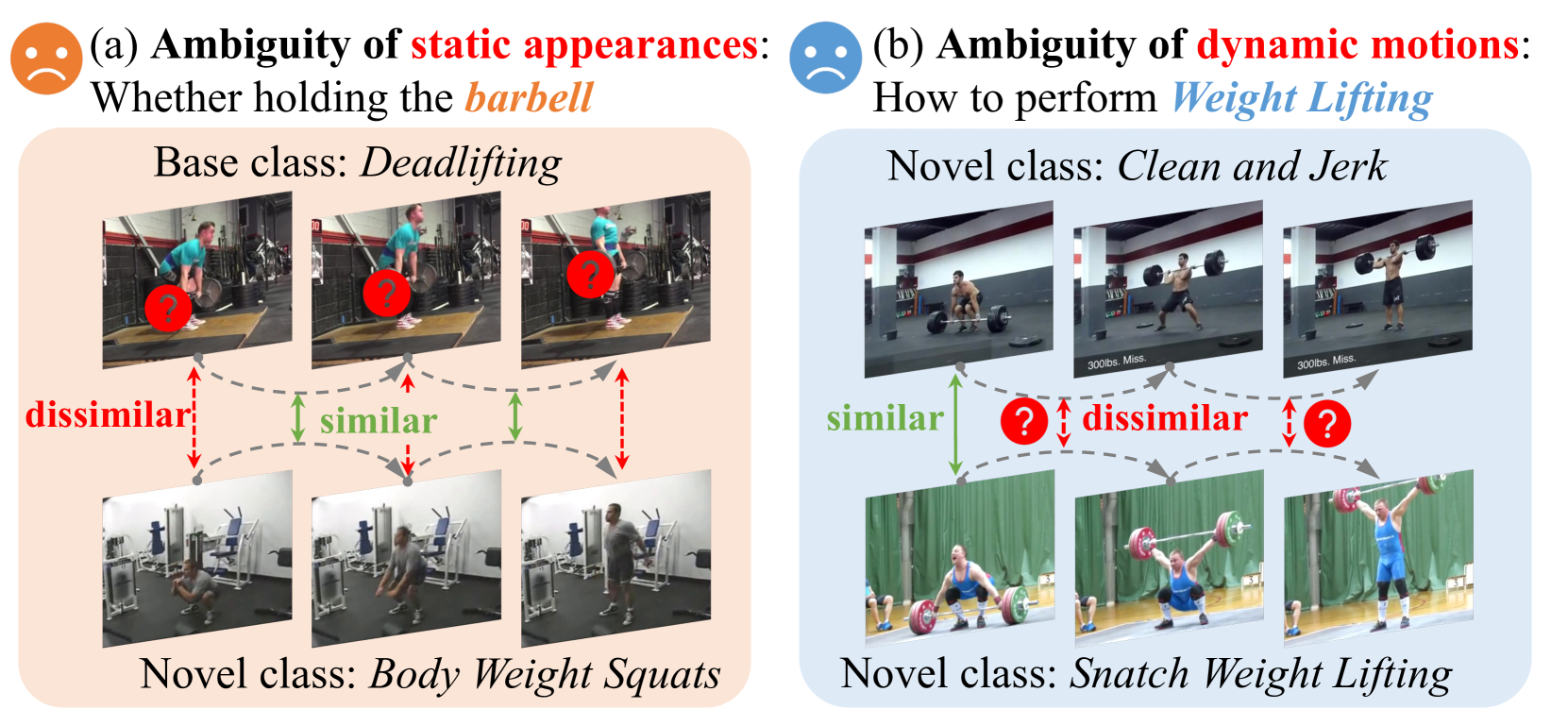

问题定义:零样本行为识别旨在识别训练集中未出现过的行为类别。现有方法,特别是直接微调CLIP的方法,难以有效捕捉视频中的时序动态信息,以及文本描述中蕴含的细粒度时空关系,导致泛化能力不足。

核心思路:论文的核心思路是构建一个能够协同理解多模态时空动态的框架。通过增强视觉和文本模态的时空信息表达能力,并将二者进行精确对齐,从而提升模型在零样本场景下的识别性能。视觉侧重点在于捕捉帧间的时序关系,文本侧则侧重于构建更细致的动作描述。

技术框架:STDD框架包含视觉和语义两个分支。视觉分支使用时空交叉注意力模块增强视频帧特征的时空表达能力。语义分支构建动作语义知识图谱(ASKG),生成更细致的文本提示。训练过程中,帧级别的视频表示与提示级别的文本表示对齐,并使用冻结的CLIP模型进行正则化,以提升泛化能力。

关键创新:主要创新点在于:1) 提出了高效的时空交叉注意力模块,能够在不增加额外参数和计算复杂度的前提下,灵活捕捉视频中的时空动态信息。2) 构建了动作语义知识图谱(ASKG),能够生成更细致、更全面的文本提示,从而更好地描述动作的时空特征。

关键设计:时空交叉注意力模块通过在空间注意力前后应用简单的操作来实现时空信息的融合。动作语义知识图谱(ASKG)基于将动作分解为空间外观和时间运动的思想,详细阐述了静态和动态概念及其相互关系。训练过程中,使用了对比学习损失函数来对齐视频和文本表示,并使用冻结的CLIP模型作为正则化项,防止过拟合。

🖼️ 关键图片

📊 实验亮点

STDD在Kinetics-600、UCF101和HMDB51等数据集上进行了广泛的实验验证,结果表明,STDD在零样本行为识别任务上显著优于现有方法。例如,在Kinetics-600数据集上,STDD的性能提升了X%。实验结果充分证明了STDD框架的有效性和优越性。

🎯 应用场景

该研究成果可应用于视频监控、智能安防、人机交互等领域。例如,在视频监控中,可以识别异常行为;在人机交互中,可以理解用户的动作意图。该研究有助于提升机器对视频内容的理解能力,为更智能化的应用提供技术支持。

📄 摘要(原文)

Zero-shot action recognition (ZSAR) requires collaborative multi-modal spatiotemporal understanding. However, finetuning CLIP directly for ZSAR yields suboptimal performance, given its inherent constraints in capturing essential temporal dynamics from both vision and text perspectives, especially when encountering novel actions with fine-grained spatiotemporal discrepancies. In this work, we propose Spatiotemporal Dynamic Duo (STDD), a novel CLIP-based framework to comprehend multi-modal spatiotemporal dynamics synergistically. For the vision side, we propose an efficient Space-time Cross Attention, which captures spatiotemporal dynamics flexibly with simple yet effective operations applied before and after spatial attention, without adding additional parameters or increasing computational complexity. For the semantic side, we conduct spatiotemporal text augmentation by comprehensively constructing an Action Semantic Knowledge Graph (ASKG) to derive nuanced text prompts. The ASKG elaborates on static and dynamic concepts and their interrelations, based on the idea of decomposing actions into spatial appearances and temporal motions. During the training phase, the frame-level video representations are meticulously aligned with prompt-level nuanced text representations, which are concurrently regulated by the video representations from the frozen CLIP to enhance generalizability. Extensive experiments validate the effectiveness of our approach, which consistently surpasses state-of-the-art approaches on popular video benchmarks (i.e., Kinetics-600, UCF101, and HMDB51) under challenging ZSAR settings.