VQTalker: Towards Multilingual Talking Avatars through Facial Motion Tokenization

作者: Tao Liu, Ziyang Ma, Qi Chen, Feilong Chen, Shuai Fan, Xie Chen, Kai Yu

分类: cs.CV

发布日期: 2024-12-13 (更新: 2024-12-18)

备注: 14 pages

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

VQTalker:通过面部运动 Token 化实现多语种口型生成

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 口型生成 多语种 矢量量化 面部动画 语音驱动

📋 核心要点

- 现有口型生成方法在跨语种泛化性方面存在不足,难以在有限数据下保证多语种场景下的唇形同步和自然运动。

- VQTalker 采用基于矢量量化的面部运动 Tokenizer,将面部运动离散化,从而捕捉面部运动的共性,提高跨语种泛化能力。

- 实验表明,VQTalker 在多语种口型生成任务上取得了 SOTA 性能,并能在低比特率下生成高质量的 512*512 像素视频。

📝 摘要(中文)

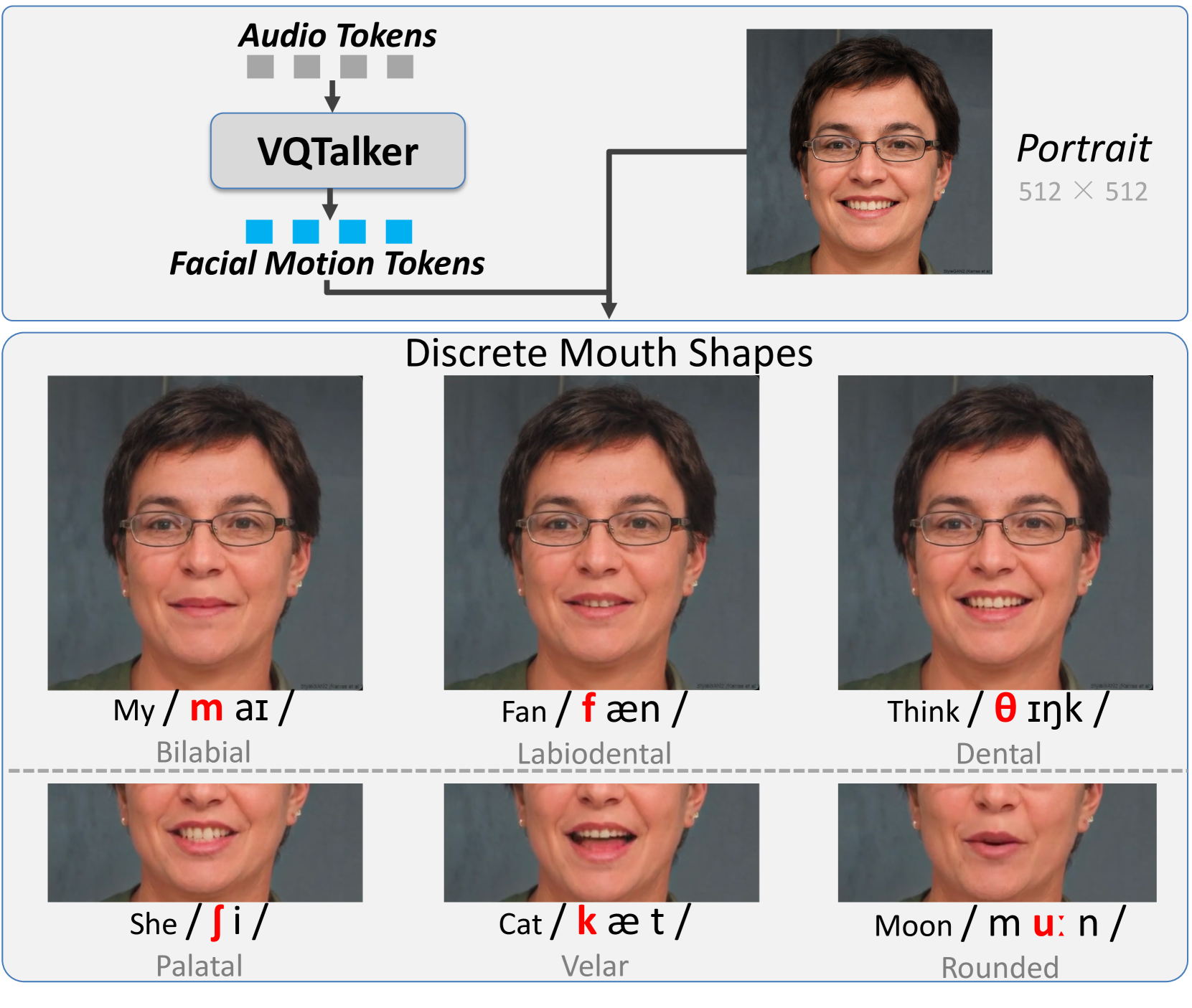

本文提出了一种基于矢量量化的多语种口型生成框架 VQTalker,旨在解决跨语言的唇形同步和自然运动问题。该方法基于语音学原理,即人类语音由有限的独特声音单元(音素)和相应的视觉发音(口型)组成,这些单元在不同语言中通常具有共性。我们引入了一种基于分组残差有限标量量化(GRFSQ)的面部运动 Tokenizer,它创建了面部特征的离散化表示。这种方法能够全面捕捉面部运动,同时提高对多种语言的泛化能力,即使在训练数据有限的情况下也是如此。在此量化表示的基础上,我们实现了一个由粗到精的运动生成过程,逐步细化面部动画。大量实验表明,VQTalker 在视频驱动和语音驱动的场景中均取得了最先进的性能,尤其是在多语种环境中。值得注意的是,我们的方法在保持约 11 kbps 的较低比特率的同时,实现了 512*512 像素的高质量结果。我们的工作为跨语言口型生成开辟了新的可能性。

🔬 方法详解

问题定义:论文旨在解决多语种口型生成问题,即如何生成与不同语言语音同步且自然的面部动画。现有方法在处理多语种时,由于不同语言的语音和面部运动模式差异较大,往往需要大量的特定语言数据进行训练,泛化能力较差,且难以保证唇形同步的准确性和面部运动的自然性。

核心思路:论文的核心思路是利用语音学原理,将面部运动视为一系列离散的视觉发音单元(口型)的组合,这些口型在不同语言中具有一定的共性。通过学习一个通用的面部运动 Tokenizer,将连续的面部运动转化为离散的 Token 序列,从而实现跨语种的知识迁移和泛化。

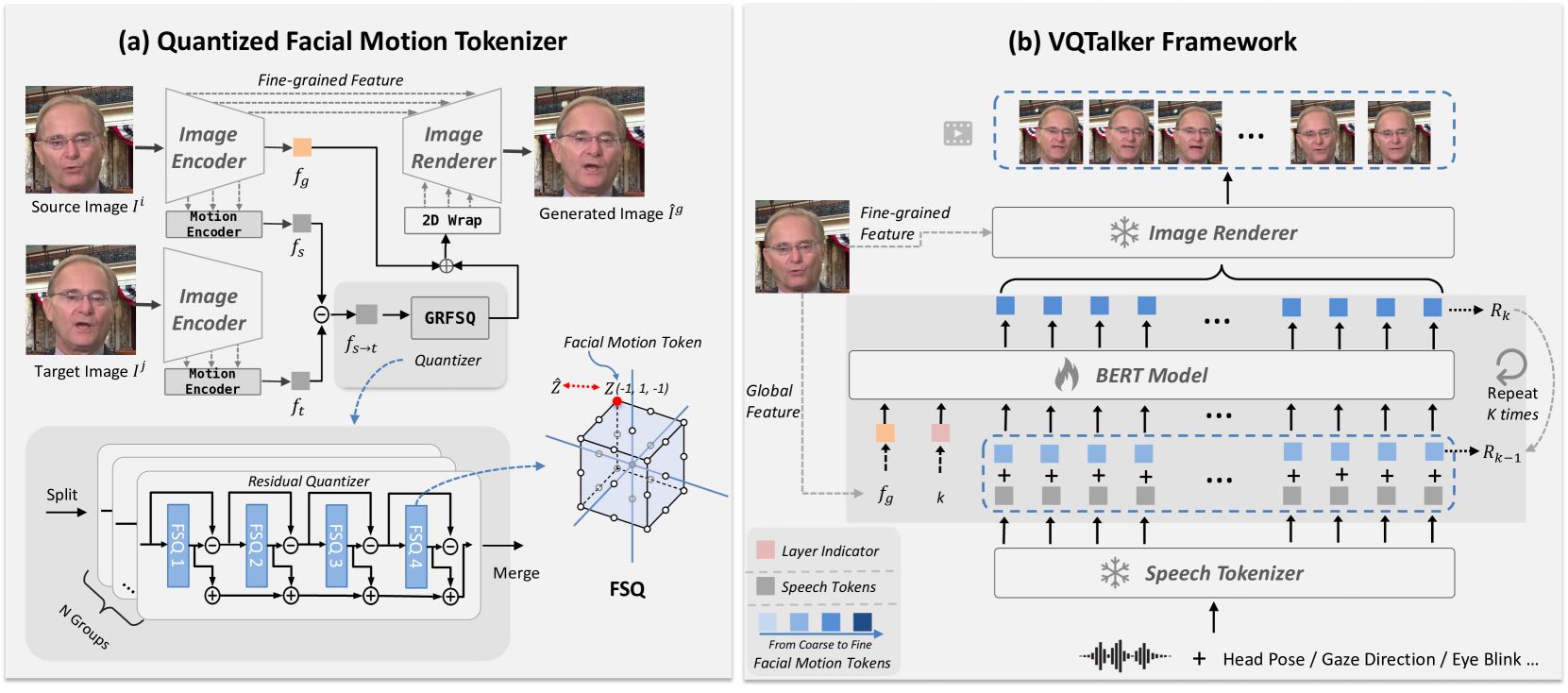

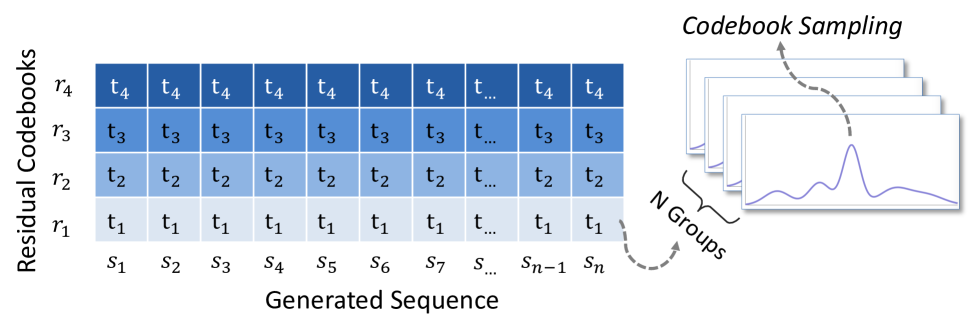

技术框架:VQTalker 的整体框架包含以下几个主要模块:1) 面部运动 Tokenizer:基于 GRFSQ 将面部运动特征进行量化,得到离散的 Token 序列。2) 运动生成器:根据输入的语音特征(如音素序列),生成对应的面部运动 Token 序列。3) 运动解码器:将生成的 Token 序列解码为连续的面部运动序列,最终驱动头像生成动画。整个过程采用由粗到精的生成方式,先生成粗略的面部运动,再逐步细化。

关键创新:论文最重要的创新点在于提出了基于分组残差有限标量量化(GRFSQ)的面部运动 Tokenizer。与传统的矢量量化方法相比,GRFSQ 能够更有效地捕捉面部运动的细微变化,并减少量化误差。此外,GRFSQ 具有更强的可扩展性,可以方便地增加码本大小,从而提高面部运动的表达能力。

关键设计:在面部运动 Tokenizer 中,论文采用了 GRFSQ 算法,并设置了合适的码本大小和残差量化层数。在运动生成器中,论文使用了 Transformer 网络,并采用了注意力机制来捕捉语音和面部运动之间的依赖关系。在损失函数方面,论文使用了 L1 损失和对抗损失,以保证生成面部运动的准确性和自然性。

🖼️ 关键图片

📊 实验亮点

VQTalker 在多语种口型生成任务上取得了显著的性能提升。实验结果表明,VQTalker 在视频驱动和语音驱动的场景中均优于现有的 SOTA 方法。尤其是在多语种环境下,VQTalker 能够生成更准确、更自然的口型动画。此外,VQTalker 在保持较低比特率(约 11 kbps)的同时,实现了 512*512 像素的高分辨率输出。

🎯 应用场景

VQTalker 在虚拟主播、在线教育、游戏角色动画、跨语言交流等领域具有广泛的应用前景。它可以用于生成逼真的多语种口型动画,提升用户体验和沟通效率。此外,该技术还可以应用于数字人制作,降低制作成本,提高制作效率。未来,VQTalker 有望成为构建智能化、个性化人机交互界面的关键技术。

📄 摘要(原文)

We present VQTalker, a Vector Quantization-based framework for multilingual talking head generation that addresses the challenges of lip synchronization and natural motion across diverse languages. Our approach is grounded in the phonetic principle that human speech comprises a finite set of distinct sound units (phonemes) and corresponding visual articulations (visemes), which often share commonalities across languages. We introduce a facial motion tokenizer based on Group Residual Finite Scalar Quantization (GRFSQ), which creates a discretized representation of facial features. This method enables comprehensive capture of facial movements while improving generalization to multiple languages, even with limited training data. Building on this quantized representation, we implement a coarse-to-fine motion generation process that progressively refines facial animations. Extensive experiments demonstrate that VQTalker achieves state-of-the-art performance in both video-driven and speech-driven scenarios, particularly in multilingual settings. Notably, our method achieves high-quality results at a resolution of 512*512 pixels while maintaining a lower bitrate of approximately 11 kbps. Our work opens new possibilities for cross-lingual talking face generation. Synthetic results can be viewed at https://x-lance.github.io/VQTalker.