PBR-NeRF: Inverse Rendering with Physics-Based Neural Fields

作者: Sean Wu, Shamik Basu, Tim Broedermann, Luc Van Gool, Christos Sakaridis

分类: cs.CV

发布日期: 2024-12-12 (更新: 2025-04-07)

备注: CVPR 2025. 16 pages, 7 figures. Code is publicly available at https://github.com/s3anwu/pbrnerf

🔗 代码/项目: GITHUB

💡 一句话要点

PBR-NeRF:利用物理渲染的神经场进行逆渲染,实现材质和光照的联合估计。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 神经辐射场 逆渲染 物理渲染 材质估计 光照估计

📋 核心要点

- 现有NeRF方法在3D重建中忽略了场景材质和光照建模,导致依赖视角的表观估计不准确。

- PBR-NeRF引入基于物理的先验知识,通过直观的损失项约束逆渲染过程,联合估计场景几何、材质和光照。

- 实验表明,PBR-NeRF在材质估计方面达到了最先进水平,同时保持了高质量的新视角合成效果。

📝 摘要(中文)

本文提出了一种名为PBR-NeRF的基于物理渲染(PBR)理论的神经辐射场(NeRF)方法,用于解决3D重建中不适定的逆渲染问题。该方法旨在解决大多数NeRF和3D高斯溅射方法的关键局限性:它们估计依赖于视角的表观,而不对场景材质和光照进行建模。为此,我们提出了一个逆渲染(IR)模型,能够联合估计场景几何、材质和光照。我们的模型建立在最近基于NeRF的IR方法之上,但关键在于引入了两个新的基于物理的先验,更好地约束了IR估计。这些先验被严格地公式化为直观的损失项,并在不影响新视角合成质量的前提下,实现了最先进的材质估计。我们的方法可以很容易地适应其他需要材质估计的逆渲染和3D重建框架。我们证明了扩展当前的神经渲染方法以充分建模场景属性(而不仅仅是几何和依赖于视角的表观)的重要性。

🔬 方法详解

问题定义:现有的NeRF和3D高斯溅射方法主要关注几何重建和新视角合成,忽略了场景的材质属性和光照条件。这导致模型只能学习到依赖于视角的表观,而无法真正理解场景的物理属性,限制了其在真实感渲染和编辑方面的应用。逆渲染的目标是从图像中恢复场景的几何、材质和光照,是一个病态问题,需要引入额外的约束。

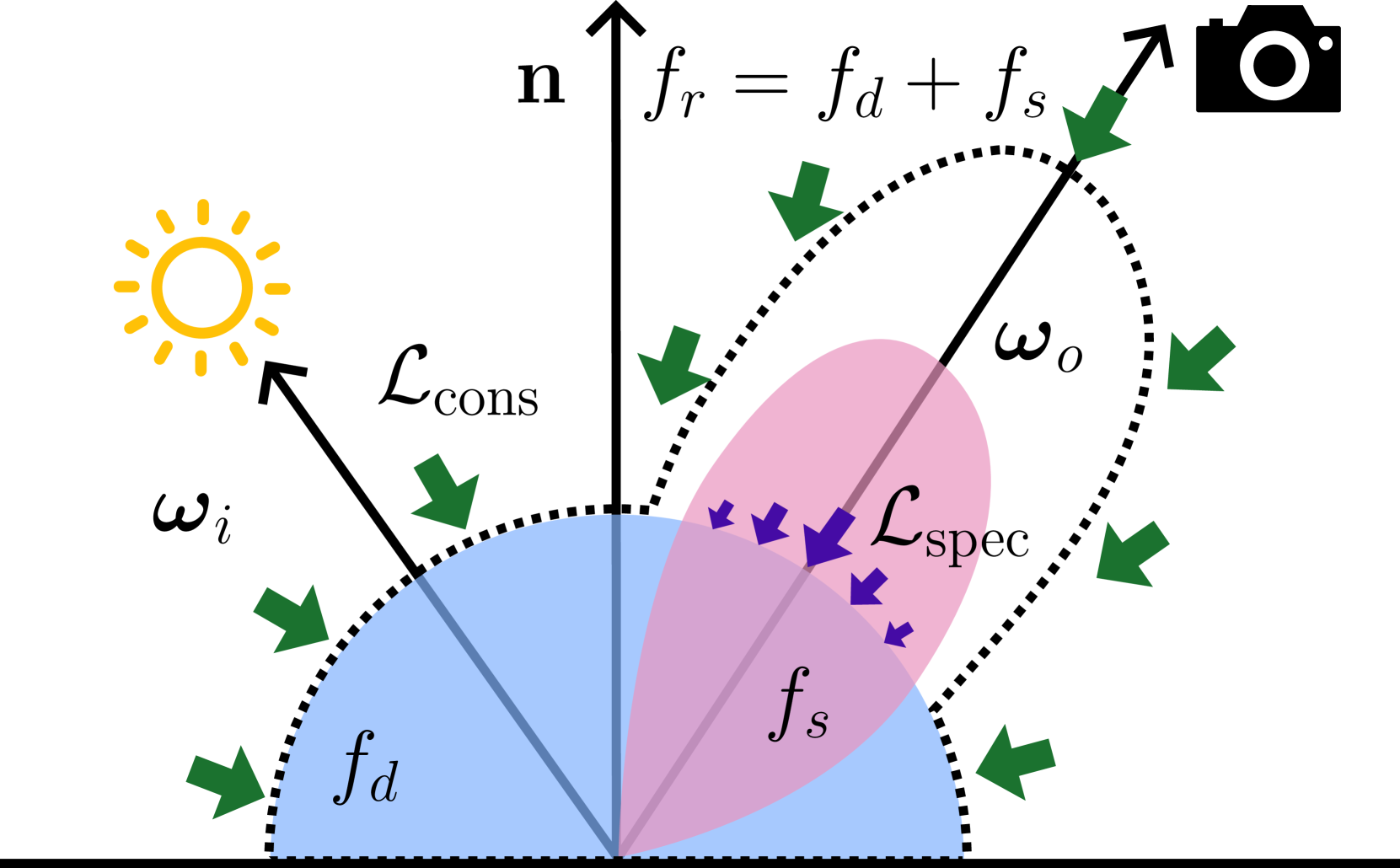

核心思路:PBR-NeRF的核心思路是将基于物理的渲染(PBR)理论融入到神经辐射场(NeRF)框架中,通过引入物理先验来约束逆渲染过程。具体来说,论文设计了两个新的基于物理的先验,并将其转化为损失函数,从而引导模型学习更准确的材质和光照参数。这种方法旨在克服传统NeRF方法中缺乏物理约束的问题,从而提高材质估计的准确性和新视角合成的真实感。

技术框架:PBR-NeRF建立在现有的NeRF框架之上,并对其进行了扩展以支持材质和光照的估计。整体流程包括:1)使用NeRF进行场景几何的重建;2)引入基于物理的渲染模型,将场景的材质属性(如反射率、粗糙度等)和光照条件参数化;3)设计损失函数,包括图像重建损失和基于物理的先验损失,用于优化NeRF的参数以及材质和光照参数。模型通过最小化这些损失函数来学习场景的几何、材质和光照。

关键创新:PBR-NeRF的关键创新在于引入了两个新的基于物理的先验,用于约束逆渲染过程。这些先验基于对真实世界材质和光照的观察,并被设计成易于理解和实现的损失函数。与现有方法相比,PBR-NeRF能够更有效地利用物理知识来提高材质估计的准确性,而无需复杂的网络结构或大量的训练数据。此外,该方法可以很容易地集成到其他逆渲染和3D重建框架中。

关键设计:论文中两个关键的物理先验被设计为损失函数。具体的技术细节包括:1)使用微表面模型来描述材质的反射特性,并使用可学习的参数来表示材质的反射率和粗糙度;2)使用球谐函数来表示环境光照,并使用可学习的系数来表示光照的强度和方向;3)设计损失函数,鼓励材质参数在空间上平滑变化,并鼓励光照具有一定的对称性。这些设计旨在提高材质和光照估计的稳定性和准确性。

🖼️ 关键图片

📊 实验亮点

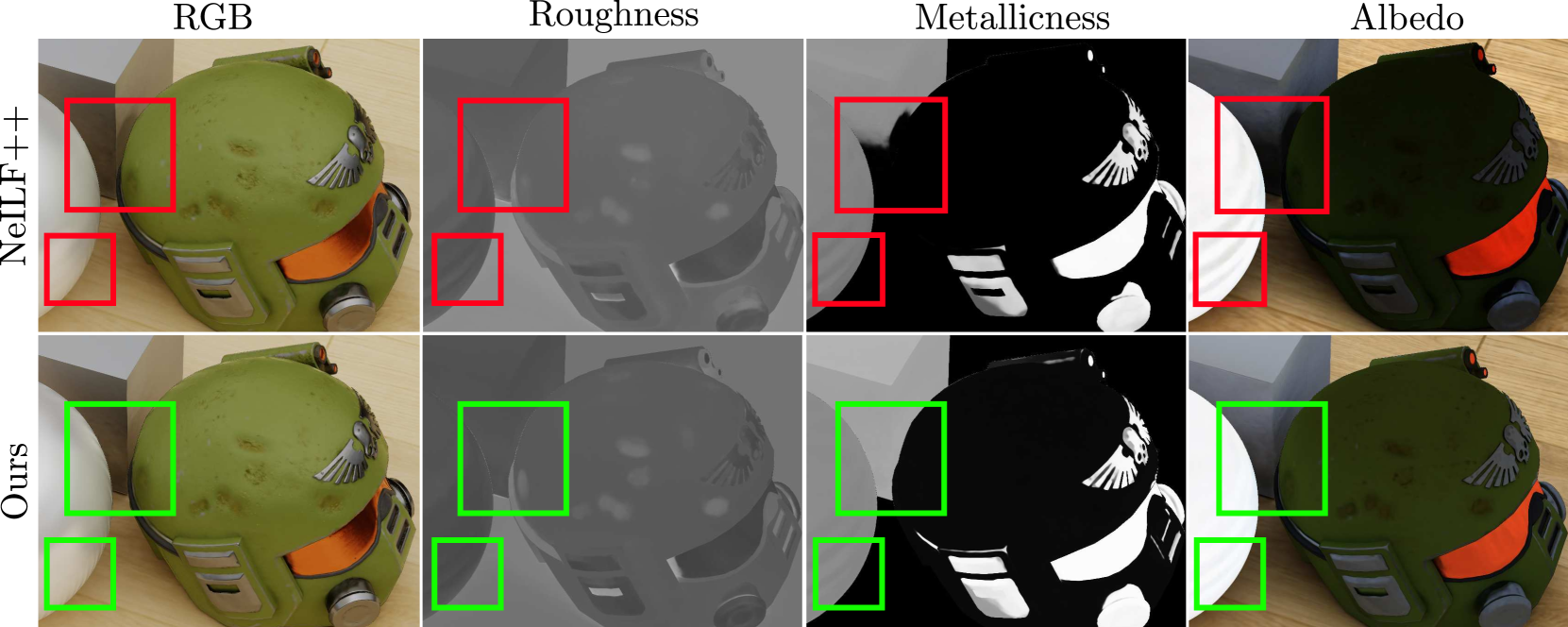

PBR-NeRF在合成数据集和真实数据集上都取得了显著的成果。实验结果表明,PBR-NeRF在材质估计方面优于现有的NeRF方法,并且在不影响新视角合成质量的前提下,实现了更真实的渲染效果。例如,在材质估计的指标上,PBR-NeRF相比于基线方法有显著的提升。

🎯 应用场景

PBR-NeRF在虚拟现实、增强现实、游戏开发等领域具有广泛的应用前景。它可以用于创建更逼真的3D场景,实现更真实的物体交互和光照效果。此外,该方法还可以用于3D资产的自动生成和编辑,从而降低内容创作的成本。未来,PBR-NeRF有望成为3D内容创作的重要工具。

📄 摘要(原文)

We tackle the ill-posed inverse rendering problem in 3D reconstruction with a Neural Radiance Field (NeRF) approach informed by Physics-Based Rendering (PBR) theory, named PBR-NeRF. Our method addresses a key limitation in most NeRF and 3D Gaussian Splatting approaches: they estimate view-dependent appearance without modeling scene materials and illumination. To address this limitation, we present an inverse rendering (IR) model capable of jointly estimating scene geometry, materials, and illumination. Our model builds upon recent NeRF-based IR approaches, but crucially introduces two novel physics-based priors that better constrain the IR estimation. Our priors are rigorously formulated as intuitive loss terms and achieve state-of-the-art material estimation without compromising novel view synthesis quality. Our method is easily adaptable to other inverse rendering and 3D reconstruction frameworks that require material estimation. We demonstrate the importance of extending current neural rendering approaches to fully model scene properties beyond geometry and view-dependent appearance. Code is publicly available at https://github.com/s3anwu/pbrnerf