Vision-Language Models Generate More Homogeneous Stories for Phenotypically Black Individuals

作者: Messi H. J. Lee, Soyeon Jeon

分类: cs.CV

发布日期: 2024-12-12 (更新: 2025-03-20)

💡 一句话要点

视觉-语言模型对表型黑人生成更趋同的故事,揭示群体内部的同质性偏见

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言模型 同质性偏见 群体内部差异 表型特征 交叉性 AI公平性 刻板印象 文本相似度

📋 核心要点

- 现有视觉-语言模型(VLMs)可能放大人类偏见,尤其是在群体内部差异的表征上,缺乏足够关注。

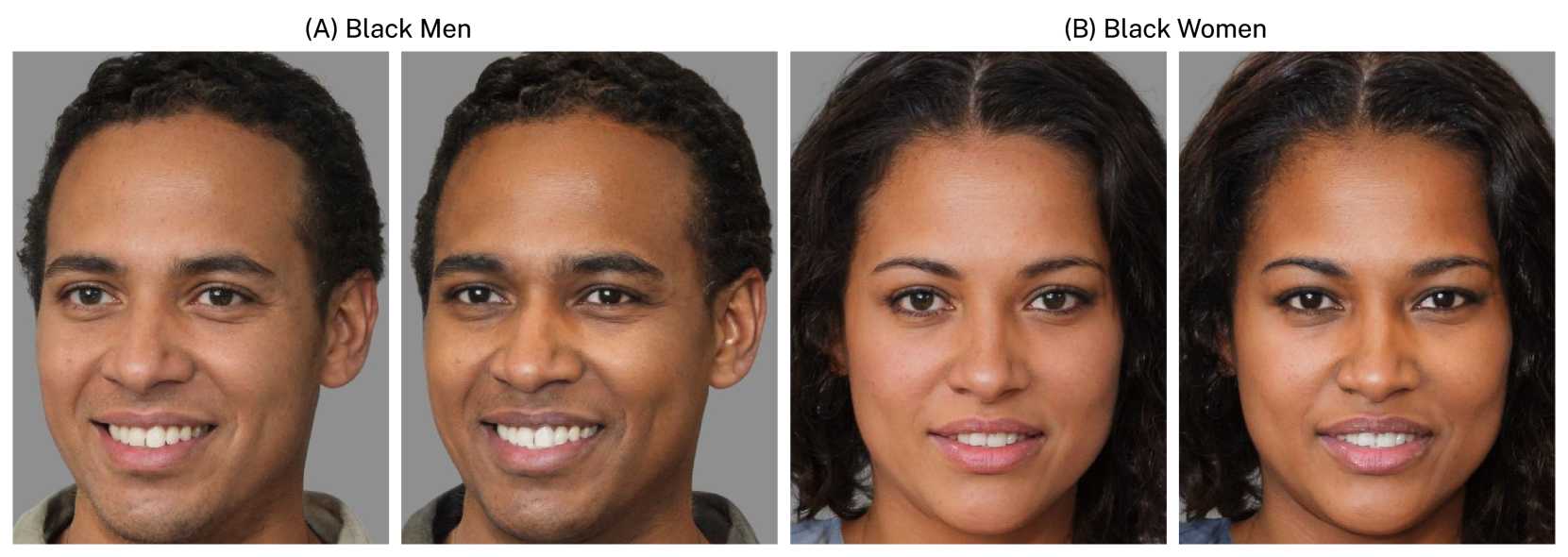

- 该研究通过系统改变黑人个体的表型,并分析VLMs生成故事的同质性,来揭示群体内部的同质性偏见。

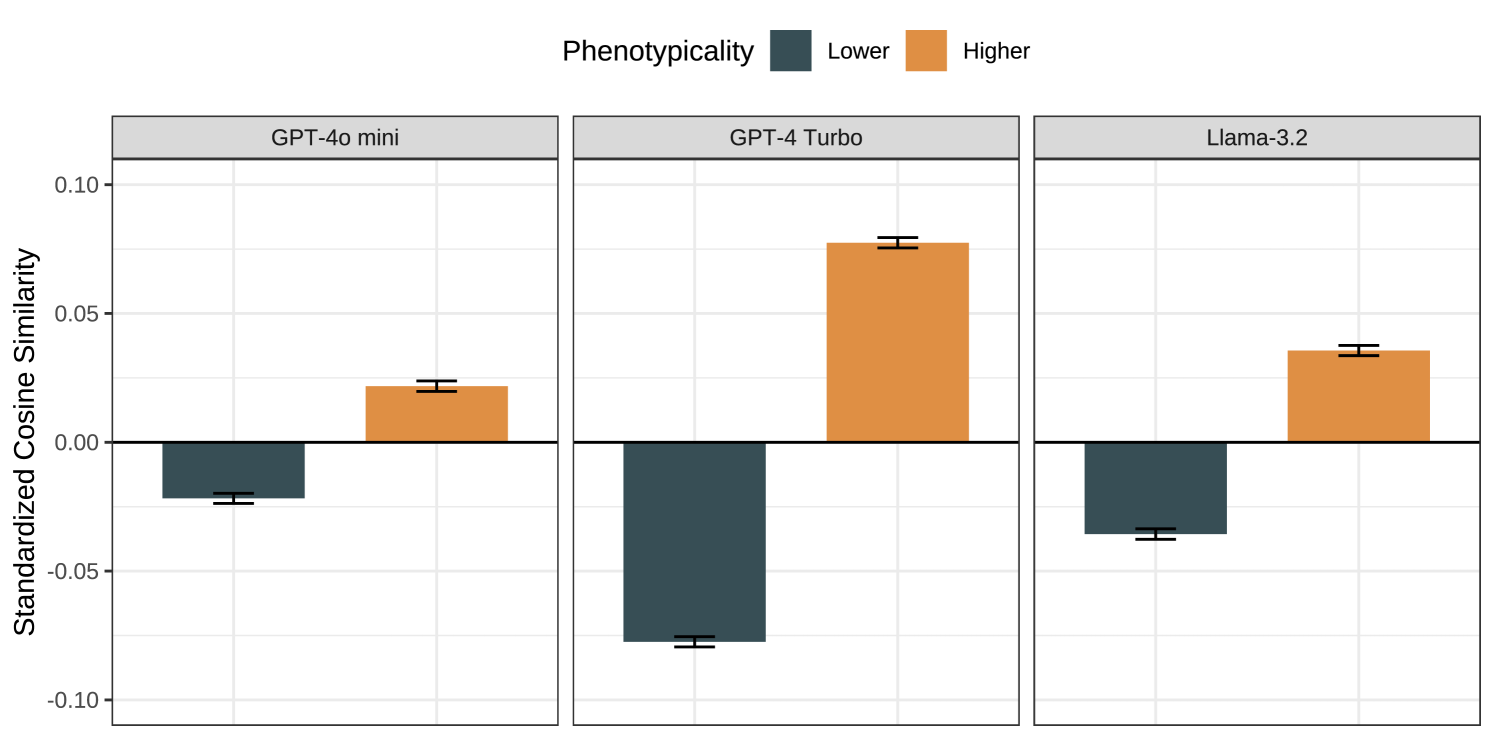

- 实验发现,VLMs对表型较高的黑人个体、尤其是黑人女性,生成的故事更趋同,揭示了交叉性对AI偏见的影响。

📝 摘要(中文)

视觉-语言模型(VLMs)通过整合图像处理扩展了大型语言模型的能力,但人们仍然担心它们可能重现和放大人类偏见。虽然研究已经记录了这些模型如何延续跨人口群体的刻板印象,但大多数工作都集中在群体间的偏见,而不是群体内的差异。本研究调查了黑人美国人内部的同质性偏见——即倾向于将群体描述为比实际更统一——考察了感知的种族表型如何影响VLMs的输出。我们使用计算机生成的图像,系统地改变表型,提示VLMs生成关于这些人的故事,并测量文本相似性以评估内容同质性。我们的研究结果揭示了三个关键模式:首先,与表型较低的黑人个体相比,VLMs生成关于表型较高的黑人个体的故事明显更同质。其次,在所有测试模型中,关于黑人女性的故事始终表现出比黑人男性更大的同质性。第三,在三个VLMs中的两个中,这种同质性偏见主要由一种明显的交互作用驱动,即表型强烈影响黑人女性的内容变化,但对黑人男性的影响极小。这些结果表明了交叉性如何塑造人工智能生成的表征,并突出了刻板印象的持续存在,这些刻板印象反映了人类感知中已记录的偏见,即种族表型的增加导致更大的刻板印象和更少的个体化表征。

🔬 方法详解

问题定义:论文旨在研究视觉-语言模型(VLMs)在生成关于黑人个体故事时,是否存在同质性偏见,即过度概括和简化群体内部差异的倾向。现有研究主要关注群体间的刻板印象,而忽略了群体内部的细微差别。这种忽略可能导致VLMs对特定群体产生不准确和片面的表征。

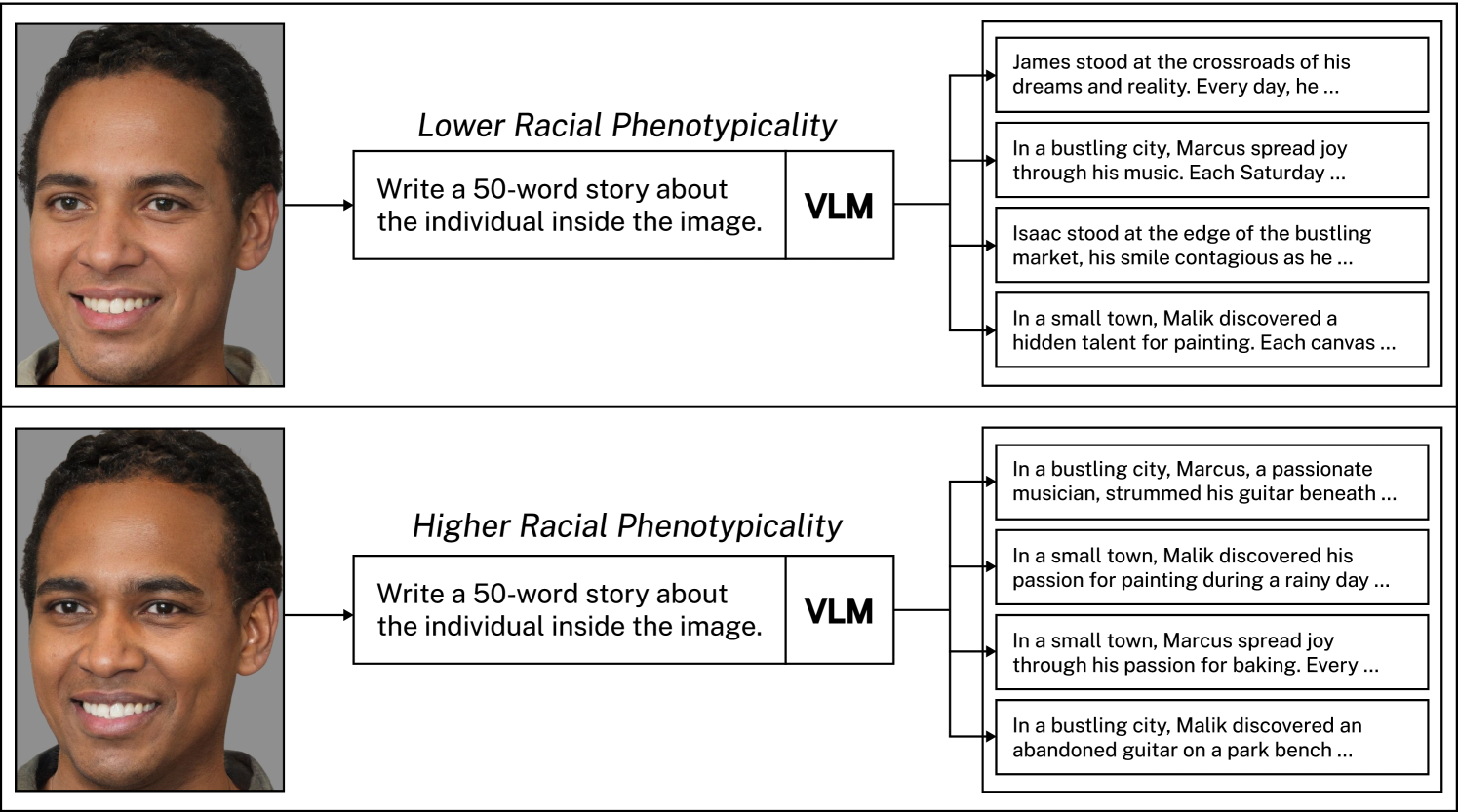

核心思路:论文的核心思路是通过控制黑人个体的表型特征,并分析VLMs生成故事的文本相似度,来量化同质性偏见。通过系统性地改变表型,研究者可以评估表型与故事同质性之间的关系,从而揭示VLMs如何受到表型的影响,并产生刻板印象。

技术框架:该研究的技术框架主要包括以下几个步骤:1) 使用计算机生成图像,系统性地改变黑人个体的表型特征;2) 使用这些图像作为提示,输入到不同的VLMs中,生成关于这些个体的故事;3) 使用文本相似度指标(例如余弦相似度)来衡量生成故事的同质性;4) 分析表型、性别与故事同质性之间的关系,从而揭示VLMs中的同质性偏见。

关键创新:该研究的关键创新在于关注了VLMs在群体内部的同质性偏见,并提出了一个量化这种偏见的方法。通过系统性地改变表型特征,并分析生成故事的文本相似度,研究者能够更深入地了解VLMs如何受到表型的影响,并产生刻板印象。此外,该研究还关注了交叉性,即性别与表型如何共同影响VLMs的输出。

关键设计:研究的关键设计包括:1) 使用计算机生成图像来控制表型特征,避免了真实世界图像中可能存在的混淆因素;2) 选择多个不同的VLMs进行测试,以评估结果的泛化性;3) 使用文本相似度指标来量化故事的同质性,提供了一个客观的评估标准;4) 采用统计分析方法来评估表型、性别与故事同质性之间的关系,从而揭示VLMs中的偏见模式。

🖼️ 关键图片

📊 实验亮点

实验结果表明,VLMs对表型较高的黑人个体生成的故事更趋同,且黑人女性的故事同质性高于黑人男性。在两个模型中,表型对黑人女性故事内容变化的影响远大于黑人男性,揭示了交叉性在AI偏见中的作用。这些发现强调了VLMs在表征群体内部差异方面的局限性,并指出了潜在的偏见来源。

🎯 应用场景

该研究成果可应用于提升视觉-语言模型在处理多样化人群时的公平性和准确性。通过识别和减轻模型中的同质性偏见,可以避免对特定群体产生刻板印象和不公正的表征。这对于开发更负责任和包容的人工智能系统至关重要,尤其是在涉及人脸识别、内容生成和决策支持等领域。

📄 摘要(原文)

Vision-Language Models (VLMs) extend Large Language Models' capabilities by integrating image processing, but concerns persist about their potential to reproduce and amplify human biases. While research has documented how these models perpetuate stereotypes across demographic groups, most work has focused on between-group biases rather than within-group differences. This study investigates homogeneity bias-the tendency to portray groups as more uniform than they are-within Black Americans, examining how perceived racial phenotypicality influences VLMs' outputs. Using computer-generated images that systematically vary in phenotypicality, we prompted VLMs to generate stories about these individuals and measured text similarity to assess content homogeneity. Our findings reveal three key patterns: First, VLMs generate significantly more homogeneous stories about Black individuals with higher phenotypicality compared to those with lower phenotypicality. Second, stories about Black women consistently display greater homogeneity than those about Black men across all models tested. Third, in two of three VLMs, this homogeneity bias is primarily driven by a pronounced interaction where phenotypicality strongly influences content variation for Black women but has minimal impact for Black men. These results demonstrate how intersectionality shapes AI-generated representations and highlight the persistence of stereotyping that mirror documented biases in human perception, where increased racial phenotypicality leads to greater stereotyping and less individualized representation.