Video Creation by Demonstration

作者: Yihong Sun, Hao Zhou, Liangzhe Yuan, Jennifer J. Sun, Yandong Li, Xuhui Jia, Hartwig Adam, Bharath Hariharan, Long Zhao, Ting Liu

分类: cs.CV

发布日期: 2024-12-12

备注: Project page at https://delta-diffusion.github.io/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出δ-Diffusion,通过演示视频和上下文图像生成逼真且连贯的新视频

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频生成 扩散模型 自监督学习 隐式控制 动作迁移

📋 核心要点

- 现有视频生成方法依赖显式信号控制,缺乏灵活性和表现力,难以生成通用视频。

- 提出δ-Diffusion,利用自监督学习从无标签视频中学习,通过隐式潜在控制实现灵活的视频生成。

- 实验表明,δ-Diffusion在人类偏好和机器评估上优于现有方法,展现了交互式世界模拟的潜力。

📝 摘要(中文)

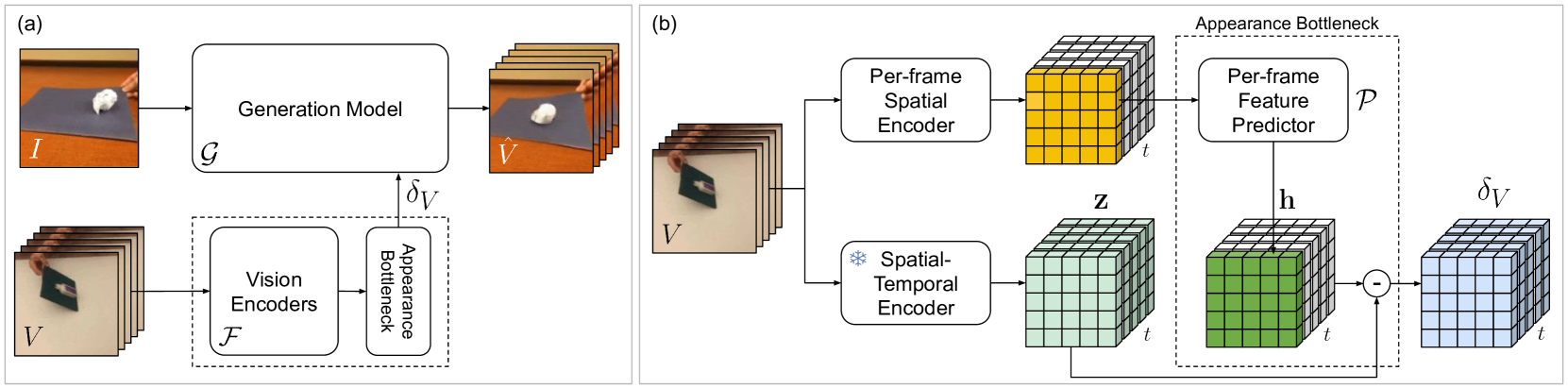

本文探索了一种新颖的视频创作体验,即通过演示进行视频创作。给定一个演示视频和一个来自不同场景的上下文图像,我们生成一个物理上合理的视频,该视频从上下文图像自然地延续,并执行演示中的动作概念。为了实现这一能力,我们提出了一种自监督训练方法$δ$-Diffusion,它通过条件未来帧预测从无标签视频中学习。与大多数基于显式信号的现有视频生成控制不同,我们采用隐式潜在控制的形式,以实现通用视频所需的最大灵活性和表现力。通过利用具有外观瓶颈设计的视频基础模型,我们从演示视频中提取动作潜在变量,以在最小化外观泄漏的情况下调节生成过程。实验结果表明,$δ$-Diffusion在人类偏好和大规模机器评估方面均优于相关基线,并展示了交互式世界模拟的潜力。采样视频生成结果可在https://delta-diffusion.github.io/上找到。

🔬 方法详解

问题定义:论文旨在解决如何根据演示视频和上下文图像生成逼真且连贯的新视频的问题。现有视频生成方法通常依赖于显式的控制信号,例如文本描述或动作标签,这限制了它们在处理复杂和通用的视频内容时的灵活性和表现力。此外,如何从演示视频中提取动作信息,并将其有效地转移到新的场景中,同时避免外观信息的泄露,也是一个重要的挑战。

核心思路:论文的核心思路是利用隐式潜在控制来实现灵活的视频生成。通过训练一个视频扩散模型,使其能够根据演示视频提取的动作潜在变量和上下文图像来生成新的视频。这种方法避免了对显式控制信号的依赖,从而能够处理更广泛的视频内容。同时,论文还设计了一个具有外观瓶颈的视频基础模型,以减少外观信息的泄露,从而保证生成视频与上下文图像的连贯性。

技术框架:整体框架包含以下几个主要模块:1) 视频编码器:用于将演示视频编码为动作潜在变量。2) 图像编码器:用于将上下文图像编码为图像特征。3) 扩散模型:一个条件视频扩散模型,以动作潜在变量和图像特征为条件,生成新的视频。4) 外观瓶颈:位于视频编码器中,用于减少外观信息的泄露。整个流程是,首先将演示视频和上下文图像分别编码为动作潜在变量和图像特征,然后将这些信息输入到扩散模型中,生成新的视频。

关键创新:论文的关键创新在于以下几个方面:1) 提出了δ-Diffusion,一种基于隐式潜在控制的视频生成方法。2) 设计了一个具有外观瓶颈的视频基础模型,以减少外观信息的泄露。3) 采用自监督学习的方式,从无标签视频中学习,从而避免了对大量标注数据的依赖。

关键设计:论文的关键设计包括:1) 外观瓶颈的设计:通过在视频编码器中引入一个瓶颈层,限制了外观信息的传递,从而减少了外观信息的泄露。2) 扩散模型的条件设计:扩散模型以动作潜在变量和图像特征为条件,从而能够根据演示视频和上下文图像生成新的视频。3) 损失函数的设计:论文采用了一种自监督的损失函数,鼓励模型生成与演示视频具有相似动作,并且与上下文图像连贯的视频。

🖼️ 关键图片

📊 实验亮点

实验结果表明,δ-Diffusion在人类偏好和大规模机器评估方面均优于相关基线。具体来说,在人类偏好测试中,δ-Diffusion生成的视频在逼真度和连贯性方面获得了更高的评分。在大规模机器评估中,δ-Diffusion在FID(Fréchet Inception Distance)等指标上取得了显著的提升,表明其生成的视频具有更高的质量和多样性。

🎯 应用场景

该研究成果可应用于视频编辑、游戏开发、虚拟现实等领域。例如,用户可以通过提供一个演示视频和一个背景图像,快速生成一段新的视频内容,从而简化视频创作流程。此外,该技术还可以用于创建虚拟环境,模拟真实世界的交互行为,为用户提供更加沉浸式的体验。未来,该技术有望进一步发展,实现更加智能化的视频生成和编辑。

📄 摘要(原文)

We explore a novel video creation experience, namely Video Creation by Demonstration. Given a demonstration video and a context image from a different scene, we generate a physically plausible video that continues naturally from the context image and carries out the action concepts from the demonstration. To enable this capability, we present $δ$-Diffusion, a self-supervised training approach that learns from unlabeled videos by conditional future frame prediction. Unlike most existing video generation controls that are based on explicit signals, we adopts the form of implicit latent control for maximal flexibility and expressiveness required by general videos. By leveraging a video foundation model with an appearance bottleneck design on top, we extract action latents from demonstration videos for conditioning the generation process with minimal appearance leakage. Empirically, $δ$-Diffusion outperforms related baselines in terms of both human preference and large-scale machine evaluations, and demonstrates potentials towards interactive world simulation. Sampled video generation results are available at https://delta-diffusion.github.io/.