FD2-Net: Frequency-Driven Feature Decomposition Network for Infrared-Visible Object Detection

作者: Ke Li, Di Wang, Zhangyuan Hu, Shaofeng Li, Weiping Ni, Lin Zhao, Quan Wang

分类: cs.CV

发布日期: 2024-12-12

备注: This work is accepted by AAAI 2025

💡 一句话要点

提出FD2-Net,通过频率驱动的特征分解实现红外-可见光图像目标检测性能提升。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 红外可见光目标检测 频率分解 特征融合 多模态学习 深度学习

📋 核心要点

- 现有红外-可见光目标检测方法忽略了图像频率特性,未能充分利用高频细节和低频热信息。

- FD2-Net通过频率驱动的特征分解,分别提取高低频特征,并进行互补融合与重建,提升表征能力。

- 实验结果表明,FD2-Net在LLVIP、FLIR和M3FD等数据集上均超越了现有SOTA模型。

📝 摘要(中文)

红外-可见光目标检测(IVOD)旨在利用红外和可见光图像中的互补信息,从而提高检测器在复杂环境中的性能。然而,现有方法通常忽略了互补信息的频率特性,例如可见光图像中丰富的高频细节和红外图像中有价值的低频热信息,从而限制了检测性能。为了解决这个问题,我们提出了一种新颖的频率驱动特征分解网络FD2-Net,它有效地捕获了跨多模态视觉空间互补信息的独特频率表示。具体来说,我们提出了一个特征分解编码器,其中高频单元(HFU)利用离散余弦变换来捕获代表性的高频特征,而低频单元(LFU)采用动态感受野来建模各种对象的多尺度上下文。接下来,我们采用一种无参数的互补强度策略,通过无缝的频率间重耦合来增强多模态特征。此外,我们创新性地设计了一种多模态重建机制,恢复特征提取过程中丢失的图像细节,进一步利用红外和可见光图像的互补信息来增强整体表征能力。大量实验表明,FD2-Net在各种IVOD基准测试中优于最先进的模型,即LLVIP(96.2% mAP),FLIR(82.9% mAP)和M3FD(83.5% mAP)。

🔬 方法详解

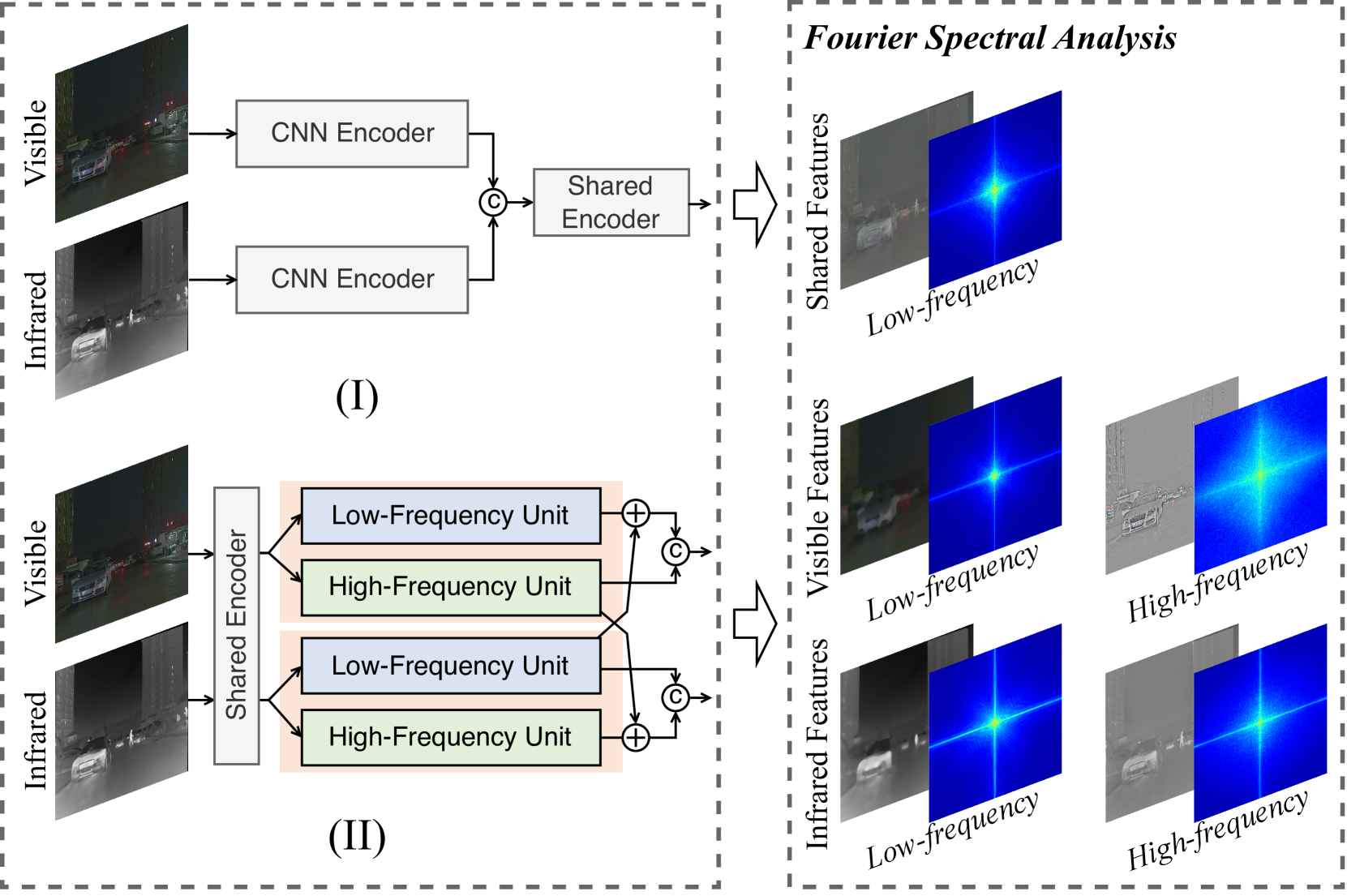

问题定义:现有红外-可见光目标检测方法未能充分利用红外和可见光图像在频率上的互补特性。可见光图像包含丰富的高频细节,而红外图像则包含重要的低频热信息。现有方法通常平等对待所有频率分量,导致信息损失和检测性能受限。

核心思路:FD2-Net的核心思路是分别提取和处理红外和可见光图像的高频和低频特征,然后将这些特征进行融合,并重建图像细节。通过这种方式,网络可以更好地利用两种模态的互补信息,从而提高目标检测的准确性。

技术框架:FD2-Net主要包含三个模块:特征分解编码器、互补强度策略和多模态重建机制。特征分解编码器包含高频单元(HFU)和低频单元(LFU),分别提取高频和低频特征。互补强度策略用于增强多模态特征。多模态重建机制用于恢复特征提取过程中丢失的图像细节。

关键创新:FD2-Net的关键创新在于频率驱动的特征分解。通过将特征分解为高频和低频分量,网络可以更好地捕捉红外和可见光图像的独特特性。此外,多模态重建机制也是一个创新点,它可以恢复特征提取过程中丢失的图像细节,进一步提高检测性能。

关键设计:高频单元(HFU)使用离散余弦变换(DCT)来提取高频特征。低频单元(LFU)使用动态感受野来建模多尺度上下文信息。互补强度策略是一种无参数方法,用于增强多模态特征。多模态重建机制使用卷积神经网络来恢复图像细节。损失函数包括检测损失和重建损失。

🖼️ 关键图片

📊 实验亮点

FD2-Net在LLVIP数据集上达到了96.2%的mAP,在FLIR数据集上达到了82.9%的mAP,在M3FD数据集上达到了83.5%的mAP。这些结果表明,FD2-Net在各种IVOD基准测试中均优于现有SOTA模型,证明了该方法的有效性。

🎯 应用场景

FD2-Net在红外-可见光目标检测领域具有广泛的应用前景,例如自动驾驶、安防监控、搜救行动等。在这些场景中,红外和可见光图像可以提供互补的信息,从而提高目标检测的准确性和鲁棒性。该研究成果有助于提升复杂环境下智能系统的感知能力。

📄 摘要(原文)

Infrared-visible object detection (IVOD) seeks to harness the complementary information in infrared and visible images, thereby enhancing the performance of detectors in complex environments. However, existing methods often neglect the frequency characteristics of complementary information, such as the abundant high-frequency details in visible images and the valuable low-frequency thermal information in infrared images, thus constraining detection performance. To solve this problem, we introduce a novel Frequency-Driven Feature Decomposition Network for IVOD, called FD2-Net, which effectively captures the unique frequency representations of complementary information across multimodal visual spaces. Specifically, we propose a feature decomposition encoder, wherein the high-frequency unit (HFU) utilizes discrete cosine transform to capture representative high-frequency features, while the low-frequency unit (LFU) employs dynamic receptive fields to model the multi-scale context of diverse objects. Next, we adopt a parameter-free complementary strengths strategy to enhance multimodal features through seamless inter-frequency recoupling. Furthermore, we innovatively design a multimodal reconstruction mechanism that recovers image details lost during feature extraction, further leveraging the complementary information from infrared and visible images to enhance overall representational capacity. Extensive experiments demonstrate that FD2-Net outperforms state-of-the-art (SOTA) models across various IVOD benchmarks, i.e. LLVIP (96.2% mAP), FLIR (82.9% mAP), and M3FD (83.5% mAP).