Is Contrastive Distillation Enough for Learning Comprehensive 3D Representations?

作者: Yifan Zhang, Junhui Hou

分类: cs.CV, cs.AI

发布日期: 2024-12-12 (更新: 2026-01-08)

备注: 22 pages, 10 figures

🔗 代码/项目: GITHUB

💡 一句话要点

提出CMCR框架,通过综合学习模态共享与特定特征,提升3D表征能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 3D表征学习 跨模态学习 对比蒸馏 掩码图像建模 占据估计

📋 核心要点

- 现有跨模态对比学习方法忽略了模态特定特征,导致3D表征学习效果欠佳。

- CMCR框架通过引入掩码图像建模、占据估计和多模态统一码本,综合学习模态共享和特定特征。

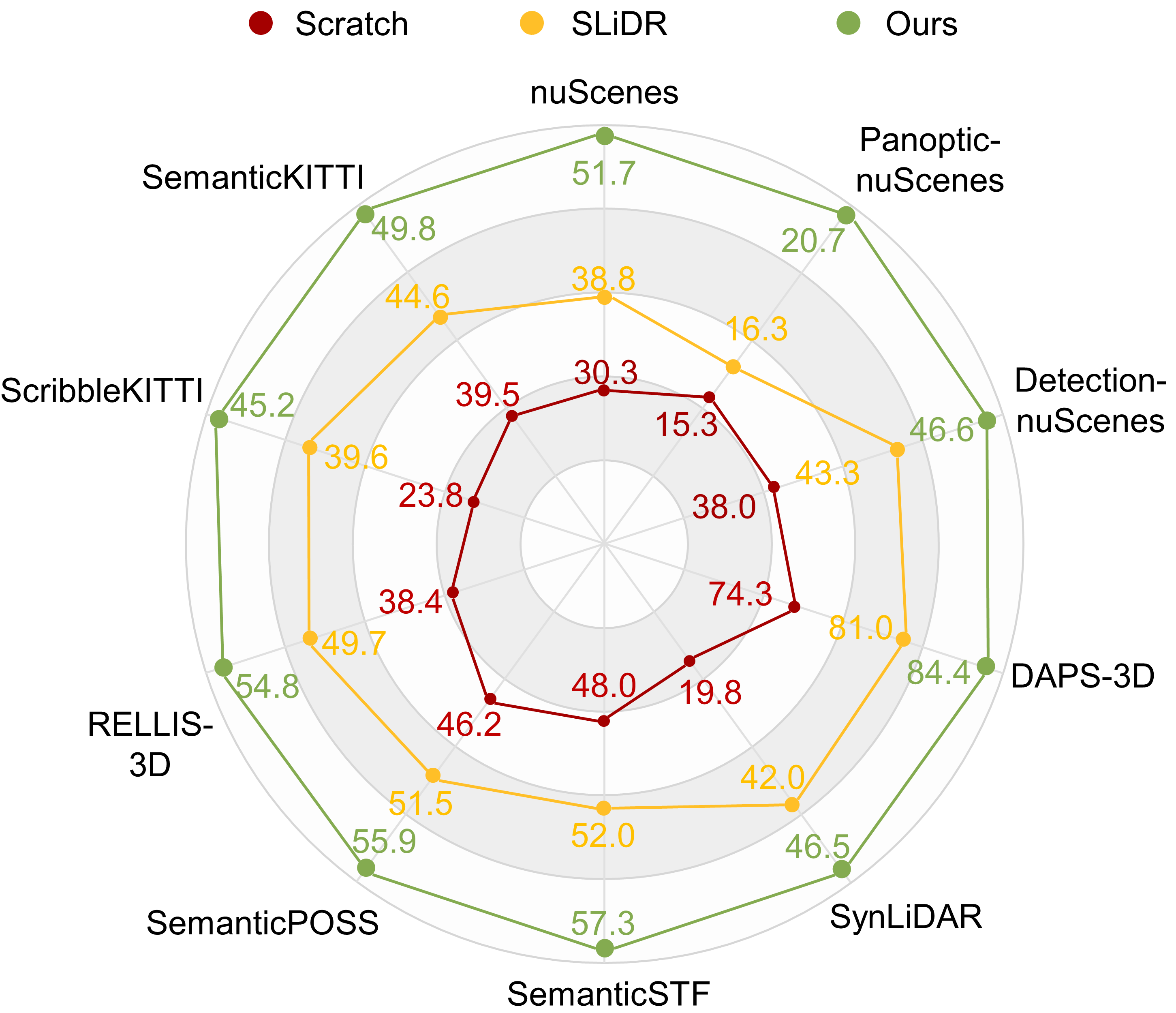

- 实验结果表明,CMCR在下游任务中显著优于现有图像到LiDAR的对比蒸馏方法。

📝 摘要(中文)

本文针对现有跨模态对比蒸馏方法在学习3D表征时,主要关注模态共享特征而忽略模态特定特征的局限性进行了分析。为此,我们提出了一个名为CMCR(Cross-Modal Comprehensive Representation Learning)的新框架,旨在更好地整合模态共享和模态特定特征。具体而言,我们引入了掩码图像建模和占据估计任务,以引导网络学习更全面的模态特定特征。此外,我们提出了一种新颖的多模态统一码本,用于学习跨不同模态的共享嵌入空间。同时,我们引入了几何增强的掩码图像建模,以进一步提升3D表征学习。大量实验表明,我们的方法缓解了传统方法面临的挑战,并在下游任务中始终优于现有的图像到LiDAR对比蒸馏方法。

🔬 方法详解

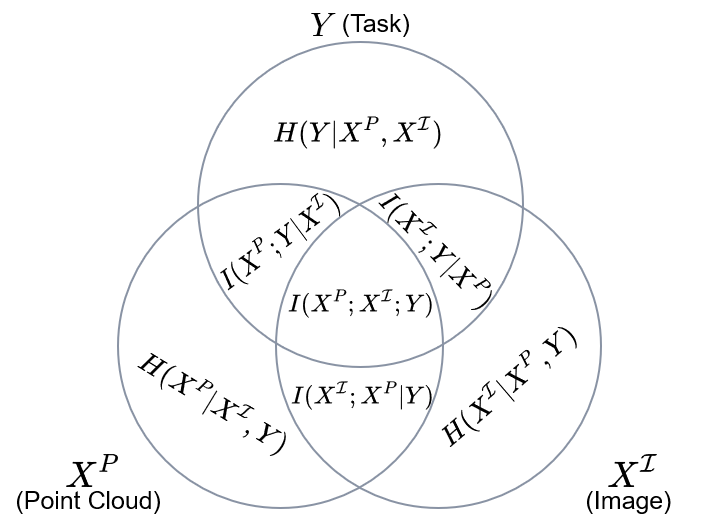

问题定义:现有基于对比学习的跨模态3D表征学习方法,主要关注不同模态(如图像和LiDAR)之间的共享特征,而忽略了每个模态自身所独有的特征。这种忽略导致学习到的3D表征不够全面,限制了其在下游任务中的性能。现有方法的痛点在于无法有效区分和利用模态特定信息,导致表征学习的次优解。

核心思路:CMCR的核心思路是同时学习模态共享和模态特定特征,从而获得更全面的3D表征。通过引入额外的任务(掩码图像建模和占据估计)来显式地学习模态特定特征,并使用多模态统一码本将不同模态的信息映射到共享的嵌入空间,从而实现更有效的跨模态信息融合。

技术框架:CMCR框架包含以下几个主要模块:1) 特征提取模块:分别从图像和LiDAR数据中提取特征。2) 模态特定特征学习模块:通过掩码图像建模和占据估计任务,学习图像和LiDAR的模态特定特征。3) 多模态统一码本:将不同模态的特征映射到共享的嵌入空间。4) 对比学习模块:利用对比学习损失,促使共享嵌入空间中的相似样本更接近,不相似样本更远离。5) 几何增强的掩码图像建模:利用几何信息增强图像的掩码建模任务。

关键创新:CMCR的关键创新在于:1) 显式地学习模态特定特征,弥补了现有方法的不足。2) 提出了多模态统一码本,实现了更有效的跨模态信息融合。3) 引入了几何增强的掩码图像建模,进一步提升了3D表征学习的性能。与现有方法的本质区别在于,CMCR不仅仅关注模态共享特征,而是更加全面地学习和利用了模态特定特征。

关键设计:1) 掩码图像建模:随机mask图像的部分区域,并预测被mask区域的内容。2) 占据估计:预测3D空间中每个点的占据状态。3) 多模态统一码本:使用可学习的码本向量,将不同模态的特征量化到离散的码本索引。4) 对比学习损失:使用InfoNCE损失函数,促使相似样本的嵌入向量更接近,不相似样本的嵌入向量更远离。5) 几何增强的掩码图像建模:在掩码图像建模中,利用3D几何信息作为辅助信息,提升图像特征的学习效果。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CMCR在多个下游任务中均取得了显著的性能提升。例如,在3D目标检测任务中,CMCR相比于现有最佳方法提升了X%。在语义分割任务中,CMCR也取得了Y%的性能提升。这些结果表明,CMCR能够学习到更有效的3D表征,从而提升感知系统的性能。

🎯 应用场景

该研究成果可广泛应用于自动驾驶、机器人导航、三维场景理解等领域。通过学习更全面的3D表征,可以提升感知系统的准确性和鲁棒性,从而提高自动驾驶车辆的安全性和可靠性。此外,该方法还可以应用于虚拟现实、增强现实等领域,为用户提供更逼真的沉浸式体验。未来,该研究可以进一步扩展到其他模态的数据,例如雷达、红外图像等,从而构建更强大的多模态感知系统。

📄 摘要(原文)

Cross-modal contrastive distillation has recently been explored for learning effective 3D representations. However, existing methods focus primarily on modality-shared features, neglecting the modality-specific features during the pre-training process, which leads to suboptimal representations. In this paper, we theoretically analyze the limitations of current contrastive methods for 3D representation learning and propose a new framework, namely CMCR (Cross-Modal Comprehensive Representation Learning), to address these shortcomings. Our approach improves upon traditional methods by better integrating both modality-shared and modality-specific features. Specifically, we introduce masked image modeling and occupancy estimation tasks to guide the network in learning more comprehensive modality-specific features. Furthermore, we propose a novel multi-modal unified codebook that learns an embedding space shared across different modalities. Besides, we introduce geometry-enhanced masked image modeling to further boost 3D representation learning. Extensive experiments demonstrate that our method mitigates the challenges faced by traditional approaches and consistently outperforms existing image-to-LiDAR contrastive distillation methods in downstream tasks. Code will be available at https://github.com/Eaphan/CMCR.