Tuned Reverse Distillation: Enhancing Multimodal Industrial Anomaly Detection with Crossmodal Tuners

作者: Xinyue Liu, Jianyuan Wang, Biao Leng, Shuo Zhang

分类: cs.CV

发布日期: 2024-12-12 (更新: 2025-07-25)

🔗 代码/项目: GITHUB

💡 一句话要点

提出Tuned Reverse Distillation,通过跨模态调谐器增强多模态工业异常检测。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态异常检测 知识蒸馏 跨模态学习 工业异常检测 反向蒸馏

📋 核心要点

- 现有基于知识蒸馏的多模态异常检测方法难以有效捕获单模态异常,且未能充分利用模态内和模态间信息。

- 提出Tuned Reverse Distillation (TRD),采用多分支结构处理不同模态,并设计跨模态调谐器增强模态间交互。

- 实验结果表明,TRD在多模态异常检测和定位方面达到了state-of-the-art的性能。

📝 摘要(中文)

知识蒸馏(KD)在无监督图像异常检测(AD)中得到了广泛研究,但其在无监督多模态AD中的应用仍未被充分探索。现有的基于KD的多模态AD方法使用融合的多模态特征来获得教师表示,面临着挑战。仅存在于一种模态中的异常可能无法在融合的教师特征中被有效捕获,从而导致检测失败。此外,这些方法没有充分利用丰富的模态内和模态间信息,而这些信息对于有效的异常检测至关重要。在本文中,我们提出了一种基于多分支设计的Tuned Reverse Distillation (TRD)来实现多模态工业AD。通过为每个模态分配独立的branch,我们的方法能够更精细地检测每个模态内的异常。此外,我们通过设计包括跨模态滤波器和放大器在内的两个跨模态调谐器,增强了蒸馏过程中模态之间的交互。借助跨模态映射的思想,学生网络可以更好地学习正常特征,同时确保有效检测所有模态中的异常。在多模态AD数据集上的实验验证表明,我们的方法在多模态异常检测和定位方面取得了最先进的性能。代码可在https://github.com/hito2448/TRD获得。

🔬 方法详解

问题定义:论文旨在解决多模态工业异常检测问题。现有基于知识蒸馏的方法,通过融合多模态特征来训练教师网络,难以有效捕捉仅存在于单一模态中的异常,并且没有充分利用模态内和模态间的信息,导致检测精度受限。

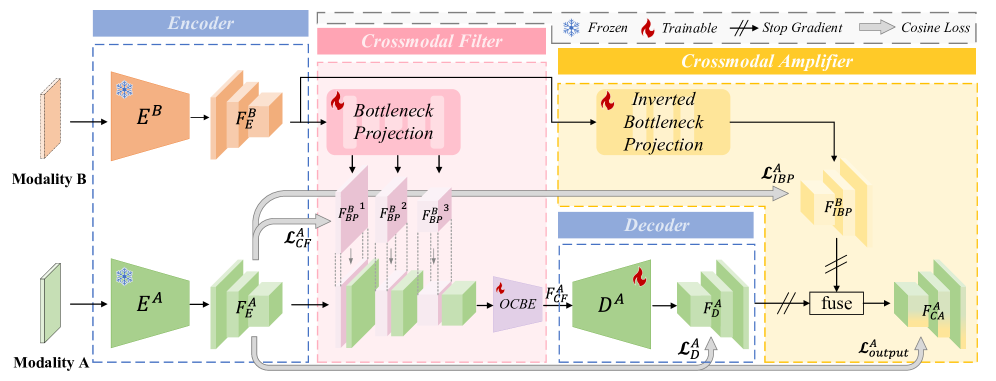

核心思路:核心思路是采用多分支结构,为每个模态分配独立的网络分支,从而能够更精细地检测每个模态内的异常。同时,设计跨模态调谐器,增强不同模态之间的信息交互,使学生网络能够更好地学习正常特征,从而更有效地检测异常。

技术框架:TRD框架包含以下几个主要模块:1) 多分支学生网络,每个分支处理一种模态的数据;2) 教师网络,同样采用多分支结构,但使用融合后的特征进行训练;3) 跨模态滤波器,用于过滤掉其他模态中的噪声信息;4) 跨模态放大器,用于增强不同模态之间的相关性;5) 知识蒸馏损失函数,用于指导学生网络学习教师网络的知识。

关键创新:主要创新点在于:1) 采用多分支结构,独立处理每个模态,避免了信息融合带来的单模态异常信息丢失;2) 设计了跨模态滤波器和放大器,增强了模态间的交互,使学生网络能够更好地学习正常特征;3) 提出了Tuned Reverse Distillation,通过反向蒸馏的方式,让学生网络学习教师网络的知识,从而提高异常检测的准确率。

关键设计:跨模态滤波器和放大器的具体实现方式未知,论文中可能使用了注意力机制或者其他特征选择方法来实现跨模态信息的过滤和增强。损失函数的设计可能包括重构损失、知识蒸馏损失以及其他正则化项,以保证学生网络能够有效地学习正常特征并抑制异常特征。

🖼️ 关键图片

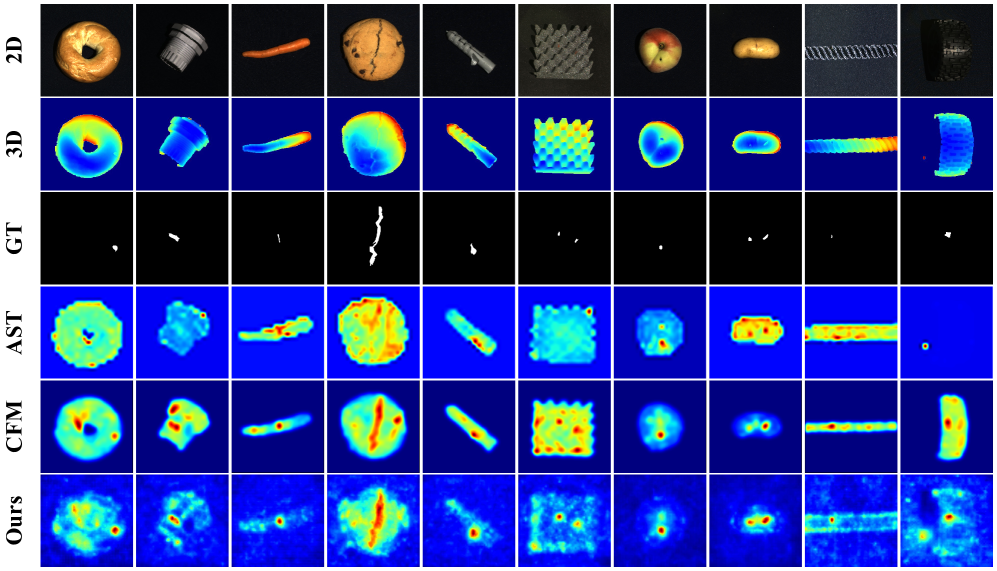

📊 实验亮点

论文提出的TRD方法在多模态异常检测数据集上取得了state-of-the-art的性能,表明其在多模态异常检测和定位方面具有显著优势。具体的性能数据和对比基线需要在论文中查找,但摘要明确指出该方法优于现有方法。

🎯 应用场景

该研究成果可应用于工业生产线的质量检测、智能制造、医疗诊断等领域。通过对多模态数据的分析,例如图像、声音、温度等,可以实现对产品缺陷、设备故障、疾病的早期预警和诊断,提高生产效率和产品质量,降低安全风险。

📄 摘要(原文)

Knowledge distillation (KD) has been widely studied in unsupervised image Anomaly Detection (AD), but its application to unsupervised multimodal AD remains underexplored. Existing KD-based methods for multimodal AD that use fused multimodal features to obtain teacher representations face challenges. Anomalies that only exist in one modality may not be effectively captured in the fused teacher features, leading to detection failures. Besides, these methods do not fully leverage the rich intra- and inter-modality information that are critical for effective anomaly detection. In this paper, we propose Tuned Reverse Distillation (TRD) based on Multi-branch design to realize Multimodal Industrial AD. By assigning independent branches to each modality, our method enables finer detection of anomalies within each modality. Furthermore, we enhance the interaction between modalities during the distillation process by designing two Crossmodal Tuners including Crossmodal Filter and Amplifier. With the idea of crossmodal mapping, the student network is allowed to better learn normal features while anomalies in all modalities are ensured to be effectively detected. Experimental verifications on multimodal AD datasets demonstrate that our method achieves state-of-the-art performance in multimodal anomaly detection and localization. Code is available at https://github.com/hito2448/TRD.