Neighborhood Commonality-aware Evolution Network for Continuous Generalized Category Discovery

作者: Ye Wang, Yaxiong Wang, Guoshuai Zhao, Xueming Qian

分类: cs.CV, cs.AI

发布日期: 2024-12-07

备注: 12 pages, 7 Figures

🔗 代码/项目: GITHUB

💡 一句话要点

提出Neighborhood Commonality-aware Evolution Network以解决连续类别发现问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 连续学习 类别发现 表示学习 对比学习 知识蒸馏

📋 核心要点

- 现有的连续类别发现方法在处理新类别时,往往会导致旧类别的性能下降,缺乏有效的知识保持机制。

- 本文提出的NCENet通过Neighborhood Commonality-aware Representation Learning(NCRL)和Bi-level Contrastive Knowledge Distillation(BCKD)模块,增强了新旧类别的表示学习能力。

- 实验结果显示,NCENet在CIFAR100数据集的最后增量学习阶段,旧类别和新类别的聚类准确率分别提升了3.09%和6.32%。

📝 摘要(中文)

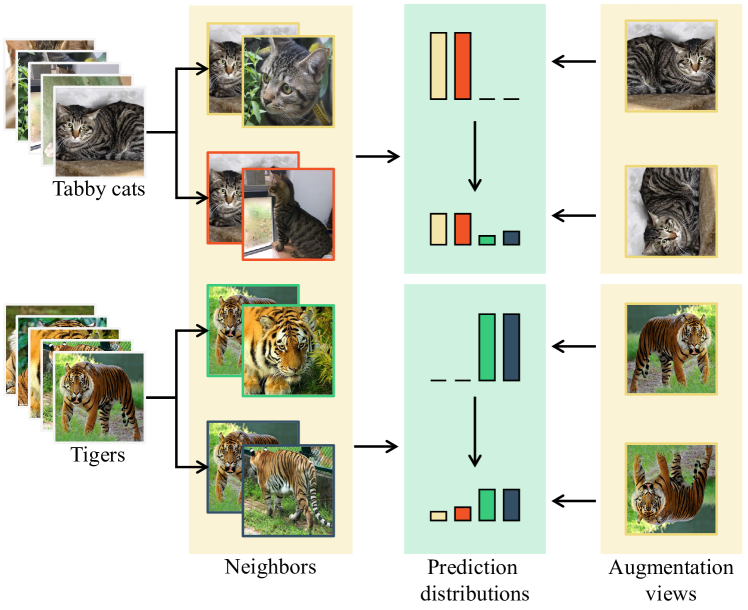

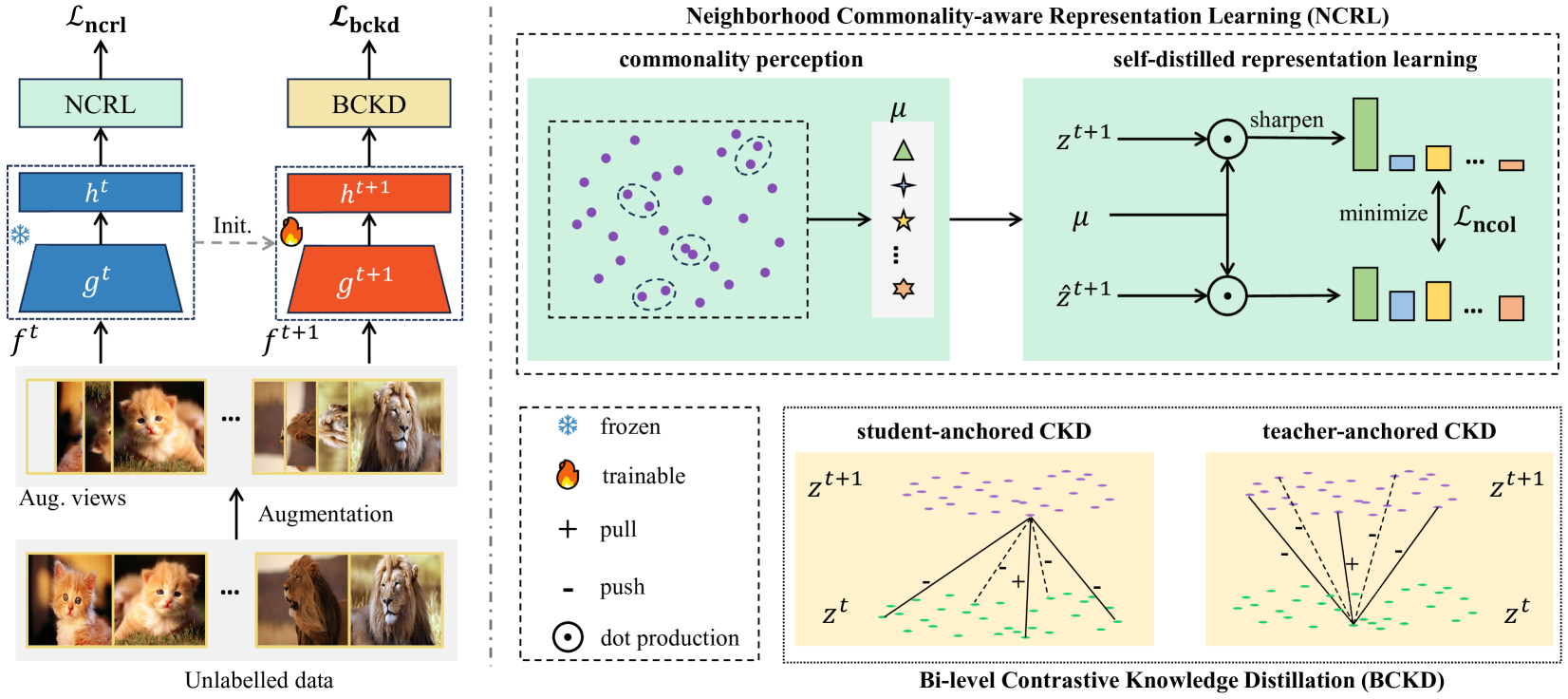

连续广义类别发现(C-GCD)旨在从未标记的图像集中持续发现新类别,同时保持对旧类别的性能。在本文中,我们提出了一种新颖的学习框架,称为Neighborhood Commonality-aware Evolution Network(NCENet),从表示学习的角度解决这一任务。具体而言,为了学习新类别的区分性表示,设计了Neighborhood Commonality-aware Representation Learning(NCRL),利用邻域中衍生的局部共性来指导不同类别实例之间表示差异的学习。为了保持对旧类别的表示能力,设计了Bi-level Contrastive Knowledge Distillation(BCKD)模块,利用对比学习感知学习和已学习知识并进行知识蒸馏。在CIFAR10、CIFAR100和Tiny-ImageNet上的大量实验表明,NCENet相较于之前的最先进方法具有优越的性能。特别是在CIFAR100的最后增量学习阶段,NCENet在旧类别上的聚类准确率比第二名方法高出3.09%,在新类别上高出6.32%。

🔬 方法详解

问题定义:本文旨在解决连续广义类别发现(C-GCD)中的新旧类别性能保持问题。现有方法在引入新类别时,往往会导致旧类别的性能下降,缺乏有效的知识保持机制。

核心思路:NCENet通过引入Neighborhood Commonality-aware Representation Learning(NCRL)来学习新类别的区分性表示,同时利用Bi-level Contrastive Knowledge Distillation(BCKD)模块保持旧类别的表示能力。这样的设计旨在通过局部共性引导表示学习,从而增强模型的泛化能力。

技术框架:NCENet的整体架构包括两个主要模块:NCRL用于新类别的表示学习,BCKD用于旧类别知识的蒸馏。NCRL通过分析邻域内的共性来指导不同类别之间的表示差异,而BCKD则通过对比学习来感知和传递知识。

关键创新:NCENet的核心创新在于结合了局部共性学习与对比知识蒸馏,形成了一种新颖的表示学习框架。这种方法与传统的单一类别学习方法有本质区别,能够更好地处理新旧类别的关系。

关键设计:在NCRL中,设计了特定的损失函数以优化邻域内的表示差异;在BCKD中,采用了双层对比学习机制,以确保旧知识的有效传递和保持。

🖼️ 关键图片

📊 实验亮点

实验结果表明,NCENet在CIFAR100数据集的最后增量学习阶段,旧类别的聚类准确率比第二名方法高出3.09%,新类别的聚类准确率高出6.32%。这些结果显示了NCENet在连续类别发现任务中的显著优势。

🎯 应用场景

该研究的潜在应用领域包括图像分类、物体检测和自动驾驶等场景,尤其是在需要持续学习和适应新环境的任务中。通过有效的类别发现机制,NCENet能够提升模型在动态环境中的表现,具有重要的实际价值和未来影响。

📄 摘要(原文)

Continuous Generalized Category Discovery (C-GCD) aims to continually discover novel classes from unlabelled image sets while maintaining performance on old classes. In this paper, we propose a novel learning framework, dubbed Neighborhood Commonality-aware Evolution Network (NCENet) that conquers this task from the perspective of representation learning. Concretely, to learn discriminative representations for novel classes, a Neighborhood Commonality-aware Representation Learning (NCRL) is designed, which exploits local commonalities derived neighborhoods to guide the learning of representational differences between instances of different classes. To maintain the representation ability for old classes, a Bi-level Contrastive Knowledge Distillation (BCKD) module is designed, which leverages contrastive learning to perceive the learning and learned knowledge and conducts knowledge distillation. Extensive experiments conducted on CIFAR10, CIFAR100, and Tiny-ImageNet demonstrate the superior performance of NCENet compared to the previous state-of-the-art method. Particularly, in the last incremental learning session on CIFAR100, the clustering accuracy of NCENet outperforms the second-best method by a margin of 3.09\% on old classes and by a margin of 6.32\% on new classes. Our code will be publicly available at \href{https://github.com/xjtuYW/NCENet.git}{https://github.com/xjtuYW/NCENet.git}. \end{abstract}