Sparse autoencoders reveal selective remapping of visual concepts during adaptation

作者: Hyesu Lim, Jinho Choi, Jaegul Choo, Steffen Schneider

分类: cs.CV, cs.LG

发布日期: 2024-12-06 (更新: 2025-03-21)

备注: Published as a conference paper at the Thirteenth International Conference on Learning Representations (ICLR 2025)

💡 一句话要点

提出PatchSAE,揭示视觉概念在模型适应过程中的选择性重映射机制

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 稀疏自编码器 视觉Transformer 模型适应 可解释性 知识迁移

📋 核心要点

- 现有模型适应方法缺乏对内部机制的深入理解,难以解释适应过程中的知识迁移。

- 提出PatchSAE,通过稀疏自编码器提取视觉Transformer中的可解释概念及其空间属性。

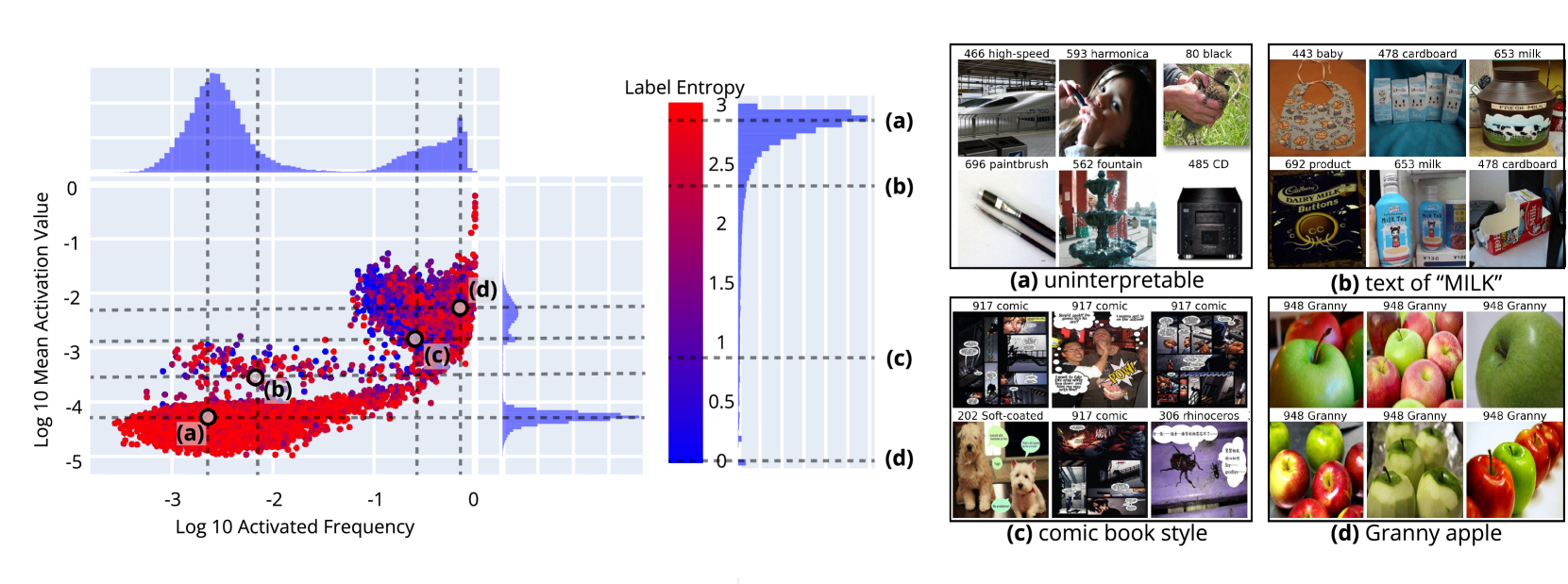

- 实验表明,模型适应的性能提升主要源于预训练模型中已存在的概念,而非新概念的引入。

📝 摘要(中文)

针对下游任务,对预训练模型进行适应已成为构建机器学习系统的标准方法。然而,适应过程中发生的机制仍然未知。本文提出了一种新的稀疏自编码器(SAE)——PatchSAE,用于CLIP视觉Transformer,以提取细粒度的可解释概念(例如,物体的形状、颜色或语义)及其patch级别的空间属性。研究了这些概念如何影响模型在下游图像分类任务中的输出,并探讨了最新的基于prompt的适应技术如何改变模型输入与这些概念的关联。研究发现,虽然适应模型和非适应模型之间概念的激活略有变化,但常见适应任务中的大部分增益可以用非适应预训练模型中已存在的概念来解释。这项工作提供了一个具体的框架来训练和使用SAE用于视觉Transformer,并为解释适应机制提供了见解。

🔬 方法详解

问题定义:论文旨在理解视觉Transformer模型在适应下游任务时,内部发生了哪些变化。现有方法缺乏对模型内部概念的细粒度理解,难以解释模型适应的机制,例如哪些概念被激活、哪些概念被抑制,以及这些概念如何影响最终的预测结果。

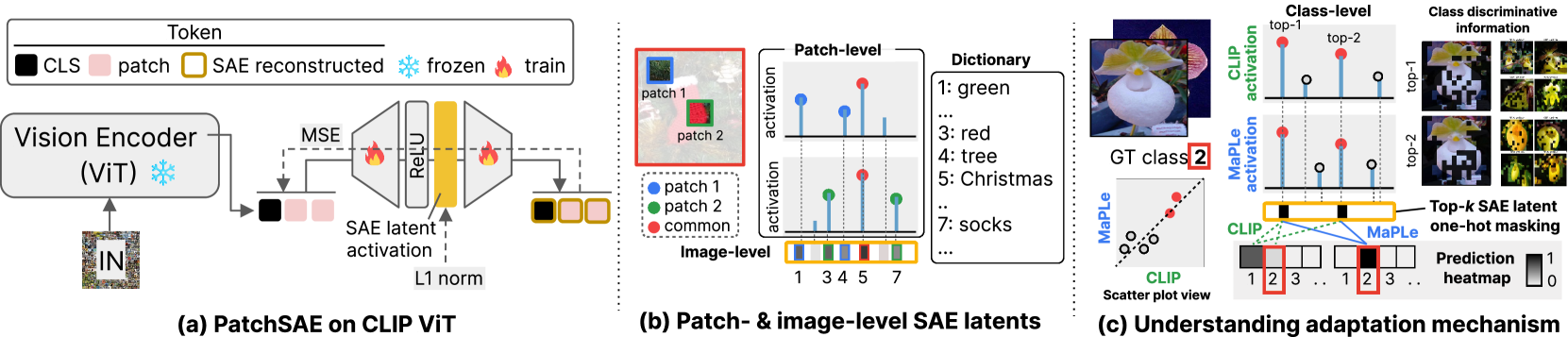

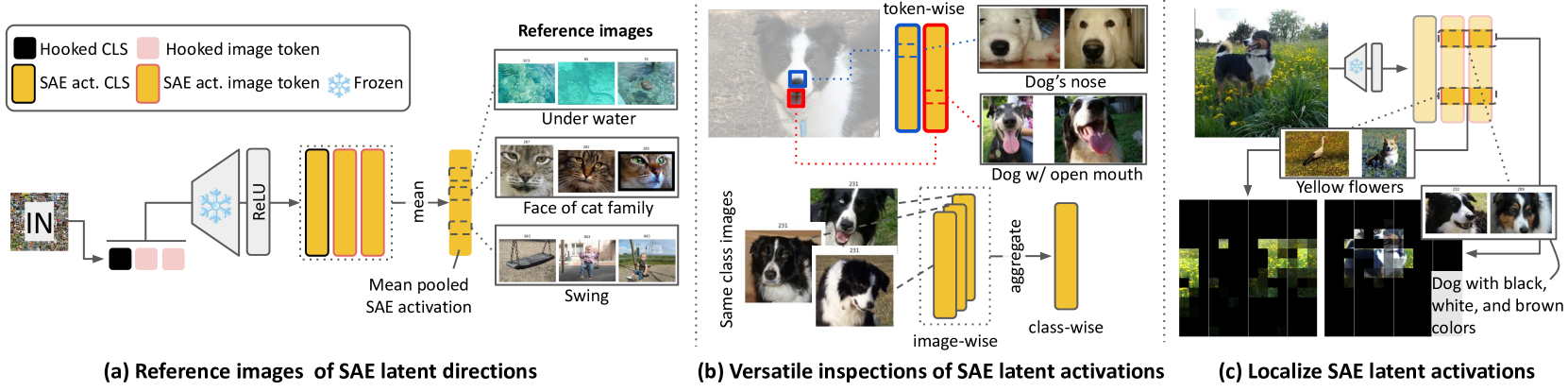

核心思路:论文的核心思路是利用稀疏自编码器(SAE)来提取视觉Transformer中的可解释概念。通过分析这些概念在适应前后的激活变化,可以揭示模型适应过程中知识迁移和重用的机制。PatchSAE的设计目标是提取patch级别的细粒度概念,从而更好地理解模型如何利用图像的不同区域进行决策。

技术框架:整体框架包括三个主要步骤:1) 使用CLIP视觉Transformer提取图像特征;2) 使用PatchSAE对Transformer的中间层特征进行编码,提取稀疏的、可解释的概念;3) 分析这些概念在适应前后模型中的激活变化,以及它们对下游任务性能的影响。PatchSAE被设计为附加在预训练CLIP模型上的模块,无需从头训练CLIP模型。

关键创新:关键创新在于将稀疏自编码器应用于视觉Transformer,并设计了PatchSAE来提取patch级别的概念。与传统的SAE相比,PatchSAE能够提供更细粒度的解释,揭示模型如何利用图像的不同区域进行决策。此外,论文还提出了一种分析概念激活变化的方法,用于理解模型适应的机制。

关键设计:PatchSAE的关键设计包括:1) 稀疏性约束:通过L1正则化鼓励编码器的输出稀疏,从而提取更具代表性的概念;2) Patch级别的编码:将图像划分为patch,并对每个patch的特征进行编码,从而提取patch级别的概念;3) 损失函数:使用重构损失和稀疏性损失的加权和作为PatchSAE的训练目标。具体的参数设置(如稀疏性系数)需要根据实验进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,PatchSAE能够有效地提取视觉Transformer中的可解释概念。通过分析这些概念在适应前后的激活变化,研究发现模型适应的性能提升主要源于预训练模型中已存在的概念,而非新概念的引入。这表明,模型适应的过程主要是对现有知识的重用和调整,而非从头学习新的知识。此外,实验还表明,PatchSAE可以用于诊断模型的偏差和漏洞,从而提高模型的可靠性。

🎯 应用场景

该研究成果可应用于提升模型的可解释性和可控性,例如,通过理解模型如何利用图像的不同区域进行决策,可以改进模型的鲁棒性和泛化能力。此外,该方法还可以用于指导模型的微调和知识迁移,从而更有效地将预训练模型应用于新的下游任务。在安全攸关的应用中,例如自动驾驶和医疗诊断,模型的可解释性至关重要,该研究为此类应用提供了新的工具和方法。

📄 摘要(原文)

Adapting foundation models for specific purposes has become a standard approach to build machine learning systems for downstream applications. Yet, it is an open question which mechanisms take place during adaptation. Here we develop a new Sparse Autoencoder (SAE) for the CLIP vision transformer, named PatchSAE, to extract interpretable concepts at granular levels (e.g., shape, color, or semantics of an object) and their patch-wise spatial attributions. We explore how these concepts influence the model output in downstream image classification tasks and investigate how recent state-of-the-art prompt-based adaptation techniques change the association of model inputs to these concepts. While activations of concepts slightly change between adapted and non-adapted models, we find that the majority of gains on common adaptation tasks can be explained with the existing concepts already present in the non-adapted foundation model. This work provides a concrete framework to train and use SAEs for Vision Transformers and provides insights into explaining adaptation mechanisms.