DreamColour: Controllable Video Colour Editing without Training

作者: Chaitat Utintu, Pinaki Nath Chowdhury, Aneeshan Sain, Subhadeep Koley, Ayan Kumar Bhunia, Yi-Zhe Song

分类: cs.CV

发布日期: 2024-12-06

备注: Project page available at https://chaitron.github.io/DreamColour-demo

💡 一句话要点

DreamColour:提出一种免训练的可控视频色彩编辑框架,提升编辑质量与效率。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 视频色彩编辑 免训练 空间-时间解耦 运动感知 颜色传播

📋 核心要点

- 现有视频色彩编辑方法要么耗时费力,需要逐帧调整,要么容易产生时间伪影,效果不佳。

- DreamColour通过解耦空间和时间色彩编辑,使用户能够先精确选择关键帧颜色,再自动传播,贴合用户习惯。

- 该方法无需训练或专用硬件,即可达到或超过现有最佳效果,降低了专业视频色彩编辑的门槛。

📝 摘要(中文)

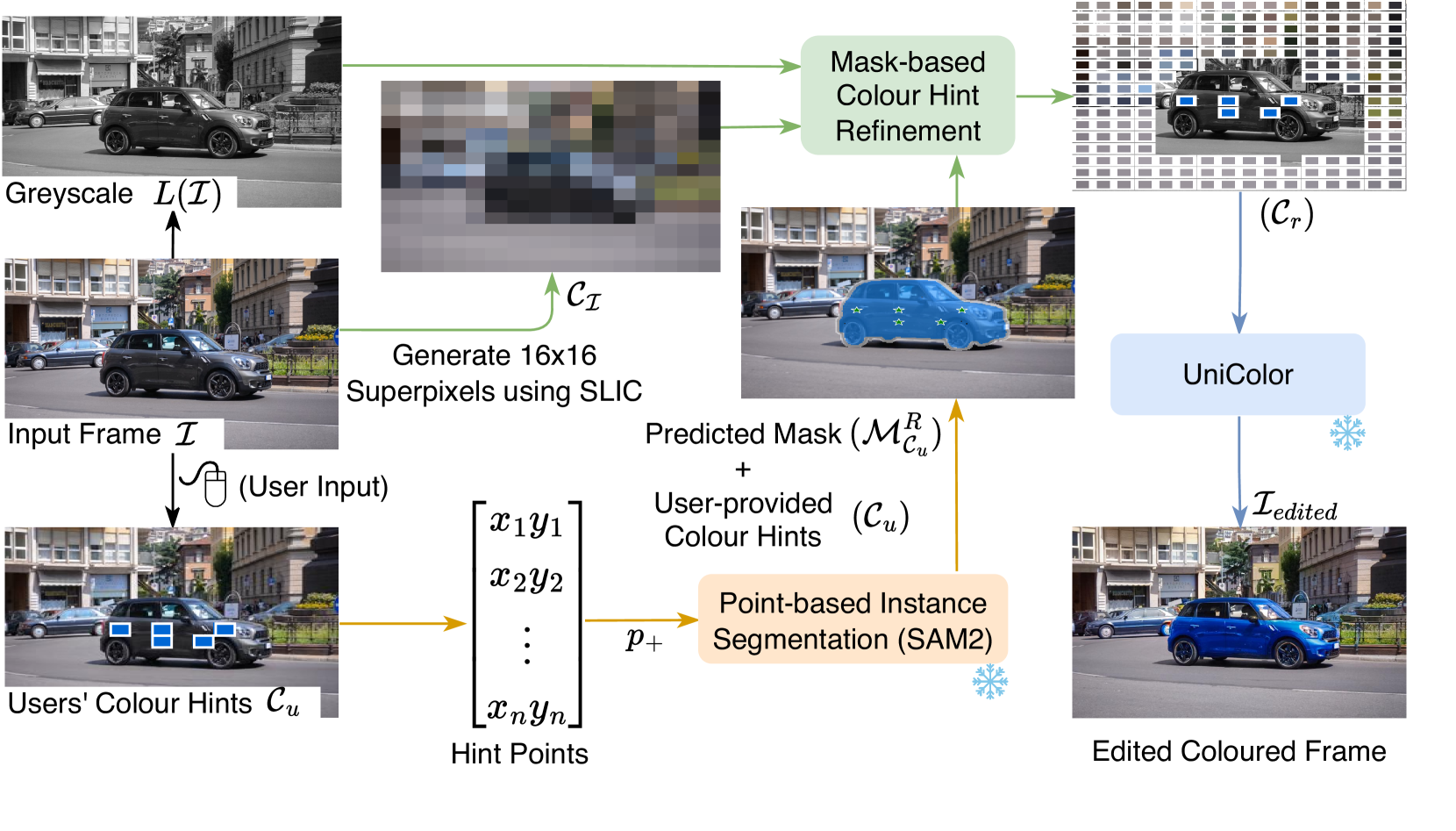

视频色彩编辑是内容创作的关键环节,但现有方法要么需要逐帧手动调整,要么产生不真实的伪影。我们提出了一种实用的、免训练的框架,通过直观的界面实现精确的视频色彩编辑,同时保持专业级的输出质量。核心思想是将色彩编辑的空间和时间方面解耦,从而更好地与用户的自然工作流程对齐——允许用户专注于关键帧中的精确颜色选择,然后自动地在时间上传播更改。我们通过一个新颖的技术框架来实现这一点,该框架结合了:(i)一个简单的点击界面,将基于网格的颜色选择与自动实例分割相结合,以实现精确的空间控制;(ii)利用固有视频运动模式的双向颜色传播;以及(iii)运动感知混合,即使在复杂的物体运动下也能确保平滑过渡。通过对各种场景的广泛评估,我们证明了我们的方法在匹配或超过最先进方法的同时,消除了对训练或专用硬件的需求,使每个人都可以进行专业质量的视频色彩编辑。

🔬 方法详解

问题定义:视频色彩编辑是内容创作的重要组成部分,但现有方法存在局限性。传统方法需要手动逐帧调整颜色,耗时且容易出错。基于学习的方法虽然可以自动化色彩编辑,但通常需要大量的训练数据,并且容易产生时间上的不一致性,导致视频出现闪烁等伪影。因此,如何在保证编辑质量的同时,提高效率,降低对专业知识和硬件的要求,是本论文要解决的核心问题。

核心思路:DreamColour的核心思路是将视频色彩编辑的空间和时间维度解耦。用户首先在关键帧中进行精确的颜色选择(空间维度),然后系统自动将这些颜色变化传播到其他帧(时间维度)。这种解耦使得用户可以专注于关键帧的颜色调整,而无需手动处理每一帧,从而大大提高了编辑效率。同时,通过运动感知的颜色传播和混合,可以减少时间上的不一致性,保证视频的流畅性。

技术框架:DreamColour的技术框架主要包含三个模块:(1) 精确的空间颜色控制:用户通过一个简单的点击界面,结合网格颜色选择和自动实例分割,在关键帧中精确地选择和调整颜色。(2) 双向颜色传播:利用视频中固有的运动模式,将关键帧中的颜色变化双向传播到其他帧。这种双向传播可以更好地处理遮挡和运动模糊等问题。(3) 运动感知混合:通过分析视频中的运动信息,对传播的颜色变化进行混合,从而保证视频在时间上的平滑过渡,减少伪影。

关键创新:DreamColour最重要的技术创新在于其免训练的设计和空间-时间解耦的编辑方式。与需要大量训练数据的基于学习的方法不同,DreamColour无需任何训练,即可实现高质量的视频色彩编辑。空间-时间解耦使得用户可以专注于关键帧的颜色调整,而无需手动处理每一帧,大大提高了编辑效率。此外,运动感知的颜色传播和混合也有效地减少了时间上的不一致性。

关键设计:在空间颜色控制方面,论文采用了一种结合网格颜色选择和自动实例分割的界面。用户可以通过点击网格中的颜色来选择目标颜色,并通过实例分割来精确地控制颜色变化的应用范围。在双向颜色传播方面,论文利用光流估计来跟踪视频中的运动,并将颜色变化沿着运动轨迹进行传播。在运动感知混合方面,论文采用了一种加权平均的方法,根据运动的幅度来调整颜色变化的权重,从而保证视频的平滑过渡。

🖼️ 关键图片

📊 实验亮点

DreamColour在各种场景下进行了广泛的评估,实验结果表明,该方法在色彩编辑质量上可以匹配甚至超过现有的最先进方法,同时无需任何训练或专用硬件。这使得专业质量的视频色彩编辑变得更加容易获得,极大地降低了使用门槛。具体的性能数据和对比基线在论文中有详细的展示。

🎯 应用场景

DreamColour具有广泛的应用前景,可应用于电影制作、广告设计、短视频编辑、游戏开发等领域。它降低了专业视频色彩编辑的门槛,使得普通用户也能轻松制作出高质量的视频内容。未来,该技术有望与AI技术结合,实现更智能化的视频色彩编辑,例如自动根据场景内容调整颜色,或者根据用户的偏好生成个性化的色彩风格。

📄 摘要(原文)

Video colour editing is a crucial task for content creation, yet existing solutions either require painstaking frame-by-frame manipulation or produce unrealistic results with temporal artefacts. We present a practical, training-free framework that makes precise video colour editing accessible through an intuitive interface while maintaining professional-quality output. Our key insight is that by decoupling spatial and temporal aspects of colour editing, we can better align with users' natural workflow -- allowing them to focus on precise colour selection in key frames before automatically propagating changes across time. We achieve this through a novel technical framework that combines: (i) a simple point-and-click interface merging grid-based colour selection with automatic instance segmentation for precise spatial control, (ii) bidirectional colour propagation that leverages inherent video motion patterns, and (iii) motion-aware blending that ensures smooth transitions even with complex object movements. Through extensive evaluation on diverse scenarios, we demonstrate that our approach matches or exceeds state-of-the-art methods while eliminating the need for training or specialized hardware, making professional-quality video colour editing accessible to everyone.