Verb Mirage: Unveiling and Assessing Verb Concept Hallucinations in Multimodal Large Language Models

作者: Zehao Wang, Xinpeng Liu, Yudonglin Zhang, Xiaoqian Wu, Zhou Fang, Yifan Fang, Junfu Pu, Cewu Lu, Yong-Lu Li

分类: cs.CV

发布日期: 2024-12-06 (更新: 2025-12-20)

备注: Accepted by AAAI-26

💡 一句话要点

首次揭示并评估多模态大语言模型中动词概念幻觉现象,并提出知识增强的缓解方法。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 动词幻觉 幻觉缓解 知识增强 微调 视觉理解 动作识别

📋 核心要点

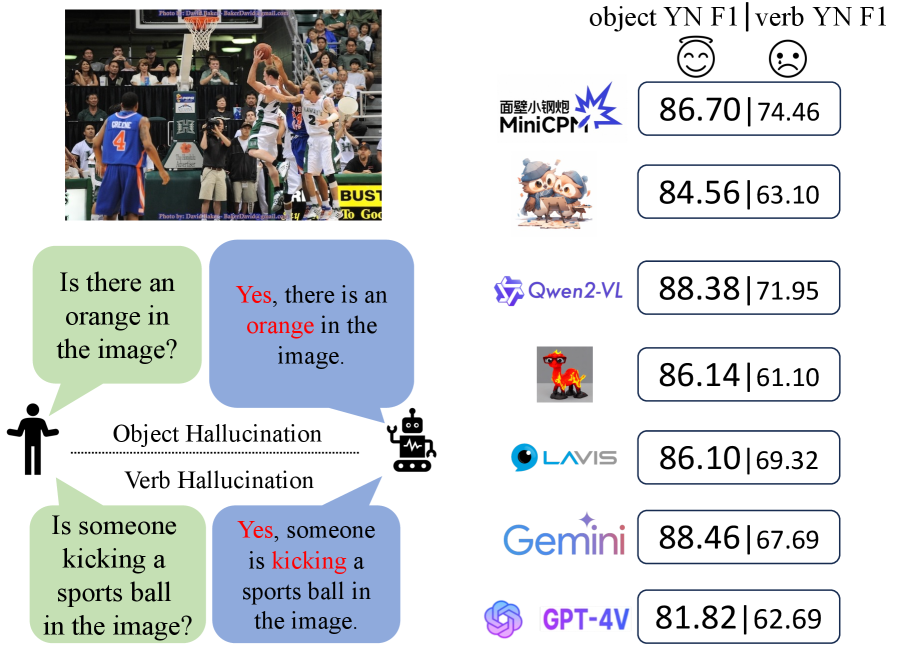

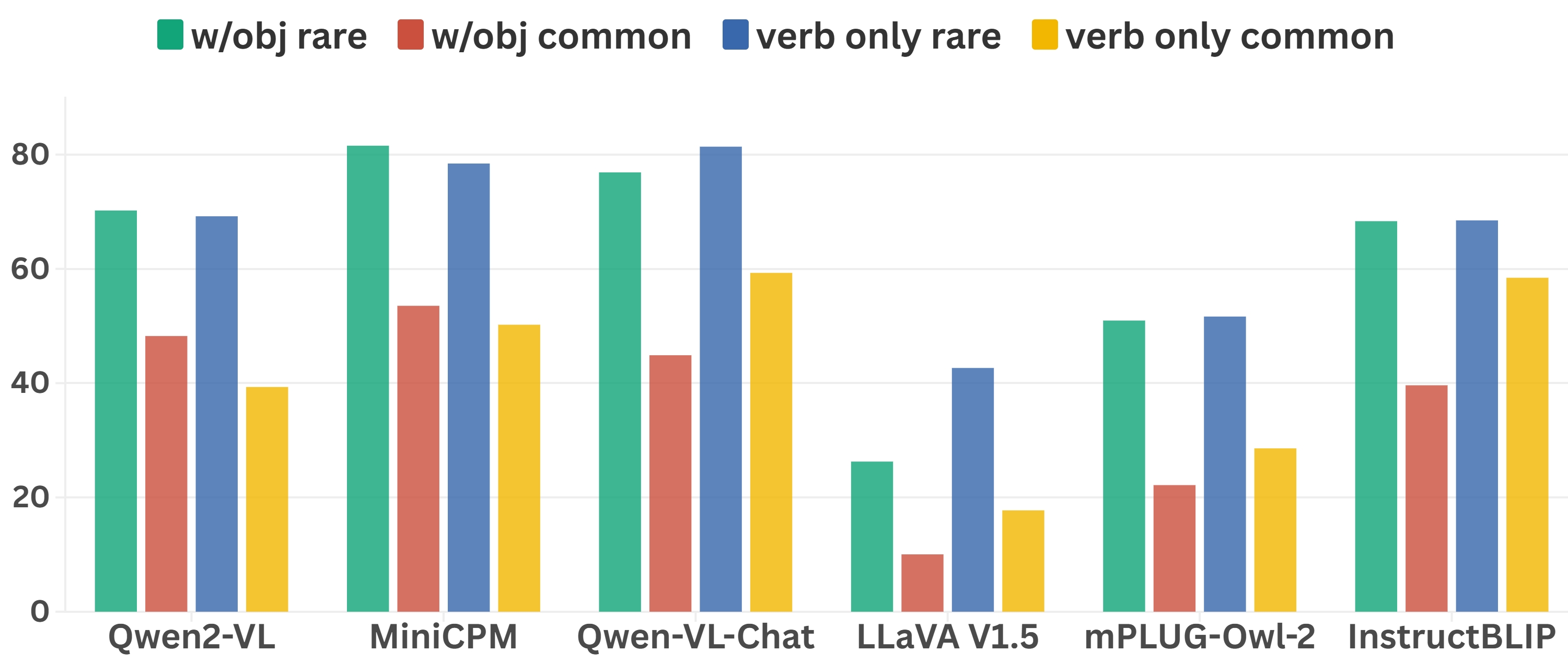

- 现有MLLM幻觉缓解方法主要关注名词/对象,忽略了动词概念,导致模型在理解人类行为时产生幻觉。

- 提出一种基于丰富动词知识的微调方法,旨在通过引入外部知识来减少MLLM中的动词幻觉。

- 实验结果表明,该方法能够显著减少MLLM中与动词相关的幻觉,提升模型对动作的理解能力。

📝 摘要(中文)

多模态大语言模型(MLLMs)近年来备受关注,并在OCR、VQA、图像描述等任务中表现出卓越的能力。然而,幻觉仍然是一个持续存在的问题。虽然已经提出了许多缓解幻觉的方法,并且取得显著的改进,但这些方法主要集中在缓解与对象/名词相关的概念的幻觉。动词概念对于理解人类行为至关重要,但很大程度上被忽视了。在本文中,据我们所知,我们是第一个从各个角度研究MLLM的动词幻觉现象。我们的研究结果表明,大多数最先进的MLLM都存在严重的动词幻觉。为了评估现有的对象概念幻觉缓解方法对动词幻觉的有效性,我们评估了这些方法,发现它们不能有效地解决动词幻觉。为了解决这个问题,我们提出了一种新的基于丰富动词知识的微调方法来缓解动词幻觉。实验结果表明,我们的方法显著减少了与动词相关的幻觉。

🔬 方法详解

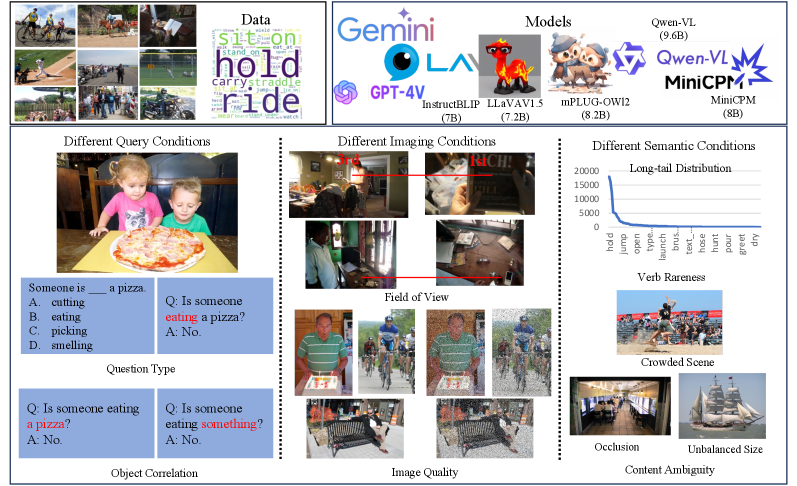

问题定义:论文旨在解决多模态大语言模型(MLLMs)中存在的动词概念幻觉问题。现有的大部分幻觉缓解方法主要关注名词和对象,忽略了动词,导致模型在理解图像或视频中的动作时产生错误的描述或推断。这种动词幻觉会严重影响MLLM在视觉问答、图像描述等任务中的性能。

核心思路:论文的核心思路是通过引入丰富的动词知识来增强MLLM对动词概念的理解,从而减少动词幻觉。具体来说,通过微调的方式,让模型学习动词及其相关属性、关系等知识,使其能够更准确地识别和描述图像或视频中的动作。

技术框架:论文提出的方法主要包含以下几个阶段:1) 构建包含丰富动词知识的数据集,例如动词的定义、同义词、反义词、动作发生的场景等;2) 使用该数据集对预训练的MLLM进行微调,使其学习动词知识;3) 在评估数据集上测试微调后的模型,评估其动词幻觉的程度。整体框架是在现有MLLM的基础上,增加一个动词知识增强的微调阶段。

关键创新:该论文的关键创新在于首次关注并系统性地研究了MLLM中的动词幻觉问题,并提出了一种针对性的缓解方法。与以往主要关注名词/对象幻觉的方法不同,该方法通过引入外部动词知识来增强模型对动作的理解,从而更有效地减少动词幻觉。

关键设计:论文的关键设计包括:1) 如何构建包含丰富动词知识的数据集,例如使用WordNet、ConceptNet等知识库;2) 如何设计微调的目标函数,例如使用对比学习或生成式学习来让模型学习动词知识;3) 如何评估动词幻觉的程度,例如设计专门的评估指标或使用人工评估。

🖼️ 关键图片

📊 实验亮点

该论文首次揭示了MLLM中普遍存在的动词幻觉问题,并证明了现有对象幻觉缓解方法对动词幻觉无效。提出的基于丰富动词知识的微调方法能够显著减少动词幻觉,具体性能提升数据未知,但实验结果表明该方法优于现有基线方法。

🎯 应用场景

该研究成果可应用于提升多模态大语言模型在视频理解、机器人控制、智能监控等领域的性能。例如,在视频理解中,模型可以更准确地识别视频中的动作,从而更好地理解视频内容。在机器人控制中,模型可以更准确地理解人类的指令,从而更好地执行任务。在智能监控中,模型可以更准确地识别异常行为,从而提高安全预警能力。

📄 摘要(原文)

Multimodal Large Language Models (MLLMs) have garnered significant attention recently and demonstrate outstanding capabilities in various tasks such as OCR, VQA, captioning, $\textit{etc}$. However, hallucination remains a persistent issue. While numerous methods have been proposed to mitigate hallucinations, achieving notable improvements, these methods primarily focus on mitigating hallucinations about $\textbf{object/noun-related}$ concepts. Verb concepts, crucial for understanding human actions, have been largely overlooked. In this paper, to the best of our knowledge, we are the $\textbf{first}$ to investigate the $\textbf{verb hallucination}$ phenomenon of MLLMs from various perspectives. Our findings reveal that most state-of-the-art MLLMs suffer from severe verb hallucination. To assess the effectiveness of existing mitigation methods for object concept hallucination on verb hallucination, we evaluated these methods and found that they do not effectively address verb hallucination. To address this issue, we propose a novel rich verb knowledge-based tuning method to mitigate verb hallucination. The experiment results demonstrate that our method significantly reduces hallucinations related to verbs.