EACO: Enhancing Alignment in Multimodal LLMs via Critical Observation

作者: Yongxin Wang, Meng Cao, Haokun Lin, Mingfei Han, Liang Ma, Jin Jiang, Yuhao Cheng, Xiaodan Liang

分类: cs.CV, cs.AI, cs.CL, cs.LG

发布日期: 2024-12-06 (更新: 2024-12-16)

备注: 19 pages

💡 一句话要点

EACO:通过关键观察增强多模态LLM的对齐能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 大型语言模型 对齐 偏好学习 自监督学习 视觉问答 幻觉抑制

📋 核心要点

- 现有MLLM依赖昂贵的人工或专有模型生成高质量关键标签,限制了其对齐和性能提升。

- EACO通过自生成偏好数据,训练Critic模型评估响应,并利用DPO进行对齐,降低了成本。

- 实验表明,EACO显著减少幻觉,提升推理能力,并在多个基准测试中超越现有模型。

📝 摘要(中文)

多模态大型语言模型(MLLM)在视觉问答和推理任务上取得了显著进展,这得益于针对特定数据集的指令微调。它们还可以从人类标注的偏好数据中学习,以增强推理能力并减轻幻觉。大多数偏好数据由模型自身生成。然而,现有方法需要高质量的关键标签,这既昂贵又依赖于人类或像GPT-4V这样的专有模型。本文提出了通过关键观察增强MLLM对齐(EACO)的方法,该方法仅使用5k张图像,通过自生成的偏好数据经济地对齐MLLM。我们的方法首先收集和改进一个评分评估指令微调数据集,以训练一个关键评估模型,称为Critic。这个Critic观察模型在多个维度上的响应,选择首选和非首选的输出,用于改进的直接偏好优化(DPO)调整。为了进一步提高模型性能,我们在偏好调整后采用额外的监督微调阶段。EACO在HallusionBench上减少了65.6%的幻觉,并在MME-Cognition上提高了21.8%的推理能力。EACO在多个基准测试中比LLaVA-v1.6-Mistral-7B提高了8.5%。值得注意的是,EACO还展示了开源MLLM中潜在的关键能力,表明EACO是提高MLLM能力的可行途径。

🔬 方法详解

问题定义:论文旨在解决多模态大型语言模型(MLLM)对齐问题,具体来说,是如何在有限的资源下,有效地利用偏好数据来提升MLLM的推理能力并减少幻觉。现有方法依赖于人工标注或专有模型(如GPT-4V)生成高质量的关键标签,成本高昂且不易获取,限制了开源MLLM的发展。

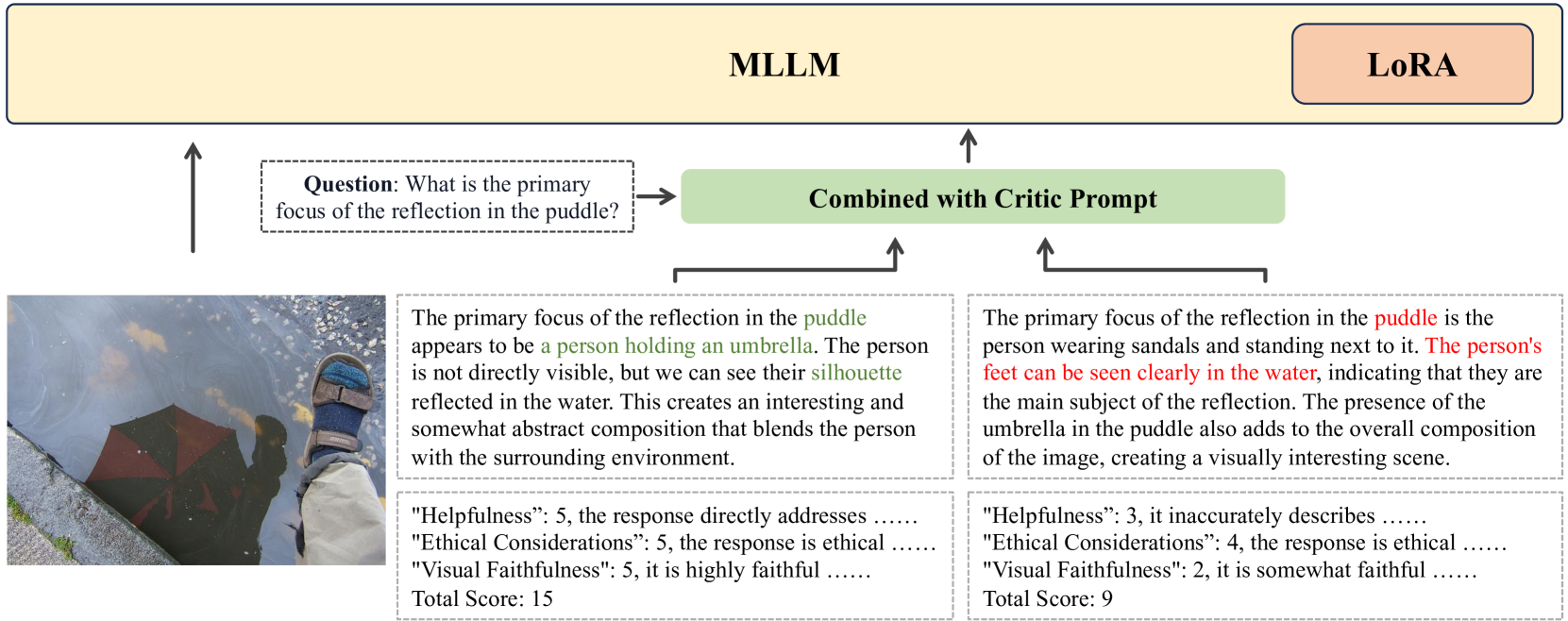

核心思路:论文的核心思路是利用模型自身生成偏好数据,并训练一个Critic模型来评估这些数据,从而实现低成本的MLLM对齐。通过让模型自我反思,并学习区分好坏响应,可以有效地提升模型的推理能力和减少幻觉。这种自监督学习的方式降低了对外部资源的依赖。

技术框架:EACO方法包含以下几个主要阶段:1) 数据收集与精炼:构建一个评分评估指令微调数据集,用于训练Critic模型。2) Critic模型训练:训练Critic模型,使其能够评估MLLM在多个维度上的响应质量。3) 偏好优化:使用Critic模型选择的首选和非首选输出,进行直接偏好优化(DPO)调整。4) 监督微调:在偏好调整后,进行额外的监督微调,进一步提升模型性能。

关键创新:EACO的关键创新在于提出了一个完全基于自生成数据的MLLM对齐方法。与现有方法相比,EACO不需要人工标注或专有模型生成关键标签,大大降低了成本。此外,Critic模型的引入使得偏好数据的选择更加智能和高效。

关键设计:Critic模型的设计至关重要,需要能够准确评估MLLM在多个维度上的响应质量。DPO调整阶段的关键在于如何有效地利用Critic模型选择的偏好数据来更新MLLM的参数。监督微调阶段则可以进一步提升模型的泛化能力和鲁棒性。论文中使用了5k张图像进行训练,并针对不同的任务和数据集进行了参数调整。

🖼️ 关键图片

📊 实验亮点

EACO在HallusionBench上将幻觉减少了65.6%,在MME-Cognition上将推理能力提高了21.8%。在多个基准测试中,EACO比LLaVA-v1.6-Mistral-7B提高了8.5%。这些结果表明,EACO是一种有效的MLLM对齐方法,能够显著提升模型的性能。

🎯 应用场景

EACO方法可应用于各种视觉问答、图像描述和多模态推理任务。该方法降低了MLLM对齐的成本,使得开源社区能够更容易地构建和改进高性能的MLLM。未来,EACO可以扩展到其他多模态任务,例如视频理解和具身智能,并促进相关领域的发展。

📄 摘要(原文)

Multimodal large language models (MLLMs) have achieved remarkable progress on various visual question answering and reasoning tasks leveraging instruction fine-tuning specific datasets. They can also learn from preference data annotated by human to enhance their reasoning ability and mitigate hallucinations. Most of preference data is generated from the model itself. However, existing methods require high-quality critical labels, which are costly and rely on human or proprietary models like GPT-4V. In this work, we propose Enhancing Alignment in MLLMs via Critical Observation (EACO), which aligns MLLMs by self-generated preference data using only 5k images economically. Our approach begins with collecting and refining a Scoring Evaluation Instruction-tuning dataset to train a critical evaluation model, termed the Critic. This Critic observes model responses across multiple dimensions, selecting preferred and non-preferred outputs for refined Direct Preference Optimization (DPO) tuning. To further enhance model performance, we employ an additional supervised fine-tuning stage after preference tuning. EACO reduces the overall hallucinations by 65.6% on HallusionBench and improves the reasoning ability by 21.8% on MME-Cognition. EACO achieves an 8.5% improvement over LLaVA-v1.6-Mistral-7B across multiple benchmarks. Remarkably, EACO also shows the potential critical ability in open-source MLLMs, demonstrating that EACO is a viable path to boost the competence of MLLMs.