Cubify Anything: Scaling Indoor 3D Object Detection

作者: Justin Lazarow, David Griffiths, Gefen Kohavi, Francisco Crespo, Afshin Dehghan

分类: cs.CV

发布日期: 2024-12-05

💡 一句话要点

提出CA-1M数据集与CuTR模型,提升室内3D物体检测在数据规模和精度上的性能。

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 3D物体检测 Transformer 大规模数据集 室内场景理解 深度学习

📋 核心要点

- 现有室内3D物体检测数据集在规模、精度和物体多样性方面存在明显不足,限制了模型性能的进一步提升。

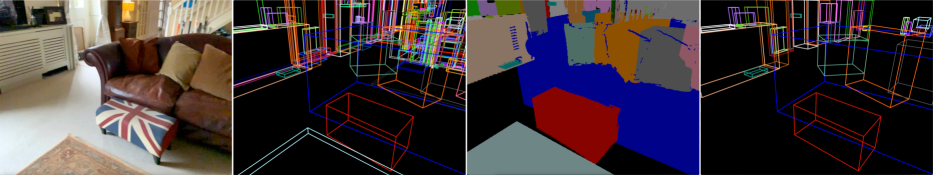

- 提出Cubify Transformer (CuTR)模型,直接从2D特征预测3D框,避免了传统方法中基于点云或体素的3D表示。

- 结合大规模数据集CA-1M,CuTR在3D物体检测任务中超越了基于点的方法,并在噪声处理和纯RGB图像性能上展现出优势。

📝 摘要(中文)

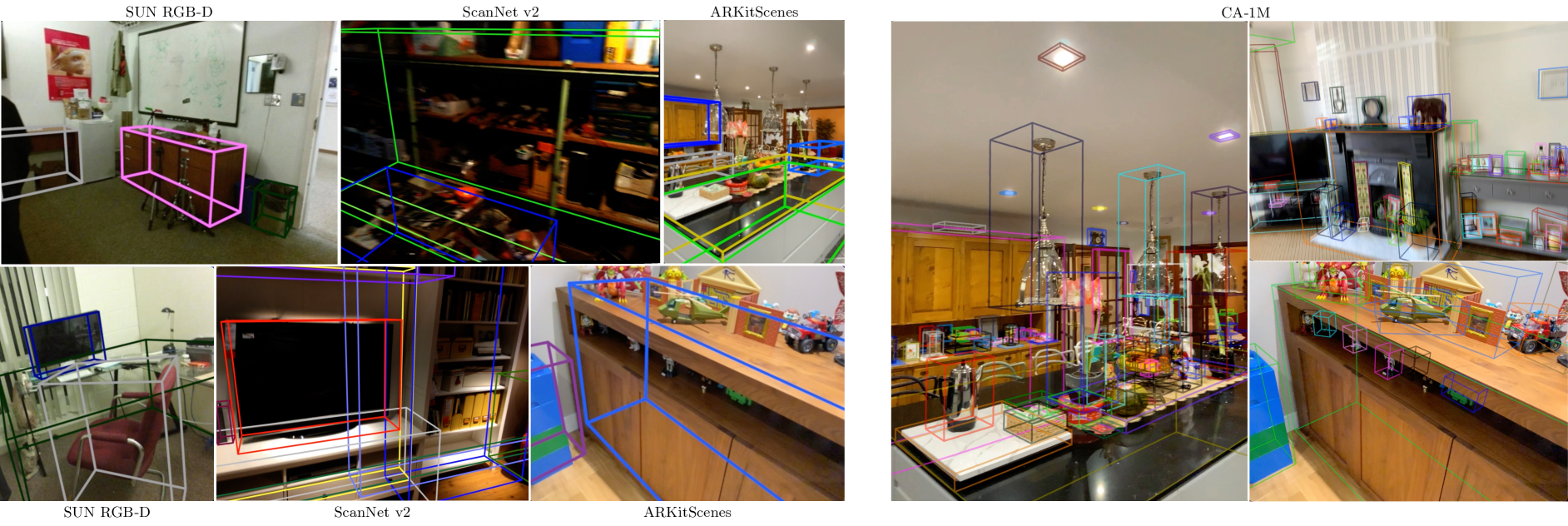

本文针对手持设备采集的单帧RGB(-D)图像进行室内3D物体检测。研究表明,现有数据集在规模、精度和物体多样性方面存在局限性。为此,作者提出了Cubify-Anything 1M (CA-1M)数据集,该数据集在超过1000个高精度激光扫描场景中,详尽标注了超过40万个3D物体,并与超过3500个手持设备的第一人称视角图像进行了近乎完美的配准。此外,作者还提出了Cubify Transformer (CuTR),这是一个完全基于Transformer的3D物体检测基线模型,它直接从RGB(-D)输入的2D特征预测3D框,而非在基于点或体素的3D表示上操作。实验表明,结合CA-1M数据集,CuTR优于基于点的方法,在3D中准确召回超过62%的物体,并且在处理商品级LiDAR深度图中存在的噪声和不确定性方面更具优势,同时在不改变架构的情况下提供了有希望的纯RGB性能。通过在CA-1M上进行预训练,CuTR在更多样化的SUN RGB-D变体上优于基于点的方法,这表明3D中的归纳偏置在现有数据集的小规模下是有用的,但无法扩展到CA-1M的数据丰富状态。总而言之,该数据集和基线模型为我们朝着能够有效“Cubify Anything”的模型迈进提供了强有力的证据。

🔬 方法详解

问题定义:现有室内3D物体检测方法受限于数据集的规模、精度和多样性,导致模型泛化能力不足。同时,基于点云或体素的方法计算复杂度高,对噪声敏感。

核心思路:论文的核心思路是利用大规模、高质量的数据集CA-1M来训练一个完全基于Transformer的3D物体检测模型CuTR。通过直接从2D特征预测3D框,避免了对3D数据的预处理,从而降低了计算复杂度,并提高了对噪声的鲁棒性。

技术框架:CuTR模型的整体架构包含以下几个主要模块:1) 2D特征提取器:从RGB(-D)图像中提取2D特征;2) Transformer编码器:对2D特征进行编码,学习特征之间的关系;3) 3D框预测器:从编码后的特征中预测3D物体框的参数,如中心坐标、尺寸和方向。整个流程是端到端可训练的。

关键创新:CuTR的关键创新在于它完全基于Transformer架构,直接从2D特征预测3D框,无需显式的3D表示。这与传统的基于点云或体素的方法有本质区别,后者需要对3D数据进行预处理,并且计算复杂度较高。

关键设计:CuTR的关键设计包括:1) 使用Transformer编码器来学习2D特征之间的关系,从而提高模型的表达能力;2) 设计合适的损失函数来优化3D框的预测,例如使用Smooth L1损失来回归框的参数,并使用交叉熵损失来分类物体类别;3) 在大规模数据集CA-1M上进行预训练,从而提高模型的泛化能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CuTR模型在CA-1M数据集上取得了显著的性能提升,3D物体召回率超过62%,优于传统的基于点的方法。此外,通过在CA-1M上进行预训练,CuTR在SUN RGB-D数据集上也能超越基于点的方法,证明了大规模数据对于提升模型泛化能力的重要性。即使仅使用RGB图像,CuTR也表现出有竞争力的性能。

🎯 应用场景

该研究成果可应用于机器人导航、智能家居、自动驾驶等领域。通过提升室内3D物体检测的精度和效率,可以帮助机器人更好地理解周围环境,从而实现更智能的交互和决策。此外,该方法在处理噪声和不确定性方面的优势,使其在实际应用中更具鲁棒性。

📄 摘要(原文)

We consider indoor 3D object detection with respect to a single RGB(-D) frame acquired from a commodity handheld device. We seek to significantly advance the status quo with respect to both data and modeling. First, we establish that existing datasets have significant limitations to scale, accuracy, and diversity of objects. As a result, we introduce the Cubify-Anything 1M (CA-1M) dataset, which exhaustively labels over 400K 3D objects on over 1K highly accurate laser-scanned scenes with near-perfect registration to over 3.5K handheld, egocentric captures. Next, we establish Cubify Transformer (CuTR), a fully Transformer 3D object detection baseline which rather than operating in 3D on point or voxel-based representations, predicts 3D boxes directly from 2D features derived from RGB(-D) inputs. While this approach lacks any 3D inductive biases, we show that paired with CA-1M, CuTR outperforms point-based methods - accurately recalling over 62% of objects in 3D, and is significantly more capable at handling noise and uncertainty present in commodity LiDAR-derived depth maps while also providing promising RGB only performance without architecture changes. Furthermore, by pre-training on CA-1M, CuTR can outperform point-based methods on a more diverse variant of SUN RGB-D - supporting the notion that while inductive biases in 3D are useful at the smaller sizes of existing datasets, they fail to scale to the data-rich regime of CA-1M. Overall, this dataset and baseline model provide strong evidence that we are moving towards models which can effectively Cubify Anything.