HANDI: Hand-Centric Text-and-Image Conditioned Video Generation

作者: Yayuan Li, Zhi Cao, Jason J. Corso

分类: cs.CV

发布日期: 2024-12-05 (更新: 2025-07-14)

备注: 16 pages, 7 figures and 4 tables

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

HANDI:提出手部为中心的文本和图像条件视频生成方法,提升动作细节表现。

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 视频生成 扩散模型 手部动作 运动区域生成 手部姿势估计

📋 核心要点

- 现有视频生成方法难以捕捉手部动作等精细的视觉细节,尤其是在复杂环境中。

- 提出一种基于扩散模型的手部中心视频生成方法,自动生成运动区域并优化手部姿势。

- 在EpicKitchens和Ego4D数据集上的实验表明,该方法显著提升了动作清晰度和手部运动的真实性。

📝 摘要(中文)

尽管视频生成领域取得了显著进展,但现有方法在视觉细节方面仍然存在不足。一个特别具有挑战性的例子是,需要手部的复杂运动以及相对稳定但分散注意力的环境来传达复杂动作的执行及其效果的视频。为了解决这些挑战,我们提出了一种新的视频生成方法,专注于以手部为中心的动作。我们的基于扩散的方法包含两个独特的创新点。首先,我们提出了一种自动生成运动区域的方法——视频中发生详细活动的区域——该区域由视觉上下文和动作文本提示引导,而不是像现在常见的假设那样手动提供该区域。其次,我们引入了一个关键的手部细化损失,以引导扩散模型专注于平滑和一致的手部姿势。我们在基于EpicKitchens和Ego4D的具有挑战性的增强数据集上评估了我们的方法,结果表明,在不同环境和动作中,我们的方法在动作清晰度方面,特别是目标区域中手部运动的清晰度方面,相比最先进的方法有了显著的改进。视频结果可以在https://excitedbutter.github.io/project_page找到。

🔬 方法详解

问题定义:现有视频生成方法在处理需要精细手部动作的视频时表现不佳。这些视频通常包含复杂的背景,使得模型难以关注手部动作的细节。手动标注运动区域成本高昂且不实用。

核心思路:该论文的核心思路是设计一个以手部为中心的视频生成框架,通过自动生成运动区域和引入手部细化损失来提升手部动作的清晰度和真实性。通过关注手部区域,模型可以更好地学习和生成复杂的手部动作。

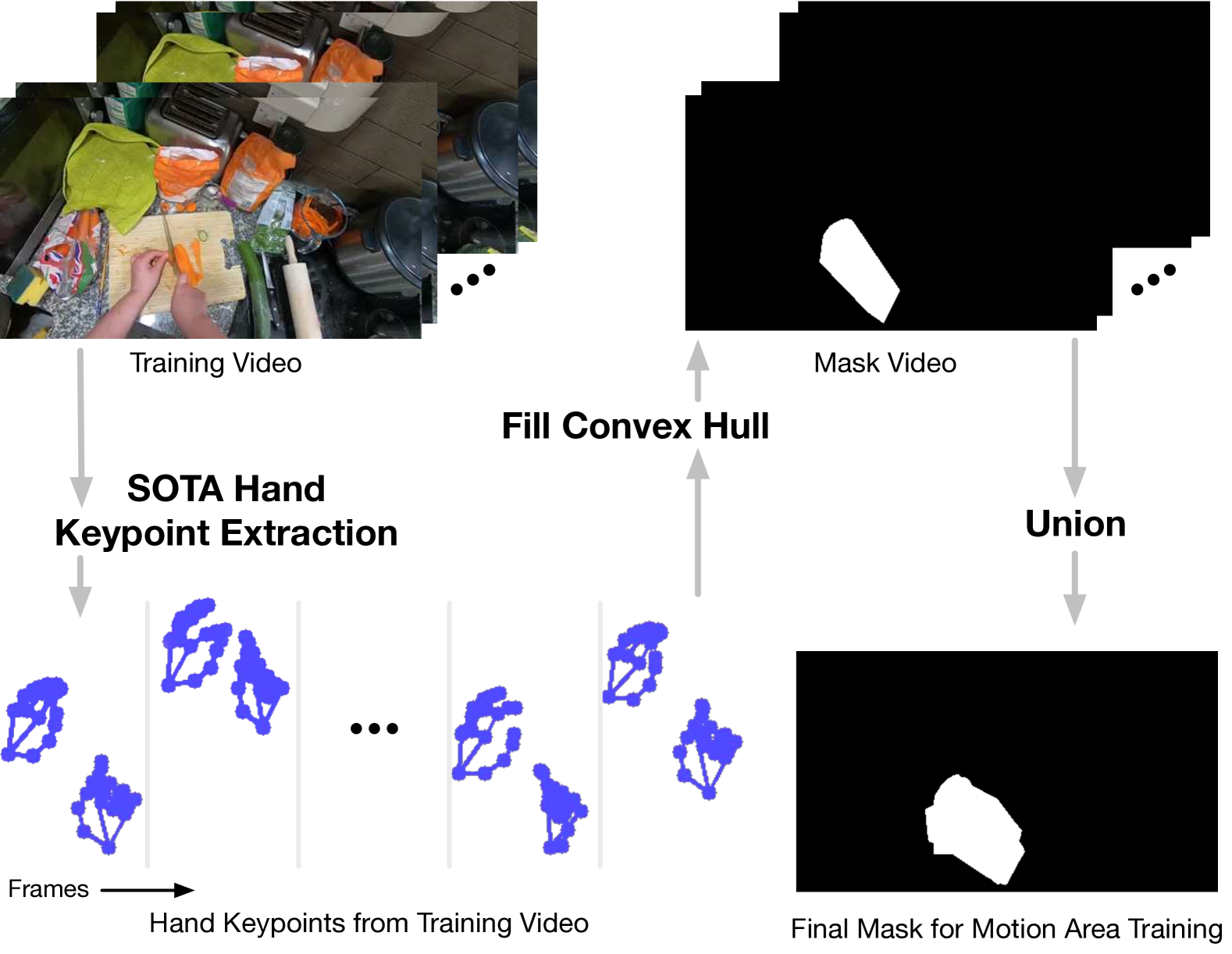

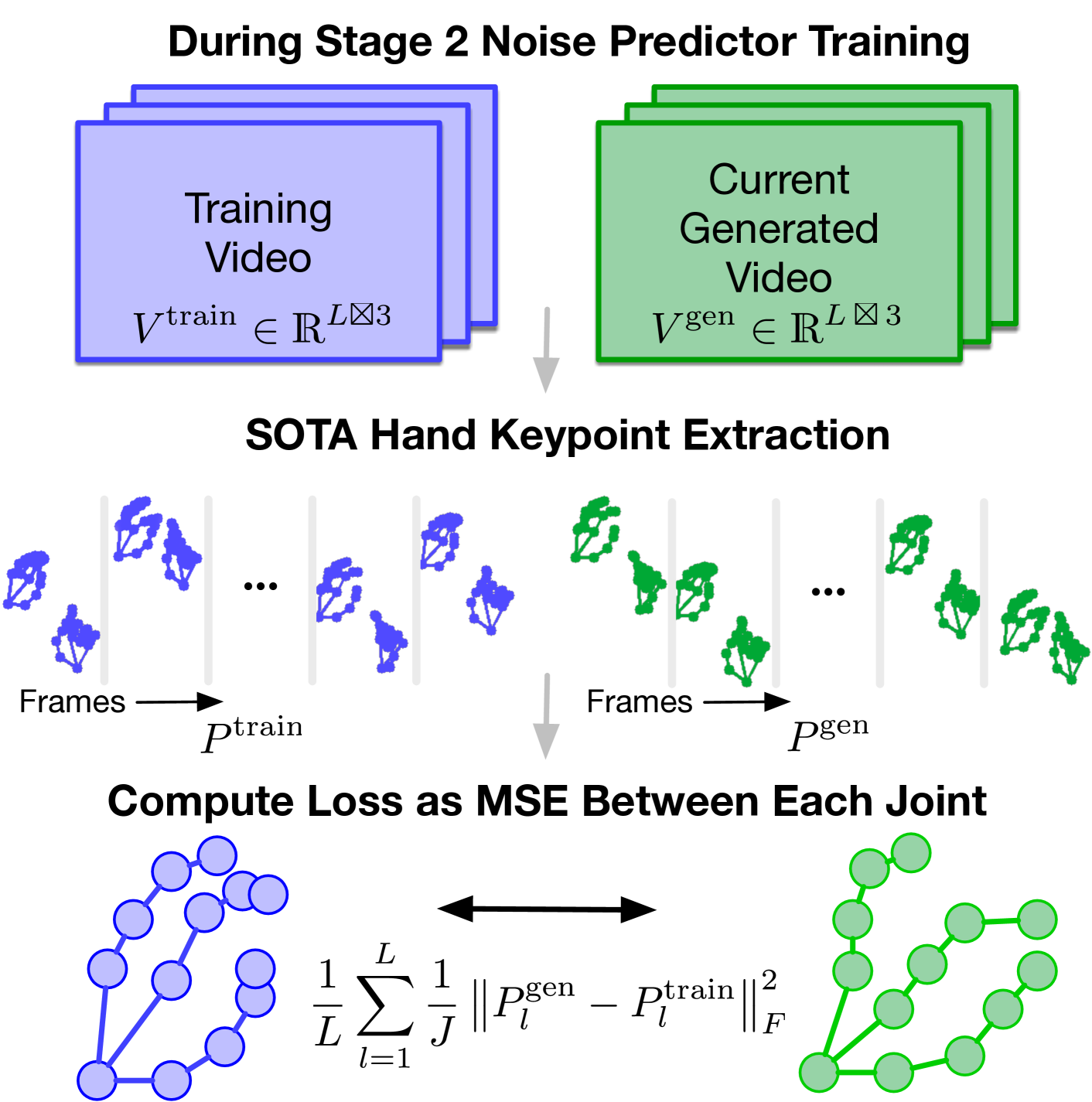

技术框架:该方法基于扩散模型,整体流程包括:1) 接收文本和图像作为输入;2) 自动生成运动区域,确定需要关注的视频区域;3) 使用扩散模型生成视频,并利用手部细化损失优化手部姿势。该框架包含运动区域生成模块和视频生成模块,两者协同工作以生成高质量的手部动作视频。

关键创新:该论文的关键创新在于:1) 提出了一种自动生成运动区域的方法,无需手动标注;2) 引入了手部细化损失,引导扩散模型专注于生成平滑和一致的手部姿势。这两个创新共同提升了手部动作的真实感和清晰度。

关键设计:运动区域生成模块利用视觉上下文和文本提示来预测运动区域。手部细化损失基于手部关键点,鼓励生成的手部姿势与真实姿势一致。扩散模型采用U-Net结构,并针对视频生成进行了优化。具体的损失函数包括L1损失、对抗损失和手部细化损失。网络结构和参数设置根据实验结果进行调整。

🖼️ 关键图片

📊 实验亮点

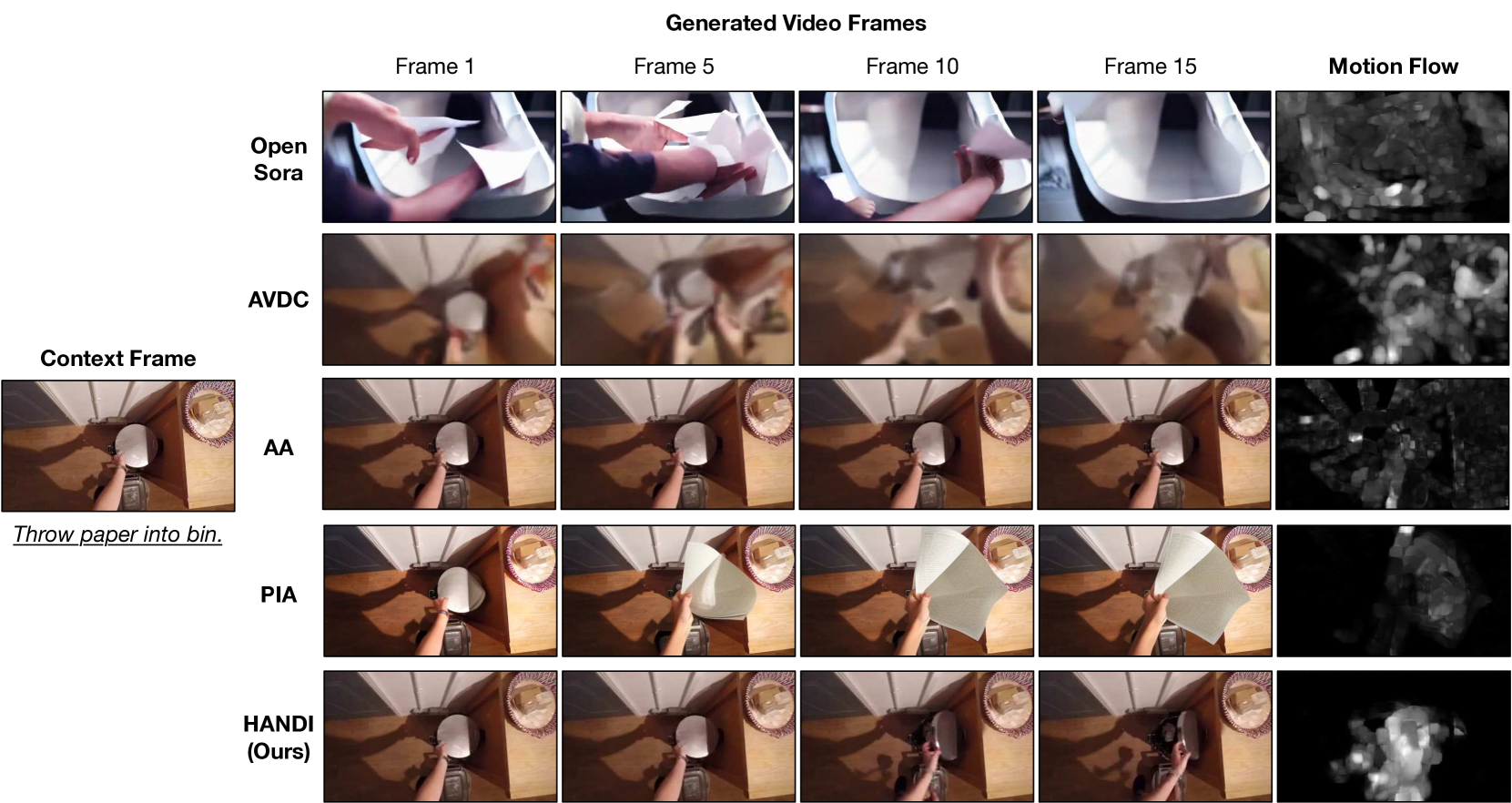

该方法在EpicKitchens和Ego4D数据集上取得了显著的性能提升。实验结果表明,该方法在动作清晰度方面优于现有方法,尤其是在手部运动的细节方面。通过定量指标和定性评估,证明了自动运动区域生成和手部细化损失的有效性。具体性能数据未知,但摘要强调了“significant improvements”。

🎯 应用场景

该研究成果可应用于人机交互、虚拟现实、机器人控制等领域。例如,可以用于生成逼真的人手操作视频,用于训练机器人完成复杂任务,或用于创建更具沉浸感的虚拟现实体验。此外,该技术还可以用于视频编辑和内容创作,自动生成高质量的手部动作视频。

📄 摘要(原文)

Despite the recent strides in video generation, state-of-the-art methods still struggle with elements of visual detail. One particularly challenging case is the class of videos in which the intricate motion of the hand coupled with a mostly stable and otherwise distracting environment is necessary to convey the execution of some complex action and its effects. To address these challenges, we introduce a new method for video generation that focuses on hand-centric actions. Our diffusion-based method incorporates two distinct innovations. First, we propose an automatic method to generate the motion area -- the region in the video in which the detailed activities occur -- guided by both the visual context and the action text prompt, rather than assuming this region can be provided manually as is now commonplace. Second, we introduce a critical Hand Refinement Loss to guide the diffusion model to focus on smooth and consistent hand poses. We evaluate our method on challenging augmented datasets based on EpicKitchens and Ego4D, demonstrating significant improvements over state-of-the-art methods in terms of action clarity, especially of the hand motion in the target region, across diverse environments and actions. Video results can be found in https://excitedbutter.github.io/project_page