ARCON: Advancing Auto-Regressive Continuation for Driving Videos

作者: Ruibo Ming, Jingwei Wu, Zhewei Huang, Zhuoxuan Ju, Jianming HU, Lihui Peng, Shuchang Zhou

分类: cs.CV

发布日期: 2024-12-04 (更新: 2025-02-26)

💡 一句话要点

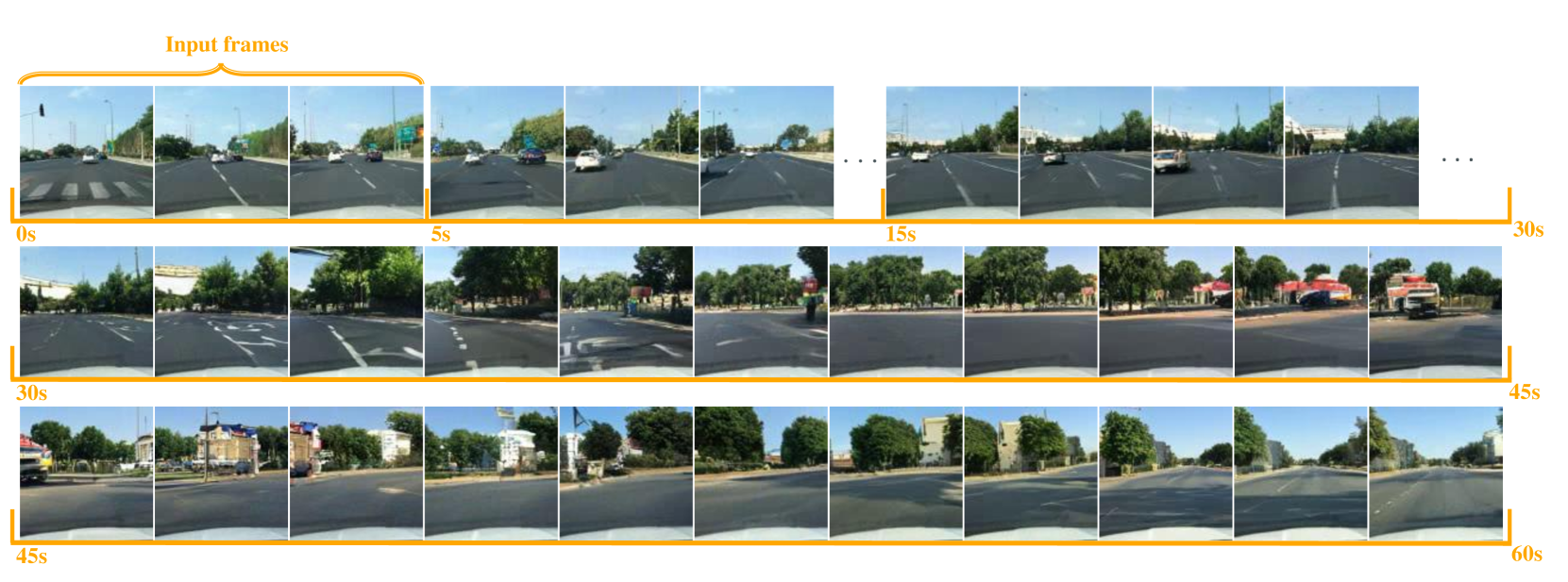

ARCON:提出一种用于自动驾驶视频延续的自回归方案,提升长时视频生成一致性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频延续 自回归模型 大型视觉模型 自动驾驶 语义分割 光流估计 视频生成 世界模型

📋 核心要点

- 现有视频生成方法难以保证长时视频生成的一致性,尤其是在自动驾驶等复杂场景下。

- ARCON方案通过交替生成语义和RGB tokens,使模型能够显式学习视频的结构化信息,从而提升生成一致性。

- 实验表明,ARCON在自动驾驶场景下能够生成高质量、长时一致的视频,并利用光流增强视觉效果。

📝 摘要(中文)

本文探索了大型视觉模型(LVM)在视频延续任务中的应用,该任务对于构建世界模型和预测未来帧至关重要。我们提出了一种名为ARCON的方案,它交替生成语义和RGB tokens,使LVM能够显式地学习高层次的结构化视频信息。实验表明,在没有特殊设计的情况下,生成的RGB图像和语义图具有高度一致性。此外,我们采用了一种基于光流的纹理拼接方法来增强视觉质量。在自动驾驶场景中的实验表明,我们的模型能够持续生成长视频。

🔬 方法详解

问题定义:论文旨在解决自动驾驶场景下长视频延续问题。现有方法在生成长视频时,容易出现内容不一致、画面抖动等问题,难以保证视频的连贯性和真实感。这些问题限制了世界模型的构建和未来帧预测的准确性。

核心思路:ARCON的核心思路是利用大型视觉模型(LVM)的强大表征能力,通过交替生成语义tokens和RGB tokens,显式地建模视频的结构化信息。语义tokens捕捉视频的高层语义信息,RGB tokens负责生成具体的图像细节。这种交替生成的方式,能够使模型更好地理解视频内容,从而生成更连贯、更真实的视频。

技术框架:ARCON的整体框架包含以下几个主要模块:1) 语义编码器:将输入视频帧编码为语义tokens;2) RGB编码器:将输入视频帧编码为RGB tokens;3) 自回归生成器:交替生成语义tokens和RGB tokens,预测未来帧;4) 纹理拼接模块:利用光流信息,对生成的RGB图像进行纹理拼接,提升视觉质量。整个流程首先对输入视频进行编码,然后通过自回归生成器预测未来帧,最后利用纹理拼接模块提升视觉效果。

关键创新:ARCON的关键创新在于交替生成语义和RGB tokens的自回归生成方案。与传统的直接生成RGB图像的方法相比,ARCON能够显式地建模视频的结构化信息,从而提升生成视频的一致性和真实感。此外,ARCON还引入了基于光流的纹理拼接模块,进一步提升了生成视频的视觉质量。

关键设计:在ARCON中,语义编码器和RGB编码器可以使用现有的视觉模型,例如ViT或CNN。自回归生成器可以使用Transformer架构,通过注意力机制建模tokens之间的关系。纹理拼接模块利用光流信息,将相邻帧的纹理信息进行融合,从而减少画面抖动,提升视觉效果。损失函数可以包括重构损失、对抗损失等,用于约束生成视频的质量。

🖼️ 关键图片

📊 实验亮点

论文在自动驾驶场景下进行了实验,结果表明ARCON能够生成高质量、长时一致的视频。与基线方法相比,ARCON在视频生成质量和一致性方面均有显著提升。通过定量指标和视觉效果对比,验证了ARCON的有效性。此外,光流纹理拼接模块进一步提升了生成视频的视觉质量。

🎯 应用场景

ARCON在自动驾驶领域具有广泛的应用前景,例如可以用于自动驾驶仿真、未来场景预测、以及驾驶辅助系统。通过预测未来视频帧,ARCON可以帮助自动驾驶系统更好地理解周围环境,从而做出更安全、更合理的决策。此外,ARCON还可以应用于游戏、电影等领域,用于生成高质量的视频内容。

📄 摘要(原文)

Recent advancements in auto-regressive large language models (LLMs) have led to their application in video generation. This paper explores the use of Large Vision Models (LVMs) for video continuation, a task essential for building world models and predicting future frames. We introduce ARCON, a scheme that alternates between generating semantic and RGB tokens, allowing the LVM to explicitly learn high-level structural video information. We find high consistency in the RGB images and semantic maps generated without special design. Moreover, we employ an optical flow-based texture stitching method to enhance visual quality. Experiments in autonomous driving scenarios show that our model can consistently generate long videos.