Dense Scene Reconstruction from Light-Field Images Affected by Rolling Shutter

作者: Hermes McGriff, Renato Martins, Nicolas Andreff, Cedric Demonceaux

分类: cs.CV

发布日期: 2024-12-04

🔗 代码/项目: GITHUB

💡 一句话要点

提出一种基于高斯溅射的光场图像稠密重建方法,可补偿卷帘快门效应

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 光场图像 稠密重建 卷帘快门 高斯溅射 深度估计

📋 核心要点

- 现有光场图像深度估计方法难以处理卷帘快门效应,导致重建精度下降。

- 该方法利用2D高斯溅射,通过“渲染和比较”策略,分阶段估计RS无关的3D形状和相机运动。

- 实验结果表明,该方法在不同场景和运动类型下均有效,并提供了一个新的合成RS光场图像数据集。

📝 摘要(中文)

本文提出了一种从受卷帘快门(RS)效应影响的光场(LF)图像中进行稠密深度估计的方法,该方法能够补偿强烈的RS效应。我们的方法估计RS补偿视图和稠密的RS补偿视差图。我们提出了一种基于2D高斯溅射的两阶段方法,该方法允许使用点云公式进行“渲染和比较”策略。在第一阶段,使用子孔径图像的子集来估计与场景目标形状“高达一个运动”相关的RS无关的3D形状。在第二阶段,通过估计允许的相机运动来计算3D形状的变形。我们通过针对不同场景和运动类型进行的多个实验证明了该方法的有效性和优势。由于缺乏合适的评估数据集,我们还提出了一个新的精心设计的RS LF图像合成数据集。源代码、训练模型和数据集将在https://github.com/ICB-Vision-AI/DenseRSLF上公开。

🔬 方法详解

问题定义:论文旨在解决卷帘快门效应对光场图像稠密三维重建的影响。传统光场重建方法通常假设全局快门,当存在卷帘快门效应时,图像的不同行在不同时间曝光,导致图像扭曲,严重影响深度估计的准确性。现有方法难以有效补偿这种时变畸变。

核心思路:该方法的核心思路是分两阶段估计场景的3D结构和相机运动。首先,利用部分子孔径图像估计一个与卷帘快门无关的初始3D形状。然后,通过估计相机运动来校正这个初始形状的变形,从而补偿卷帘快门效应。这种分阶段的方法允许分别处理静态场景结构和动态相机运动,简化了优化过程。

技术框架:该方法包含两个主要阶段: 1. RS无关的3D形状估计:使用部分子孔径图像,通过2D高斯溅射技术,构建场景的初始3D点云表示。这个阶段的目标是获得一个不受卷帘快门影响的粗略3D结构。 2. RS补偿的相机运动估计:通过估计相机运动来校正第一阶段得到的3D形状的变形。这个阶段使用“渲染和比较”策略,将估计的3D点云渲染成图像,并与实际的卷帘快门光场图像进行比较,通过优化相机运动参数来最小化渲染图像和真实图像之间的差异。

关键创新:该方法的主要创新在于将2D高斯溅射技术应用于卷帘快门光场图像的稠密重建,并提出了一种分阶段的优化策略。与传统方法相比,该方法能够有效地分离静态场景结构和动态相机运动,从而更好地补偿卷帘快门效应。此外,该方法还提出了一个新的合成数据集,为卷帘快门光场图像重建的研究提供了基准。

关键设计: * 2D高斯溅射:使用2D高斯函数来表示3D点云,允许高效的渲染和优化。 * “渲染和比较”策略:通过比较渲染图像和真实图像之间的差异来优化相机运动参数。 * 损失函数:使用光度一致性损失来衡量渲染图像和真实图像之间的相似度。 * 数据集:精心设计的合成数据集,包含不同场景和运动类型的卷帘快门光场图像。

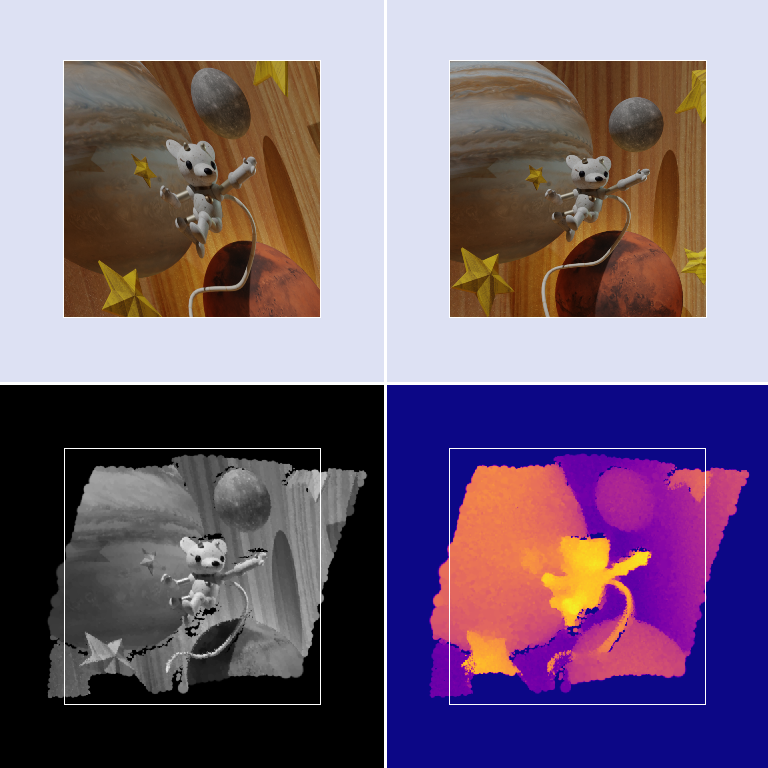

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在合成数据集上能够有效地补偿卷帘快门效应,显著提高光场图像的稠密重建精度。与现有方法相比,该方法在不同场景和运动类型下均表现出更强的鲁棒性和更高的重建质量。此外,该论文还提供了一个新的合成数据集,为后续研究提供了基准。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、虚拟现实等领域。在这些场景中,相机运动可能导致卷帘快门效应,影响三维重建的精度。该方法能够有效补偿这种效应,提高重建质量,从而提升相关应用系统的性能和鲁棒性。未来,该技术有望进一步推广到其他类型的图像传感器和更复杂的运动场景。

📄 摘要(原文)

This paper presents a dense depth estimation approach from light-field (LF) images that is able to compensate for strong rolling shutter (RS) effects. Our method estimates RS compensated views and dense RS compensated disparity maps. We present a two-stage method based on a 2D Gaussians Splatting that allows for a

render and compare" strategy with a point cloud formulation. In the first stage, a subset of sub-aperture images is used to estimate an RS agnostic 3D shape that is related to the scene target shapeup to a motion". In the second stage, the deformation of the 3D shape is computed by estimating an admissible camera motion. We demonstrate the effectiveness and advantages of this approach through several experiments conducted for different scenes and types of motions. Due to lack of suitable datasets for evaluation, we also present a new carefully designed synthetic dataset of RS LF images. The source code, trained models and dataset will be made publicly available at: https://github.com/ICB-Vision-AI/DenseRSLF