Hijacking Vision-and-Language Navigation Agents with Adversarial Environmental Attacks

作者: Zijiao Yang, Xiangxi Shi, Eric Slyman, Stefan Lee

分类: cs.CV, cs.RO

发布日期: 2024-12-03

备注: Accepted by WACV 2025

💡 一句话要点

提出对抗环境攻击方法,劫持视觉语言导航智能体行为

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言导航 对抗攻击 环境攻击 具身智能体 白盒攻击

📋 核心要点

- 现有视觉语言导航智能体易受环境干扰,缺乏鲁棒性,可能导致任务失败。

- 提出一种白盒对抗攻击方法,通过优化3D攻击对象的外观,诱导智能体产生非预期行为。

- 实验证明,该攻击能有效劫持智能体行为,使其偏离预定路径或提前终止任务。

📝 摘要(中文)

本文研究了如何通过对智能体操作环境进行局部外观修改来劫持辅助具身智能体的行为。以视觉语言导航(VLN)任务为例,开发了一种白盒对抗攻击,该攻击优化了3D攻击对象的外观,以诱导预训练的VLN智能体在环境中观察到该对象后产生期望的行为。实验表明,该攻击可以使VLN智能体忽略其指令并执行替代动作,即使对于优化攻击时未考虑的指令和智能体路径也是如此。在这些新环境中,发现攻击可以诱导提前终止行为或将智能体转移到攻击者定义的多步轨迹上。在这两种情况下,环境攻击都会显著降低智能体成功遵循用户指令的能力。

🔬 方法详解

问题定义:现有视觉语言导航(VLN)智能体在开放世界环境中执行任务时,容易受到环境因素的干扰,特别是环境外观的微小变化。这些变化可能导致智能体错误理解指令,从而偏离预定路径或提前终止任务。现有方法缺乏对这种环境干扰的鲁棒性,使得智能体在实际应用中面临安全风险。

核心思路:本文的核心思路是通过设计一种对抗性的3D对象,并优化其外观,使得当VLN智能体观察到该对象时,会产生攻击者期望的行为。这种攻击利用了智能体视觉感知和语言理解之间的脆弱性,通过改变环境中的视觉信息来影响智能体的决策过程。

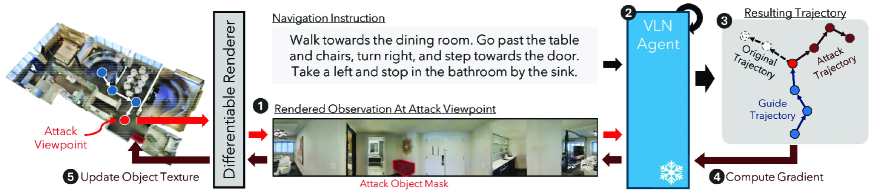

技术框架:该方法采用白盒攻击的方式,即攻击者可以访问智能体的模型参数和训练数据。攻击流程包括以下几个步骤:首先,在环境中放置一个可操控的3D对象。然后,通过优化算法调整该对象的外观(例如颜色、纹理等),使得智能体在观察到该对象后,执行攻击者期望的动作。优化目标是最大化智能体偏离预定路径的程度或提前终止任务的概率。

关键创新:该方法的关键创新在于提出了一种针对VLN智能体的环境对抗攻击策略。与传统的对抗样本攻击不同,该方法不是直接修改输入图像,而是通过改变环境中的物理对象来影响智能体的行为。这种攻击方式更贴近现实场景,也更难以防御。

关键设计:攻击对象的外观优化采用梯度下降算法,损失函数的设计需要考虑智能体的行为和攻击目标。例如,如果要使智能体偏离预定路径,损失函数可以定义为智能体当前位置与目标位置之间的距离。此外,为了保证攻击的隐蔽性,可以添加正则化项,限制攻击对象外观的变化幅度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该对抗攻击能够显著降低VLN智能体成功遵循用户指令的能力。在未进行攻击的情况下,智能体能够以较高的成功率完成导航任务。然而,在引入对抗攻击后,智能体经常会忽略指令,执行错误的动作,甚至提前终止任务。攻击成功率在某些情况下可达较高水平,证明了该攻击的有效性。

🎯 应用场景

该研究成果可应用于评估和提升视觉语言导航智能体的鲁棒性。通过模拟对抗环境攻击,可以发现智能体的脆弱点,并开发相应的防御机制。此外,该研究也提醒人们在部署智能体时需要考虑潜在的安全风险,例如恶意攻击者可能通过篡改环境来控制智能体的行为,从而造成财产损失或人身伤害。

📄 摘要(原文)

Assistive embodied agents that can be instructed in natural language to perform tasks in open-world environments have the potential to significantly impact labor tasks like manufacturing or in-home care -- benefiting the lives of those who come to depend on them. In this work, we consider how this benefit might be hijacked by local modifications in the appearance of the agent's operating environment. Specifically, we take the popular Vision-and-Language Navigation (VLN) task as a representative setting and develop a whitebox adversarial attack that optimizes a 3D attack object's appearance to induce desired behaviors in pretrained VLN agents that observe it in the environment. We demonstrate that the proposed attack can cause VLN agents to ignore their instructions and execute alternative actions after encountering the attack object -- even for instructions and agent paths not considered when optimizing the attack. For these novel settings, we find our attacks can induce early-termination behaviors or divert an agent along an attacker-defined multi-step trajectory. Under both conditions, environmental attacks significantly reduce agent capabilities to successfully follow user instructions.