GSGTrack: Gaussian Splatting-Guided Object Pose Tracking from RGB Videos

作者: Zhiyuan Chen, Fan Lu, Guo Yu, Bin Li, Sanqing Qu, Yuan Huang, Changhong Fu, Guang Chen

分类: cs.CV, cs.RO

发布日期: 2024-12-03

💡 一句话要点

GSGTrack:基于高斯溅射的RGB视频物体姿态跟踪

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 物体姿态跟踪 6DoF姿态估计 3D高斯溅射 单目RGB视频 几何优化 机器人操作 计算机视觉

📋 核心要点

- 现有方法依赖精确深度信息,但在真实场景中难以获取,深度估计算法的几何不准确性会导致RGBD方法失效。

- GSGTrack联合优化几何与姿态,利用3D高斯溅射构建可优化3D表示,并结合图优化细化几何形状。

- 引入轮廓损失降低姿态噪声敏感性,提出几何一致图像对选择策略,提升几何优化鲁棒性,并在数据集上验证有效性。

📝 摘要(中文)

本文提出GSGTrack,一种新颖的基于RGB视频的物体姿态跟踪框架,用于联合优化几何和姿态,解决单目RGB视频中未知物体6DoF姿态跟踪问题。该方法采用3D高斯溅射创建可优化的3D表示,同时学习基于图的几何优化,以捕获物体的外观特征并细化其几何形状。为了解决联合优化过程中噪声姿态和几何数据引起的扰动问题,提出了物体轮廓损失,以解决像素级损失对跟踪过程中姿态噪声过于敏感的问题。为了缓解不准确深度信息造成的几何歧义,提出了一种几何一致的图像对选择策略,该策略过滤掉低置信度的图像对,并确保鲁棒的几何优化。在OnePose和HO3D数据集上的大量实验证明了GSGTrack在6DoF姿态跟踪和物体重建方面的有效性。

🔬 方法详解

问题定义:现有基于RGBD的物体姿态跟踪方法依赖于精确的深度信息,但在真实场景中,深度信息的获取往往具有挑战性。即使采用深度估计算法,其几何不准确性也会导致姿态跟踪失败。因此,如何在单目RGB视频中实现对未知物体的鲁棒6DoF姿态跟踪是一个关键问题。

核心思路:GSGTrack的核心思路是联合优化物体的几何形状和姿态,避免对精确深度信息的依赖。通过3D高斯溅射(3D Gaussian Splatting)构建可优化的3D表示,并结合图优化方法,在学习物体外观特征的同时,不断细化其几何形状。这种联合优化策略能够提升姿态跟踪的准确性和鲁棒性。

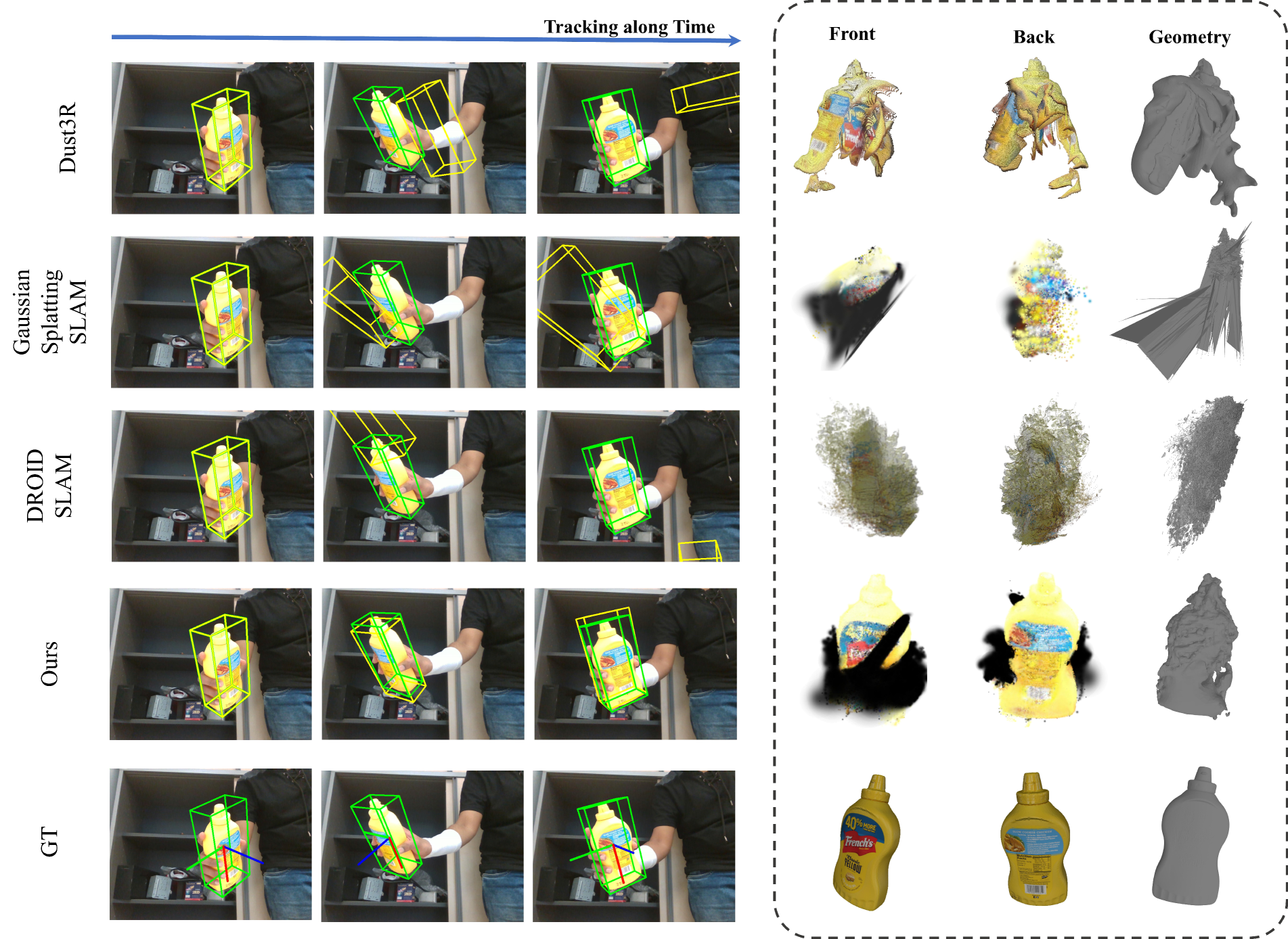

技术框架:GSGTrack框架主要包含以下几个关键模块:1) 3D高斯溅射表示:使用3D高斯溅射来表示物体的3D结构和外观。2) 基于图的几何优化:构建图结构来优化高斯溅射的几何参数,从而提高3D表示的准确性。3) 物体轮廓损失:用于约束姿态估计,降低像素级损失对噪声的敏感性。4) 几何一致的图像对选择:过滤掉低质量的图像对,保证几何优化的稳定性。整个流程通过联合优化高斯溅射参数、图结构和姿态来实现精确的物体姿态跟踪。

关键创新:GSGTrack的关键创新在于:1) 提出了一种基于RGB视频的联合几何与姿态优化框架,无需依赖精确的深度信息。2) 引入了物体轮廓损失,降低了姿态噪声对像素级损失的影响,提高了跟踪的鲁棒性。3) 设计了几何一致的图像对选择策略,过滤掉低质量图像对,保证了几何优化的稳定性。与现有方法相比,GSGTrack在单目RGB视频中实现了更准确、更鲁棒的物体姿态跟踪。

关键设计:1) 3D高斯溅射的参数化表示,包括位置、协方差矩阵、颜色等。2) 基于图的几何优化中,图的节点表示高斯溅射,边表示高斯溅射之间的几何关系。3) 物体轮廓损失的计算方式,通常基于预测的物体掩码与真实掩码之间的差异。4) 几何一致性图像对选择策略,例如,基于图像对之间的视点差异和特征匹配质量进行筛选。

🖼️ 关键图片

📊 实验亮点

GSGTrack在OnePose和HO3D数据集上进行了广泛的实验,结果表明该方法在6DoF姿态跟踪和物体重建方面均取得了显著的性能提升。具体而言,相较于现有方法,GSGTrack在姿态估计的准确性和鲁棒性方面均有明显提高,尤其是在深度信息缺失或不准确的情况下,其性能优势更为突出。实验结果验证了GSGTrack在解决单目RGB视频物体姿态跟踪问题上的有效性。

🎯 应用场景

GSGTrack在机器人操作、增强现实、虚拟现实等领域具有广泛的应用前景。例如,在机器人操作中,可以利用该方法实现对未知物体的精确抓取和操作。在增强现实和虚拟现实中,可以用于实现对真实物体的姿态跟踪,从而实现更逼真的交互体验。该研究的成果有助于推动机器人和计算机视觉技术的发展。

📄 摘要(原文)

Tracking the 6DoF pose of unknown objects in monocular RGB video sequences is crucial for robotic manipulation. However, existing approaches typically rely on accurate depth information, which is non-trivial to obtain in real-world scenarios. Although depth estimation algorithms can be employed, geometric inaccuracy can lead to failures in RGBD-based pose tracking methods. To address this challenge, we introduce GSGTrack, a novel RGB-based pose tracking framework that jointly optimizes geometry and pose. Specifically, we adopt 3D Gaussian Splatting to create an optimizable 3D representation, which is learned simultaneously with a graph-based geometry optimization to capture the object's appearance features and refine its geometry. However, the joint optimization process is susceptible to perturbations from noisy pose and geometry data. Thus, we propose an object silhouette loss to address the issue of pixel-wise loss being overly sensitive to pose noise during tracking. To mitigate the geometric ambiguities caused by inaccurate depth information, we propose a geometry-consistent image pair selection strategy, which filters out low-confidence pairs and ensures robust geometric optimization. Extensive experiments on the OnePose and HO3D datasets demonstrate the effectiveness of GSGTrack in both 6DoF pose tracking and object reconstruction.