Fast LiDAR Data Generation with Rectified Flows

作者: Kazuto Nakashima, Xiaowen Liu, Tomoya Miyawaki, Yumi Iwashita, Ryo Kurazume

分类: cs.CV, cs.RO

发布日期: 2024-12-03 (更新: 2025-03-08)

备注: ICRA 2025

💡 一句话要点

提出R2Flow,一种基于修正流的快速高保真LiDAR数据生成模型,加速机器人应用。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: LiDAR数据生成 修正流 Transformer 自主移动机器人 数据增强

📋 核心要点

- 扩散模型在LiDAR数据生成方面表现出色,但计算成本高昂,限制了其在机器人领域的应用。

- R2Flow基于修正流学习直线轨迹,显著减少采样步骤,从而加速LiDAR数据的生成过程。

- 该方法采用高效的Transformer架构处理LiDAR数据图像表示,并在KITTI-360数据集上验证了其效率和质量。

📝 摘要(中文)

构建LiDAR生成模型有望成为自主移动机器人中用于恢复、场景操作和可扩展仿真的强大数据先验。近年来,使用扩散模型的方法已经出现,显著提高了训练稳定性和生成质量。尽管它们取得了成功,但扩散模型需要多次迭代运行神经网络才能生成高质量的样本,这使得不断增加的计算成本成为机器人应用的潜在障碍。为了解决这个挑战,本文提出了一种快速、高保真的LiDAR数据生成模型R2Flow。我们的方法基于学习直线轨迹的修正流,与扩散模型相比,可以用显著更少的采样步骤来模拟数据生成。我们还提出了一种高效的基于Transformer的模型架构,用于处理LiDAR距离和反射率测量的图像表示。我们在KITTI-360数据集上进行的无条件LiDAR数据生成实验证明了我们方法在效率和质量方面的有效性。

🔬 方法详解

问题定义:现有的基于扩散模型的LiDAR数据生成方法,虽然能够生成高质量的LiDAR数据,但需要大量的计算资源和时间,这使得它们难以应用于对实时性要求较高的机器人应用场景。因此,需要一种更高效的LiDAR数据生成方法。

核心思路:R2Flow的核心思路是利用修正流(Rectified Flows)来学习数据分布之间的直线轨迹。通过学习这种直线轨迹,生成过程可以大大简化,从而减少所需的采样步骤和计算量。与扩散模型逐步去噪的过程不同,修正流直接将噪声分布映射到数据分布,从而实现更快的生成速度。

技术框架:R2Flow的整体框架包括以下几个主要部分:1)LiDAR数据预处理,将原始LiDAR数据转换为图像表示;2)基于Transformer的生成模型,该模型学习从噪声分布到LiDAR数据分布的映射;3)修正流训练,通过优化模型参数,使得噪声到数据的轨迹尽可能接近直线;4)数据生成,通过在学习到的轨迹上进行少量采样,生成新的LiDAR数据。

关键创新:R2Flow的关键创新在于将修正流引入LiDAR数据生成领域。与传统的扩散模型相比,修正流能够学习更简单的生成轨迹,从而显著减少生成所需的计算量。此外,该论文还提出了一种高效的Transformer架构,专门用于处理LiDAR数据的图像表示,进一步提高了生成效率。

关键设计:在模型设计方面,R2Flow采用了Transformer架构,并针对LiDAR数据的特点进行了优化。具体来说,该模型使用了自注意力机制来捕捉LiDAR点之间的关系,并使用了位置编码来保留LiDAR点的空间信息。在损失函数方面,R2Flow使用了基于最优传输的损失函数,该损失函数能够有效地衡量生成数据与真实数据之间的差异,并引导模型学习更准确的生成轨迹。具体的参数设置和网络结构细节在论文中有详细描述。

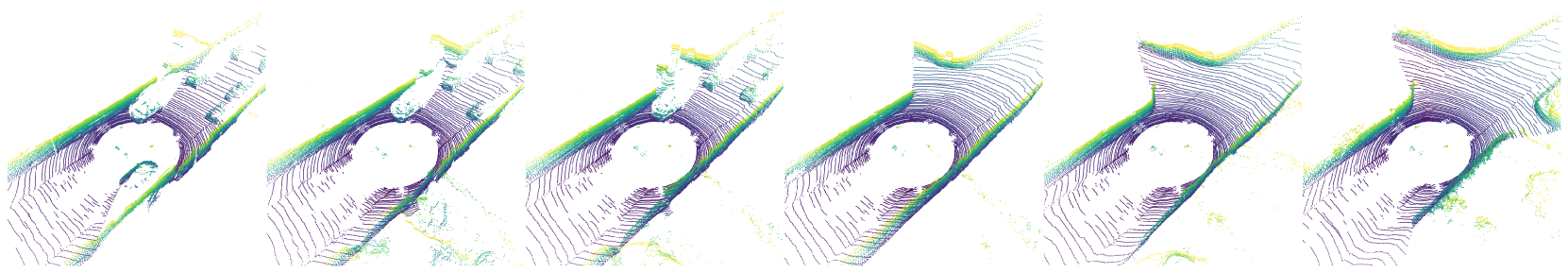

🖼️ 关键图片

📊 实验亮点

R2Flow在KITTI-360数据集上进行了实验,结果表明,与基于扩散模型的现有方法相比,R2Flow能够在显著减少计算量的同时,生成高质量的LiDAR数据。具体来说,R2Flow仅需少量采样步骤即可生成与扩散模型相当质量的LiDAR数据,从而大大提高了生成效率。实验结果验证了R2Flow在效率和质量方面的有效性。

🎯 应用场景

R2Flow在自主移动机器人领域具有广泛的应用前景。它可以用于数据增强,提高机器人感知系统的鲁棒性;可以用于场景操作,例如在虚拟环境中生成逼真的LiDAR数据;还可以用于可扩展的仿真,加速机器人算法的开发和测试。此外,该方法还可以应用于自动驾驶、三维重建等领域。

📄 摘要(原文)

Building LiDAR generative models holds promise as powerful data priors for restoration, scene manipulation, and scalable simulation in autonomous mobile robots. In recent years, approaches using diffusion models have emerged, significantly improving training stability and generation quality. Despite their success, diffusion models require numerous iterations of running neural networks to generate high-quality samples, making the increasing computational cost a potential barrier for robotics applications. To address this challenge, this paper presents R2Flow, a fast and high-fidelity generative model for LiDAR data. Our method is based on rectified flows that learn straight trajectories, simulating data generation with significantly fewer sampling steps compared to diffusion models. We also propose an efficient Transformer-based model architecture for processing the image representation of LiDAR range and reflectance measurements. Our experiments on unconditional LiDAR data generation using the KITTI-360 dataset demonstrate the effectiveness of our approach in terms of both efficiency and quality.