HUGSIM: A Real-Time, Photo-Realistic and Closed-Loop Simulator for Autonomous Driving

作者: Hongyu Zhou, Longzhong Lin, Jiabao Wang, Yichong Lu, Dongfeng Bai, Bingbing Liu, Yue Wang, Andreas Geiger, Yiyi Liao

分类: cs.CV, cs.RO

发布日期: 2024-12-02

备注: Our project page is at https://xdimlab.github.io/HUGSIM

💡 一句话要点

HUGSIM:用于自动驾驶的实时、照片级真实感和闭环仿真器

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 自动驾驶仿真 闭环仿真 照片级真实感 3D高斯溅射 新视角合成

📋 核心要点

- 现有自动驾驶系统评估方法难以全面反映整体性能,需要更全面的评估方法。

- HUGSIM通过3D高斯溅射提升2D图像至3D空间,构建照片级真实感闭环仿真环境。

- HUGSIM提供包含70+序列和400+场景的综合基准,为自动驾驶算法提供公平评估平台。

📝 摘要(中文)

本文提出HUGSIM,一个闭环、照片级真实感和实时的仿真器,用于评估自动驾驶算法。该仿真器通过使用3D高斯溅射将捕获的2D RGB图像提升到3D空间来实现,从而提高闭环场景的渲染质量,并构建闭环环境。在渲染方面,解决了闭环场景中新视角合成的挑战,包括视点外推和360度车辆渲染。除了新视角合成,HUGSIM还实现了完整的闭环仿真,基于控制命令动态更新自我车辆和参与者的状态和观察。此外,HUGSIM提供了一个全面的基准测试,涵盖来自KITTI-360、Waymo、nuScenes和PandaSet的70多个序列,以及400多个不同的场景,为现有的自动驾驶算法提供了一个公平和真实的评估平台。HUGSIM不仅作为一个直观的评估基准,而且还释放了在照片级真实感的闭环环境中微调自动驾驶算法的潜力。

🔬 方法详解

问题定义:自动驾驶算法的评估需要更贴近真实场景的闭环仿真环境。现有的仿真器在真实感、实时性和闭环能力方面存在不足,难以充分评估算法的整体性能,尤其是在复杂场景下的表现。现有方法难以兼顾渲染质量和仿真效率,无法满足自动驾驶算法的训练和测试需求。

核心思路:HUGSIM的核心思路是利用3D高斯溅射技术,从真实世界的图像数据中重建出高质量的3D场景,并在此基础上构建闭环仿真环境。通过这种方式,HUGSIM能够提供照片级真实感的渲染效果,同时保持较高的仿真效率。此外,HUGSIM还考虑了闭环仿真的特殊需求,例如视点外推和360度车辆渲染等问题。

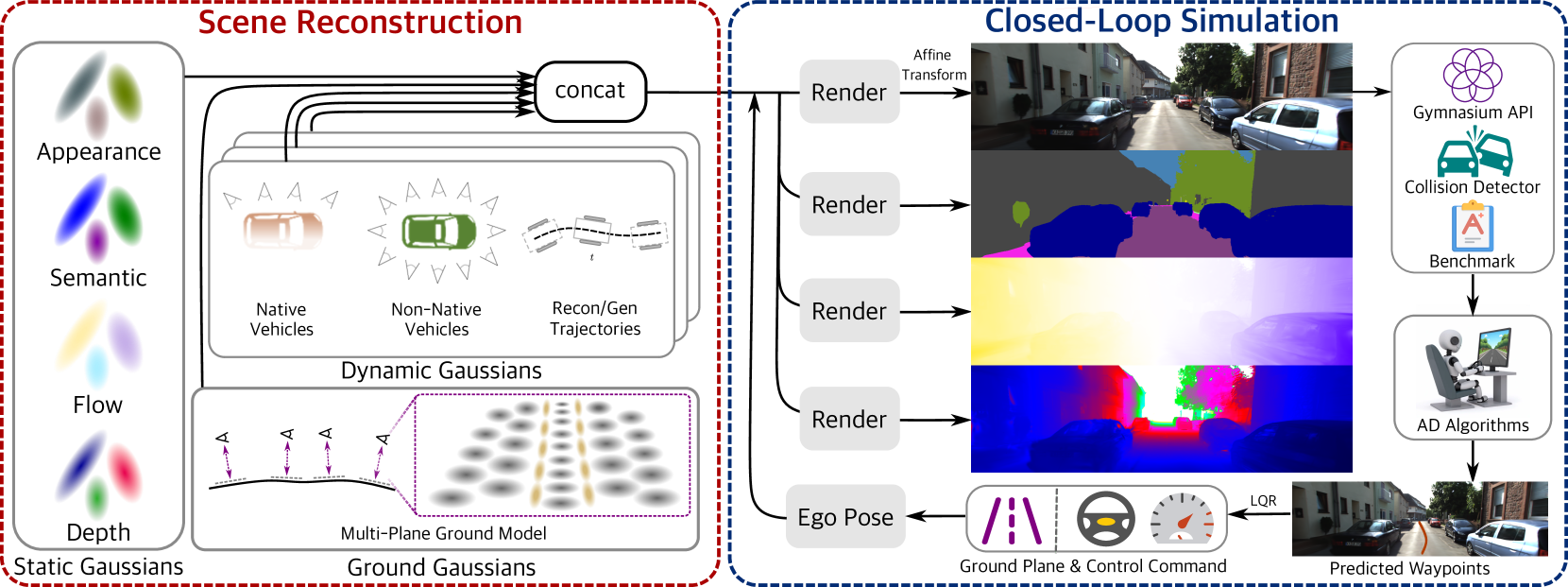

技术框架:HUGSIM的整体框架包括以下几个主要模块:1) 场景重建模块:使用3D高斯溅射技术将2D RGB图像提升到3D空间,生成高质量的3D场景。2) 渲染模块:负责将3D场景渲染成逼真的图像,并支持新视角的合成。3) 闭环控制模块:根据自动驾驶算法的控制指令,动态更新自我车辆和参与者的状态,并生成相应的观察数据。4) 评估模块:提供各种评估指标,用于评估自动驾驶算法的性能。

关键创新:HUGSIM的关键创新在于以下几个方面:1) 采用3D高斯溅射技术进行场景重建,实现了照片级真实感的渲染效果。2) 针对闭环仿真的特殊需求,提出了视点外推和360度车辆渲染等解决方案。3) 构建了一个包含大量真实世界数据的综合基准,为自动驾驶算法的评估提供了公平和真实的平台。4) 实现了实时仿真,能够满足自动驾驶算法的在线训练和测试需求。

关键设计:HUGSIM的关键设计包括:1) 使用高斯分布表示3D场景中的点,并通过优化高斯分布的参数来提高渲染质量。2) 采用基于图像的渲染技术,避免了复杂的几何建模过程。3) 设计了高效的闭环控制算法,能够实时更新车辆状态和生成观察数据。4) 针对不同的自动驾驶算法,提供了灵活的评估指标。

🖼️ 关键图片

📊 实验亮点

HUGSIM在多个数据集上进行了评估,包括KITTI-360、Waymo、nuScenes和PandaSet。实验结果表明,HUGSIM能够生成照片级真实感的渲染效果,并支持实时仿真。此外,HUGSIM还能够有效地评估自动驾驶算法的性能,并为算法的改进提供指导。相较于其他仿真器,HUGSIM在渲染质量、仿真效率和闭环能力方面具有显著优势。

🎯 应用场景

HUGSIM可应用于自动驾驶算法的开发、测试和验证。它能够提供一个安全、高效和经济的仿真环境,帮助开发者快速迭代算法,并提高算法的鲁棒性和可靠性。此外,HUGSIM还可以用于自动驾驶系统的性能评估和安全认证,为自动驾驶技术的商业化应用提供保障。未来,HUGSIM有望成为自动驾驶领域的重要工具,推动自动驾驶技术的快速发展。

📄 摘要(原文)

In the past few decades, autonomous driving algorithms have made significant progress in perception, planning, and control. However, evaluating individual components does not fully reflect the performance of entire systems, highlighting the need for more holistic assessment methods. This motivates the development of HUGSIM, a closed-loop, photo-realistic, and real-time simulator for evaluating autonomous driving algorithms. We achieve this by lifting captured 2D RGB images into the 3D space via 3D Gaussian Splatting, improving the rendering quality for closed-loop scenarios, and building the closed-loop environment. In terms of rendering, We tackle challenges of novel view synthesis in closed-loop scenarios, including viewpoint extrapolation and 360-degree vehicle rendering. Beyond novel view synthesis, HUGSIM further enables the full closed simulation loop, dynamically updating the ego and actor states and observations based on control commands. Moreover, HUGSIM offers a comprehensive benchmark across more than 70 sequences from KITTI-360, Waymo, nuScenes, and PandaSet, along with over 400 varying scenarios, providing a fair and realistic evaluation platform for existing autonomous driving algorithms. HUGSIM not only serves as an intuitive evaluation benchmark but also unlocks the potential for fine-tuning autonomous driving algorithms in a photorealistic closed-loop setting.