6DOPE-GS: Online 6D Object Pose Estimation using Gaussian Splatting

作者: Yufeng Jin, Vignesh Prasad, Snehal Jauhri, Mathias Franzius, Georgia Chalvatzaki

分类: cs.CV, cs.RO

发布日期: 2024-12-02 (更新: 2025-04-03)

💡 一句话要点

6DOPE-GS:利用高斯溅射实现实时6D物体姿态估计与跟踪

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 6D姿态估计 高斯溅射 实时跟踪 无模型方法 RGB-D相机

📋 核心要点

- 现有无模型6D物体姿态估计方法在实时RGB-D视频流中渲染和推断任意物体的一致姿态时,计算负担过高。

- 6DOPE-GS利用高斯溅射的快速可微渲染能力,同时优化6D物体姿态和3D物体重建,实现高效的在线姿态估计。

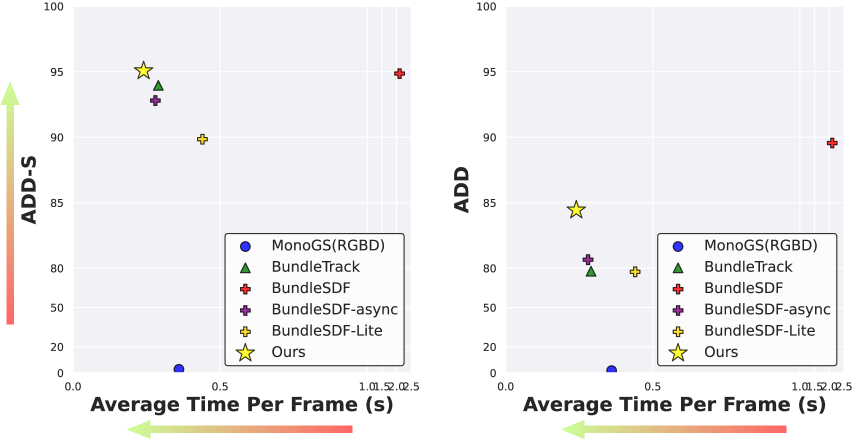

- 实验表明,6DOPE-GS在HO3D和YCBInEOAT数据集上与SOTA基线性能相当,同时速度提升5倍,并适用于真实场景。

📝 摘要(中文)

本文提出了一种名为6DOPE-GS的新方法,用于利用单个RGB-D相机进行在线6D物体姿态估计和跟踪,该方法有效地利用了高斯溅射的最新进展。 借助高斯溅射的快速可微渲染能力,6DOPE-GS可以同时优化6D物体姿态和3D物体重建。 为了实现实时跟踪所需的效率和准确性,该方法采用增量2D高斯溅射和智能动态关键帧选择程序,以实现高空间物体覆盖率并防止错误的姿态更新。 此外,还提出了一种基于不透明度统计的剪枝机制,用于自适应高斯密度控制,以确保训练的稳定性和效率。 在HO3D和YCBInEOAT数据集上的评估表明,6DOPE-GS在无模型同步6D姿态跟踪和重建方面与最先进的基线相匹配,同时提供了5倍的加速。 此外,还展示了该方法在真实环境中实时动态物体跟踪和重建方面的适用性。

🔬 方法详解

问题定义:论文旨在解决在实时RGB-D视频流中,对任意物体的6D姿态进行高效、准确估计和跟踪的问题。现有无模型方法的主要痛点在于渲染和推断一致姿态时计算量巨大,难以满足实时性要求。

核心思路:论文的核心思路是利用高斯溅射(Gaussian Splatting)的快速可微渲染能力,将6D姿态估计问题转化为一个可微优化问题,从而可以同时优化物体的6D姿态和3D重建。高斯溅射能够高效地表示和渲染三维场景,使其成为实时姿态估计的理想选择。

技术框架:6DOPE-GS的整体框架包括以下几个主要模块:1) 增量2D高斯溅射:使用2D高斯分布来表示物体,并随着新帧的到来进行增量更新。2) 动态关键帧选择:智能地选择关键帧,以保证物体的高空间覆盖率,并防止错误的姿态更新。3) 基于不透明度统计的剪枝:根据高斯分布的不透明度统计信息,自适应地控制高斯密度,以提高训练的稳定性和效率。4) 姿态优化:利用可微渲染,通过最小化渲染图像与输入图像之间的差异来优化6D姿态。

关键创新:该方法最重要的创新点在于将高斯溅射引入到无模型6D物体姿态估计中,利用其快速可微渲染的优势,实现了实时、准确的姿态估计和跟踪。与现有方法相比,6DOPE-GS避免了复杂的模型训练过程,可以直接对任意物体进行姿态估计。

关键设计:关键设计包括:1) 增量2D高斯溅射的更新策略,保证了实时性和准确性。2) 动态关键帧选择策略,避免了冗余计算和错误更新。3) 基于不透明度统计的剪枝机制,提高了训练的稳定性和效率。损失函数主要由渲染图像与输入图像之间的光度误差构成,通过优化该损失函数来更新6D姿态和高斯参数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,6DOPE-GS在HO3D和YCBInEOAT数据集上取得了与最先进基线相当的性能,同时实现了5倍的加速。此外,该方法还在真实场景中展示了实时动态物体跟踪和重建的能力,验证了其在实际应用中的可行性。

🎯 应用场景

该研究成果可广泛应用于增强现实、自动驾驶和机器人等领域。在增强现实中,可以实现对虚拟物体与真实场景的精确对齐。在自动驾驶中,可以用于感知和跟踪周围的物体,提高驾驶安全性。在机器人领域,可以帮助机器人更好地理解和操作周围环境。

📄 摘要(原文)

Efficient and accurate object pose estimation is an essential component for modern vision systems in many applications such as Augmented Reality, autonomous driving, and robotics. While research in model-based 6D object pose estimation has delivered promising results, model-free methods are hindered by the high computational load in rendering and inferring consistent poses of arbitrary objects in a live RGB-D video stream. To address this issue, we present 6DOPE-GS, a novel method for online 6D object pose estimation \& tracking with a single RGB-D camera by effectively leveraging advances in Gaussian Splatting. Thanks to the fast differentiable rendering capabilities of Gaussian Splatting, 6DOPE-GS can simultaneously optimize for 6D object poses and 3D object reconstruction. To achieve the necessary efficiency and accuracy for live tracking, our method uses incremental 2D Gaussian Splatting with an intelligent dynamic keyframe selection procedure to achieve high spatial object coverage and prevent erroneous pose updates. We also propose an opacity statistic-based pruning mechanism for adaptive Gaussian density control, to ensure training stability and efficiency. We evaluate our method on the HO3D and YCBInEOAT datasets and show that 6DOPE-GS matches the performance of state-of-the-art baselines for model-free simultaneous 6D pose tracking and reconstruction while providing a 5$\times$ speedup. We also demonstrate the method's suitability for live, dynamic object tracking and reconstruction in a real-world setting.