Towards Unified Molecule-Enhanced Pathology Image Representation Learning via Integrating Spatial Transcriptomics

作者: Minghao Han, Dingkang Yang, Jiabei Cheng, Xukun Zhang, Linhao Qu, Zizhi Chen, Lihua Zhang

分类: cs.CV, q-bio.GN

发布日期: 2024-12-01

备注: 21 pages, 11 figures, 7 tables

🔗 代码/项目: GITHUB

💡 一句话要点

UMPIRE:融合空间转录组学,提升病理图像分子增强表示学习

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 计算病理学 空间转录组学 多模态学习 分子增强 图像表示学习

📋 核心要点

- 现有计算病理学方法主要依赖视觉-语言模型,缺乏分子层面的信息,导致性能瓶颈。

- UMPIRE框架通过整合空间转录组学数据,指导多模态预训练,提升病理图像表示的分子感知能力。

- 实验表明,UMPIRE在基因表达预测、斑点分类和突变状态预测等任务上表现出色,验证了其有效性。

📝 摘要(中文)

本文提出了一种统一的分子增强病理图像表示学习框架(UMPIRE)。该框架旨在利用基因表达谱的互补信息来指导多模态预训练,从而增强病理图像表示学习的分子感知能力。研究表明,这种分子视角为学习病理图像嵌入提供了一个鲁棒且与任务无关的训练信号。由于配对数据的稀缺性,收集了约400万条空间转录组学基因表达数据来训练基因编码器。通过利用强大的预训练编码器,UMPIRE对齐了超过69.7万个病理图像-基因表达对的编码器。UMPIRE的性能在各种分子相关的下游任务中得到了验证,包括基因表达预测、斑点分类和全切片图像中的突变状态预测。研究结果强调了多模态数据集成的重要性,并为探索分子视角增强的计算病理学开辟了新的途径。代码和预训练权重可在https://github.com/Hanminghao/UMPIRE获取。

🔬 方法详解

问题定义:现有计算病理学方法主要依赖视觉信息,忽略了分子层面的信息,限制了模型对疾病机制的理解和预测能力。缺乏有效的手段将基因表达信息融入到病理图像的表示学习中,导致模型在分子相关的下游任务中表现不佳。

核心思路:UMPIRE的核心思路是利用空间转录组学数据提供的基因表达信息,作为一种分子层面的指导信号,来增强病理图像的表示学习。通过将病理图像和对应的基因表达谱对齐,模型可以学习到更具有生物学意义的图像特征,从而提升在分子相关任务中的性能。

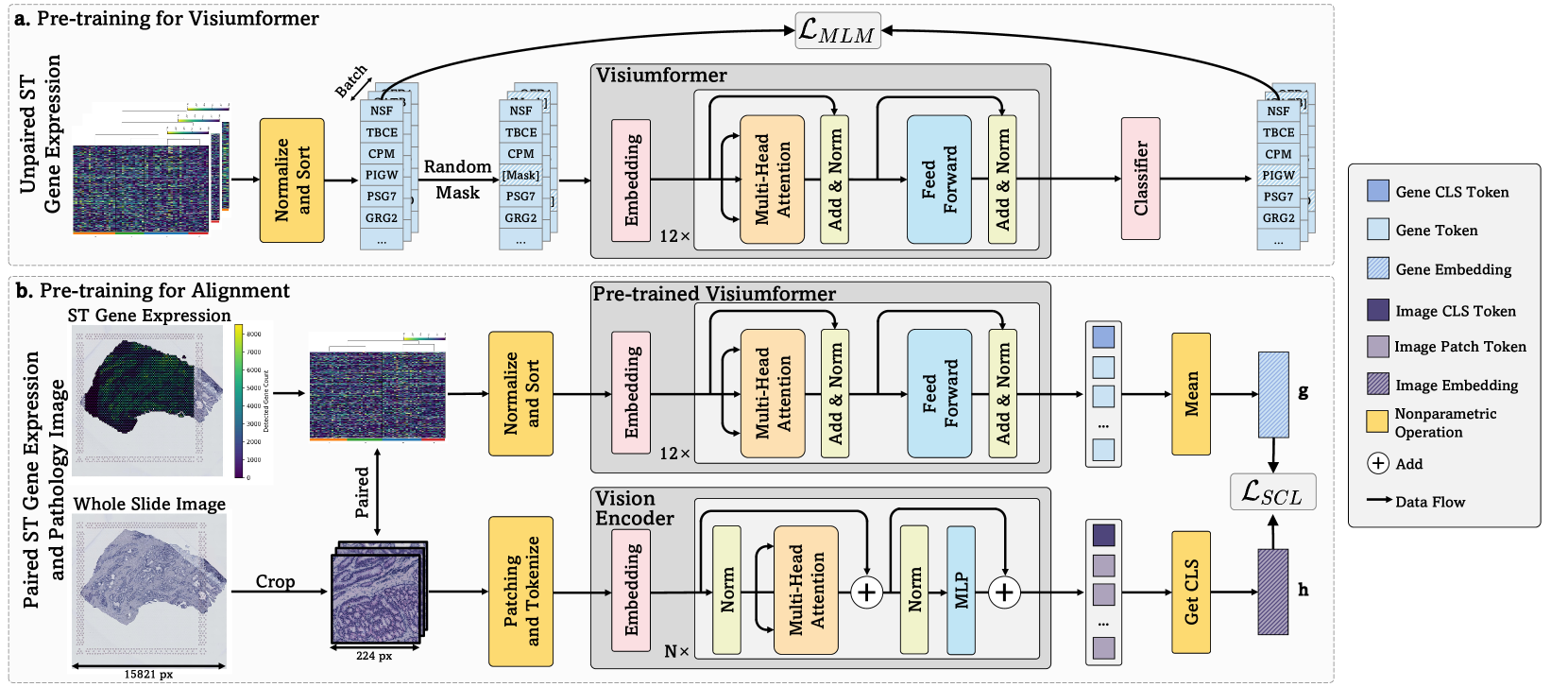

技术框架:UMPIRE框架包含以下主要模块:1) 病理图像编码器:用于提取病理图像的视觉特征。2) 基因表达编码器:用于提取空间转录组学数据的基因表达特征。3) 对齐模块:通过对比学习等方法,将病理图像特征和基因表达特征对齐到同一个嵌入空间。4) 下游任务模块:利用学习到的图像表示进行基因表达预测、斑点分类和突变状态预测等任务。

关键创新:UMPIRE的关键创新在于将空间转录组学数据引入到病理图像的表示学习中,从而实现了分子增强的病理图像表示。与传统的视觉-语言模型相比,UMPIRE能够更好地捕捉病理图像中的生物学信息,从而提升在分子相关任务中的性能。

关键设计:UMPIRE使用了大量的空间转录组学数据(约400万条)来训练基因表达编码器。为了实现病理图像和基因表达谱的对齐,UMPIRE采用了对比学习的损失函数。此外,UMPIRE还使用了预训练的图像编码器和基因表达编码器,以加速模型的训练和提升模型的性能。

🖼️ 关键图片

📊 实验亮点

UMPIRE在多个分子相关的下游任务中取得了显著的性能提升。例如,在基因表达预测任务中,UMPIRE的性能优于现有的视觉-语言模型。在斑点分类和突变状态预测任务中,UMPIRE也取得了具有竞争力的结果。这些实验结果表明,UMPIRE能够有效地利用空间转录组学数据来增强病理图像的表示学习。

🎯 应用场景

UMPIRE框架可应用于多种计算病理学任务,例如基因表达预测、肿瘤亚型分类、药物反应预测等。通过整合分子信息,UMPIRE可以帮助医生更准确地诊断疾病、制定治疗方案,并加速新药研发。该研究为开发更智能、更精准的计算病理学工具奠定了基础。

📄 摘要(原文)

Recent advancements in multimodal pre-training models have significantly advanced computational pathology. However, current approaches predominantly rely on visual-language models, which may impose limitations from a molecular perspective and lead to performance bottlenecks. Here, we introduce a Unified Molecule-enhanced Pathology Image REpresentationn Learning framework (UMPIRE). UMPIRE aims to leverage complementary information from gene expression profiles to guide the multimodal pre-training, enhancing the molecular awareness of pathology image representation learning. We demonstrate that this molecular perspective provides a robust, task-agnostic training signal for learning pathology image embeddings. Due to the scarcity of paired data, approximately 4 million entries of spatial transcriptomics gene expression were collected to train the gene encoder. By leveraging powerful pre-trained encoders, UMPIRE aligns the encoders across over 697K pathology image-gene expression pairs. The performance of UMPIRE is demonstrated across various molecular-related downstream tasks, including gene expression prediction, spot classification, and mutation state prediction in whole slide images. Our findings highlight the effectiveness of multimodal data integration and open new avenues for exploring computational pathology enhanced by molecular perspectives. The code and pre-trained weights are available at https://github.com/Hanminghao/UMPIRE.