Sketch-Guided Motion Diffusion for Stylized Cinemagraph Synthesis

作者: Hao Jin, Hengyuan Chang, Xiaoxuan Xie, Zhengyang Wang, Xusheng Du, Shaojun Hu, Haoran Xie

分类: cs.CV, cs.GR

发布日期: 2024-12-01

备注: 14 pages, 20 figures

💡 一句话要点

提出Sketch2Cinemagraph,通过草图引导的运动扩散生成风格化电影图

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 电影图生成 草图引导 运动扩散模型 风格化图像 潜在空间 图像合成

📋 核心要点

- 现有电影图设计方法难以定制复杂且富有表现力的流动运动,限制了创作的灵活性和个性化。

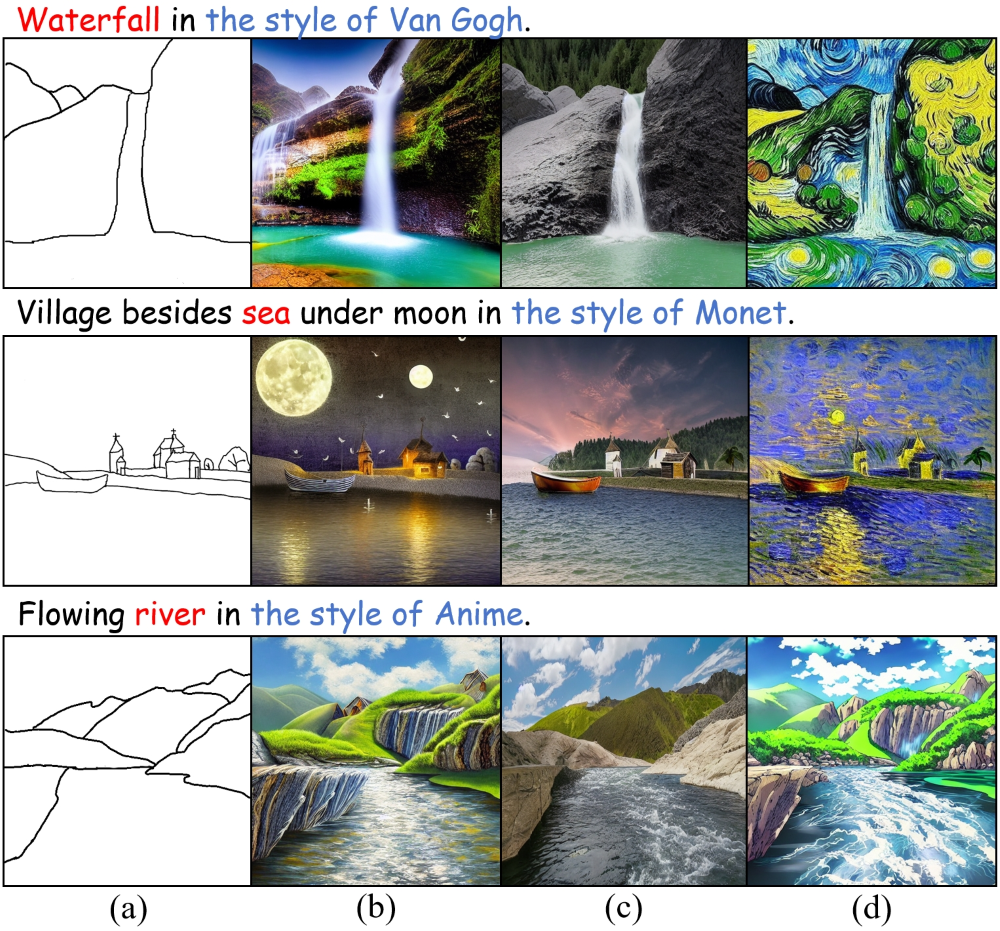

- Sketch2Cinemagraph利用草图直观地控制电影图的空间和运动,结合文本提示生成初始内容,实现更精细的定制。

- 实验表明,该方法能生成高保真、美观且具有连续时间流的风格化电影图,优于现有技术水平。

📝 摘要(中文)

本文提出了一种名为Sketch2Cinemagraph的草图引导框架,用于从手绘草图有条件地生成风格化电影图。该方法利用文本提示进行初始内容生成,并提供手绘草图控制,以实现空间和运动线索的定制。采用潜在扩散模型生成目标风格化景观图像及其对应的真实版本。利用预训练的目标检测模型分割并获得流动区域的掩码。提出了一种新的潜在运动扩散模型,用于估计生成景观图像中流动区域的运动场。输入的运动草图作为条件,用于控制带提示的掩码流动区域中生成的矢量场。为了合成电影图帧,使用帧生成器将流动区域内的像素在每个时间步扭曲到目标位置。实验结果验证了Sketch2Cinemagraph能够从直观的草图输入生成具有连续时间流的高保真和美观的风格化电影图。通过与最先进的生成方法进行定量比较,展示了Sketch2Cinemagraph的优势。

🔬 方法详解

问题定义:现有电影图生成方法在控制复杂和富有表现力的流动运动方面存在困难,用户难以通过简单的文本提示精确地表达其设计意图,导致生成结果缺乏个性化和定制性。因此,如何提供一种更直观、更精细的控制方式,以生成具有用户期望的风格化运动效果的电影图,是本文要解决的核心问题。

核心思路:本文的核心思路是利用手绘草图作为引导,结合潜在扩散模型和运动扩散模型,实现对电影图中流动区域运动的精确控制。通过草图,用户可以直观地指定流动区域的运动方向和强度,从而实现对电影图风格化运动的精细定制。这种方法将用户的创造性意图直接融入到生成过程中,提高了生成结果的可控性和个性化。

技术框架:Sketch2Cinemagraph框架主要包含以下几个阶段:1) 内容生成:使用文本提示和潜在扩散模型生成初始的风格化景观图像及其对应的真实版本。2) 区域分割:利用预训练的目标检测模型对生成的图像进行分割,提取出流动区域的掩码。3) 运动扩散:提出潜在运动扩散模型,以输入的运动草图为条件,估计流动区域的运动场。4) 帧生成:使用帧生成器,根据估计的运动场,将流动区域内的像素在每个时间步扭曲到目标位置,从而合成电影图帧。

关键创新:该论文的关键创新在于提出了草图引导的潜在运动扩散模型。与传统的基于文本或图像的电影图生成方法不同,该方法允许用户通过手绘草图直接控制流动区域的运动,从而实现更精细、更直观的定制。此外,将运动扩散模型应用于潜在空间,提高了生成效率和质量。

关键设计:在运动扩散模型中,运动草图被编码为条件信息,用于指导运动场的生成。损失函数的设计旨在确保生成的运动场与草图指定的运动方向和强度一致。帧生成器采用光流扭曲技术,根据估计的运动场,将流动区域内的像素在每个时间步进行扭曲,从而生成具有连续时间流的电影图帧。具体的网络结构和参数设置在论文中有详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Sketch2Cinemagraph能够生成高保真、美观且具有连续时间流的风格化电影图。通过与现有最先进的生成方法进行定量比较,Sketch2Cinemagraph在图像质量和运动效果方面均取得了显著提升(具体性能数据未知)。用户研究表明,该方法能够有效地满足用户对电影图风格化运动的定制需求。

🎯 应用场景

该研究成果可应用于数字艺术创作、广告设计、游戏开发等领域。艺术家和设计师可以利用该方法快速生成具有个性化风格的电影图,用于艺术展示或商业宣传。游戏开发者可以利用该方法创建动态的游戏场景,提升游戏的视觉效果和沉浸感。此外,该技术还可用于教育领域,帮助学生学习和理解流体运动的规律。

📄 摘要(原文)

Designing stylized cinemagraphs is challenging due to the difficulty in customizing complex and expressive flow motions. To achieve intuitive and detailed control of the generated cinemagraphs, freehand sketches can provide a better solution to convey personalized design requirements than only text inputs. In this paper, we propose Sketch2Cinemagraph, a sketch-guided framework that enables the conditional generation of stylized cinemagraphs from freehand sketches. Sketch2Cinemagraph adopts text prompts for initial content generation and provides hand-drawn sketch controls for both spatial and motion cues. The latent diffusion model is adopted to generate target stylized landscape images along with realistic versions. Then, a pre-trained object detection model is utilized to segment and obtain masks for the flow regions. We proposed a novel latent motion diffusion model to estimate the motion field in the fluid regions of the generated landscape images. The input motion sketches serve as the conditions to control the generated vector fields in the masked fluid regions with the prompt. To synthesize the cinemagraph frames, the pixels within fluid regions are subsequently warped to the target locations for each timestep using a frame generator. The results verified that Sketch2Cinemagraph can generate high-fidelity and aesthetically appealing stylized cinemagraphs with continuous temporal flow from intuitive sketch inputs. We showcase the advantages of Sketch2Cinemagraph through quantitative comparisons against the state-of-the-art generation approaches.