Speedy-Splat: Fast 3D Gaussian Splatting with Sparse Pixels and Sparse Primitives

作者: Alex Hanson, Allen Tu, Geng Lin, Vasu Singla, Matthias Zwicker, Tom Goldstein

分类: cs.CV, cs.GR

发布日期: 2024-11-30 (更新: 2025-08-14)

备注: CVPR 2025, Project Page: https://speedysplat.github.io/

💡 一句话要点

Speedy-Splat:通过稀疏像素和图元加速3D高斯溅射渲染。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 实时渲染 场景重建 模型压缩 渲染优化 剪枝算法 稀疏表示

📋 核心要点

- 3D高斯溅射虽然能实时渲染新视角,但渲染速度和模型大小仍有优化空间,尤其在资源受限场景。

- Speedy-Splat通过优化渲染管线精确定位高斯函数,并引入剪枝技术减少模型大小和训练时间。

- 实验表明,Speedy-Splat在多个数据集上实现了平均6.71倍的渲染速度提升,并减小了模型尺寸。

📝 摘要(中文)

3D高斯溅射(3D-GS)是一种新兴的3D场景重建技术,它通过将场景建模为可微3D高斯函数的参数化点云,从而实现新视角的实时渲染。然而,其渲染速度和模型大小仍然是瓶颈,尤其是在资源受限的环境中。本文针对3D-GS中的两个关键低效之处进行了分析和改进,从而显著提高了渲染速度。这些改进也带来了模型尺寸和训练时间减少的额外好处。首先,我们优化了渲染管线,以精确定位场景中的高斯函数,从而在不改变视觉保真度的情况下提高渲染速度。其次,我们引入了一种新颖的剪枝技术,并将其集成到训练管线中,从而显著减小模型尺寸和训练时间,同时进一步提高渲染速度。我们的Speedy-Splat方法结合了这些技术,在Mip-NeRF 360、Tanks & Temples和Deep Blending数据集的场景中,平均渲染速度提高了6.71倍。

🔬 方法详解

问题定义:3D高斯溅射(3D-GS)在实时渲染高质量新视角方面表现出色,但其渲染速度和模型大小仍然是实际应用中的瓶颈,尤其是在移动设备或嵌入式系统等资源受限的环境中。现有方法在定位高斯函数和模型压缩方面存在效率问题,导致渲染速度受限,模型存储需求高,训练时间长。

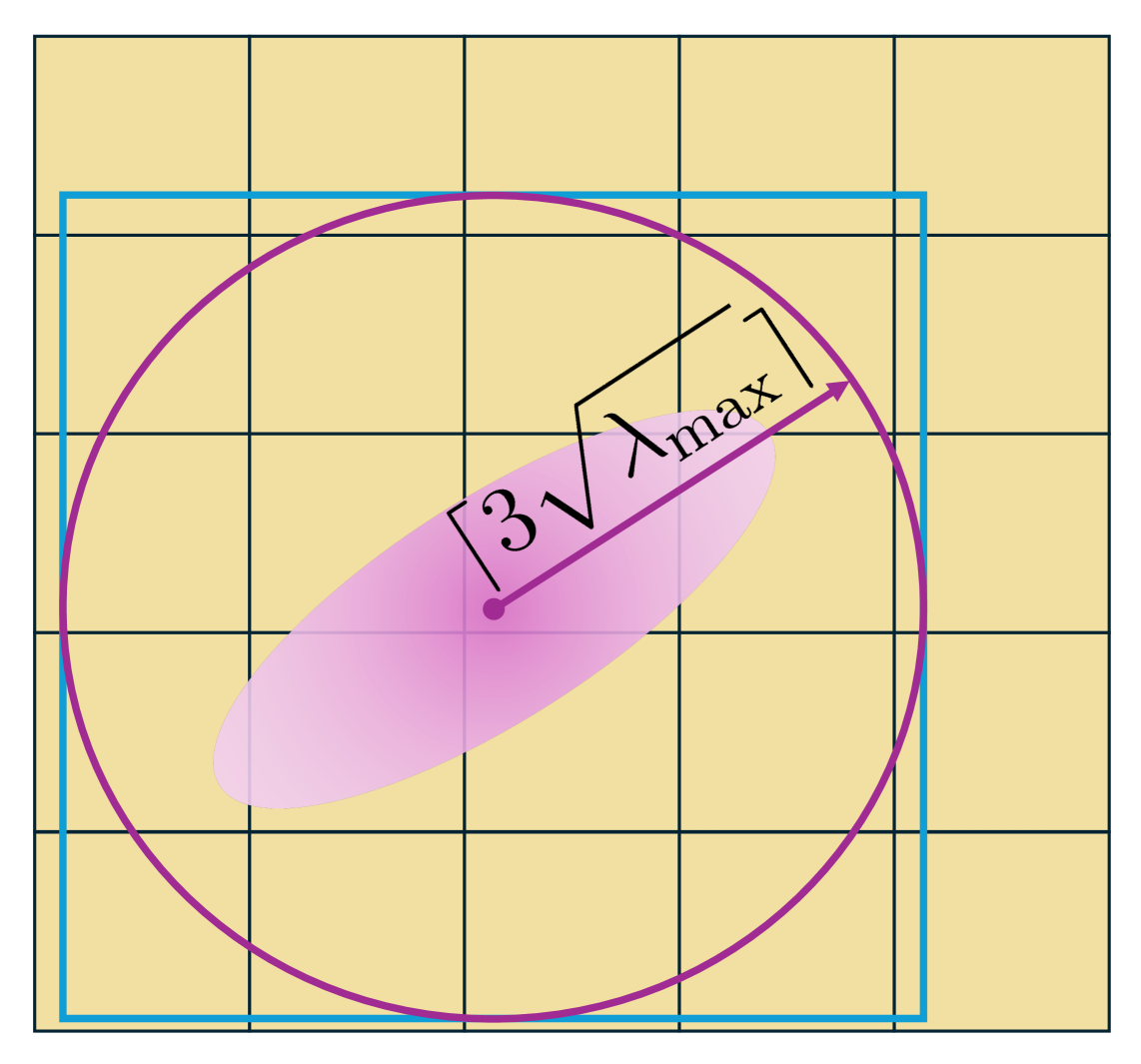

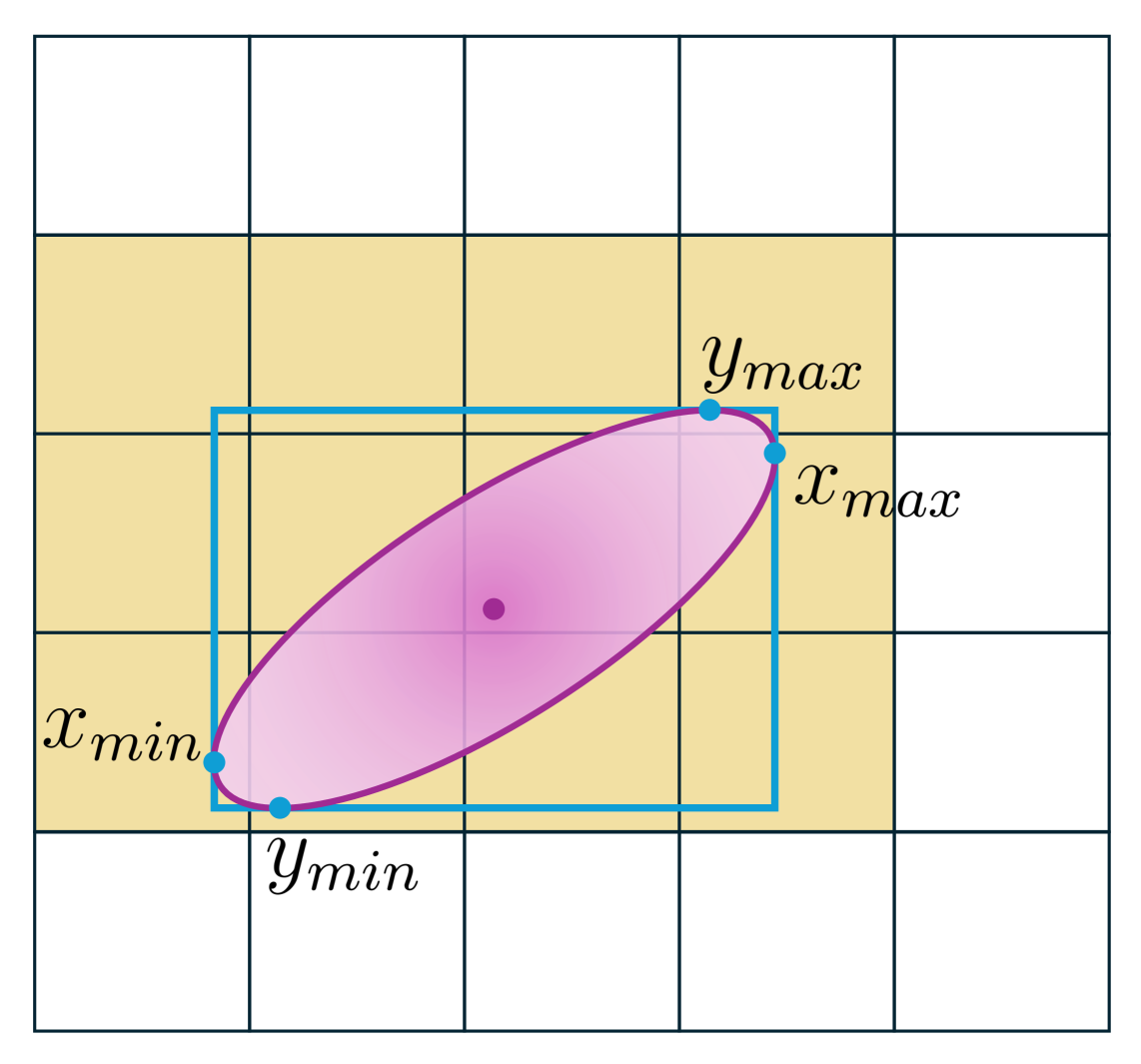

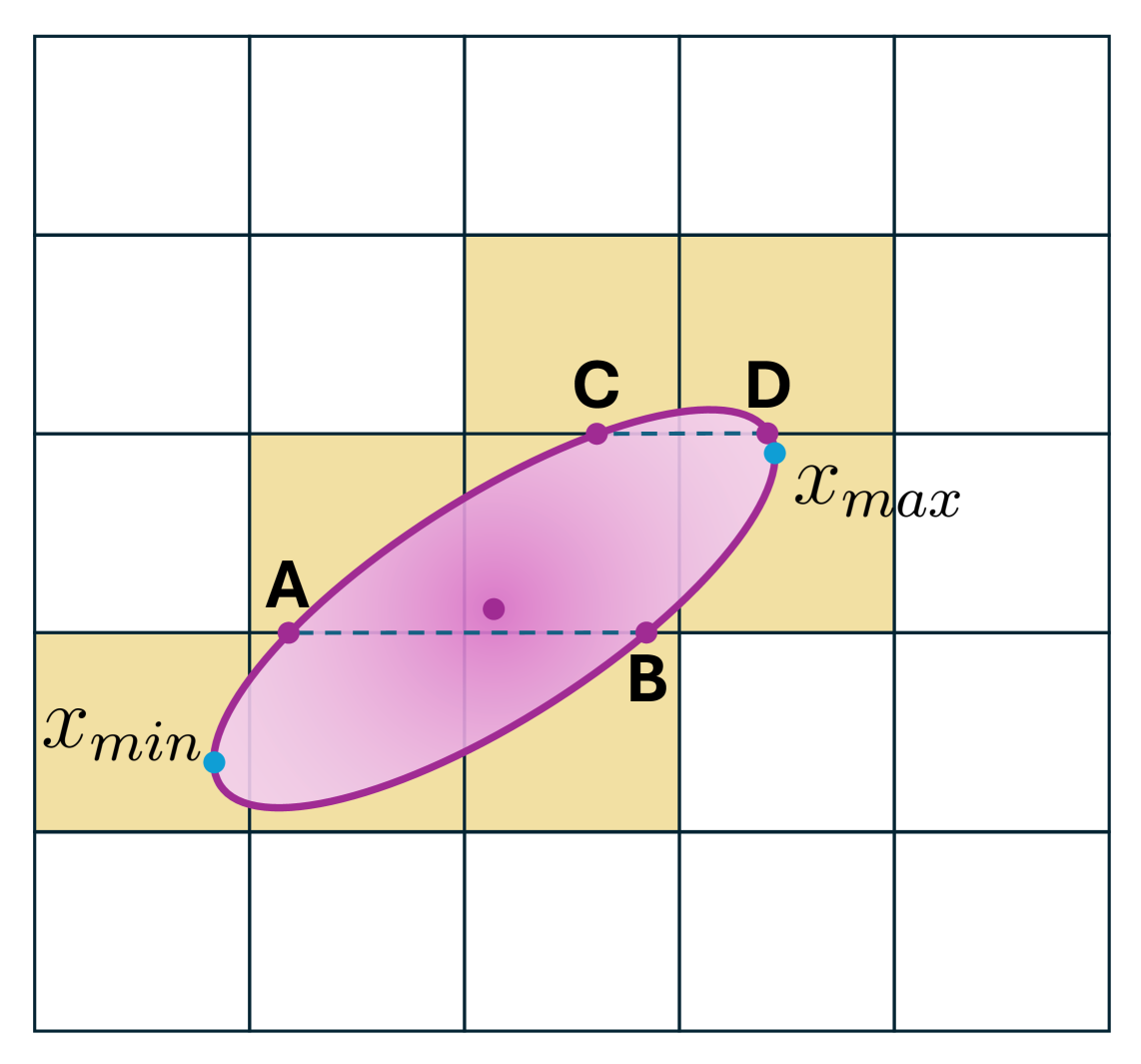

核心思路:Speedy-Splat的核心思路是通过优化渲染管线和引入新的剪枝技术来解决3D-GS的效率问题。优化渲染管线旨在更精确地定位场景中的高斯函数,从而减少不必要的计算。新的剪枝技术旨在减少模型中冗余的高斯函数,从而减小模型大小并加速训练和渲染。

技术框架:Speedy-Splat的整体框架包括两个主要部分:优化的渲染管线和集成了剪枝技术的训练管线。优化的渲染管线通过改进高斯函数的定位算法来提高渲染效率。集成了剪枝技术的训练管线在训练过程中动态地移除不重要的高斯函数,从而减小模型大小。这两个部分协同工作,共同提高渲染速度并减小模型大小。

关键创新:Speedy-Splat的关键创新点在于:1) 优化了渲染管线,使其能够更精确地定位高斯函数,从而减少了不必要的计算;2) 引入了一种新颖的剪枝技术,该技术能够在训练过程中有效地移除冗余的高斯函数,从而减小模型大小。与现有方法相比,Speedy-Splat在渲染效率和模型大小方面都取得了显著的提升。

关键设计:关于渲染管线优化,论文可能涉及对高斯函数可见性判断的加速,例如通过更高效的视锥体裁剪或遮挡剔除算法。剪枝技术可能基于高斯函数的不透明度、梯度或其他重要性指标,并设置相应的阈值来决定是否移除某个高斯函数。损失函数可能包含正则化项,以鼓励模型生成更稀疏的高斯函数分布。具体的参数设置和网络结构细节未知,需要查阅论文全文。

🖼️ 关键图片

📊 实验亮点

Speedy-Splat在Mip-NeRF 360、Tanks & Temples和Deep Blending数据集上进行了评估,实验结果表明,Speedy-Splat在平均渲染速度上实现了6.71倍的提升。此外,Speedy-Splat还显著减小了模型大小和训练时间,而视觉质量没有明显下降。这些结果表明,Speedy-Splat是一种高效且有效的3D-GS加速方法。

🎯 应用场景

Speedy-Splat在需要实时渲染3D场景的各种应用中具有广泛的潜力,例如移动增强现实(AR)、虚拟现实(VR)、机器人导航、游戏开发和自动驾驶。通过提高渲染速度和减小模型大小,Speedy-Splat使得在资源受限的设备上部署3D-GS成为可能,从而扩展了其应用范围。该技术还有助于加速3D场景的重建和编辑过程,提高工作效率。

📄 摘要(原文)

3D Gaussian Splatting (3D-GS) is a recent 3D scene reconstruction technique that enables real-time rendering of novel views by modeling scenes as parametric point clouds of differentiable 3D Gaussians. However, its rendering speed and model size still present bottlenecks, especially in resource-constrained settings. In this paper, we identify and address two key inefficiencies in 3D-GS to substantially improve rendering speed. These improvements also yield the ancillary benefits of reduced model size and training time. First, we optimize the rendering pipeline to precisely localize Gaussians in the scene, boosting rendering speed without altering visual fidelity. Second, we introduce a novel pruning technique and integrate it into the training pipeline, significantly reducing model size and training time while further raising rendering speed. Our Speedy-Splat approach combines these techniques to accelerate average rendering speed by a drastic $\mathit{6.71\times}$ across scenes from the Mip-NeRF 360, Tanks & Temples, and Deep Blending datasets.